Spark集群启动后进程的简单介绍

Posted 大冰的小屋

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Spark集群启动后进程的简单介绍相关的知识,希望对你有一定的参考价值。

刚开始学习Spark,首先看一下Spark集群启动之后都会产生哪些进程,方便查看集群是否启动正常。首先介绍下我的Spark集群是以Hadoop的HDFS作为分布式文件存储系统,资源管理系统既可以使用Hadoop的Yarn,也可以使用Spark自带的Standalone模式,当然也可以使用其他的资源管理系统,例如Mesos、EC2等。

我的测试集群是一个master节点和4个worker节点

启动HDFS会产生哪些进程

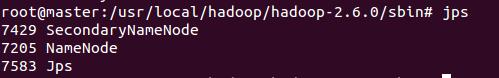

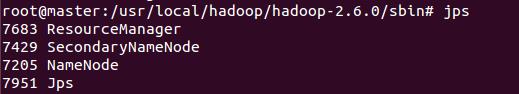

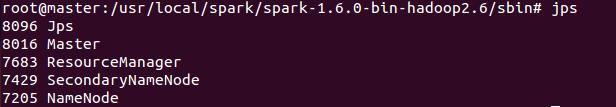

在master节点上会产生NameNode进程和SecondaryNameNode进程。NameNode进程管理集群的全局数据,而SecondaryNameNode是NameNode的备份,这么做是为了容错。

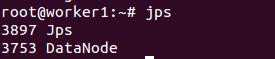

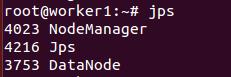

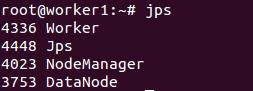

在worker节点上会产生DataNode进程,该进程管理本台worker上的数据。

启动yarn会产生哪些进程

在master上会产生ResourceManager进程,该进程管理整个集群的内存和CPU等资源。

在worker节点上会产生DataNode进程,该进程管理本worker上的内存和CPU等资源。

启动Spark会产生哪些进程(运行在Standalone模式下)

在master节点上会产生Master进程,该进程管理整个集群的资源。

在worker节点上会产生Worker进程,该进程管理本worker上的资源

这里先做简单的记录,随着学习的深入再不断补充完善。

以上是关于Spark集群启动后进程的简单介绍的主要内容,如果未能解决你的问题,请参考以下文章