MIT 18.06 线性代数总结(Part I)

Posted Xurtle

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了MIT 18.06 线性代数总结(Part I)相关的知识,希望对你有一定的参考价值。

Overview

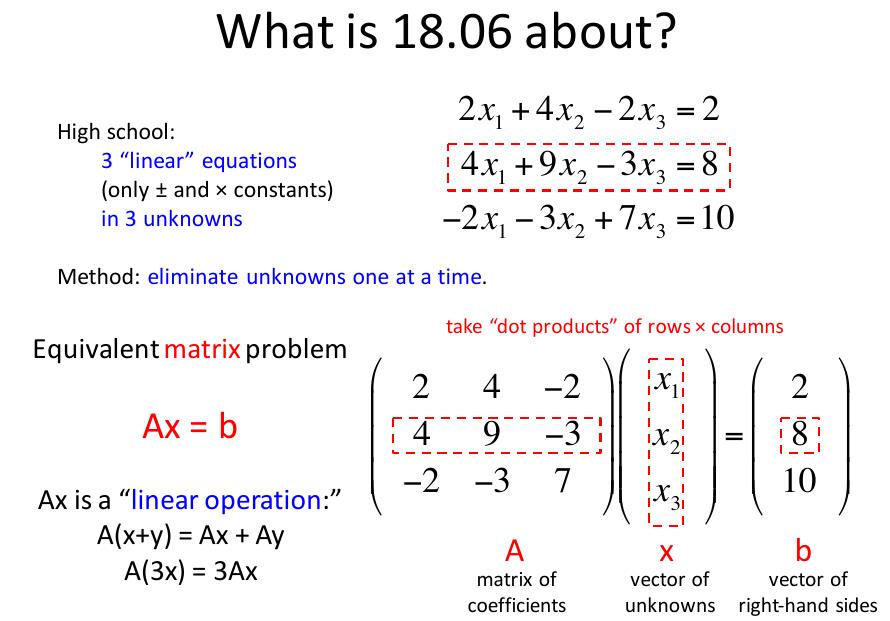

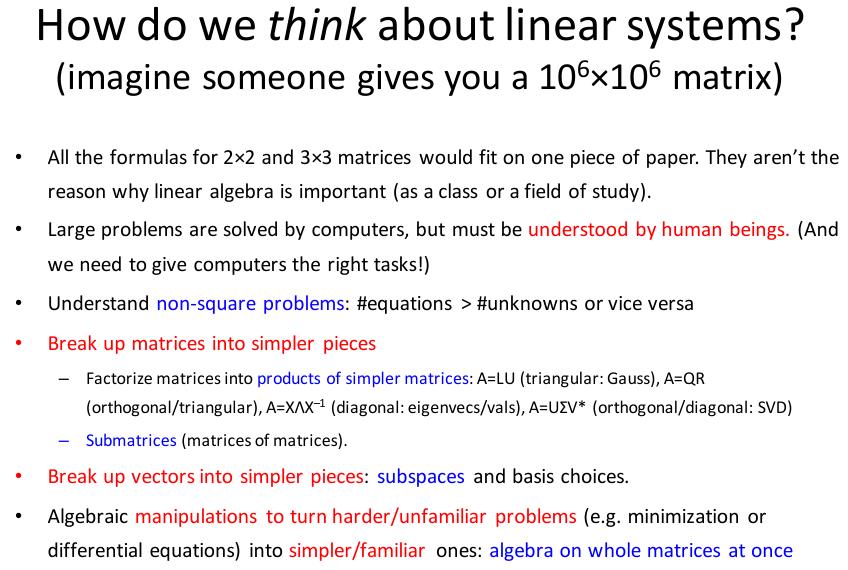

本文是对 MIT 18.06 的总结。下面3幅图来自 MIT Course 18.06 的 course overview slides.

The Geometry of Linear Equations

教授在这个 lecture 中介绍了3个概念:Row Picture,Column Picture, and Matrix Picture,其中理解 Column Picture 是最重要的。

我们可以把线性方程组写成矩阵的形式,Row Picture 描述的是从矩阵的 row 看起,对于每一个 row 来说,在 2D 中可以决定一条直线,在 3D 中决定一个平面; 而对于 Column Picture 来说,从 column 看起,形成了列向量的 linear combination,因此在 2D 和 3D 中都是向量,只不过2者之间相差一个维度而已; Matrix Picture 没什么好说的。详情可以看 The Geometry of Linear Equations.

Given a matrix

A

, can we solve:

If the answer is “no”, we say that

从几何上理解会更直观一些。比如在空间中有3个向量(A,B,C),如果 A 和 B 通过 linear combination 会得到 C,因此 C 在向量 A 与 B 组成的平面上,因此这3个向量的 linear combinations 不能 fill 整个3维空间。在进一步,如果这3个向量共线,那么它们就只能 fill 一条直线。

Elimination with Matrices

在文章开头,已经看到了线性方程组可以写成矩阵的形式。下图中就是把一个3元方程组写成矩阵的形式(Ax=b):

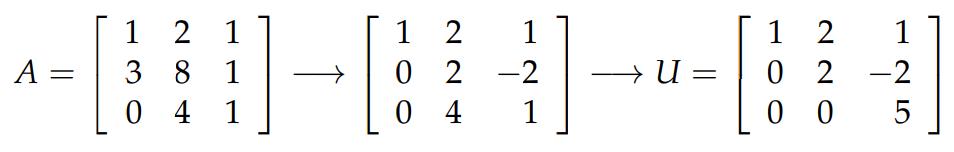

在高中的时候,如果想要求解出这样的方程组,需要不断地化简消元,只不过我们现在用更加系统的方法去做这件事情,道理本身是一样的。这里直接操纵矩阵,从而达到消元的目的。过程如下图所示:

由于对方程的左边(即矩阵 A)进行了上述步骤的简化,同样的步骤也需要应用到向量 b 上。应用到 b 以后,我们得到了一个新的向量 c=⎡⎣⎢26−10⎤⎦⎥ ,因此整个消元方法转换 Ax=b 到 Ux=c,通过 back substitution 就可以得到这个3元方程组的解了。

在上面的消元过程中,pivots may not be 0. If there is a zero in the pivot position, we must exchange that row with one below to get a non-zero value in the pivot position. If there is a zero in the pivot position and no non-zero value below it, then the matrix A is not invertible.

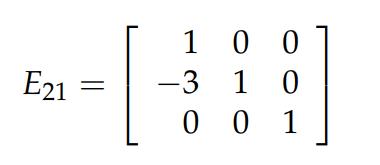

熟悉了上面的消元过程,现在让我们了解一下 Elimination Matrices 的概念。在上面消元的第一步中,我们是把矩阵 A 的 row 2 - 3×row 1,通过下图中的方式也可以达到同样的效果:

上图中最左面的矩阵就是消元矩阵。The elimination matrix used to eliminate the entry in row

m

column

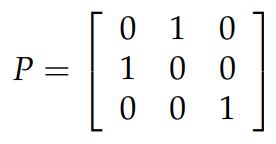

A permutation matrix exchanges two rows of a matrix. 对于一个 n×n 的矩阵来说,可以有 n! 种方式交换行,因此就有 n! 个permutation matrix,这些矩阵形成了一个组. 单位矩阵就是一个 permutation matrix 的例子,只不过它不交换任何行而已。关于 permutation matrix 的规律,就是你怎样交换单位矩阵的行,你就如何交换另一个应用到它的矩阵的行。比如对于下图中的 permutation matrix 来说,它交换了单位矩阵的行1和行2,如果你把这个 permutation matrix 应用到另一个矩阵上,那么它就会交换那个矩阵的第1行和第2行。

既然我们有 n! 种方式交换行,无论你怎么交换都逃不出这些可能。因此,无论你对同一个矩阵应用多少个 permutation matrix,交换之后的结果一定在 n! 种情况内。因此可以得出,当你从一组 permutation matrix 中拿出任意多个矩阵时,它们的乘积也一定在组里。

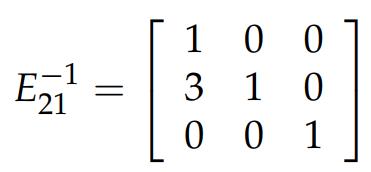

接下来我再谈一下关于 elimination matrix 的逆矩阵。比如下图中的 elimination matrix,它的目的是进行操作: row 2 - 3×row 1,为了 “undo” 这个操作,我们必须进行操作: row 2 -+3×row 1,即用 E21 的逆矩阵:

Multiplication and Inverse Matrices

有5种 perspective 来看矩阵的乘法:它们分别是:row times column,columns,rows,column times row,blocks. 关于它们的详情参考 矩阵乘法。

接下来谈一谈如何判断 square matrix A 是否可逆。设矩阵 Ax=0,如果你可以找到一个非0的 x 使其成立,则 A 不可逆。这是为什么呢?假设 A−1 存在,且有一个非0解 x. 由于 A−1(Ax)=A−10=0≠x=Ix=(A−1A)x ,违背了假设,所以矩阵 A 不可逆。

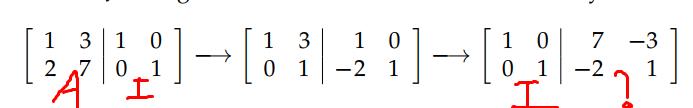

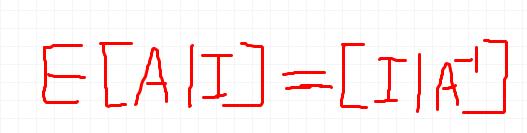

接下来谈一谈当一个矩阵可逆的时候,如何用 Gauss-Jordan Elimination 来求出它的逆矩阵。下图中就是整个过程(Once we have used Gauss’ elimination method to convert the original matrix to upper triangular form, we go on to use Jordan’s idea of eliminating entries in the upper right portion of the matrix)。

上面的消元过程很好理解,但是为什么上图中“问号”上面的矩阵就是 A−1 呢?在下图中通过把一个 elimination matrix E 应用到矩阵 A 上得到了单位矩阵 I,即 EA=I,所以 E= A−1 ,所以 EI= A−1I=A−1

Factorization into A = LU

正如本节标题所示,我们需要把矩阵 A 分解成2个矩阵(L 和 U)的乘积,where ‘LU’ stands for ‘lower upper’, and also called LU factorization. 在上面的小节中已经看到,通过对矩阵 A 的消元过程,最终可以得到一个 upper triangular 的矩阵 U,因此是 EA=U. 有了过程,我们就可以很容易把 A 分解成 LU 了。 E−1 EA= E−1 U,因此你会发现 L 实际上就是 E−1 .

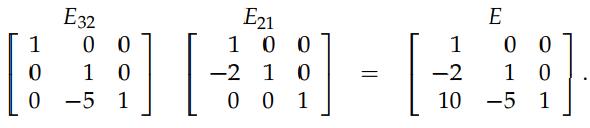

矩阵 L 是 lower triangular 的,而且对角线上全是1. 你可以看每一步的消元矩阵,它都是对角线上是1,然后改变某个位置上的乘子。你可能会想,A=LU 和 EA=U,并没有什么太大区别吗!我们为什么更倾向于前者呢?举个例子一下就明白了。比如某个矩阵 A 的 A21 和 A32 两个元素需要消元,因此有下图中的2个消元矩阵。你会发现最终得到的 E 不仅在其需要消元的2个元素上有乘子,而且在左下角不还有个10出现,这就是副作用。

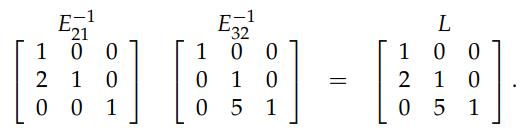

而对于通过求消元矩阵的逆,从而得到的 L 来说,如下图所示,它并没有这样的副作用。因此在没有行交换的情况下,消元矩阵中的乘子可以直接复制到 L 中。

当需要交换行时,我们可以写成:PA=LU,其中的 P 是 permutation matrix. 这种类型的矩阵有很好的性质: P−1=PT

A matrix A is symmetric if AT=A . Given any matrix R (not necessarily square) the product RTR is always symmetric, because (RTR)T=RT(RT)T=RTR

Vector Spaces

来自维基百科的定义:

A vector space (also called a linear space) is a collection of objects called vectors, which may be added together and multiplied (“scaled”) by numbers, called scalars.

通过上面的定义,我们可以判断一个给定的向量集合是否为 vector space. 比如,在 x-y 平面上第1象限的向量集合,它就不是 vector space. 集合中的任意2个向量相加依然在集合中,但是如果你乘上一个负数,得到的向量就不在集合中了。我们说这种类型的向量集合是 closed under addition but not under multiplication.

关于 subspace 的定义:

A vector space that is contained inside of another vector space is called a subspace of that space. Every subspace must contain the zero vector because vector spaces are closed under multiplication.

下面举2个例子:

The subspaces of R2

- all of