人工智能简史:哲学家和人工智能

Posted 丽泽哲学苑

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了人工智能简史:哲学家和人工智能相关的知识,希望对你有一定的参考价值。

《人工智能简史》

The real discovery is the one that makes me capable of stopping doing philosophy when I want to, the one that gives philosophy peace.

真的发现是能让我停下来不做哲学的发现,让哲学消停的发现。

——Wittgenstein(维特根斯坦)

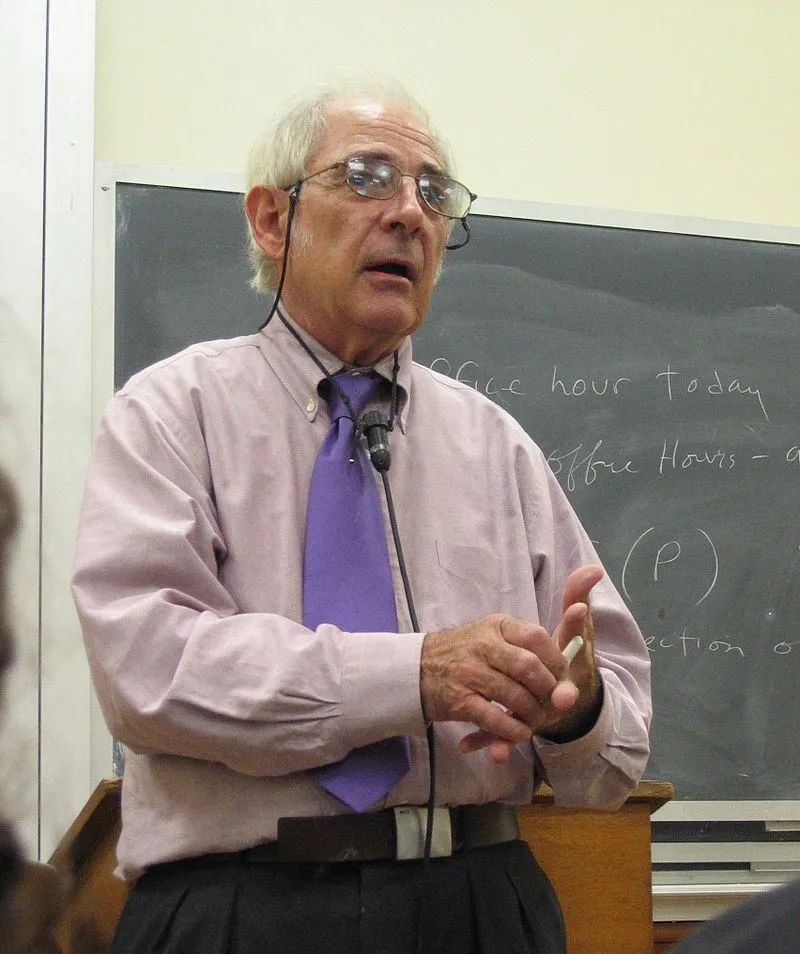

哲学家不一定懂哲学,就像相声演员不一定会说相声,这是低门槛行业的通病。本章只讲哲学家和人工智能的故事,而真正的人工智能中的哲学问题散布在别处。加州大学伯克利分校的哲学系有两位人工智能的出名批评者,一位是休伯特・徳雷弗斯(Hubert Dreyfus),另一位是塞尔(John Searle)。德雷弗斯的《计算机不能干什么》和塞尔的假想实验“中文屋”一度代表了外行反对人工智能的最强音。2016年去世的普特南(Hilary Putnam)身兼哲学家、数学家和计算机科学家,对自动定理证明做过原创贡献,是内行。他的“缸中脑”是严肃的假想实验。

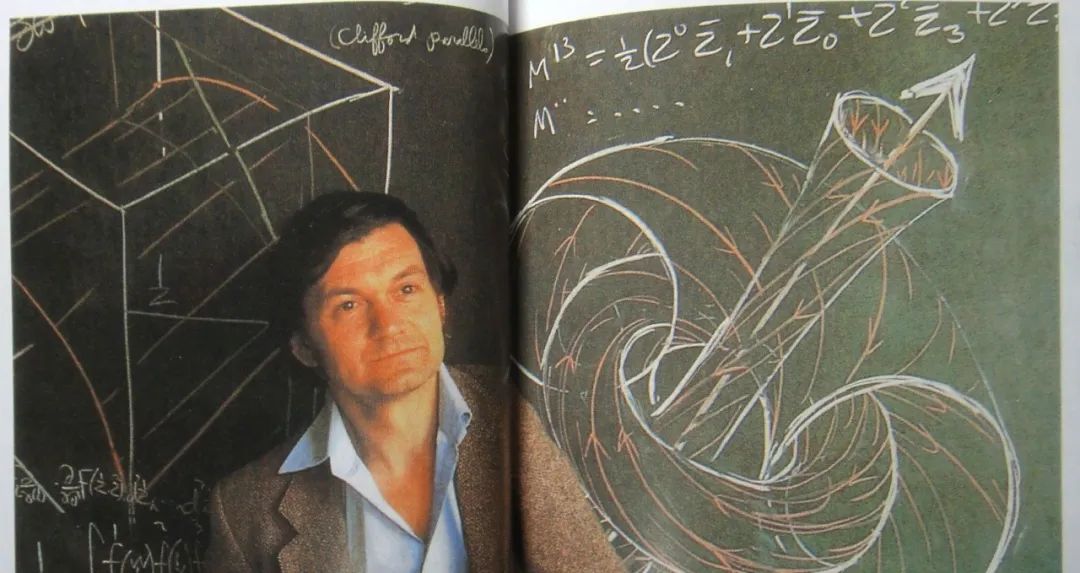

左:休伯特・徳雷弗斯

右:约翰·塞尔

1. 德雷弗斯和《计算机不能干什么》

休伯特・徳雷弗斯是美国为数不多的欧陆派哲学家之一,主攻胡塞尔、海徳格尔和梅洛-庞蒂(Merleau-Ponty),但他出名主要靠的还是批判人工智能。

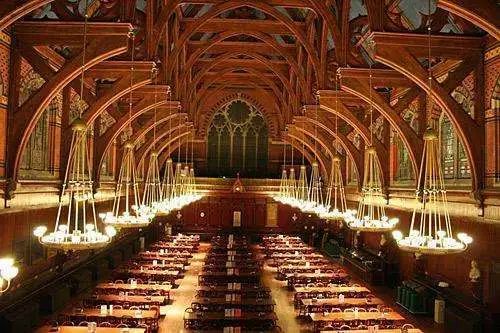

休伯特・徳雷弗斯是苦出身,但本科、博士都毕业于哈佛大学,刚入学时读过一段时间物理,很快就转了哲学。他还有个兄弟斯图亚特・德雷弗斯( Stuart Dreyfus),也是哈佛博士。中西部的农民家庭一家出两个哈佛博士倒是个励志的故事。斯图亚特・德雷弗斯的专业是应用数学,毕业后也去了加州大学伯克利分校,在工业工程与运筹学系任教,曾和动态规划的祖师爷贝尔曼合作,还一度研究过神经网络。兄弟俩1988年还联手写过一本批评专家系统的书《人定胜机》(Mind over Machine)。

休伯特・德雷弗斯在哈佛博士毕业前,就开始在隔壁的麻省理工学院教哲学导论,毕业后顺理成章地成了麻省理工学院哲学系助理教授。那时的麻省理工学院哲学系和语言学系还没合并。学校最热门的明星人物之一是明斯基。德雷弗斯1961年在他兄弟的帮助下拿到了一个在美国军方智库兰德公司夏季实习的机会,期间接触到纽厄尔和司马贺的工作。1964年夏季他再次到兰德公司工作,写出了那篇广为流传的“炼金术与人工智能”。他在兰德工作时的老板起初看见这篇文章后非常不爽,他认为德雷弗斯的东西是糟糕的哲学,他扣着这篇东西没有立即发表。但徳雷弗斯把预印本在各个圈子里散发。徳雷弗斯的批评者认为那根本就不是兰德的报告,德雷弗斯不过是利用他在兰德短期工作的身份,为报告背书。9个月之后,德雷弗斯在兰德的老板怕被别人批评在实施检查制度,最终同意以最低级别的兰德公司内部备忘录的形式印发了这篇文章。这篇文章一开始只是攻击纽厄尔和司马贺的观点,后来内容逐渐被扩充,攻击的范围也扩大,终于成为一本书,书名是《计算机不能干什么》,变成了对人工智能的全面批评。

德雷弗斯的书出来后,他马上成了人工智能学界的死敌。麻省理工学院的人工智能圈子在明斯基的影响下,根本不待见他,他在食堂吃饭时大家都躲着他。德雷弗斯后来指控麻省理工学院的计算机教授企图阻挠他获到终身教职(tenure),因为害怕他对AI的批评会导致学校拿不到政府资助。他甚至考虑雇一个演员装扮成美国国防部先进研究局(DARPA)的官员和他在麻省理工学院教授俱乐部里吃饭,以此吓唬他同校的人工智能教授们。最后校长维斯纳( Jerry Wiesner)不得不干预,在咨询了邻居哈佛大学以及苏联的计算机同行后,亲自批准给德雷弗斯终身教职。维斯纳是电机工程(EE)的教授,麻省理工学院的EE和计算机至今还是一个系,维斯纳在计算机教授间颇有威信,著名的 Media Lab就是在他手里建立的。苏联那时正批控制论,徳雷弗斯的调子倒是合拍。后来 DARPA传唤德雷弗斯到首都华盛顿听取他的反动言论,再后来,还真有了AI的核冬天,而那期间麻省理工学院人工智能实验室的政府资助也确实大幅减少。

1992年《计算机不能干什么》出版20周年纪念时,徳雷弗斯新写了序,新瓶装旧酒,书又被重新出版了一遍,正文内容没什么变化,只是书名被改为《计算机仍然不能干什么》。这本书的副书名随版本不同,时有变化,或“人工智能的极限”,或“人工理性批判"(A Critique of Artificial Reason),很明显,这是抄自康德的《纯粹理性批判》。人工的当然不纯粹,一个假酒一个茅台,不同的是:康德初衷是建设,而德雷弗斯则是大批判。更有意思的是,新版的出版社竟然变成了麻省理工出版社。麻省理工出版社毕竟不是早年结下梁子的麻省理工学院,此时的人工智能圈子应该也更有自信了吧。

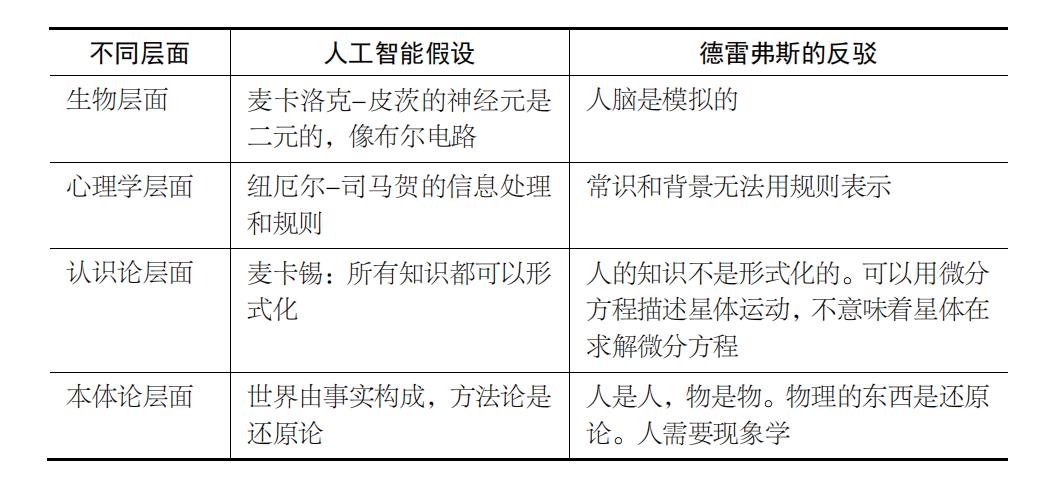

德雷弗斯从以下四个层面批评人工智能。

德雷弗斯的批评随着人工智能的进展也与时俱进,但可以总结为多少有些互相矛盾的两句话:其一,所有人工智能研究者搞的东西都是哲学家玩剩下的,例如霍布斯的“推理即计算”(reasoning is calculation)、笛卡尔的心理表示、菜布尼茨的“广义计算”(universal characteristic);其二,有好多人能干的事,现在的计算机干不了。徳雷弗斯甚至小肚鸡肠地推断明斯基提出框架概念肯定受到明斯基的一个学生的影响,而那个学生上过德雷弗斯的现象学的课。

纽厄尔和司马贺1957年曾做过一个乐观的预测:十年内计算机下棋能赢人,十年内计算机将能证明人还没有证明的定理。这成了德雷弗斯的把柄,也是他最有力的武器。每次计算机下棋有些进展,徳雷弗斯都会跳出来说:“那还是赢不了人啊。”其实1966年德雷弗斯就曾和当时最厉害的下棋程序 Machack对弈过一局,并且输给了Machack,但他说赢我不算赢。他不得不再次澄清他原来的论断是计算机当时不能赢人类棋手,并不是永远不能赢人类棋手,这不是废话嘛。美国计算机学会人工智能组的出版物SIGART Bulletin引用了明斯基的战友佩珀特(Seymour Papert)以维特根斯坦的格式写的笔记:

1.5计算机不能下棋。

1.5.1德雷弗斯也不能下棋。

1965年司马贺再度预言:他的原定目标可以在20年内可以实现,结果到了1985年,自然为德雷弗斯徒增笑料。直到1996年马库恩( McCune)的定理证明程序EQP证明了罗宾斯猜想,1997年IBM“深蓝”战胜象棋世界冠军卡斯帕罗夫。常被德雷弗斯讽刺的另一个领域——几何定理证明——在1978年吴文俊的工作之后也渐趋成熟。不知道如果现在德雷弗斯再写一版那本书,书名该改成啥,《计算机就是不能干》?不过人工智能的乐观派也该学到点教训:老老实实干活,没事別瞎吹。

1986年,麻省理工学院人工智能实验室的老大温斯顿(明斯基的学生)邀请已经在加州大学伯克利分校任教的德雷弗斯回来做了个讲座,题目居然是“为什么AI从业者应该读《存在与时间》?”《存在与时间》是德国哲学家海德格尔的成名作。海德格尔是德雷弗斯偏爱的哲学家,素不为英美哲学家所喜。2008年德雷弗斯还写过篇文章“为什么海德格尔派的AI失败了,为什么需要更多的海德格尔”,大意是人工智能中的重要思想都来自海德格尔,而正是因为贯彻海德格尔思想的不彻底导致了人工智能的失败,为了成功,我们需要更多的海德格尔。换句话说,成功是因为听从海德格尔的教导,失败是因为没听从他的教导。德雷弗斯文中似乎把人工智能没有成功的主要原因都归结为“框架问题”,并提出“框架问题”是不能通过符号派的表示手段来解决的,唯一手段是利用神经网络,而他所谓的神经网络研究也被海德格尔早就料事如神地在《存在与时间》里想到了。德雷弗斯认为明斯基一票人不懂海德格尔,所以导致知识表示的框架问题。这听起来真有点儿像仁波切们说他们早就料到了量子力学一样。

德雷弗斯声称明斯基的“框架”式知识表示的根源是海德格尔的犹太人师傅胡塞尔(Edmund Husserl)。胡塞尔的现象学就是知识表示系统,只是胡塞尔在他75岁(1934年)时认识到知识表示是死路,而明斯基在1988年还没认识到。德雷弗斯这么说的根据是明斯基的框架系统有个顶层概念,而胡塞尔也有个东西叫“神圣不可侵犯的本源”(Inviolably the same)如果认真读过胡塞尔,就知道胡塞尔现象学和知识表示没啥关系,只是有修辞性的比喻,而非实质性的相似。德雷弗斯大概知道科学家对胡塞尔和海德格尔的晦涩语言伪装的深刻不感兴趣。

哲学家有两类,一类是深刻的,一类是混饭的。罗素和弗里格是深刻的,没有他们,就不会有数理逻辑,也就不会有哥徳尔、丘奇、图灵,以及后来的计算机科学。但没有现代的欧陆哲学,世界不过省了些粮食而已。没有胡塞尔和海德格尔,明斯基照样会想出“框架”,从而催生后来的“面向目标的程序设计”方法论。所谓“顶层”概念就是Java程序设计语言里的Object,或者知识图谱DBpedia里的Thing。按照德雷弗斯们的说法,哲学系是不是应该要求读现象学的博士必须熟练掌握一门面向对象的程序设计语言?

在20世纪80年代末期,神经网络研究复兴之后,德雷弗斯对人工智能的全面批评也缩小为对符号派的专门攻击。他和他的兄弟斯图亚特・德雷弗斯一起撰文写书。斯图亚特虽然是运筹学专家,但一直都在做神经网络的研究,甚至号称发明了“反向传播”(back-propagation)的原始概念。考虑到这一点,他们的攻击不免有报复和落井下石之嫌。

徳雷弗斯曾经引用梅洛-庞提批判人工智能:人脑是和环境直接交流的,而不是通过表示(representation)。德雷弗斯曾经按照海德格尔的思路创造了一个词:“随手拈来"(readiness-to-hands),也就是说直接性是不经过表示的。可以把这算作对符号派的朦胧批判吧。但这种批评有点像算命常用的两头堵,因为你无论怎么直接地接近环境,他都可以说这和人脑不同。不知道波普尔会怎么评价海德格尔,或者德雷弗斯的这种解读。很可惜德雷弗斯不知道深度学习,对多层的解释恰恰是因为需要表示。造飞机不需要按照鸟的结构,飞机的翅膀不会动。飞机的表示是空气动力学。飞机能飞吗?

明斯基和佩珀特的学生维诺格拉德(Terry Winograd)加入德雷弗斯和塞尔的批评阵营,确实给他们增色不少。维诺格拉德早期在麻省理工学院的研究课题“积木世界”是自然语言处理的经典工作。在碰到问题时维诺格拉徳放弃了原来的研究方向。他联手德雷弗斯和塞尔一道批评麻省理工学院的学生只能将课题限制在“微世界”而不是“实际世界”。但罗马不是一天建成的,任何一门科学一开始不都是从小处着手吗?所谓“微世界”就是维诺格拉徳的积木世界。其实积木世界从某种意义上体现了维特根斯坦后期《哲学研究》中的思路,语义就是与环境的交互。用维特根斯坦的例子,师傅对徒弟说“递给我一块砖”,如果徒弟真递过来那就是听懂了。

德雷弗斯能够如此长久地混迹人工智能的江湖,有两个原因:其人工智能内部一直就是两大派不和,而且派中有派,很少有过学科的发展像人工智能这样起伏跌宕,苍蝇不叮无缝的蛋;其二,相当一批人工智能工作者有哲学情怀。2001年第一次互联网泡沫崩裂时,德雷弗斯又出了本大批判互联网的书《关于互联网》,风格一如既往。他的出发点是互联网的隐私和媒体的责任感。这倒更符合他的训练和智力。

2.塞尔和中文屋

塞尔是德雷弗斯之后又ー位批评人工智能的干将,但他主要以英美哲学立身。他是地道的美国人,一开始就读威斯康辛大学麦迪逊分校,但三年级时获得罗徳奖学金(Rhodes Scholarship),去了英国,结果本科硕士和博士三个学位都是在牛津拿的。他在牛津时跟随日常语言学派的领袖奥斯丁(John Langshaw Austin),回美国后马上就到加州大学伯克利分校教书,出名很早。塞尔晚年还被中国的清华大学和华东师大聘为名誉教授。2017年初,84岁高龄的塞尔被他的一名博士后以“性侵害”罪名告到法庭,这个罪名比“性骚扰”要厉害一级。而据他的同事说他素有这个毛病,过去就有多名学生和他发生性关系以换取金钱和分数的好处。伯克利校方既然知道他的不当行为却不加处置,为此在案件中也被连带。他原本在2017春季要教的“心智哲学”的课也被取消了。

言归正传,1980年塞尔在《行为与脑科学》杂志上发表了“心灵大脑和程序”(Minds,Brains and Programs)ー文。文中的一个思想实验“中文屋”马上成为最喜欢被引用的假想实验之一。曾有人批评《行为与脑科学》杂志不严谨,更像哲学杂志。但说实在的,这杂志经常登些好看的文章并屡次挑起事端。当年彭罗斯的《皇帝新脑》(Emperor’s New Mind)一书出来后颇引争议,《行为与脑科学》就搞了一期争辩专刊,正方反方吵得不亦乐乎,各方都抬出了自己的大佬,无论从吸引眼球还是严肃讨论的角度看,这都是成功的。

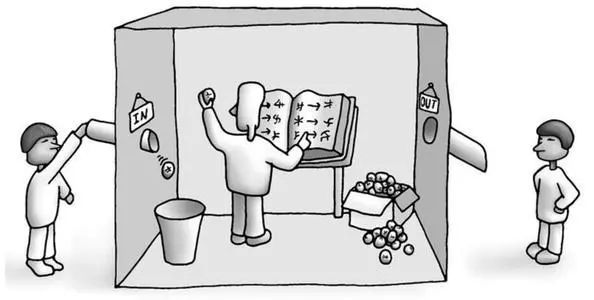

所谓“中文屋”思想实验是这样的:假设有个只懂英文不懂中文的人(塞尔的第一人称“我”)被锁在一个房间里,屋里只给“我”留了一本手册或一个计算机程序,这个手册或程序教“我”在收到中文信息时如何用中文应对。屋外的人用中文问问题,屋里的“我”依靠程序用中文回答问题,沟通方式是递纸条。塞尔的问题是:假设屋外的人不能区分屋里的人是不是母语为中文,那么屋里的“我”是不是就算懂中文?塞尔自己认为“我”不懂中文。很明显,这个场景源自图灵测试,只不过图灵测试的环境是英文,而中文屋里既有中文又有英文。

塞尔的文章出来后,引起轰动。其实轰动的原因很简单:谈论这种玩意儿没什么门槛,谁都可以说三道四:哲学家、科学家,以及各种媒体人。塞尔毕竟是老练的哲学家,已经预测大家会质疑他的论断,他在文尾也设想了各种回答。中文屋的第一个问题是,我们只是算屋里人理解中文呢,还是屋子加人作为一个系统理解中文。塞尔的论断是屋里人即使查遍手册,顶多算是理解语法,而不算理解语义。我们可以问塞尔这样的问题:戴眼镜的人能算看见东西吗?一个耳聋的人通过换上人工耳蜗重获听觉后算是能听见吗?一个坐飞机的人算能飞吗?如果对这些问题的答案都是“算”,那中文屋作为一个系统为什么不算理解中文呢?

塞尔认为必须内化(换句话说:手册必须变成人身的一部分)才能算懂中文,那么内化到什么程度才能算呢?爱因斯坦说“我的笔加上我要比我自己聪明”,笔算不算外化?原来纸笔时代的拼写错误,现在用任何文本编辑软件,如微软Word,都可自动纠错,这算内化吗?内化就是一点外部工具都不能借助吗?内化是完全的物理隐藏,还是只是个反应时间问题?在一开始查手册时,反应时间必定很慢,但熟能生巧之后,查手册变成下意识的动作,那算内化吗?即使中文是母语的人也免不了查手册啊。我猜对塞尔来说,可能人工耳蜗算是内化,飞机肯定是外化,而眼镜则是可算可不算。

内化和辅助工具的大小也有关系。目前语音识别被认为是已经解决的问题,机器的识别率已经达到或超过人类。两个讲不同语言的人可以借助语音识别工具沟通。如果语音识别工具是桌面电脑,我们可能不会认为对话中的两个人理解了对方的语言。但如果这个语音识别工具可以微型化,直接内化到耳朵里,那算不算理解?同理,可能中文屋让人不能接受的原因是因为它的体积。就像丹尼特所说“植物是很慢的动物”,我这里可以再加一条“植物是很大的动物”。如果我们可以把基本功能做得很小很快,那么“内化”就是很便宜的功能。

在塞尔的术语里,理解或意识等同于一个抽象的哲学观念“意向( intention)或“意向性”(intentionality)。屋里的人并没有“意向”,所以“我”没有理解中文。在塞尔的论辩里,时而意向性是人特有的性质,时而意向性是不可检测到的东西。

塞尔认为他不是反人工智能,他只是反“强人工智能”,但在“强人工智能”和“弱人工智能”之间并没有质的区别,只有量的渐变。中文屋测试的不是屋中的“我”而是屋中的程序。如果那本种奇的手册成者程序已经通过图灵测试,那程序就是一个机器翻译的神器。这本身就是强人工智能了。而且那程序已经有语义功能了。假设游戏不是中文翻译,而是下棋,那“我”算不算会下棋?断言中文屋是不是有智能,就像断言Alpha Go会不会下围棋一样,要看应用场景。一个数学家离开了数学也不一定就是聪明的。

塞尔的第二个准备好的答辩就是所谓“机器人”反驳。如果那本手册或者那个程序那么厉害,如果把它放到一个机器人里,那么这个机器人就可以做很多人可以做的事情,那么它是不是就算能理解了呢?塞尔的答辩是这恰恰说明单纯的形式化符号操纵是没有理解力的。

维特根斯坦后期哲学《哲学研究》中有个例子:泥瓦匠要徒弟把砖头递给他。如果徒弟把砖头递过来了,那么徒弟就是懂了。理解是一个社会现象,而不是一个独立的哲学概念,或个人行为。按此,语义也是社会的。翻译只是心心交互?翻译需要涉及外部世界吗?维特根斯坦说语义就是语言的使用。语言的使用也必涉及心物交互。从这个角度看,也许关于中文屋的讨论可以更有建设性。

3.普特南和缸中脑

普特南灿烂的学术生涯覆盖了数学、计算机科学和哲学。他虽是哲学出身,但他也是解决希尔伯特第十题的主要推手之一,他和逻辑学家戴维斯长期合作研究机器定理证明,是这个领域的开拓者之一。他的哲学研究也涉猎广泛,并且立场常常变来变去。他的变化和徳雷弗斯的浅薄机会主义不同,普特南是高处不胜寒,自己换着法儿和自己辩论。他在1960 年就写过一篇“心和机器”(Minds and Machines),定义了计算主义(Computationalism)和功能主义(Functionalism)。普特南指出同样的软件可以在不同的硬件上运行,软件的功能和硬件的实现可以分开。到20世纪80年代初,普特南又变成计算主义和功能主义的批判者。

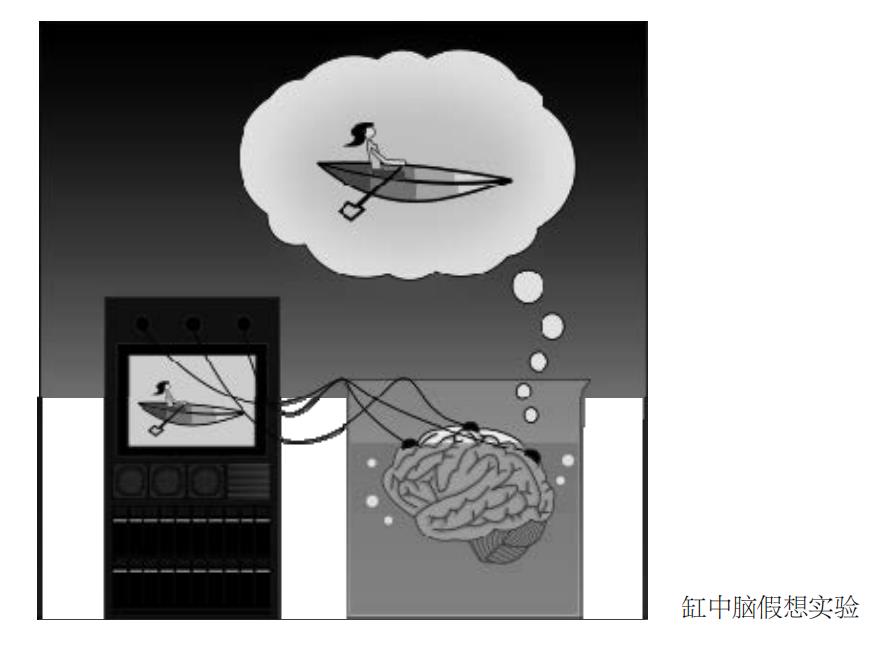

1981年普特南出版了《理性、真理与历史》(Reason, Truth,and History)一书,该书的开篇就给出了“缸中脑”的假想实验:

“一个人(想象一下那是您自己)被邪恶科学家施行了手术,他的大脑(您的大脑)被从身体中取出,放入一个缸中,缸里盛有维持脑存活需要的营养液。脑的神经末梢和一台超级计算机相连,这台计算机使大脑的主人保持一切完好的幻觉。对于他来说,似乎人、物体、天空还都存在,但实际上,此人(您)体验到的一切都是计算机传输到神经末梢的电子脉冲的结果。这台计算机非常聪明,此人要是抬起手,计算机发出的反馈能让他“看到”并“感到”手正在抬起。不仅如此,邪恶科学家还可通过改变程序使受害者“经验到”(即幻觉到)邪恶科学家所希望的任何情景或环境。他还可以消除这次脑手术的痕迹,从而使受害者觉得自己一直是处于这种环境。受害者甚至还会以为他正坐着读书,读的就是这样一个有趣但荒诞的故事:一个邪恶科学家把人脑从人体中取出放到一个有营养液的缸中。神经末梢连到一台超级计算机,它使这个大脑的主人具有如此幻觉……

普特南更进一步设想,假设所有的感觉器官都泡在缸里,而外面的世界就是一台大自动机。美国科幻电影《黑客帝国》(Matrix)、《盗梦空间》( Inception)等都受“缸中脑”思想实验的启发。

普特南发明了一种新的图灵测试,他称之为“图灵指称测试”(Turing Test for Reference),测试的方法和图灵测试一样,通过传递打印纸条,来判断是否机器能像人那样指称外部世界的客体。普特南的结论是机器不能像人那样指称。图灵指称测试实际上已经很接近塞尔的中文屋。尽管如此,普特南一直对“意向性”这样模糊不清的概念不爽。

普特南进一步把缸中脑和图灵指称测试做了对比。图灵指称测试的底线是语言,任何超越语言的东西,图灵测试没法回答,例如,如果给机器一张丘吉尔的照片,机器会不知所云。但缸中脑的底线是神经末梢,给缸中脑一张照片,缸中脑知道如何反应,缸中脑毕竟也是脑啊。但问题是缸中脑知道如何与外部世界做对应吗?泡在缸中的人脑,如何知道自己是颅中脑,还是缸中脑?人工智能的基本问题是可否造一台机器能有智能,“缸中脑”中的机器则起了另一种作用:人脑是否能确定外在的世界是直接实在还是间接实在。

普特南曾经正面地批评过人工智能:人工智能并没干什么哲学家不能干的事。但这要看是什么人工智能的学者和什么哲学家。如果是普特南这样的哲学家,计算机科学家必须认真倾听,因为普特南自己就是一位富有成就的计算机科学家,他也是人工智能一些分支的开拓者,计算机科学大概会更加认为他是自己人而不是他者。他在塔夫茨大学的邻居丹尼特(Daniel Dennett)则会对人工智能采取更加同情的态度。他认为即使人工智能没有解决什么实际问题,但从更深的层次提出问题本身就是进步。哲学家总不会因为生物学家没有解答什么是生命,就怪罪生物学没有取得进展吧。没有人工智能,有些问题根本就提不出来。普特南和丹尼特都算是建设性的意见,区别是一个把人工智能当成自己的用户,而另一个把自己当成人工智能的用户。

4. 给哲学家一点忠告

曾经有一个教条:哲学指导科学。这种观点为大多数科学家所不齿,费曼、惠勒和杨振宁等物理学家都曾撰文批驳。但这恰是徳雷弗斯的天真立场。维特根斯坦曾经有言:哲学家的工作应该是一直给人提醒(assembling reminders),而不是指导。德雷弗斯最早对人工智能的批评其实很简单:还不能做什么。比如最早他说下棋还不能做,当计算机科学家证明他不对时,他又说还有什么仍然不能做。如果把这些都当作维特根斯坦所谓的“提醒”,倒也不错。但比较让计算机科学家愤慨的是,他会常常会以教导的语气说,你们应该照着海徳格尔说的做。

在文明初期,哲学家掌握所有的学问,哲学就是学问的代名词,说哲学家指点科学倒也不算错。但科学进步的过程就是与哲学渐行渐远的过程,当下的科学已经和哲学关系不大,一战后的欧陆哲学已经和科学彻底无缘。偏重科学和逻辑的英美分析哲学也挡不住哲学的颓势,最后一个从哲学中脱离的硬学问是逻辑,目前最好的逻辑学家都在数学系和计算机系,哲学已经空洞化。那些非逻辑学出身的哲学家存在的一个普遍问题是压根就没见过硬的、复杂的问题。对一个不太出名的哲学家的谬论,最好的应对办法是把他交给比他数学稍微好一点的同行。但如果碰到出名的哲学家,我们只好直接迎战,否则他的谬见会影响智力还不如他的媒体人,从而被散布得更远。

彭罗斯其实也看不起塞尔,他在《皇帝新脑》书里评论塞尔时说塞尔被计算机科学家误导了,而计算机科学家又被物理学家误导了,这明显表示了某种学科的智力层级的歧视。彭罗斯把塞尔的几种辩解轻易批倒,但他还是喜欢塞尔的结论:强人工智能不靠谱。颇有否定之否定或敌人的敌人的意思——彭罗斯自己作为物理学家不认同强AI,强AI多出自计算机科学家,而哲学家塞尔又是反对强AI的。这是为彭罗斯引出自己的理论铺路的:人脑实际上就是有量子效应。我们也由此可以看出科学家和文科生有时是一笔乱账地互相寻求支持,科学家内心知道哲学家之不靠谱,而哲学家有时特别需要科学家的背书,尽管科学家内心知道哲学家对自己工作的陌生和胡乱引用。

德雷弗斯批评人工智能太重分析,而不够综合,因而提倡现象学。生物学家、诺贝尔奖金获得者埃德尔曼(Gerald Edelman)和他的学生里克(George Reeke)则说人工智能太过综合而不够分析。他们在合作的一篇文章“实在的大脑和人造的智能”(Real Brain and Artificial Intelligence)开篇中就讽刺亚里士多德——亚里士多德的《动物学》里陈述女人的牙齿数目比男人少,亚里士多德从来也不看亚里士多德夫人的嘴。埃德尔曼希望计算机科学家应该等神经科学家了解了大脑的生物学之后再谈论人工智能,或者干脆加入神经科学家的队伍一起先研究大脑。但计算机科学家恐怕没那个耐心。我们造飞机并不需要知道鸟是怎么飞的。我们享受飞机的远程旅行,也不需要懂空气动力学。我这里并非在为功能主义辩护。其实,科学体系历来如此,底层的学科说上层学科不够分析,物理学家对化学家如是说,化学家对生物学家如是说,生物学家对心理学家如是说。而哲学和人工智能恰恰可以和哪个学科都能挂上,分析和综合就看不清了。

如果真认为海德格尔有用,就应该像弗里格和罗素清理逻辑那样,把这些东西整理成可以交流的形式。也许哲学家真怕他们惯用的冷僻词汇被翻译成通俗易懂的语言。当代哲学,尤其是欧陆哲学,就像韩国整容术,乍一看唬人,其实遗传不了。

彭罗斯曾经这样谈到机器的情感和道德:如果你买一台计算机,它是有情感的,那么我们就有道徳问题,因为计算机的意愿可能被违反,并可能会被当作奴隶。我们首先必须说道徳是一个社会问题,也就是说当一个社会只有一个个体(无论是人还是计算机)时,是不存在道德问题的。

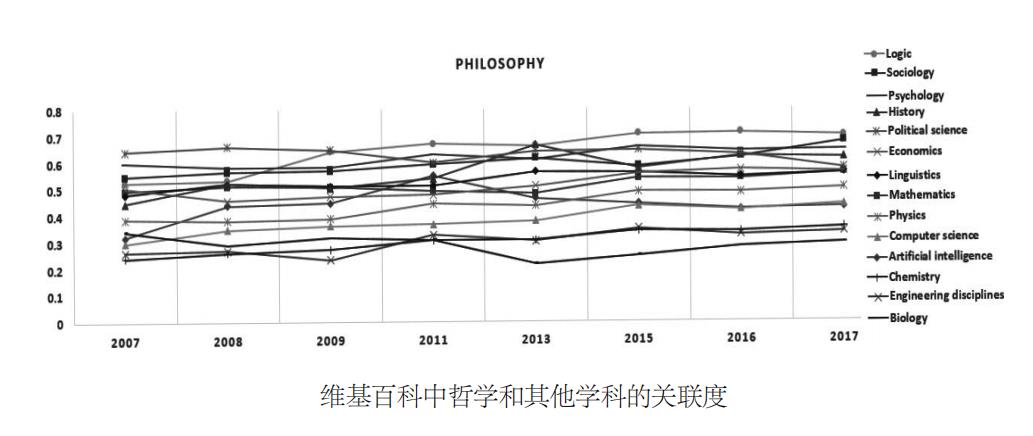

哲学家很喜欢对人工智能说三道四,原因可能是人工智能关心的问题,例如意识、生命、思维、自由意志等概念,都是哲学家自认固有的地盘。但如果我们用谷歌距离函数计算维基百科中所有学科的距离和关联度,我们会发现人工智能和哲学的距离并没有想象的那么近,也没有想象的那么依赖哲学。

创造性非虚构(creative nonfiction),例如传记,也算文学的一类,普利策奖就为此有专奖。当下的大部分哲学家都是从事创造性写作但又没有创造能力的人,他们是没有オ华的文学家。计算理论家阿伦森(Scott Aaronson)曾写过一篇文章“为什么哲学家应该学点计算复杂性?”,婉转地表达了对那些喜欢随意地对计算理论说三道四的哲学家的期望。学点计算理论,少说外行话,至少能有助于哲学家了解科学家在谈论什么问题。计算理论的源头可追溯到罗素、维特根斯坦和哥德尔,他们都有哲学背景。甚至图灵也有哲学情怀,他甚至被哲学家兼传记作家蒙克(Ray Monk)称为与柏拉图、罗素并列的十大哲学家。我一直很好奇为什么对人工智能感兴趣的欧陆哲学家比他们的分析哲学对头更多。

丹尼特曾说哲学家喜欢假想实验。其实从某种意义上说,整个人工智能就是个大的假想实验。只不过哲学家用纸和笔,而计算机科学家用计算机硬件和软件。本质是一样的。不同的是哲学家从不为假想实验的结果所苦恼,反而会时不时洋洋自得;而计算机科学家则偶尔会被他们取得的成果所惊到。崇尚科学的英美分析哲学家和欧陆哲学家分歧已久。英国哲学家克里切利(Simon Critchley)曾经写过一本毒舌的《哲学家死亡录》,里面记录了有史以来哲学家的各种死法,他的结论是分析哲学家的死大多是无趣的,而欧陆哲学家的死则多彩缤纷。随着大数据手段的成熟(套用德雷弗斯的话说,所谓成熟就是“随手拈来”),也许哲学家又重新有机会对科学的全局观有所洞见。到底应该是哲学家向科学家学习,还是科学家向哲学家学习?让科学家写一本《哲学家不能干什么》要远比哲学家写《科学家不能干什么》容易得多。

来源:尼克,《人工智能简史》,人民邮电出版社,2017年12月第1版,第177-194页。

往 期 推 荐

责任编辑丨鱼籽

欢迎关注丨丽泽哲学苑

simple living,noble thinking.

荐稿邮箱:lize_philosophy@126.com

以上是关于人工智能简史:哲学家和人工智能的主要内容,如果未能解决你的问题,请参考以下文章