模仿人脑视觉处理,助力神经网络应对对抗性样本

Posted 人工智能学家

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了模仿人脑视觉处理,助力神经网络应对对抗性样本相关的知识,希望对你有一定的参考价值。

来源:混沌巡洋舰

自从深度学习只能识别支票和信封上的手写字母以来,它已经取得了长足的进步。今天,深度神经网络已经成为许多计算机视觉应用的关键组成部分,从照片和视频编辑器到医疗软件和自动驾驶汽车。

神经网络大致模仿了大脑的结构,已经更接近于像人类一样看待世界。但是它们还有很长的路要走,而且它们在人类永远不会犯错的情况下也会犯错。

这些情况,通常被称为对抗性样本,以令人困惑的方式改变了人工智能模型的行为。

对抗性的机器学习是当前人工智能系统的最大挑战之一。它们可能导致机器学习模型以不可预知的方式失败,或者变得容易受到网络攻击。

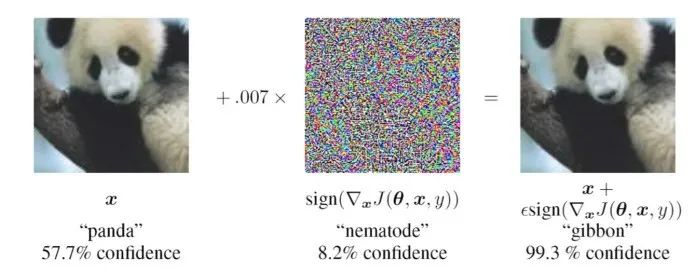

对抗性样本的例子: 在这张熊猫照片中加入一层难以察觉的噪音,会让卷积神经网络误以为它是长臂猿。

创建能够抵御敌对攻击的人工智能系统,已经成为一个活跃的研究领域和人工智能会议的热门话题。在计算机视觉中,保护深度学习系统免受对抗性攻击的一个有趣的方法是应用神经科学的发现来缩小神经网络和哺乳动物视觉系统之间的差距。

麻省理工学院(MIT)和 MIT-ibm 沃森人工智能实验室(Watson AI Lab)的研究人员利用这种方法发现,

将哺乳动物视觉皮层的特征直接映射到深层神经网络,可以创建出行为更可预测、更能抵御对抗性样本的 AI 系统

。在 bioRxiv 预印本服务器上发表的一篇论文中,研究人员介绍了 VOneNet,一种结合了当前深度学习技术和神经科学启发的神经网络的架构。

https://www.biorxiv.org/content/10.1101/2020.06.16.154542v1

这项工作是在慕尼黑大学、路德维希马克西米利安大学和奥格斯堡大学的科学家的帮助下完成的,并被去年举行的 NeurIPS 2020大会接受。

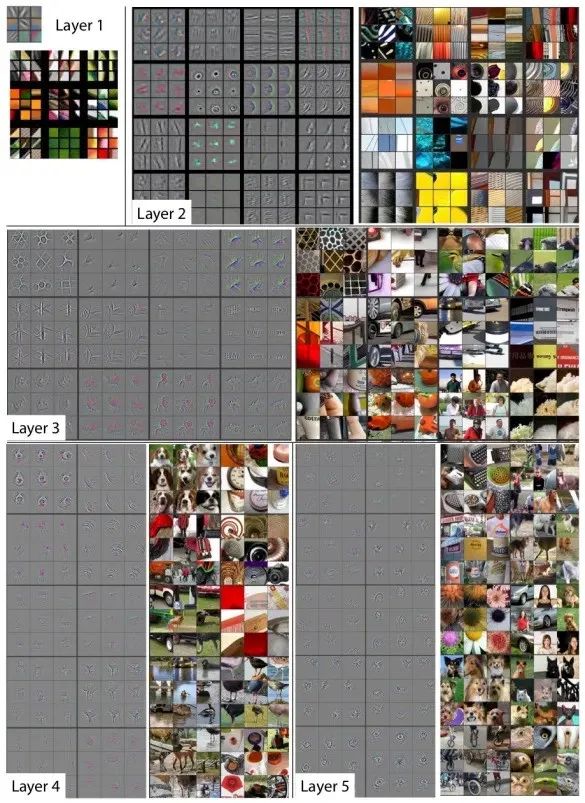

当今计算机视觉的主要体系结构是卷积神经网络(CNN)。当卷积层叠加在一起时,可以学习和提取图像中的层次特征。较低的图层找到一般的模式,如角落和边缘,而较高的图层逐渐变得善于找到更具体的东西,如物体和人。

与传统的全连接网络相比,卷积神经网络已被证明是更加健壮和计算效率更高的。但是 cnn 和人类视觉系统处理信息的方式仍然存在根本的区别。

IBM 麻省理工学院沃森人工智能实验室(mit-IBM Watson AI Lab)主任David Cox向 TechTalks 表示: “深层神经网络(尤其是卷积神经网络)已经成为视觉皮层令人惊讶的优秀模型,它们往往更适合从大脑中收集的实验数据,甚至比专门用于解释神经科学数据的计算模型更好。”。“但并不是所有的深层神经网络都能很好地匹配大脑数据,而且大脑和 dnn 之间存在一些持久的差异。”

其中最突出的差距是对抗性的例子,在这些例子中,

微小的干扰,如一小块或一层不易察觉的噪音,可能导致神经网络错误分类他们的输入

。这些变化通常不为人们所注意。

人工智能研究人员发现,通过在停车标志上添加小小的黑白贴纸,他们可以使计算机视觉算法无法识别出这些标志。

“可以肯定的是,能够欺骗dnn的图像,永远不能欺骗我们自己的视觉系统,”Cox说。“还有一种情况是,dnn 对图像的自然退化(例如,添加噪声)非常脆弱,因此对 dnn 来说,鲁棒性通常似乎是一个悬而未决的问题。考虑到这一点,我们认为这是一个寻找大脑和 dna 之间差异的好地方,这可能有所帮助。”

David Cox,IBM mit-IBM Watson AI 实验室主任

在这项新的研究中,Cox 和 DiCarlo 与论文的主要作者 Joel Dapello 和 Tiago Marques 一起,研究当与大脑活动相似时,神经网络是否能够更强大地抵御敌对性攻击。人工智能研究人员测试了几个流行的 CNN 架构训练的 ImageNet 数据集,包括 AlexNet,VGG,和不同的变化的 ResNet。他们还测试了一些经历过“对抗性训练”的深度学习模型,在这个过程中,一个神经网络使用对抗性的样本进行训练,以避免对它们的错误分类。

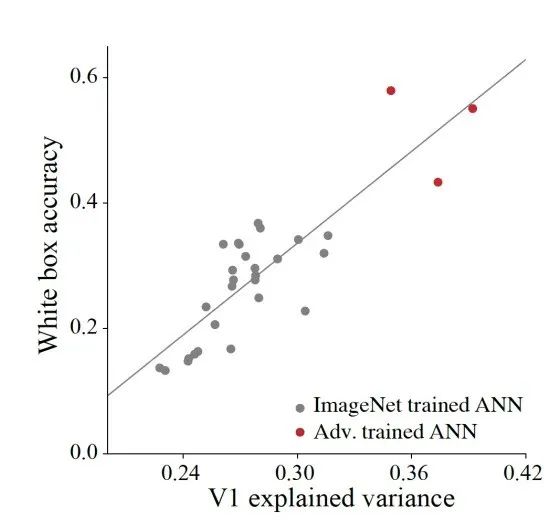

文中使用 BrainScore 度量评估了人工智能模型,该度量比较了深层神经网络的激活和大脑的神经反应。然后,通过测试每个模型对抗白盒对抗性攻击(攻击者完全了解目标神经网络的结构和参数)的鲁棒性来衡量它们的健壮性。

Cox说: “

令我们惊讶的是,神经网络越像大脑,系统就越能抵御对抗性的攻击

。”。“受此启发,我们想知道是否有可能通过在网络的输入阶段增加一个与早期视觉皮层更为类似的处理层,来提高鲁棒性(包括对抗性鲁棒性)。”

神经网络对抗性的强健性,研究表明,大脑得分越高的神经网络对抗白箱对抗性攻击的能力越强。

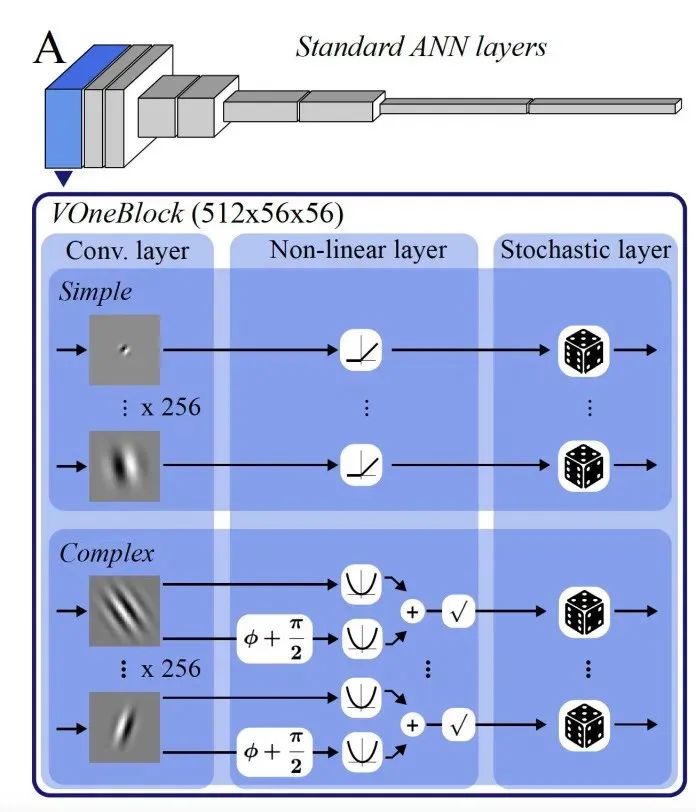

为了进一步验证他们的发现,研究人员开发了 VOneNet,这是一种混合的深度学习架构,它将标准的神经网络与一层受神经科学启发的神经网络相结合。

用 VOneBlock 取代了 CNN 的前几层,VOneBlock 是一种神经网络结构,它是以灵长类动物的初级视觉皮层,也被称为 V1区域而形成的。这意味着图像数据首先由 VOneBlock 处理,然后传递到网络的其余部分。

VOneBlock 本身由 Gabor 滤波器组(GFB)、简单细胞,复细胞非线性处理层以及随机性神经元组成。GFB 类似于其他神经网络中的卷积层。但是经典的神经网络从随机参数值开始并在训练中调整它们时,GFB 参数值的确定和固定是基于我们所知道的初级视觉皮层的激活。

VOneBlock 体系结构,VOneBlock 是一种模仿初级视觉皮层功能的神经网络结构。

“VOneBlock 的网络权重即架构设计完全依据于生物学。这意味着我们对 VOneBlock 的所有选择都受到了神经生理学的限制。换句话说,我们设计 VOneBlock 是为了尽可能地模仿灵长类动物的初级视觉皮层(V1区)。我们考虑了过去40年来从几项研究中收集的可用数据,以确定 VOneBlock 参数。

虽然不同灵长类动物的视觉皮层存在显著差异,但也存在许多共同特征,尤其是 V1区。“幸运的是,灵长类动物之间的差异似乎很小,事实上有大量研究表明猴子的物体识别能力与人类相似。在我们的模型中,我们使用了已发表的描述猴子 V1神经元反应的可用数据。尽管我们的模型仍然只是灵长类动物 V1的近似值(它不包括所有已知数据,甚至这些数据也有一定的局限性ーー对于 V1的处理,我们仍然有很多不知道的地方) ,但它是一个很好的近似值,”。

在 GFB 层之外,VOneBlock 中的简单细胞和复杂细胞为神经网络提供了在不同条件下检测特征的灵活性。“

最终目标是在独立于它们的确切形状、大小、位置和其他低级特征时,识别物体的存在

。在 VOneBlock 中,看起来简单的和复杂的细胞在不同的图像扰动下都起到了互补的作用。简单细胞对于处理常见的数据缺失,而复杂细胞对应对白盒式对抗性攻击尤为重要。”

VOneBlock 的优势之一是它与当前 CNN 架构的兼容性。“ VOneBlock 被设计成具有即插即用的功能,” Marques 说。”这意味着它直接替换标准 CNN 结构的输入层。VOneBlock 核心之后的转换层确保其输出可以与 CNN 体系结构的其余部分兼容。”

研究人员将 VOneBlock 插入到几个 CNN 体系结构中,这些体系结构在 ImageNet 数据集上运行良好。有趣的是,增加这个简单的块导致相当显著的提高了对白箱对抗性攻击的鲁棒性和优于训练为基础的防御方法。

研究人员在他们的论文中写道: “在标准的 CNN 架构前模拟灵长类初级视觉皮层的图像处理,显著地提高了它们对图像扰动的鲁棒性,甚至使它们超越了最先进的防御方法。”。

实验表明,经过修改的卷积神经网络包含 VOneBlock,能够更好地抵御白盒对抗性攻击。

“我们在这里添加的 V1模型实际上非常简单ーー我们只改变系统的第一阶段,而不改变网络的其余部分,而且这个 V1模型的生物学保真度仍然非常简单,”Cox说。他补充说,人们可以在这个模型中添加更多的细节和细微差别,以使它更好地匹配我们对大脑的了解。

这篇论文挑战了过去年人工智能研究中已经变得非常普遍的一个趋势。许多人工智能科学家没有在他们的研究中应用关于大脑机制的最新发现,而是专注于利用大量的计算资源和数据集来训练越来越大的神经网络,从而推动这一领域的进步。这种方法对人工智能研究提出了许多挑战。

VOneNet 证明了生物智能仍然有很多未开发的潜力,可以解决人工智能研究所面临的一些基本问题。“

这里展示的模型直接来自灵长类神经生物学,实际上需要更少的训练来实现更接近人类的行为。这是一个新的良性循环的转折点,神经科学和人工智能相辅相成,相互加强

。”作者写道。

在未来,研究人员将进一步探索 VOneNet 的特性,以及神经科学和人工智能的发现的进一步整合。“我们目前工作的一个局限性是,虽然我们已经证明添加 V1块可以带来改进,但是我们并不能很好地解释为什么会这样,”Cox说。

发展这个理论来帮助理解这个“为什么”的问题将使人工智能研究人员能够最终找到真正重要的东西,并建立更有效的系统。他们还计划在人工神经网络的初始层次之外,探索受神经科学启发的架构的整合。

翻译自:

https://venturebeat.com/2021/01/08/is-neuroscience-the-key-to-protecting-ai-from-adversarial-attacks/

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)云脑研究计划,构建互联网(城市)云脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”

以上是关于模仿人脑视觉处理,助力神经网络应对对抗性样本的主要内容,如果未能解决你的问题,请参考以下文章