朴素贝叶斯之应用

Posted 墨词和她的爬虫

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了朴素贝叶斯之应用相关的知识,希望对你有一定的参考价值。

数据放在https://github.com/meixialee/-machine-earning/tree/master/%E6%9C%B4%E7%B4%A0%E8%B4%9D%E5%8F%B6%E6%96%AF

有两个文件夹ham和spam,spam文件下的txt文件为垃圾邮件。

对于一个文本字符串我们可以使用string.split()方法将其切分也可以使用正则

re.split(r'\W*')其中分隔符是除单词,数字外的任意字符串,还可以使用 .lower()将字符串转换为小写,或者大写.upper()

代码:

def createVocabList(dataSet):

vocabSet = set([]) #创建一个空的不重复列表

for document in dataSet:

vocabSet = vocabSet | set(document) #取并集

return list(vocabSet)

def setOfWords2Vec(vocabList, inputSet):

returnVec = [0] * len(vocabList) #创建一个其中所含元素都为0的向量

for word in inputSet: #遍历每个词条

if word in vocabList: #如果词条存在于词汇表中,则置1

returnVec[vocabList.index(word)] = 1

else: print("the word: %s is not in my Vocabulary!" % word)

return returnVec #返回文档向量

def bagOfWords2VecMN(vocabList, inputSet): #vocabList - createVocabList返回的列表,inputSet - 切分的词条列表

returnVec = [0]*len(vocabList) #创建一个其中所含元素都为0的向量

for word in inputSet: #遍历每个词条

if word in vocabList: #如果词条存在于词汇表中,则计数加一

returnVec[vocabList.index(word)] += 1

return returnVec #返回词袋模型

"""trainMatrix - 训练文档矩阵,即setOfWords2Vec返回的returnVec构成的矩阵

trainCategory - 训练类别标签向量,即loadDataSet返回的classVec"""

import numpy as np

def trainNB0(trainMatrix,trainCategory):

numTrainDocs = len(trainMatrix) #计算训练的文档数目

numWords = len(trainMatrix[0]) #计算每篇文档的词条数

pAbusive = sum(trainCategory)/float(numTrainDocs) #文档属于侮辱类的概率

p0Num = np.ones(numWords); p1Num = np.ones(numWords) #创建numpy.ones数组,词条出现数初始化为1,拉普拉斯平滑

p0Denom = 2.0; p1Denom = 2.0 #分母初始化为2,拉普拉斯平滑

for i in range(numTrainDocs):

if trainCategory[i] == 1: #统计属于侮辱类的条件概率所需的数据,即P(w0|1),P(w1|1),P(w2|1)···

p1Num += trainMatrix[i]

p1Denom += sum(trainMatrix[i])

else: #统计属于非侮辱类的条件概率所需的数据,即P(w0|0),P(w1|0),P(w2|0)···

p0Num += trainMatrix[i]

p0Denom += sum(trainMatrix[i])

p1Vect = np.log(p1Num/p1Denom) #取对数,防止下溢出

p0Vect = np.log(p0Num/p0Denom)

return p0Vect,p1Vect,pAbusive #返回属于侮辱类的条件概率数组,属于非侮辱类的条件概率数组,文档属于侮辱类的概率

5 朴素贝叶斯分类器分类函数

"""

vec2Classify - 待分类的词条数组

p0Vec - 侮辱类的条件概率数组

p1Vec -非侮辱类的条件概率数组

pClass1 - 文档属于侮辱类的概率

0 - 属于非侮辱类

1 - 属于侮辱类

"""

def classifyNB(vec2Classify, p0Vec, p1Vec, pClass1):

p1 = sum(vec2Classify * p1Vec) + np.log(pClass1) #对应元素相乘。logA * B = logA + logB,所以这里加上log(pClass1)

p0 = sum(vec2Classify * p0Vec) + np.log(1.0 - pClass1)

if p1 > p0:

return 1

else:

return 0

6 朴素贝叶斯分类器训练函数

"""

trainMatrix - 训练文档矩阵,即setOfWords2Vec返回的returnVec构成的矩阵

trainCategory - 训练类别标签向量,即loadDataSet返回的classVec

p0Vect - 侮辱类的条件概率数组

p1Vect - 非侮辱类的条件概率数组

pAbusive - 文档属于侮辱类的概率

"""

def trainNB0(trainMatrix,trainCategory):

numTrainDocs = len(trainMatrix) #计算训练的文档数目

numWords = len(trainMatrix[0]) #计算每篇文档的词条数

pAbusive = sum(trainCategory)/float(numTrainDocs) #文档属于侮辱类的概率

p0Num = np.ones(numWords); p1Num = np.ones(numWords) #创建numpy.ones数组,词条出现数初始化为1,拉普拉斯平滑

p0Denom = 2.0; p1Denom = 2.0 #分母初始化为2,拉普拉斯平滑

for i in range(numTrainDocs):

if trainCategory[i] == 1: #统计属于侮辱类的条件概率所需的数据,即P(w0|1),P(w1|1),P(w2|1)···

p1Num += trainMatrix[i]

p1Denom += sum(trainMatrix[i])

else: #统计属于非侮辱类的条件概率所需的数据,即P(w0|0),P(w1|0),P(w2|0)···

p0Num += trainMatrix[i]

p0Denom += sum(trainMatrix[i])

p1Vect = np.log(p1Num/p1Denom) #取对数,防止下溢出

p0Vect = np.log(p0Num/p0Denom)

return p0Vect,p1Vect,pAbusive #返回属于侮辱类的条件概率数组,属于非侮辱类的条件概率数组,文档属于侮辱类的概率tok in listOfTokens if len(tok) > 2] #除了单个字母,例如大写的I,其它单词变成小写7 测试朴素贝叶斯分类

import random

def spamTest():

docList = []; classList = []; fullText = []

for i in range(1, 26): #遍历25个txt文件

wordList = textParse(open('D:\jiqixuexi\spam/%d.txt' % i, 'r').read())#读取每个垃圾邮件,并字符串转换成字符串列表

docList.append(wordList)

fullText.append(wordList)

classList.append(1)#标记垃圾邮件,1表示垃圾文件

wordList = textParse(open('D:\jiqixuexi\ham/%d.txt' % i, 'r').read()) #读取每个非垃圾邮件,并字符串转换成字符串列表

docList.append(wordList)

fullText.append(wordList)

classList.append(0) #标记非垃圾邮件,1表示垃圾文件

vocabList = createVocabList(docList) #创建词汇表,不重复

trainingSet = list(range(50)); testSet = [] #创建存储训练集的索引值的列表和测试集的索引值的列表

for i in range(10): #从50个邮件中,随机挑选出40个作为训练集,10个做测试集

randIndex = int(random.uniform(0, len(trainingSet))) #随机选取索索引值

testSet.append(trainingSet[randIndex]) #添加测试集的索引值

del(trainingSet[randIndex]) #在训练集列表中删除添加到测试集的索引值

trainMat = []; trainClasses = [] #创建训练集矩阵和训练集类别标签系向量

for docIndex in trainingSet: #遍历训练集

trainMat.append(setOfWords2Vec(vocabList, docList[docIndex])) #将生成的词集模型添加到训练矩阵中

trainClasses.append(classList[docIndex]) #将类别添加到训练集类别标签系向量中

p0V, p1V, pSpam = trainNB0(np.array(trainMat), np.array(trainClasses)) #训练朴素贝叶斯模型

errorCount = 0 #错误分类计数

for docIndex in testSet: #遍历测试集

wordVector = setOfWords2Vec(vocabList, docList[docIndex]) #测试集的词集模型

if classifyNB(np.array(wordVector), p0V, p1V, pSpam) != classList[docIndex]: #如果分类错误

errorCount += 1 #错误计数加1

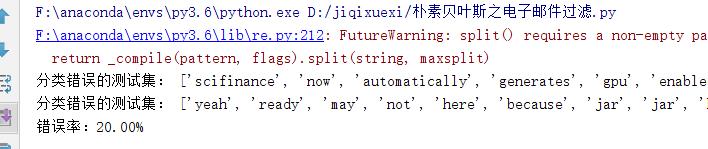

print("分类错误的测试集:",docList[docIndex])

print('错误率:%.2f%%' % (float(errorCount) / len(testSet) * 100))8 运行

if __name__ == '__main__':

spamTest()

结果:

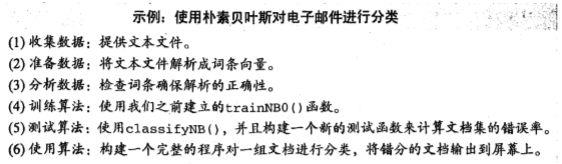

函数spamTest()会输出在10封随机选择的电子邮件上的分类错误概率。既然这些电子邮件是随机选择的,所以每次的输出结果可能有些差别。

1:收集数据

数据存放在我的GitHub上:

https://github.com/meixialee/-machine-earning/tree/master/%E6%9C%B4%E7%B4%A0%E8%B4%9D%E5%8F%B6%E6%96%AF/feedparser-develop

安装Python包:

在终端进入文件的存放目录,然后输入

python setup.py install

2:测试算法:RSS源分类器

2.1 计算出现频率

import operator

def calcMostFreq(vocabList, fullText):

freqDict = {} #新建字典

for token in vocabList: #遍历

freqDict[token] = fullText.count(token)#统计词汇表每个元素出现的次数

sortedFreq = sorted(freqDict.items(), key=operator.itemgetter(1), reverse=True) #根据字典的值降序排序

return sortedFreq[:30] #出现频率最高的30个词

testSet) * 100))

2.2 RSS源分类器

import feedparser # feedparser是python中最常用的RSS程序库

def localWords(feed1, feed0):

docList = []; classList = []; fullText = [] #初始化数据列表

minLen = min(len(feed1['entries']), len(feed0['entries']))#entries内容无法抓取,网站涉及反爬虫技术

for i in range(minLen):

wordList = textParse(feed1['entries'][i]['summary'])#切分文本

docList.append(wordList) #切分后的文本以原始列表形式加入文档列表

fullText.extend(wordList)#切分后的文本直接合并到词汇列表

classList.append(1) ##标记垃圾邮件,1表示垃圾文件

wordList = textParse(feed0['entries'][i]['summary']) #切分文本

docList.append(wordList) #切分后的文本以原始列表形式加入文档列表

fullText.extend(wordList) #切分后的文本直接合并到词汇列表

classList.append(0) #标签列表更新

vocabList = createVocabList(docList) #获得词汇表

top30Words = calcMostFreq(vocabList, fullText) #获得30个频率最高的词汇

for pairW in top30Words: #去掉出现次数最高的那些词

if pairW[0] in vocabList: vocabList.remove(pairW[0])

trainingSet = range(2*minLen); testSet = []#随机构建测试集

for i in range(20): # 随机选取二十个样本作为测试样本

randIndex = int(random.uniform(0, len(trainingSet))) #随机得到Index

testSet.append(trainingSet[randIndex]) #将该样本加入测试集中

del(trainingSet[randIndex]) #同时将该样本从训练集中剔除

trainMat = []; trainClasses = [] #初始化训练集数据列表和标签列表

for docIndex in trainingSet: #遍历训练集

trainMat.append(setOfWords2Vec(vocabList, docList[docIndex])) #词表转换到向量,并加入到训练数据列表中

trainClasses.append(classList[docIndex]) #相应的标签也加入训练标签列表中

p0V, p1V, pSpam = trainNB0(array(trainMat), array(trainClasses)) #朴素贝叶斯分类器训练函数

errorCount = 0 #初始化错误计数

for docIndex in testSet: #遍历测试集进行测试

wordVector = setOfWords2Vec(vocabList, docList[docIndex])#词表转换到向量

if classifyNB(array(wordVector), p0V, p1V, pSpam) != classList[docIndex]: #判断分类结果与原标签是否一致

errorCount += 1 #如果不一致则错误计数加1

print("classification error",docList[docIndex]) #并且输出出错的文档

print('the erroe rate is: ', float(errorCount)/len(testSet)) #打印输出信息

return vocabList, p0V, p1V #返回词汇表和两个类别概率向量

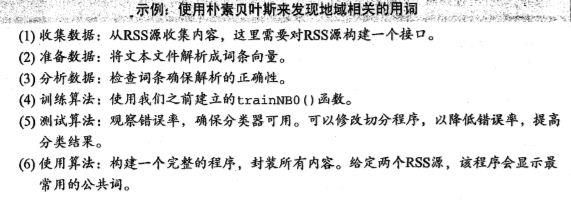

2.3显示地域性相关单词

import operator

def getTopWords(ny, sf):

vocabList, p0V, p1V = localWords(ny, sf) # RSS源分类器返回概率

topNY = []; topSF = []

for i in range(len(p0V)): # 设定阈值,返回大于阈值的所有词,如果输出信息很多,就提高一下阈值

if p0V[i] > -4.5: topSF.append((vocabList[i], p0V[i]))

if p1V[i] > -4.5: topNY.append((vocabList[i], p1V[i]))

sortedSF = sorted(topSF, key=lambda pair: pair[1], reverse=True) # 排序

print("SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**SF**")# 打印

for item in sortedSF:

print(item[0])

sortedNY = sorted(topNY, key=lambda pair: pair[1], reverse=True) # 排序

print("NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**NY**")# 打印

for item in sortedNY:

print(item[0])

到这里就草草结束了,学习为主,学习为主!

图大,扫描关注我吧

以上是关于朴素贝叶斯之应用的主要内容,如果未能解决你的问题,请参考以下文章