揭秘搜索引擎是怎么删除重复网页的?

Posted 马海祥博客

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了揭秘搜索引擎是怎么删除重复网页的?相关的知识,希望对你有一定的参考价值。

最近一直听到圈里的朋友抱怨说,自己辛辛苦苦写的文章,发表的前2天,排名还是很好的,可是被权重高的网站转载后,就排名很靠后了,甚至过段时间连文章也被百度k掉了。其实百度曾在站长贴吧里做过这样一个回复:从用户体验角度来说,有些转载未必比原创差。比方一篇科技原创博文,被知名门户网站的科技频道转载。如果这种转载保留原创者姓名和出处链接,实际上对原创者是有利的,因为起到了更好的传播效果。只是国内的转载,很多是掐头去尾,使原创者比较受伤。

据资料表明近似重复网页的数量占网页总数的的比较高达全部页面的29%,而完全相同的页面大约占全部页面的22%。很多站长都会抱怨,自己写的文章被转载后要么排名消失、要么转载站排在前面。

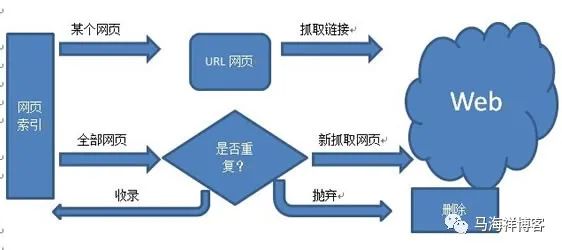

在解决这个问题之前,我认为有必要了解下搜索引擎的“去重算法框架”,换个角度看看搜索引擎是怎么给网页去重的。

你的网页什么时候会被删除?

因为互联网上有大约22%的内容是相同的,一旦你的文章发表在网上,就有可能会被转载,而一般判断帮你的网页为转载,那么搜索引擎一般会从三个时间段来删除你的网页:

(1)、抓取页面的时候删除,这样可以减少搜索引擎带宽以及减少存储数量;

(2)、收录之后删除重复网页;

(3)、用户检索时候进行再次删除;增加准确性,耗费时间;

内容重复的4种类型:

1、如果2篇文章内容和格式上毫无差别,则这种重复叫做“完全重复页面”

2、如果2篇文章内容相同,但是格式不同,则叫做“内容重复页面”

3、如果2篇文章有部分重要的内容相同,并且格式相同,则称为“布局重复页面”

4、如果2篇文章有部分重要的内容相同,但是格式不同,则称为“部分重复页面”

删除重复网页对于搜索引擎有很多好处:

1、如果这些重复网页并从搜索引擎数据库中去掉,就能节省一部分存储空间,提高检索的质量。

2、为了提高网页的搜集速度,搜索引擎会对以往搜集信息的分析,预先发现重复网页,在今后的网页搜集过程中就可以避开这些网页,这就是为什么总转载的网站排名不高的原因了。

3、对某个镜像度较高的网页,搜索引擎会赋予它较高的优先级,当用户搜索时就会赋予它较高的权重。

4、近似镜像网页的及时发现有利于改善搜索引擎系统的服务质量,也就是说如果用户点击了一个死链接,那么可以将用户引导到一个相同页面,这样可以有效的增加用户的检索体验。

通用去重算法框架

对于网页去重任务,具体可以采取的技术手段五花八门,各有创新和特色,但是如果仔细研究,其实大致都差不多。

上图给出了通用算法框架的流程图,对于给定的文档,首先要通过一定特抽取手段,从文档中抽取出一系列能够表征文档主题内容的特征集合。这一步骤往往有其内在要求,即尽可能保留文档重要信息,删除无关信息。之所以要删除部分信息,主要是从计算速度的角度考虑,一般来说,删除的信息越多,计算速度会越快。

这就是为什么你想做的关键字总没有排名,反而不想做的关键词却能排名靠前的原因之一,搜索引擎把它认为不重要的词语删除了。总之,我个人认为要想做好一个站,最终还是要从访客的角度来,真正能提供访客想要的资讯,才能有更长远的发展。

以上是关于揭秘搜索引擎是怎么删除重复网页的?的主要内容,如果未能解决你的问题,请参考以下文章