如何用ELKstack(ElasticSearch+Logstash+ Kibana)搭建实时日志分析平台

Posted 168大数据

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了如何用ELKstack(ElasticSearch+Logstash+ Kibana)搭建实时日志分析平台相关的知识,希望对你有一定的参考价值。

听说,这里有最具价值的大数据实战干货、

大数据技术经验、大数据创新思维,

更有你想融入的大数据高端人脉圈

据说,国内近6成大数据精英都在这

尽情分享吧 我的朋友

一、简介

ELK 由三部分组成elasticsearch、logstash、kibana,elasticsearch是一个近似实时的搜索平台,它让你以前所未有的速度处理大数据成为可能。

Elasticsearch所涉及到的每一项技术都不是创新或者革命性的,全文搜索,分析系统以及分布式数据库这些早就已经存在了。它的革命性在于将这些独立且有用的技术整合成一个一体化的、实时的应用。Elasticsearch是面向文档(document oriented)的,这意味着它可以存储整个对象或文档(document)。然而它不仅仅是存储,还会索引(index)每个文档的内容使之可以被搜索。在Elasticsearch中,你可以对文档(而非成行成列的数据)进行索引、搜索、排序、过滤。这种理解数据的方式与以往完全不同,这也是Elasticsearch能够执行复杂的全文搜索的原因之一。

应用程序的日志大部分都是输出在服务器的日志文件中,这些日志大多数都是开发人员来看,然后开发却没有登陆服务器的权限,如果开发人员需要查看日志就需要到服务器来拿日志,然后交给开发;试想下,一个公司有10个开发,一个开发每天找运维拿一次日志,对运维人员来说就是一个不小的工作量,这样大大影响了运维的工作效率,部署ELKstack之后,开发任意就可以直接登陆到Kibana中进行日志的查看,就不需要通过运维查看日志,这样就减轻了运维的工作。

日志种类多,且分散在不同的位置难以查找:如LAMP/LNMP网站出现访问故障,这个时候可能就需要通过查询日志来进行分析故障原因,如果需要查看apache的错误日志,就需要登陆到Apache服务器查看,如果查看数据库错误日志就需要登陆到数据库查询,试想一下,如果是一个集群环境几十台主机呢?这时如果部署了ELKstack就可以登陆到Kibana页面进行查看日志,查看不同类型的日志只需要电动鼠标切换一下索引即可。

Logstash:日志收集工具,可以从本地磁盘,网络服务(自己监听端口,接受用户日志),消息队列中收集各种各样的日志,然后进行过滤分析,并将日志输出到Elasticsearch中。

Elasticsearch:日志分布式存储/搜索工具,原生支持集群功能,可以将指定时间的日志生成一个索引,加快日志查询和访问。

Kibana:可视化日志Web展示工具,对Elasticsearch中存储的日志进行展示,还可以生成炫丽的仪表盘。

二、安装部署(因为我是测试环境,就将ElasticSearch+Logstash+ Kibana装在一台虚拟机上面了)

安装jdk

rpm -ivh jdk-8u92-linux-x64.rpm

vi /etc/profile

JAVA_HOME=/usr/java/jdk1.8.0_92/

source /etc/profile

echo $JAVA_HOME

/usr/java/jdk1.8.0_92/

java -version

java version "1.8.0_92"

Java(TM) SE Runtime Environment (build 1.8.0_92-b14)

Java HotSpot(TM) 64-Bit Server VM (build 25.92-b14, mixed mode)

安装elasticsearch

rpm --import

添加yum文件

echo "

[elasticsearch-2.x]

name=Elasticsearch repository for 2.x packages

baseurl=http://packages.elastic.co/elasticsearch/2.x/centos

gpgcheck=1

gpgkey=http://packages.elastic.co/GPG-KEY-elasticsearch

enabled=1" >> /etc/yum.repos.d/elasticsearch.repo

yum install elasticsearch -y

mkdir /data/elk/{data,logs}

Type Description Location

home elasticsearch安装的目录 {extract.path}

bin elasticsearch二进制脚本目录 {extract.path}/bin

conf 配置文件目录 {extract.path}/config

data 数据目录 {extract.path}/data

logs 日志目录 {extract.path}/logs

plugins 插件目录 {extract.path}/plugin

配置说明:

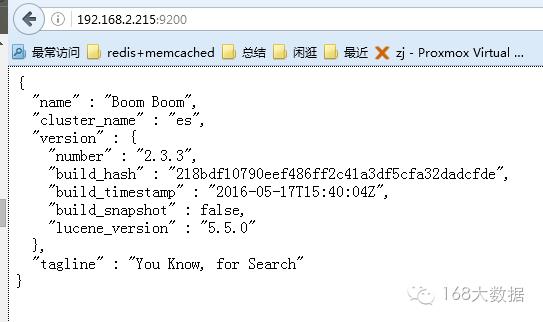

vi /etc/elasticsearch/elasticsearch.yml

cluster.name: es

path.data: /data/elk/data

path.logs: /data/elk/logs

bootstrap.mlockall: true

network.host: 0.0.0.0

http.port: 9200

discovery.zen.ping.unicast.hosts: ["192.168.2.215", "host2"]

启动:

/etc/init.d/elasticsearch start

elasticsearch的config文件夹里面有两个配置文件:elasticsearch.yml和logging.yml,

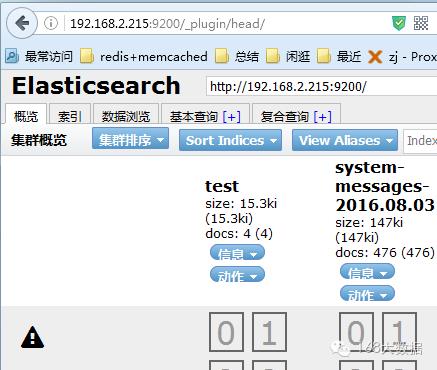

安装head插件(集群管理插件)

cd /usr/share/elasticsearch/bin/

./plugin install mobz/elasticsearch-head

ll /usr/share/elasticsearch/plugins/head

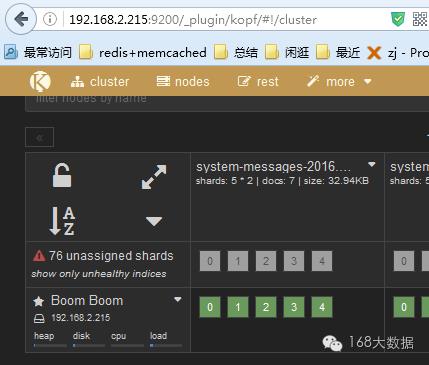

安装kopf插件(集群资源查看和查询插件)

/usr/share/elasticsearch/bin/plugin install lmenezes/elasticsearch-kopf

启动elasticearch

/etc/init.d/elasticsearch start

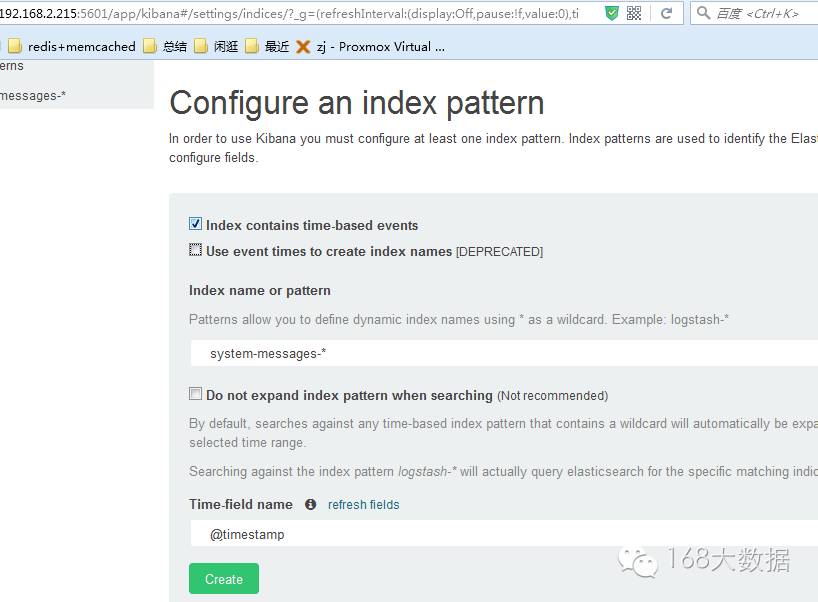

安装kibana

kibana本质上是elasticsearch web客户端,是一个分析和可视化elasticsearch平台,可通过kibana搜索、查看和与存储在elasticsearch的索引进行交互。可以很方便的执行先进的数据分析和可视化多种格式的数据,如图表、表格、地图等。

Discover页面:交互式的浏览数据。可以访问所匹配的索引模式的每个索引的每个文档。可以提交搜索查询,过滤搜索结果和查看文档数据。还可以搜索查询匹配的文档数据和字段值的统计数据。还可以选定时间以及刷新频率

tar zxvf kibana-4.5.1-linux-x64.tar.gz

mv kibana-4.5.1-linux-x64 /usr/local/

vi /etc/rc.local

/usr/local/kibana-4.5.1-linux-x64/bin/kibana > /var/log/kibana.log 2>&1 &

vi /usr/local/kibana-4.5.1-linux-x64/config/kibana.yml

server.port: 5601

server.host: "192.168.2.215"

elasticsearch.url: ""

将nginx日志转换成json

vim /usr/local/nginx/conf/nginx.conf

log_format access1 '{"@timestamp":"$time_iso8601",'

'"host":"$server_addr",'

'"clientip":"$remote_addr",'

'"size":$body_bytes_sent,'

'"responsetime":$request_time,'

'"upstreamtime":"$upstream_response_time",'

'"upstreamhost":"$upstream_addr",'

'"http_host":"$host",'

'"url":"$uri",'

'"domain":"$host",'

'"xff":"$http_x_forwarded_for",'

'"referer":"$http_referer",'

'"status":"$status"}';

access_log /var/log/nginx/access.log access1;

重新载入nginx

/usr/local/nginx/sbin/nginx -s reload

安装logstash

在logstash中,包括了三个阶段:

输入input --> 处理filter(不是必须的) --> 输出output

rpm --import

echo "

[logstash-2.1]

name=Logstash repository for 2.1.x packages

baseurl=http://packages.elastic.co/logstash/2.1/centos

gpgcheck=1

gpgkey=http://packages.elastic.co/GPG-KEY-elasticsearch

enabled=1" >> /etc/yum.repos.d/logstash.repo

yum install logstash -y

通过配置验证Logstash的输入和输出

vim /etc/logstash/conf.d/stdout.conf

input {

stdin {}

}

output {

stdout {

codec => "rubydebug"

}

}

vim /etc/logstash/conf.d/logstash.conf

input {

stdin {}

}

input {

stdin {}

}

output {

elasticsearch {

hosts => ["192.168.2.215:9200"]

index => "test"

}

}

vim /etc/logstash/conf.d/logstash.conf

output {

elasticsearch {

hosts => ["192.168.2.215:9200"]

index => "test"

}

input {

file {

type => "messagelog"

path => "/var/log/messages"

start_position => "beginning"

}

}

output {

file {

path => "/tmp/123.txt"

}

elasticsearch {

hosts => ["192.168.2.215:9200"]

index => "system-messages-%{+yyyy.MM.dd}"

}

}

检查配置文件语法

/etc/init.d/logstash configtest

vim /etc/init.d/logstash

LS_USER=root

LS_GROUP=root

来源:博客园 zclzhao

与作者留言评论互动吧!

干货推荐,你值的一读:

168大数据

168大数据 www.bi168.cn 是国内最具影响力的学习型大数据社群媒体,是专注大数据、商业智能、数据分析、云计算、人工智能等数据科学领域的深度交流、知识分享与职业发展平台,以大数据驱动创业创新和助力传统产业转型升级为使命,致力于为大数据产业的从业者、传统企业、厂商、服务商提供最具价值的资讯、服务与连接。平台聚集了国内外近十万数据领域的创始人CEO、首席技术官、首席数据官、数据科学家、大数据工程师等精英人物,共同致力于大数据技术、大数据价值、大数据思维的传播、交流与分享。

加入大数据高端人脉圈,请微信后台回复:大数据俱乐部

入群暗号:入群姓名-公司-职务,将根据职务分配相关群

也欢迎大家加入:

SAP HANA+BO交流群:521871032 大数据高管群:364910323

投稿/合作请邮件至link@bi168.cn

大数据讲师入驻:http://form.mikecrm.com/M7zzSY

大数据人才库:http://form.mikecrm.com/ftGxaA

大数据招聘需求:http://form.mikecrm.com/9o2naK

以上是关于如何用ELKstack(ElasticSearch+Logstash+ Kibana)搭建实时日志分析平台的主要内容,如果未能解决你的问题,请参考以下文章