R语言jiebaR包文本中文分词及词云制作上机练习

Posted 小兵学R语言

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了R语言jiebaR包文本中文分词及词云制作上机练习相关的知识,希望对你有一定的参考价值。

我是R语言的小白用户,关于R语言的学习,我的目标是隔三差五上机实践练习,每天进步一点点。

微信出现之前,qq群是我和读者交流的主要阵地,一般我会问大家为什么入群这样一个问题,收集到一些有趣的回答,今天就以这组文本数据练习中文分词和词云图的制作。

首先我们先从excel读取数据

data <- read.xlsx("why.xlsx")data <- data[,1]

准备jiebaR包和分词引擎

library(jiebaR)engine <- worker()

开始分词

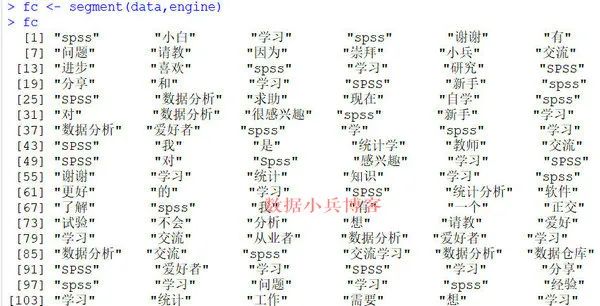

fc <- segment(data,engine)

我们会发现分词质量不高,有些词语要剔除。

准备停止词stopwords.txt

t <- readLines('stopwords.txt')stopwords<-c(NULL)for(i in 1:length(t)){stopwords[i]<-t[i]}

开始过滤

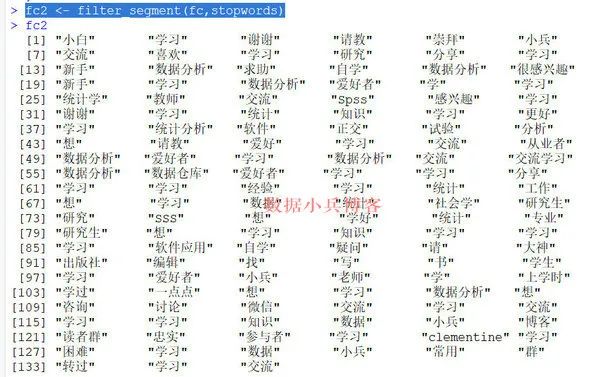

fc2 <- filter_segment(fc,stopwords)

过滤之后,我们发现此时的关键词更加凸显。

统计词频

freq <- sort(table(fc2),decreasing = T)

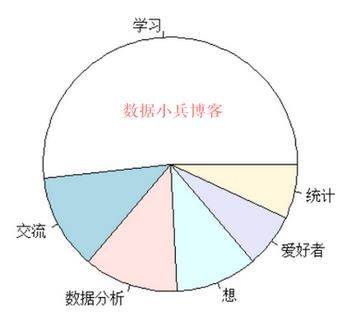

简单画个饼图看看效果咋样吧

pie(head(freq))

联想造句:爱好者想学习和交流数据分析和统计(这个意思非常符合入qq群目标)。

把关键词和词频转换为数据框结构

mydata=data.frame(word=names(freq),freq=as.vector(freq),stringsAsFactors= F)

制作一个词云图吧

library(wordcloud2)wordcloud2(mydata,size = 1.5)

这就是最终效果了,简单总结一下:入群最主要的目的是“学习”“数据分析”以及“统计”了,ta们都有谁内?有“爱好者”、“新手”、“研究生”,不管是“交流”,或是“请教”“咨询”,总是是要“谢谢”“数据小兵”(纯属娱乐造句)。

更多内容欢迎持续关注:小兵学R语言

本文完

文/图=数据小兵

历史文章 ↓

和小兵一起学R语言,小兵推荐视频课程 ↓

↙点开【阅读原文】观看R视频

以上是关于R语言jiebaR包文本中文分词及词云制作上机练习的主要内容,如果未能解决你的问题,请参考以下文章