复旦大学刘鹏飞博士论文自然语言处理中的神经表示学习,153页pdf

Posted 专知

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了复旦大学刘鹏飞博士论文自然语言处理中的神经表示学习,153页pdf相关的知识,希望对你有一定的参考价值。

表示学习(representation learning), 又称表征学习,是指将输入数据转化成 适用于机器学习形式的过程。通常地,机器学习的性能依赖于对数据表示的选 择,一个好的表示可以使得模型对输入数据进行更好的理解。近年来,神经网络 的兴起,使得我们可以自动地对输入数据进行特征抽取。这极大推动了表示学习 的发展,并给我们带来了进一步探究的可能性。

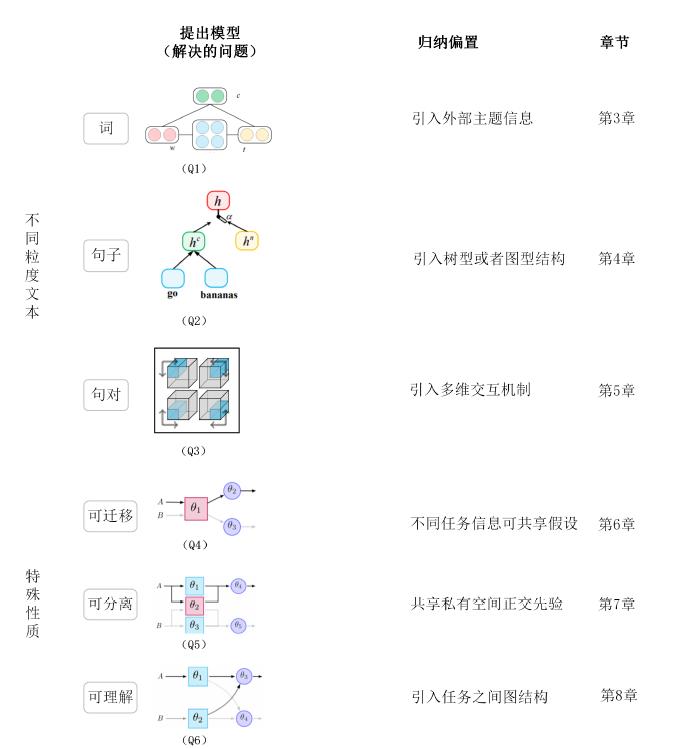

一般地,表示学习的研究可以按照不同角度进行划分:从学习方式上,可以 分为有监督学习和无监督学习;从输入数据模态上,可以分为文本表示、图像表 示以及语音表示;从共享独立性上,可以分为共享表示和私有表示。在自然语言 处理中,使用深度学习技术(即深度神经网络)对文本进行表示学习已经成为一 个很有价值的研究方向。本文工作围绕着以下问题展开:1)对于不同粒度的文 本(词语、句子、句对),如何设计合理的结构,使得模型可以学习到适合最终任 务的表示?深度学习的到来使得自然语言处理中的研究工作由原来的特征工程 (feature engineering) 过渡到了现在的结构工程 (architecture engineering) ,而对于 文本的表示学习,首先要解决的最基本问题就是寻找合适的归纳偏置 (inductive bias),使得模型可以更好地对输入文本进行编码。而本文分别针对不同粒度的文 本信号,进行相应的网络结构探索,希望找到更适合下游任务的结构偏置。2)如 何进行针对性的迁移学习?有针对性地进行迁移是指我们要对迁移的知识“按 需分配”,这就要求我们学习的知识应该具备可迁移性,此外,我们还要对已有 的知识进行可理解分析,从而可以分离我们真正需要的知识,最终实现知识的定 向迁移。对于以上两个亟待解决的问题,本文通过两个方面,九个章节进行递进 式探讨,其贡献总结如下:

一方面,对于不同粒度文本的表示学习,本文分别探索了最适合下游任务的 归纳偏置,并且利用这些归纳偏置设计新的模型,这些模型在主流的数据集上都 取得了当时最好的效果。

1. 词语: 词语表示学习的研究是深度神经网络技术最先触及的领域。经典的 基于神经网络的分布式语义表示学习方法可以将任意词映射到一个低维的 向量空间,然而这种表示往往与上下文独立,无法处理一词多义的现象。针 对这个问题,我们提出了融入 “主题” 信息的神经张量词语表示学习模型, 该模型最大的特点是可以学习到与上下文相关的词表示,从而缓解一词多 义现象带来的语义消歧问题。

2. 句子:基于深度神经网络的句子表示学习是一个重要的研究任务。在句子 建模的任务里,我们的研究围绕着三个问题展开:如何建模包含习语的句 子?如何解决语义合成的多样性与函数单一性导致的网络表示能力不足的 问题?如何动态学习句子的结构而不是预先指定?针对以上问题,我们分 别提出了基于树结构的自适应语义合成网络、动态语义合成网络、和基于 图的语境化网络。这些模型分别引入了不同的并且适用于当前任务的结构偏置。

3. 句对:句对的表示学习在自然语言处理中有很广泛的应用场景,如语义匹 配,自动问答等。解决这个任务的关键在于如何建模两个句子之间复杂的 交互关系。这里我们提出了一种基于多维长短时记忆网络的学习框架,可以建立两个句子之间强交互关系。

另一方面,我们提出学习具有特殊性质的文本表示,这为我们实现针对性迁 移做了铺垫。具体说来,我们通过利用对抗学习(adversarial learning)以及元学 习(meta learning)方式,探索了如何学习具有可迁移性、可分离性,可理解性 的文本表示。

1. 可迁移性:深度学习技术不仅可以自动提取出有用的特征,它的另一个迷 人之处在于可以对已经学习好的特征进行迁移学习。本文以循环神经网络 为原型,提出了三种适用于文本序列可迁移性学习的框架。

2. 可分解性:一个好的表示应该可以结构化,并且按照功能属性进行分离,这 样我们才能更好地进行迁移使用。本文中,为了将不同任务之间共享和私有的特征实现分离,我们将对抗学习的思想引入到多任务学习中,该模型 可以实现对共享空间的净化,实现共享-私有特征的正交分离。

3. 可理解性:很多时候,深度模型取得好结果是以牺牲我们对模型的理解能 力为代价的。那么对于学习到的表示,如何对学习的知识进行可理解分析?本文通过动态建立图神经网络实现了一种可理解模型的学习。

关键词:深度学习;语义表示学习;自然语言处理;归纳偏置;知识迁移

专知便捷查看

后台回复“NRL153” 可以获取《【复旦大学刘鹏飞博士论文】自然语言处理中的神经表示学习,153页pdf》专知下载链接索引

以上是关于复旦大学刘鹏飞博士论文自然语言处理中的神经表示学习,153页pdf的主要内容,如果未能解决你的问题,请参考以下文章