GitHub: ProxyPool 爬虫代理IP池

Posted GitHub每日探索

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了GitHub: ProxyPool 爬虫代理IP池相关的知识,希望对你有一定的参考价值。

hello,小伙伴们,大家好,今天给大家分享的开源项目是:proxy_pool,这个开源项目是抓取个大免费代理IP网站,感兴趣的爬虫可以尝试把代码clone下载然后尝试应用一下,加油!!!

______ ______ _

| ___ \_ | ___ | |

| |_/ / \__ __ __ _ __ _ | |_/ /___ ___ | |

| __/| _// _ / /| | | || __// _ / _ | |

| | | | | (_) | > < |_| || | | (_) | (_) || |___

\_| |_| \___/ /_/\_ \__ |\_| \___/ \___/ \_____

__ / /

/___ /

免费代理源

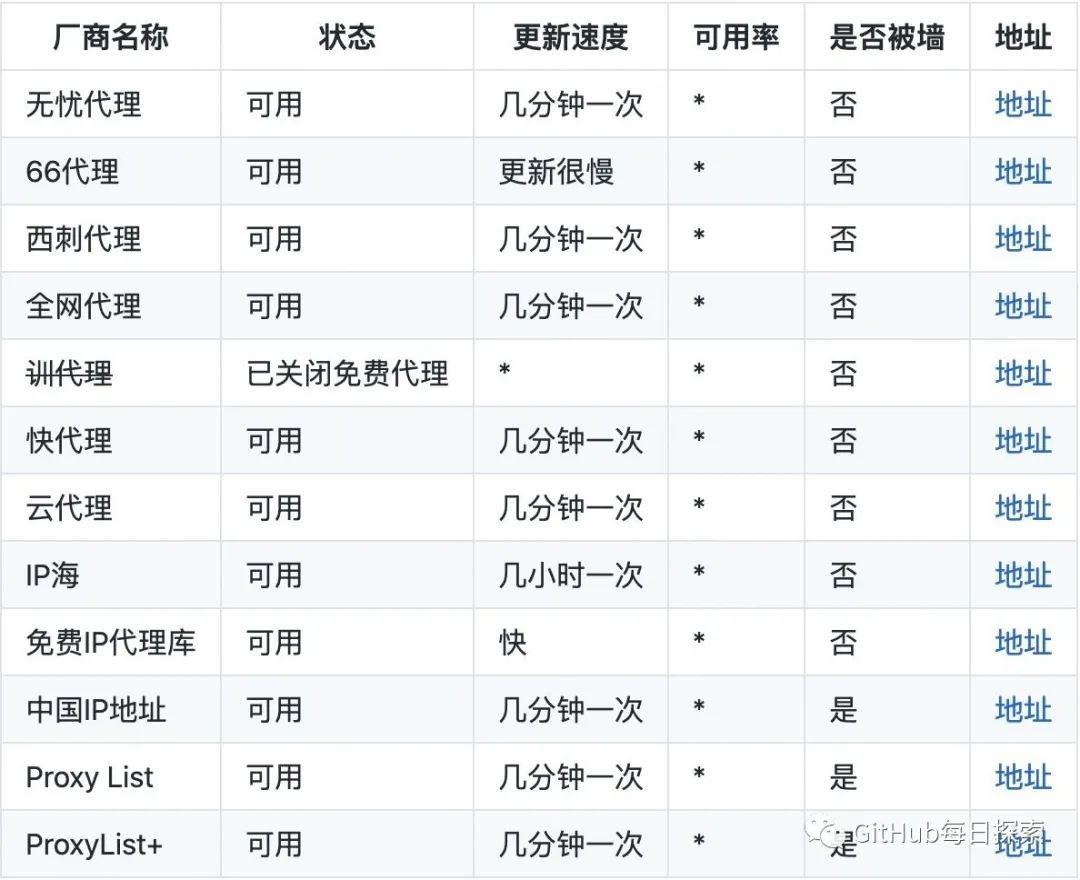

目前实现的采集免费代理网站有(排名不分先后, 下面仅是对其发布的免费代理情况, 付费代理测评可以参考这里):

如果还有其他好的免费代理网站, 可以在提交在issues, 下次更新时会考虑在项目中支持。

运行项目

下载代码:

git clone git@github.com:jhao104/proxy_pool.git

or

https://github.com/jhao104/proxy_pool/releases 下载对应zip文件

安装依赖:

pip install -r requirements.txt

更新配置:

# setting.py 为项目配置文件

# 配置API服务

HOST = "0.0.0.0" # IP

PORT = 5000 # 监听端口

# 配置数据库

DB_CONN = 'redis://@127.0.0.1:8888'

# 配置 ProxyFetcher

PROXY_FETCHER = [

"freeProxy01", # 这里是启用的代理抓取方法名,所有fetch方法位于fetcher/proxyFetcher.py

"freeProxy02",

# ....

]

启动项目:

# 如果已经具备运行条件, 可用通过proxyPool.py启动。

# 程序分为: schedule 调度程序 和 server Api服务

# 启动调度程序

python proxyPool.py schedule

# 启动webApi服务

python proxyPool.py server

Docker运行

docker pull jhao104/proxy_pool

docker run --env DB_CONN=redis://:password@ip:port/db -p 5010:5010 jhao104/proxy_pool:2.1.0

使用

如果要在爬虫代码中使用的话, 可以将此api封装成函数直接使用,例如:

import requests

def get_proxy():

return requests.get("http://127.0.0.1:5010/get/").json()

def delete_proxy(proxy):

requests.get("http://127.0.0.1:5010/delete/?proxy={}".format(proxy))

# your spider code

def gethtml():

# ....

retry_count = 5

proxy = get_proxy().get("proxy")

while retry_count > 0:

try:

html = requests.get('http://www.example.com', proxies={"http": "http://{}".format(proxy)})

# 使用代理访问

return html

except Exception:

retry_count -= 1

# 删除代理池中代理

delete_proxy(proxy)

return None

扩展代理

项目默认包含几个免费的代理获取源,但是免费的毕竟质量有限,所以如果直接运行可能拿到的代理质量不理想。所以,提供了代理获取的扩展方法。

添加一个新的代理源方法如下:

1、首先在ProxyFetcher类中添加自定义的获取代理的静态方法, 该方法需要以生成器(yield)形式返回host:ip格式的代理,例如:

class ProxyFetcher(object):

# ....

# 自定义代理源获取方法

@staticmethod

def freeProxyCustom1(): # 命名不和已有重复即可

# 通过某网站或者某接口或某数据库获取代理

# 假设你已经拿到了一个代理列表

proxies = ["x.x.x.x:3128", "x.x.x.x:80"]

for proxy in proxies:

yield proxy

# 确保每个proxy都是 host:ip正确的格式返回

2、添加好方法后,修改setting.py文件中的PROXY_FETCHER项:

在PROXY_FETCHER下添加自定义方法的名字:

PROXY_FETCHER = [

"freeProxy01",

"freeProxy02",

# ....

"freeProxyCustom1" # # 确保名字和你添加方法名字一致

]

schedule 进程会每隔一段时间抓取一次代理,下次抓取时会自动识别调用你定义的方法。

以上就是这个开源项目的详细介绍了,感兴趣的小伙伴可以尝试应用一下。

今天的推荐不知道大家喜欢吗?如果你们喜欢话,请在文章底部留言或点赞,以表示对我的支持,你们的留言,点赞,转发关注是我持续更新的动力哦!

以上是关于GitHub: ProxyPool 爬虫代理IP池的主要内容,如果未能解决你的问题,请参考以下文章