(13)聚类算法——GMM

Posted AI初见

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了(13)聚类算法——GMM相关的知识,希望对你有一定的参考价值。

GMM,Gaussian MixtureModel,高斯混合模型,其假设数据都是从多个不同的高斯分布中生成出来的,直白的说就是样本分布是由若干个高斯分布线性叠加起来的。假设每个GMM,组成,由K个高斯分布组成。若要从GMM中获取数据,可以分为两步:从k个高斯分布中选取其中一个,每个分布被选中的概率实际就是该分布加权时的系数;选定分布之后,再从这个分布中选取一点。

那么如何用GMM来做聚类?很简单,我们已知数据,就依靠这些数据拟合出GMM的概率分布来就可以了,组成GMM的K个分布就是对应的K个类别。假设N个数据点,某个数据服从某个分布的概率为p(x)。在GMM中需要确定每个分布的系数、均值和方差。

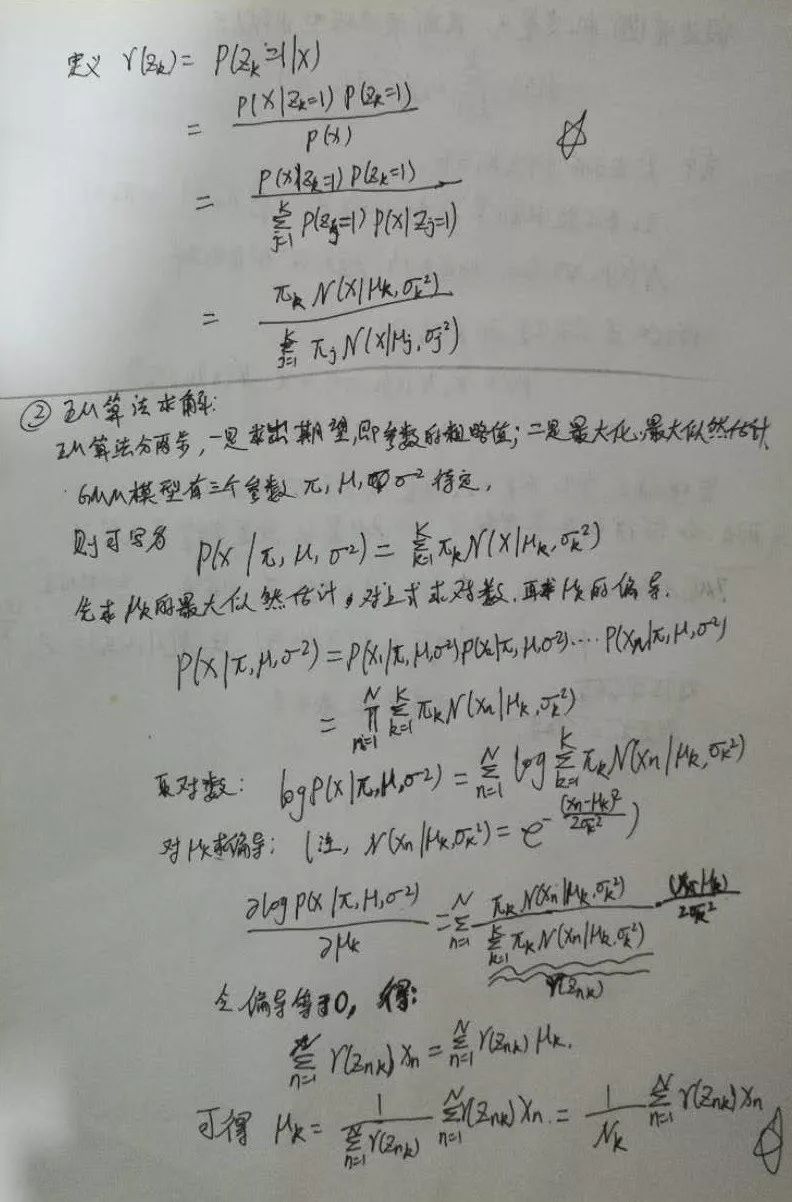

推导过程:

因手写,不太清晰,可以参照链接,链接中给推导过程不全,可以结合下图的步骤。https://blog.csdn.net/jinping_shi/article/details/59613054。

推导过程中,提到了EM算法,所谓EM就是期望最大化,其分两个步骤,求期望,然后最大值,在算法流程中有体现。

算法流程:

以上是关于(13)聚类算法——GMM的主要内容,如果未能解决你的问题,请参考以下文章