Ncam图像识别跟踪系统结合UE4在节目制作中的应用

Posted 演艺科技传媒

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Ncam图像识别跟踪系统结合UE4在节目制作中的应用相关的知识,希望对你有一定的参考价值。

随着虚拟技术的快速发展,其越来越多地被应用于综艺、体育、访谈、电子竞技等各类电视节目中,实时数据的AR呈现、商业广告的虚拟植入、虚拟IP的同台演艺、节目场景的虚实融合、物体与现象的虚拟展示等。众多融入虚拟技术的节目符合人们对电视节目求新求变的需求,也给观众带来了强烈的视觉冲击效果。另一方面,技术手段的革新也给电视节目制作人员带来了丰富的想象空间,使中国电视节目制作手段更加丰富多样。

1 虚拟制作的技术组成

虚拟制作系统主要由跟踪系统和虚拟系统组成。跟踪系统主要提供摄像机在运动拍摄中,虚拟物体与实景之间位置关系的实时数据。这些实时的跟踪数据通过网络或者串口传输至虚拟系统,并与虚拟系统中设计的场景及虚拟物体相结合,再与真实的摄像机画面叠加,呈现出最终的渲染合成画面。对于不同的节目类型、节目效果、节目拍摄环境,需要结合不同的跟踪系统以及虚拟系统来制作。

跟踪系统有多种类型,包括物理跟踪、红外跟踪、图像识别跟踪等。在众多类型的跟踪系统中,图像识别跟踪系统通过不同的策略定义,实现多区域、多策略化自动跟踪,能够更适用各种摄像机及场地跟踪模式,配合目前主流的UE4虚幻系统,可以制作出更加灵活和更高质量的节目。

2 Ncam图像识别跟踪系统

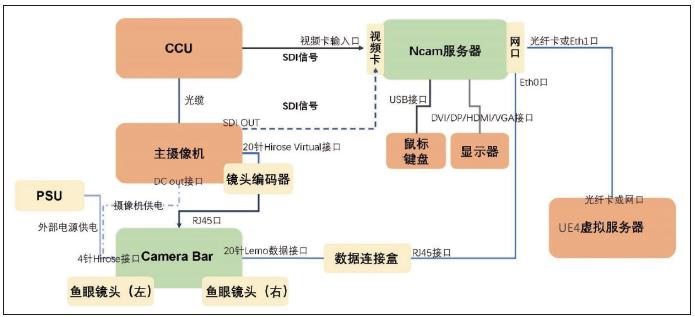

Ncam图像识别跟踪系统是一套基于光学图像识别跟踪系统,由一套多传感器摄像头组件CameraBar(包括2支鱼眼镜头和辅助陀螺仪)和一个服务器连接而成,如图1所示。其跟踪原理主要是通过鱼眼镜头拍摄的画面实时传输回服务器,在服务器中Ncam Reality软件可对拍摄画面进行图像识别,对于图像中被识别到的点系统自动生成一个标记点,通过实时的画面传输,系统会在三维的空间中生成大量的标记点形成点云,通过点云的对比,来计算出虚拟物体在空间中的位置。Ncam图像识别跟踪系统使用精密硬件与先进算法相结合,其具有以下特性。

图1 基于光学图像识别的跟踪系统

应用灵活。Ncam图像识别跟踪可适配于所有机位,包括固定机位、摇臂、伸缩臂、斯坦尼康等,并且系统可支持所有专业的摄像机机型,这使得该系统几乎可以应用在影视、广播电视的任何拍摄环境中。

部署简单。拍摄环境中无需设置基准点或跟踪标记,简单设置即可开始实时追踪。

追踪准确。采用可视化图形计算的方式,可以精准地制作每一个镜头的镜头文件,这在很大程度上保证了跟踪的准确性,同时在跟踪过程中,系统采用先进的算法使得在任何拍摄条件下,如摄像机机位位移镜头拉远、拉近等,虚拟人物场景也能准确追踪真实环境,并可以实时完整呈现虚实结合的场景。

安全的实时跟踪。摄影机位置追踪采用光学定位和惯性传感定位结合,即使在光学跟踪丢失的情况下,仅靠陀螺仪的惯性定位也能保证跟踪数据的实时传递。

3 虚幻系统UE4的优势

目前,国内外主流虚拟系统都采用UE4(虚幻4)软件系统作为核心处理手段,如Zero Density、Avid、BrainStorm、Ross、大洋等。UE4具有以下几方面的优势。

实时逼真渲染。基于物理的渲染、高级动态阴影选项、屏幕空间反射和光照通道等功能可灵活而高效地制作出细节丰富且逼真的视觉效果。

可视化脚本开发。游戏逻辑的开发结构可提供独创的蓝图方式和C++代码方式。其中,蓝图是一种比较简单易用但又功能强大的可视化脚本开发方式,提升了系统的可操作性。

专业动画与过场。动画与过场功能可提供由影视行业专家设计的完整的非线性、实时动画工具(Sequencer),包括动态剪辑、动画运镜以及实时录制。

健壮的GamePla(游戏)框架。GamePlay框架可提供包含游戏规则、玩家输出与控制、相机和用户界面等核心系统,同时内置了各种类型的游戏模板和多人游戏模板等,这为竞技类型的节目提供了丰富的原型模板,可拓展节目内容的制作,缩短制作周期。

灵活的材质编辑器。材质编辑器可提供基于节点的图形化编辑着色器的功能。

先进的人工智能。提供的相关人工智能的工具有行为树、场景查询系统等。

源代码开源。开源源代码可更深入地学习或解决问题,同时可以保持虚拟系统可持续升级,保证该软件的先进性,利于满足节目制作不断变化的需求。

4 Ncam图像识别系统和UE4的结合应用

Ncam在2016年NAB展上展示了Ncam图像识别跟踪系统配合UE4的实时虚拟互动系统,参观者可与犹如照片般逼真的Maclaren麦克拉伦汽车进行实时的虚拟互动。随着UE4和Ncam图像识别跟踪系统的不断升级,两个系统间的结合已非常完善,可应用于影视、广播电视等领域的节目制作中。

4.1

系统连接

4.1

系统连接

Ncam图像识别跟踪系统硬件部分主要包括CameraBar、镜头编码器、数据盒、服务器。其中,CameraBar由2支鱼眼镜头及内置陀螺仪组成,主要用于拍摄画面输出实时数据;镜头编码器用于采集镜头focus、zoom实时数据;数据盒用于汇聚CameraBar和镜头编码数据并输出至服务器。Ncam图像识别跟踪系统与安装在UE4软件中的Ncam AR插件配合,采集的实时跟踪数据在Ncam服务器中经过计算后,通过网络传输至UE4主机,如图2所示,即能实现跟踪数据、SDI信号的输入与制作,最终输出SDI信号完成制作。

图2 Ncam图像识别跟踪系统与UE4系统的硬件连接

4.2

系统功能的融合运用

4.2

系统功能的融合运用

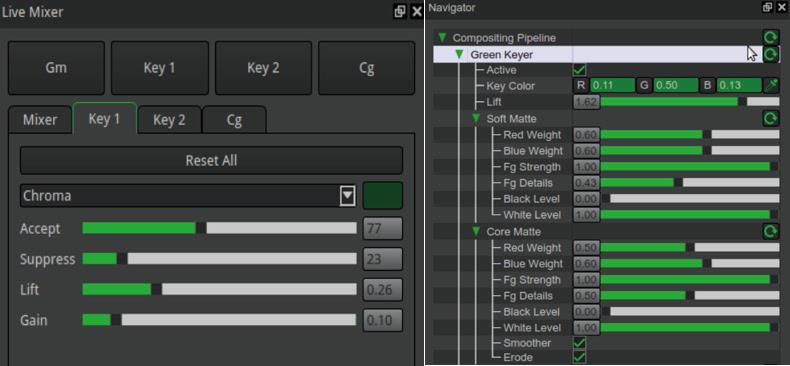

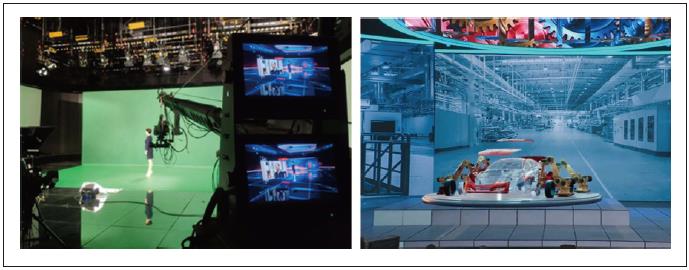

虚拟技术主要分为VR和AR两种。针对VR虚拟演播室节目的应用,Ncam服务器提供了色键功能(见图3),通过在软件中对背景色的抠像,将色键信息和跟踪数据通过网络传输到UE4中,在UE系统中完成节目的渲染合成及输出。另一类是在节目中通过虚拟植入展现AR的效果,该方式应用普遍,无论是数据、动画人物、模型、场景等都可以将虚拟的物体叠加在真实画面之上(见图4)。

图3 Ncam Reality的色键功能

图4 VR和AR效果

针对VR、AR虚拟演播室节目的制作,可以利用Ncam图像识别跟踪系统与UE4系统提供的灵活、便捷的功能进行。

4.2.1 RealDeepth

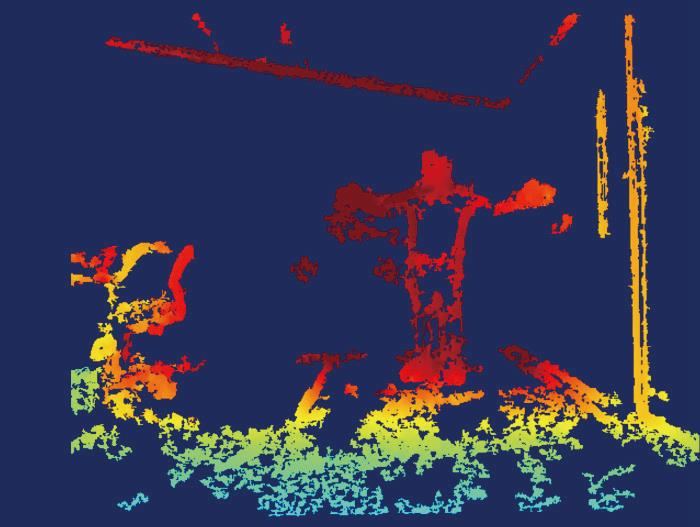

RealDeepth是Ncam图像识别跟踪系统所识别到的深度数据。

在AR虚拟制作中,传统的跟踪系统只能传递二维跟踪数据到虚拟服务器,这使得虚拟物体永远只会出现在真实场景之上,一旦人物或者镜头的大幅移动,很容易出现穿帮或者不协调的画面。Ncam图像识别跟踪系统采用双鱼眼镜头的方式,一方面可提升跟踪的准确性及安全性,另一方面可以用来进行空间感知及定位,捕捉三维空间中的位置关系,如图5所示。所以,通过Ncam双鱼眼镜头的拍摄,不仅可以得到虚拟物体在真实空间中的水平和垂直的位置,同样的虚拟物体与实景的纵深关系也能够得以体现,使AR用户能够更好地与虚拟环境互动。

图5 颜色越浅离摄像机越近

通过RealDeepth这一功能,可以在节目中制作出更为真实的AR虚拟效果,如在对虚拟物体进行讲解时,无需让主持人总是处在物体的两侧,可以处在虚拟物体360°的任何一个位置,如图6所示。在另一些AR场景布置的应用中,放置道具、大屏,不用考虑穿帮问题,可以随意在其前方或后方移动。

图6 更为真实的AR虚拟效果

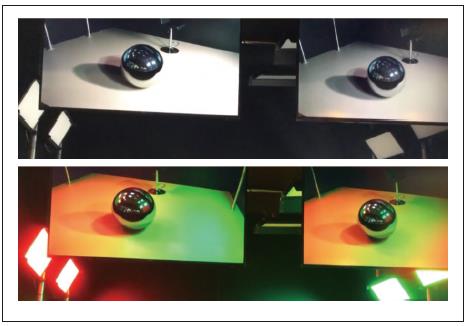

4.2.2 Real Light的效果展现

在AR中,为了帮助数字对象使用时更好地融入现实世界,Real Light功能可捕捉有关真实世界的照明信息,如方向、颜色和强度,并将其实时渲染到AR场景中,动态适应照明条件的变化,如图7所示。在一些综艺或者室外节目,可以使用Real Light功能,让虚拟物体随着真实环境的灯光变化而产生不一样的颜色反射以及倒影的位置、强度,真正地融入真实的环境中。

图7 Real Light 的效果展现

4.2.3 UE4的材质功能与VR拍摄、5G传输的结合运用

利用UE4的材质及兼容VR的功能,可尝试一种新的360°VR背景+真实摄像机拍摄画面相结合的节目方式,这种方式类似于VR演播室节目制作的模式,将传统的3D场景模型替换成360°视频或360°实时画面。该方式使节目制作不局限于场地的限制,例如历史建筑的访谈或介绍,制作团队可以不用在历史建筑内部制作完成,也不是单纯地在大屏上播放视频,前期录制中,可以通过360°VR将现场场景拍摄回来或通过360°VR直播传送回制作中心,同时,对在演播室录制主持人的讲解,并将演播室背景抠除;后期制作时,把现场的360°视频导入作为UE4整个球形材质,即作为节目现场背景素材,并将无背景的主持人素材置身其中,产生主持人身处现场的效果。这种 UE4材质配合Ncam 360°VR视频的跟踪方式,可以搭配斯坦尼康或者轨道机器人实现全景VR虚拟效果。

5 典型应用

将现场跟踪数据、360°4K/8K VR拍摄、5G实时传输、虚拟叠加、渲染输出等技术融合运用进行节目制作,产生不同的节目形态。UE4是一个开放性的平台,有着良好的扩展性和兼容性,很多外设厂商开发了相应的接口,如动作捕捉系统,在节目中通过跟踪+虚拟+动捕+面捕结合的技术手段,实现真人虚拟化或者虚拟偶像IP的创建,此类应用可带来多种意想不到的节目展现,包括虚拟主持人、虚拟歌手、虚拟演员等。

对于电视直播节目制作要求的实时性,即使录播节目也需要在现场能看见虚拟效果,这种“所见即所得”的生成流程不仅有助于把控现场的节目效果,同时也为节目制作提供了便利。

(1)《绿水青山看中国》的实时渲染

《绿水青山看中国》在大型演播厅内进行录制,如果单纯以主持人讲述+视频片段的方式呈现,视觉画面在大型舞台场景中会显得比较空洞,画面感不够强烈;但如果为营造画面的冲击而全部采用舞台搭建及灯光、大屏效果,对于录播类节目而言制作成本太高。为了突出栏目所展示的山、水、生态自然,以虚拟和实景相结合的AR方式加以呈现。

为了逼真地展现出节目所要呈现的青山绿水的效果,需要在2 500㎡的演播室中呈现大量的虚拟山水物等视觉效果,并且效果还原逼真、灵动,风吹草动、波纹荡漾、光影流逝的效果都应该被考虑其中。UE4的实时计算+预渲染的特性,能够很好的满足大型虚拟场景、丰富细节的展示,图8为《绿水青山看中国》采用UE4制作所呈现出的虚拟效果。

图8 《绿水青山看中国》的虚拟效果

(2)《经典咏流传》节目中动捕、面捕技术的结合

在《经典咏流传》节目中,呈现出了撒贝宁和虚拟人“赛小撒”的同台主持(见图9)。前期制作中,通过3D模型扫描采集撒贝宁的3D模型数据,并导入虚拟演播室系统ZeroDensity(UE4)中,呈现虚拟的“赛小撒”;后期制作中,结合跟踪数据、动捕数据、面捕数据、AI撒贝宁语音包,最终舞台中渲染输出1:1的“赛小撒”。

图9 《经典咏流传》的虚拟效果

(3)2020春晚创新启动仪式中5G+VR技术的结合

在中央广播电视总台2020春晚5G+8K/4K/VR创新应用启动仪式上,将港珠澳大桥拍摄的VR直播信号通过5G传送回启动仪式现场,并与抠除蓝箱后的主持人画面相叠加,虚拟出主持人在港珠澳大桥现场的虚拟效果,如图10所示。

图10 2020春晚创新启动仪式中的虚拟效果

6 Ncam图像识别跟踪结合UE4系统的应用优势

UE4软件系统是一个功能强大且开源的平台,配合Ncam图像识别系统的灵活性,在包括电视制作的多个行业的应用中,具有其显著的优势。

(1)灵活性

新的Ncam CameraBar拥有更小的体积(见图11)、更轻的重量及更稳定的工艺化设计,可以应用于更多的节目制作的拍摄,尤其是与飞猫、斯坦尼康的配合应用。

图11 拥有更小体积的Ncam CameraBar

(2)拓展性

Ncam图像识别系统的UE4插件提供了外部色键器的接口,在VR节目制作中,便于采用第三方硬件色键器提供更高质量的抠像效果。另外,对于单个虚拟场景多个视角镜头的节目制作,UE4提供了协同工作的编辑模式,轻松实现多机位的交互功能。

(3)创新便捷性

UE4是一个开放的且具备内容商城的平台,可以在平台上获取好的创意,也可以通过商城分享作品,还可以将平台提供的流行人物、物品、元素模型直接应用在节目工程文件中,无需重复搭建或者转换,这大大减少了制作人员的重复劳动,缩短了节目的制作周期,同时也有助于从分享的作品中获取节目的灵感。

(4)虚拟真实性

虚拟效果的最终目的是为了消除违和感,达到真实的效果,因此,需要模拟真实环境中的所有细节,这些细节有熟知的光照效果、物体的阴影、反射倒影、碰撞、遮挡等,更深一层次的动作流畅性、光照随时间的变化、各虚实物体间的反射等。Ncam图像识别系统的数据结合UE4系统,可大大提升虚拟节目制作的细节化和操作性;同时,UE4系统本身提供了这些细节的可调整性,同时蕴含内在的逻辑关系,可自动处理物体间的阴影、反射等部分特性。

7 结束语

UE4系统优异的渲染能力、灵活的蓝图系统、完善的插件库、开放性的在线模型库和庞大的用户基础为电视节目的创造性制作提供了可持续的专业化技术支撑。Ncam图像识别跟踪系统具有创新的跟踪数据特性以及应用的灵活性,与UE4结合给节目的虚拟值入带来了新的思路,结合新的想法和技术,例如AI技术、VR/MR等,可制作更多具备观赏性和竞争性的广播电视节目。

受制于硬件平台的制作能力,目前UE4对于制作360°4K的画质并不能获得高质量的画面水准,但是随着硬件能力的飞速提升,相信在未来4K、8K的制作中能够呈现更加清晰的画面,可应用于影视、广播电视等领域的节目制作中。

选自《演艺科技》2020年第6期 谭 阳《Ncam图像识别跟踪系统结合UE4在节目制作中的应用》,转载请标注:演艺科技传媒。更多详细内容请参阅《演艺科技》。

(本文仅用于行业交流学习,并不用于商业用途。文中观点为作者独立观点。如不慎侵涉第三方权益,请与我们联络,我们将第一时间删除处理。)

相关阅读

征稿启事

投稿范围

《演艺科技》杂志的主要栏目包括:灯光技术、音响技术、演出场馆建设、视频技术、乐器、舞台美术、演播室建设,以及海外掠影、热点追踪等行业。

灯光技术、音响技术、视频技术:介绍演艺领域中灯光、音响、视频的基础知识和前瞻技术,特别是技术的融合运用和发展,相关国家、行业的标准、规范;探讨专业发展的新动向、新理念及行业热点问题;分析各类工程案例的系统设计、技术要点、设备应用、安装施工及经验。

演出场馆建设:介绍专业演出场所的建筑声学设计,场馆设施及设备的设计,施工和验收标准及流程,灯光、舞台机械、音频等系统维护及运营管理,相关国家、行业的标准、规范;探讨演艺场馆建设模式、技术方案、运维中的问题;分析国内外经典演出场馆案例的建设方案与使用经验。

乐器:介绍乐器的结构、发声原理,展示新研发乐器的设计原理及特色,以及器乐表演的新科技与新技巧,电声乐器的选择与使用;探讨中西乐器、电声乐器的发展、改革方向和技术进展;分析乐器制造和改良的发展趋势、新思路。

舞台美术:介绍如何通过技术手段的运用与合理、巧妙地进行艺术创作,内容涉及艺术创作的理念,以及舞台灯光、音响、舞台装置、服装、化妆、道具的运用设计、呈现方式、实现技巧、艺术效果,特别是多媒体技术在演出中的应用;探讨科技革新给舞美设计、舞台表现艺术理念带来的影响,以及艺术创新对科技发展的推动;分析、赏析国内外优秀剧目和演出实例。

演播室建设:介绍广播电影电视领域的科技应用,内容涉及演播室、制作机房的建设和系统设计,以及节目制作的音视频、灯光、视觉效果等方面,探讨行业发展趋势,分析设计思想和制作技术,解读工程案例和节目制作经验。

投稿须知

1.文责自负,勿一稿多投,并在投稿时予以声明。

2. 投稿格式要求

文章请按论文格式撰写,并将中英文的文题、摘要、关键词,参考文献等论文要素写完整。字数在2500~5000字为宜。

翻译、编译稿件,请提供原文,并注明原文出处,及文题、作者。

文中引用的图、表,要给出图(表)序、图(表)题;图(表)中的文字要清晰,并用中文标注。图片分辨率要求为300;绘图请使用深色线条(杂志排版以白色为底色)。

参考文献著录规则请参照GB/T 7714-2005《文后参考文献著录规则》。

4. 审稿周期约为一个月,如有特别要求请在投稿时说明。

5. 凡本刊录用之文章,如作者无电子版、网络版等版权特殊声明,即视为该文章署名作者同意将该文章的信息网络传播权与发行权授予本社,本社有权授权本社合作数据库和媒体使用。同时,本社支付的稿酬及相关约定已包含上述使用的费用。

联系方式

投稿邮箱:cetamag@163.com

010-64097408

010-64012244转806

010-64037167转208

010-64012244转806

以上是关于Ncam图像识别跟踪系统结合UE4在节目制作中的应用的主要内容,如果未能解决你的问题,请参考以下文章

达观RPA | 图像识别结合人机交互,解决财务自动化场景中准确率难题

目标跟踪基于matlab帧差法结合卡尔曼滤波行人姿态识别含Matlab源码 1127期