一篇文章教会你利用Python网络爬虫获取分类图片

Posted Python程序员

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了一篇文章教会你利用Python网络爬虫获取分类图片相关的知识,希望对你有一定的参考价值。

【一、项目背景】

博海拾贝是一支互联网从业者在线教育的团队,扎根于中国教育行业以及互联网行业的创新和眼球中,打造专业体系化的互联网人在线教育平台。精心创作许多精彩的文章,提供了很多有趣的图片。

今天来教大家如何使用Python来爬取博海拾贝的图片,分类保存,写入文档。

【二、项目目标】

创建一个文件夹, 分类保存所有文章图片。下载成功,结果显示控制台。

【三、项目分析】

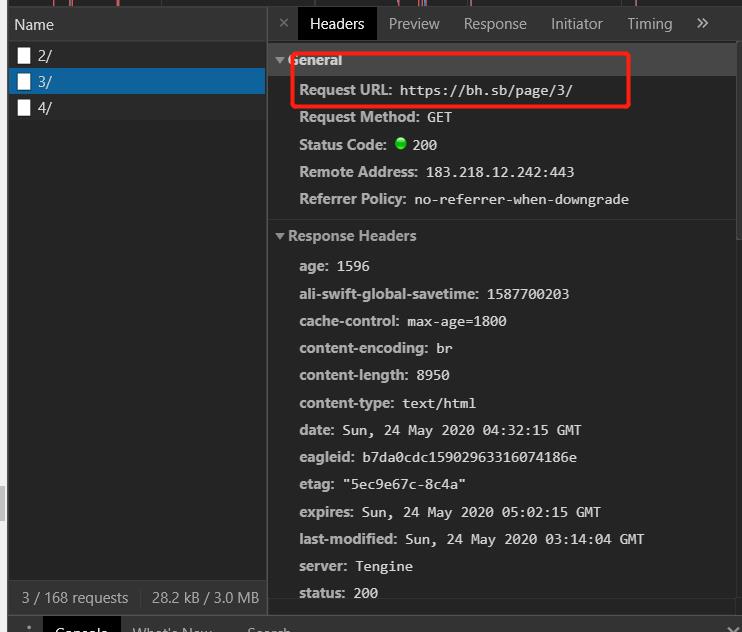

滑动鼠标,观察网站,右键F12 。鼠标滚轮滑动加载新内容。如图:

点开随机网页 , 点开Request URL ,观察网址的规律。

https://bh.sb/page/1/https://bh.sb/page/2/https://bh.sb/page/3/https://bh.sb/page/4/

观察到,每增加一页page/{}/自增加1,用{}代替变换的变量,再用for循环遍历这网址,实现多个网址请求。

2. 反爬处理

1)获取正常的 http请求头,并在requests请求时,设置这些常规的http请求头。

2)使用 fake_useragent ,产生随机的UserAgent进行访问。

【四、涉及的库和网站】

1、网址如下:

https://www.doutula.com/photo/list/?page={}2、涉及的库:requests、lxml、fake_useragent、time、os

3、软件:PyCharm

【五、项目实施】

1、我们定义一个class类继承object,然后定义init方法继承self,再定义一个主函数main继承self。导入需要的库和网址,创建保存文件夹。

import requests, osfrom lxml import etreefrom fake_useragent import UserAgentimport timeclass bnotiank(object):def __init__(self):os.mkdir("图片") # 在创建文件夹 记住只有第一次运行加上,如果多次运行请注释掉本行。def main(self):passif __name__ == '__main__':Siper=bnotiank()Siper.main()

2、随机UserAgent ,构造请求头,防止反爬。

ua = UserAgent(verify_ssl=False)for i in range(1, 50):self.headers = {'User-Agent': ua.random}

3、发送请求 ,获取响应,页面回调,方便下次请求。

'''发送请求 获取响应'''def get_page(self, url):res = requests.get(url=url, headers=self.headers)html = res.content.decode("utf-8")return html

def parse_page(self, html):parse_html = etree.HTML(html)image_src_list = parse_html.xpath('//p/a/@href')# print(image_src_list)

5、对二级页面发生请求,xpath解析数据,获取大图片链接。

reo = parse_html1.xpath('//div//div[@class="content"]') #父结点for j in reo:d = j.xpath('.//article[@class="article-content"]//p/img/@src')[0]text = parse_html1.xpath('//h1[@class ="article-title"] //a/text()')[0].strip()

html2 = requests.get(url=d, headers=self.headers).contentdirname = "./d/" + text + ".jpg" #定义图命名with open(dirname, 'wb') as f:f.write(html2)print("%s 【下载成功!!!!】" % text)

7、调用方法,实现功能。

url = self.url.format(page)print(url)html = self.get_page(url)self.parse_page(html)

8、设置延时。(防止ip被封)。

time.sleep(1) """时间延时"""

【六、效果展示】

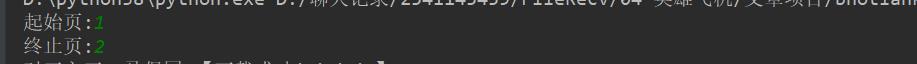

1、点击绿色小三角运行输入起始页,终止页。

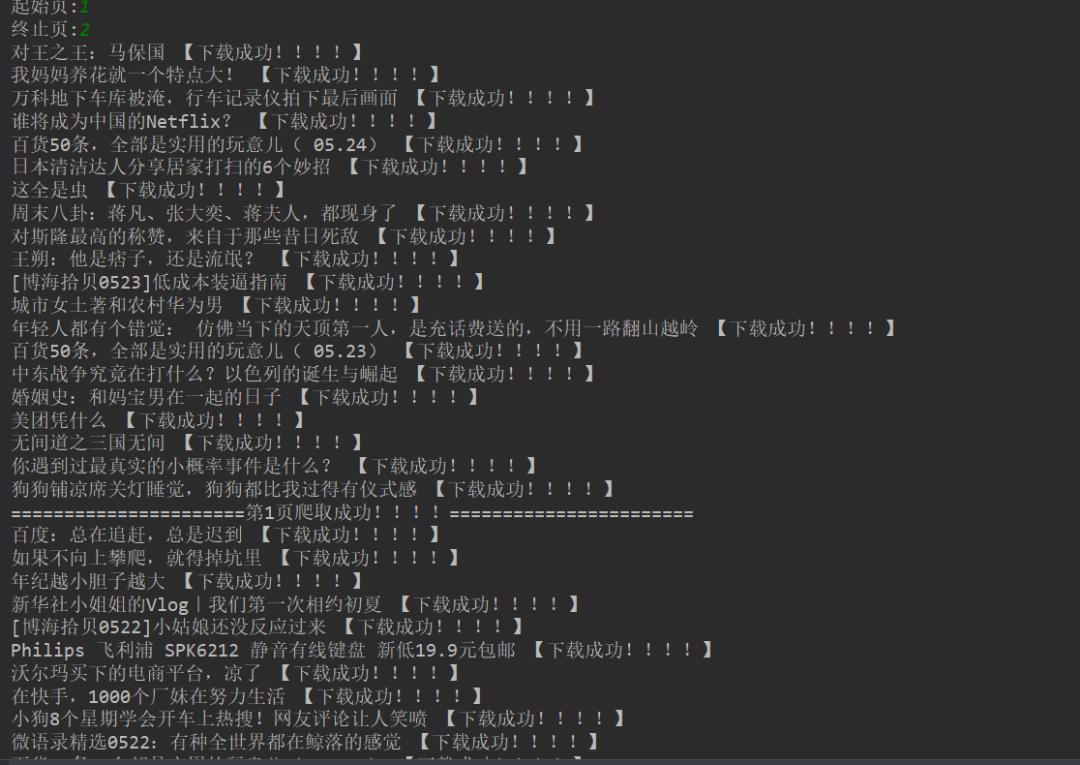

2、将下载成功信息显示在控制台。

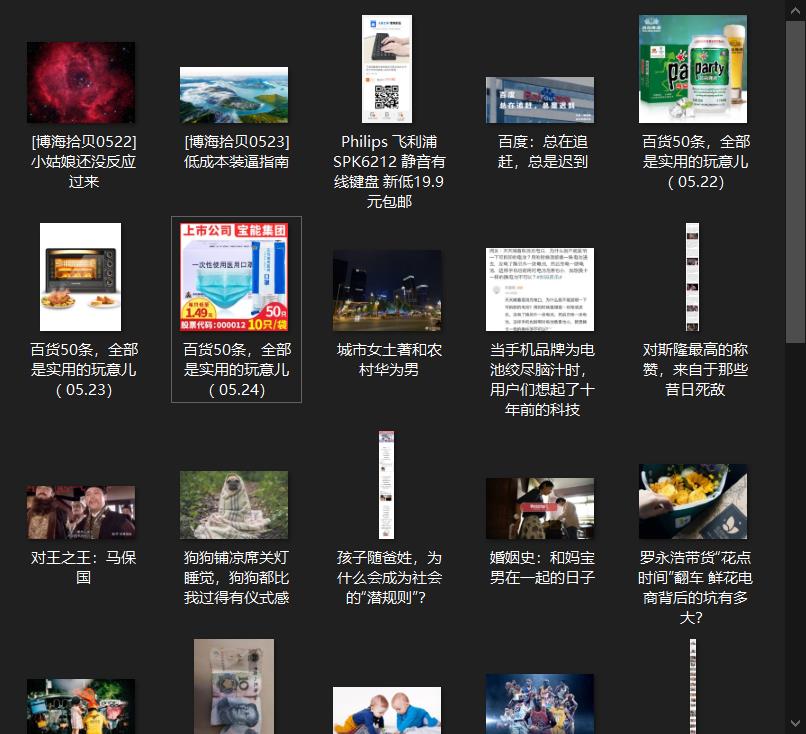

3、text 作为图片命名,展示效果如下所示。

【七、总结】

1、不建议抓取太多数据,容易对服务器造成负载,浅尝辄止即可。

2、本文基于Python网络爬虫,讲述了反爬技巧,利用爬虫库,实现了分类图片的获取,存入文档。

3、希望通过这个项目,能够帮助了解xpath,字符串是如何拼接,format函数如何运用。

4、实现的时候,总会有各种各样的问题,切勿眼高手低,勤动手,才可以理解的更加深刻。

Python学习交流群

为了让大家更加即时地沟通学习,我们建了一个Python学习交流群,有想入群的同学,可以添加下面小助手微信,他会拉大家入群哈~

以上是关于一篇文章教会你利用Python网络爬虫获取分类图片的主要内容,如果未能解决你的问题,请参考以下文章

一篇文章教会你利用Python网络爬虫获取Mikan动漫资源

一篇文章教会你理解Scrapy网络爬虫框架的工作原理和数据采集过程

一篇文章教会你理解和定义Scrapy爬虫框架中items.py文件