神经网络与光学

Posted 物无非彼

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了神经网络与光学相关的知识,希望对你有一定的参考价值。

01

最近一直在思考神经网络的层级设计,偶然间看到博客中的一篇文章,深有感触。

文章的题目为《Lessons from Optics, The Other Deep Learning》,作者Ali Rahimi是MIT的博士,曾就职于Intel和Amazon。

文中作者结合自身在光学领域研究的经历,用神经网络与光学透镜进行了对比。

02

以设计图片识别系统为例,在卷积神经网络中,图片经过网络中一个又一个layer的特征提取后,我们得到了图片的抽象表达。

有时我们在网络中加入一个层级或修改一个参数,图片识别的效果就能提升一点,但这些现象却很难用通俗的语言解释其原因。

于是乎,神经网络的设计过程就被人们戏称为“炼丹”。

很多时候,我们只能通过复现经典神经网络结构,然后反复微调层级和参数,最终得到一个适应于当前数据集的神经网络。

03

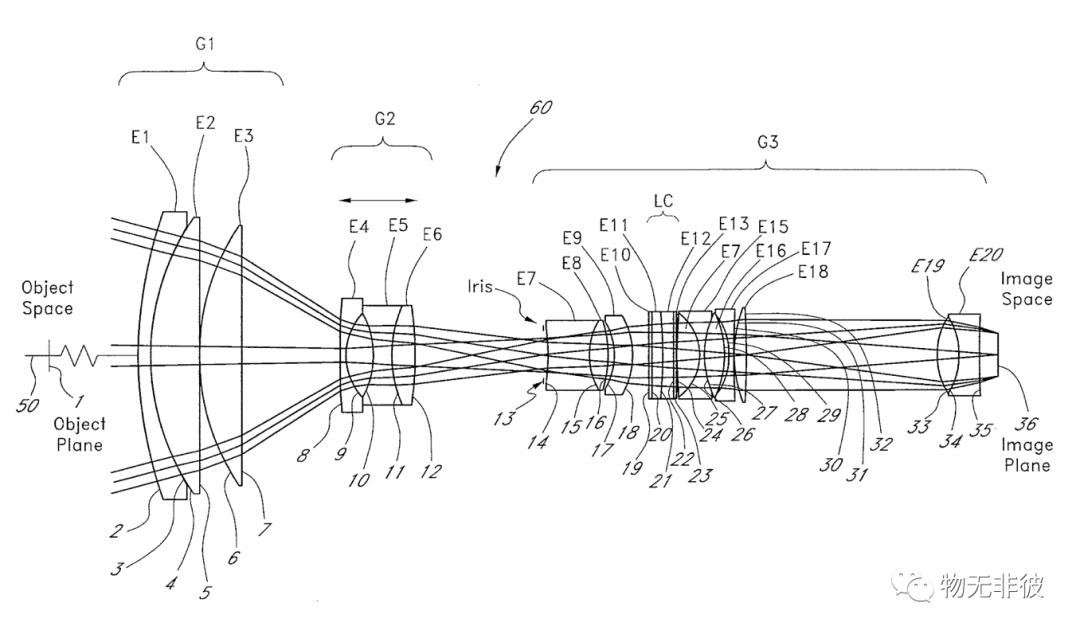

在光学领域中,这样的情况也曾经发生过。例如我们要设计一个相机镜头。

整个流程就要从基本的光学结构开始,这种结构通常以发明者的名字命名。

我们还原并模拟它,以确定它的结果与预期结果的差距,然后插入额外的光学组件来纠正缺点。

然后,我们通过数值优化器运行整个光学系统以调整其参数,如表面的形状、位置和倾斜度等等。

最终我们以最大化某些指标为主要目的,再次模拟系统、修改结构、优化参数。

04

我们会很容易地发现,设计光学系统和神经网络有很多相似之处。

但不同的是,光学工程师在设计时并不会感到迷茫。

这并不是因为光学比神经网络更加简单,而是因为现代光学有着完整的学科结构。

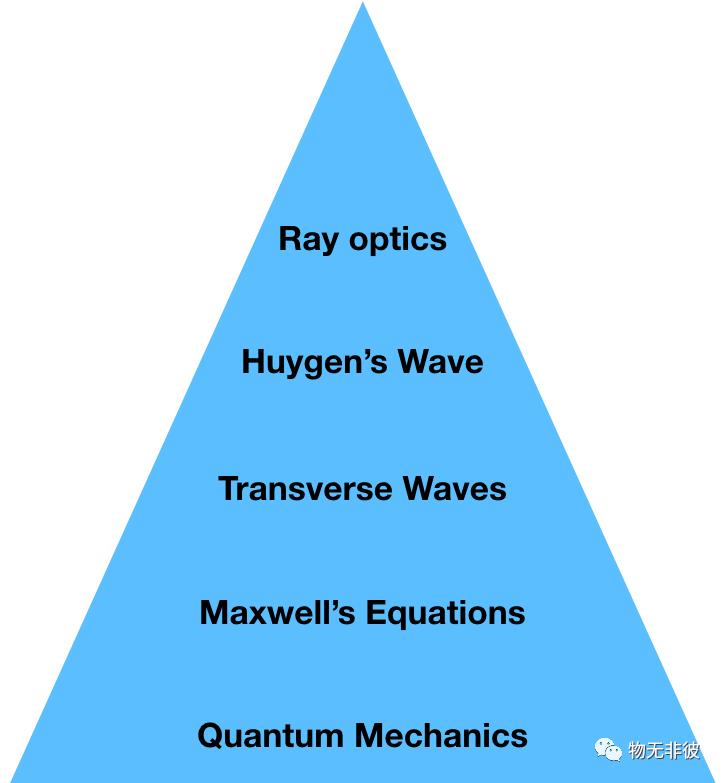

在最简单的一层,在顶部,是射线光学。射线光学是波光学的简化,其中射线代表波光学中波面的正常载体。波光学是麦克斯韦方程的近似解决方案。麦克斯韦的方程可以来自量子物理学。

每一层都来自它下面的层,通过简化假设。因此,每层都可以解释比上面的层更复杂的一组现象。

光学通过将近300年的发展,才实现了底层抽象理论到实际应用的统一。

但直到100年前,光学中还有一些理论相互矛盾,光学工程师需要依靠经验才能完成镜头的设计。

06

直至今天,已经有很多学者对神经网络层级的作用做了研究。

但仍然存在一些问题:

首先,对于层级中产生的现象,我们很难达成统一的意见。

其次,我们很难构建出有解释性的、有层级关系的神经网络学科体系。

最后,在现有论文中被提出的理论仍然被其他人所质疑。

07

最后是作者的计划:先收集一些大多数人都达成共识的现象,通过实验验证并解释这些现象。

这些被证实的部分就像牛顿环、克尔效应、法拉第效应一样,作为学科基础,作者与他的团队将继续完善理论体系。

对于普通开发者而言,我们可能在未来一段时间内,都只能基于经典结构和优化经验设计神经网络。

其中优化经验只能通过实践积累,并且积累的数量和质量受到时间的限制,即个体可支配时间是有限的。

个人认为,元学习(Meta-Learning,一种让机器学会如何学习的方法)的出现,能够进一步减少设计神经网络时对于开发人员经验的依赖,或许是日后提升神经网络设计质量的方向。

以上是关于神经网络与光学的主要内容,如果未能解决你的问题,请参考以下文章