卷积相关:Depthwise Separable Convolution

Posted 梆子井欢喜坨

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了卷积相关:Depthwise Separable Convolution相关的知识,希望对你有一定的参考价值。

主要参考

【1】李宏毅:Network Compression

【2】尹国冰:卷积神经网络中的Separable Convolution

Depthwise Separable Convolution是降低卷积运算参数量的一种典型方法。

包含两步,分别是Depthwise Convolution和Pointwise Convolution

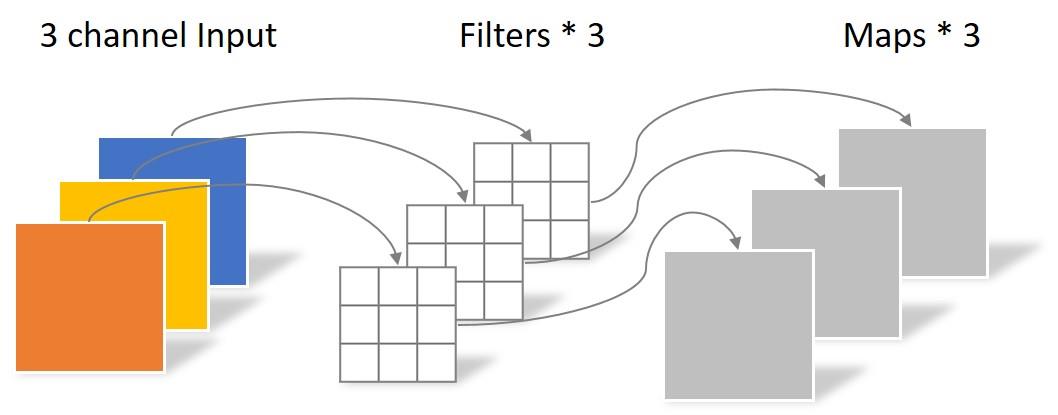

Depthwise Convolution

- filter的数量=输入通道的数量

- 每个filter只处理一个通道

- 和常规卷积相比,其每个卷积核不是立体的

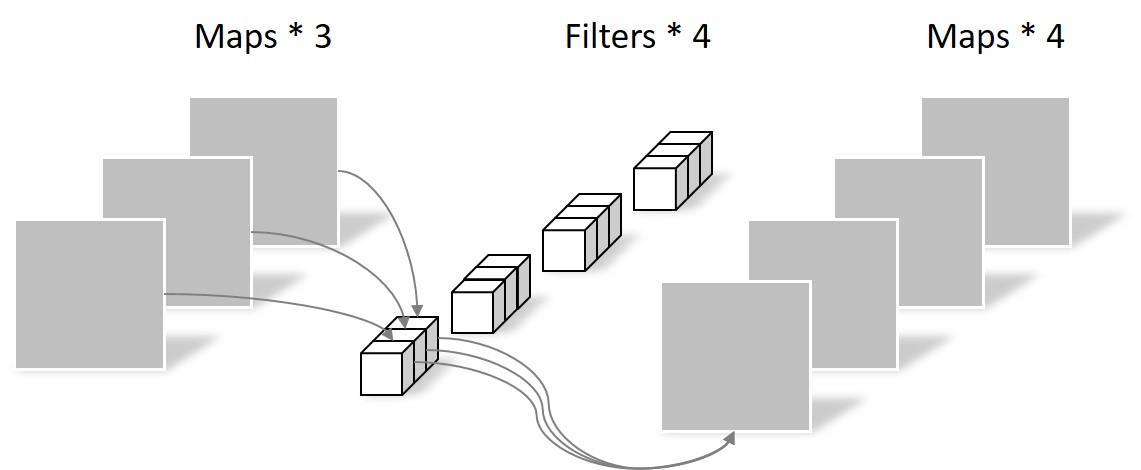

Depthwise Convolution完成后的Feature map数量与输入层的通道数相同,无法扩展Feature map。同时没有有效的利用不同通道在相同空间位置上的feature信息。因此需要做Pointwise Convolution来将这些Feature map进行组合生成新的Feature map。

Pointwise Convolution

- 使用1x1卷积控制维度,这里的卷积运算会将上一步的map在深度方向上进行加权组合,生成新的Feature map

- 卷积核的尺寸为 1×1×M,M为上一层的通道数

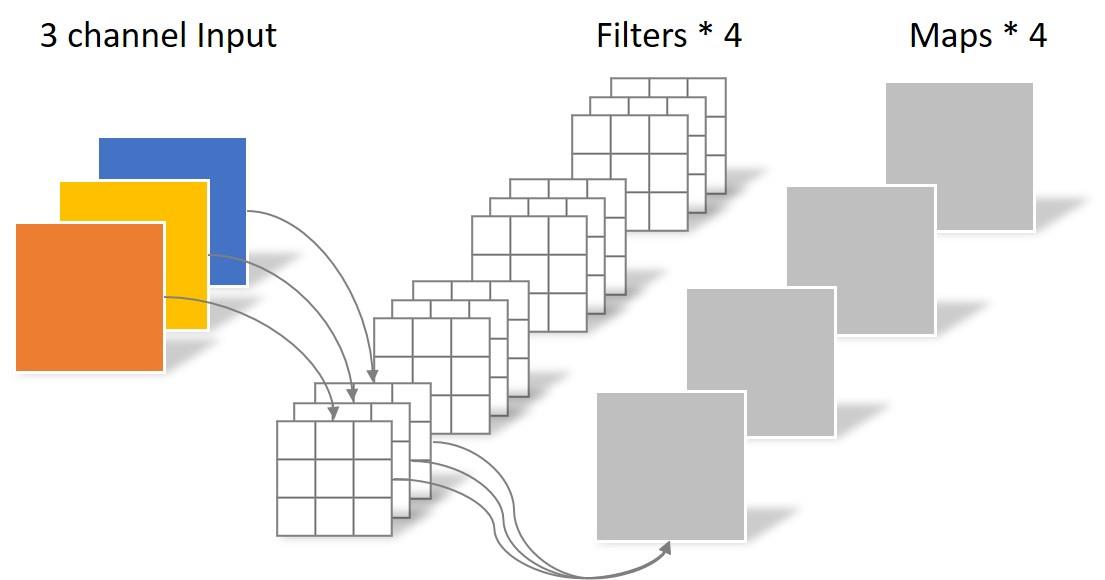

两步总共使用的卷积核参数为3x9+4x3 = 39

和常规卷积对比

同样的输入和输出,常规卷积所需的卷积核参数量为4x3x3x3 = 108

以上是关于卷积相关:Depthwise Separable Convolution的主要内容,如果未能解决你的问题,请参考以下文章