文献阅读01期:LMNN

Posted RaZLeon

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了文献阅读01期:LMNN相关的知识,希望对你有一定的参考价值。

[ 文献阅读 ] 今日好文Outline:20210522 - LMNN

所读文献:Weinberger K Q, 2009, Distance Metric Learning for Large Margin Nearest Neighbor Classification [1]

1.摘要&简介

-

针对KNN算法,将常用的欧式距离替换为马氏距离(Mahanalobis distance),提出新的目标函数,在MNIST数据集上进行测试,并将其命名为LMNN。

-

对比SVM,无需进行特别处理,便可进行多分类学习,且LMNN的训练时间长短和类别数量并无太大关联(SVM的训练时间会随着Classes的增长,呈现出线性增长态势,多种扩展算法亦是如此。)

2.算法模型(Model)

2.1.线性变换

- n个labeled样本,训练集表达: { ( x → i , y i ) } i = 1 n \\{(\\overrightarrow{x}_i,y_i)\\}^n_{i=1} {(xi,yi)}i=1n,其中样本输入为 x i ∈ R d {x}_i\\in\\mathcal{R}^d xi∈Rd,预先标定标签为 y i y_i yi.

- Binary指示器: y i j ∈ { 0 , 1 } y_{ij}\\in\\{0,1\\} yij∈{0,1},用于表示 y i y_i yi与 y j y_j yjmatch与否。

- 目标:学习线性变换:

L

:

R

d

→

R

d

\\mathrm{L}:\\mathcal{R}^d\\rightarrow\\mathcal{R}^d

L:Rd→Rd并用来计算平方距离:

D ( x → i , x → j ) = ∥ L ( x → i − x → j ) ∥ 2 (1) \\mathcal{D}(\\overrightarrow{x}_i,\\overrightarrow{x}_j)={\\left \\| \\mathrm{L}(\\overrightarrow{x}_i-\\overrightarrow{x}_j) \\right \\|}^2\\tag{1} D(xi,xj)=∥∥∥L(xi−xj)∥∥∥2(1)

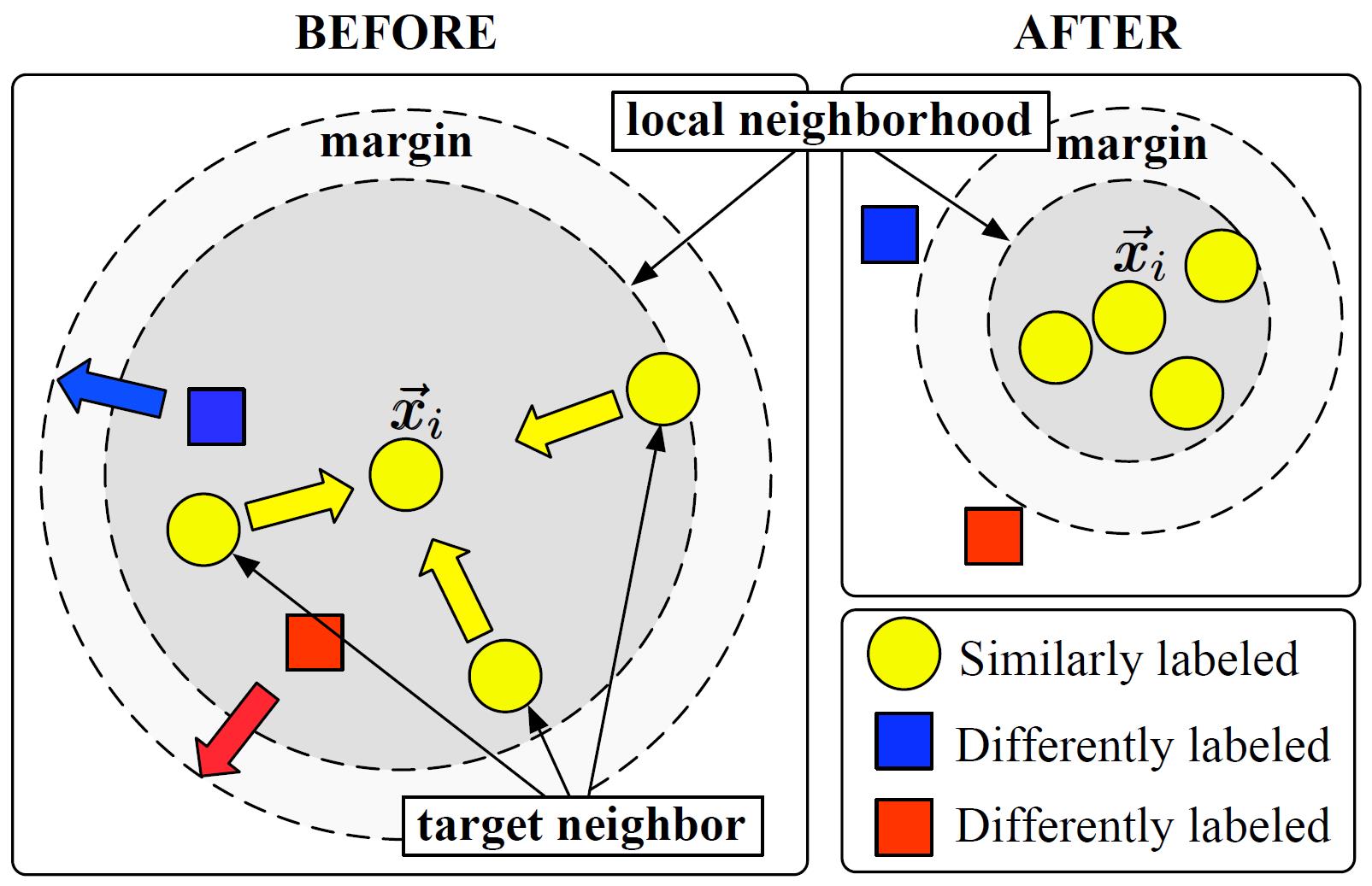

2.2.目标近邻(Target neighbors)

- 目标近邻定义:对于每个输入 x → j \\overrightarrow{x}_j xj我们需要找寻k个有同样标签( y i y_i yi)的目标近邻,并使得式(1)计算出的距离最小化。

- 在缺失先验知识的情况下,我们只能通过欧式距离,在有同样标签( y i y_i yi)的近邻中搜索。

- η i j ∈ { 0 , 1 } \\eta_{i j} \\in\\{0,1\\} ηij∈{0,1}表示 x → j \\overrightarrow{x}_j xj是 x → i \\overrightarrow{x}_i xi的目标近邻。

- 需要注意的是: y i j y_ij yij和 η i j \\eta_{i j} ηij在学习过程中不会改变。

2.3.目标函数

- 本文目标函数分为两种惩罚:惩罚1 - 输入和目标近邻距离惩罚;惩罚2 - 具有不同Label的样本间,若距离过近,也将遭到惩罚,公式如下:

ε ( L ) = ∑ i j η i j ∥ L ( x ⃗ i − x ⃗ j ) ∥ 2 + c ∑ i j l η i j ( 1 − y i l ) [ 1 + ∥ L ( x ⃗ i − x ⃗ j ) ∥ 2 − ∥ L ( x ⃗ i − x ⃗ l ) ∥ 2 ] + (2) \\varepsilon(\\mathbf{L})=\\sum_{i j} \\eta_{i j}\\left\\|\\mathbf{L}\\left(\\vec{x}_{i}-\\vec{x}_{j}\\right)\\right\\|^{2}+c \\sum_{i j l} \\eta_{i j}\\left(1-y_{i l}\\right)\\left[1+\\left\\|\\mathbf{L}\\left(\\vec{x}_{i}-\\vec{x}_{j}\\right)\\right\\|^{2}-\\left\\|\\mathbf{L}\\left(\\vec{x}_{i}-\\vec{x}_{l}\\right)\\right\\|^{2}\\right]_{+}\\tag{2} ε(L)=ij∑ηij∥L(xi−xj)∥2+cijl∑ηij(1−yil)[1+∥L(xi−xj)∥2−∥L(xi−xl)∥2]+(以上是关于文献阅读01期:LMNN的主要内容,如果未能解决你的问题,请参考以下文章