WindowsServer2019安装Nvidia驱动+CUDA+CUDNN等深度学习环境

Posted MarToony|名角

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了WindowsServer2019安装Nvidia驱动+CUDA+CUDNN等深度学习环境相关的知识,希望对你有一定的参考价值。

内容概要:

1 windowsServer中与windows10对于驱动等软件的安装过程一致;

2 windowsserver因为其本身的较强的安全策略影响,如果要在服务器上安装软件,需要在服务器管理器中禁用相关的安全策略。如此从IE等浏览器中可以下载软件,比如谷歌浏览器的下载等。

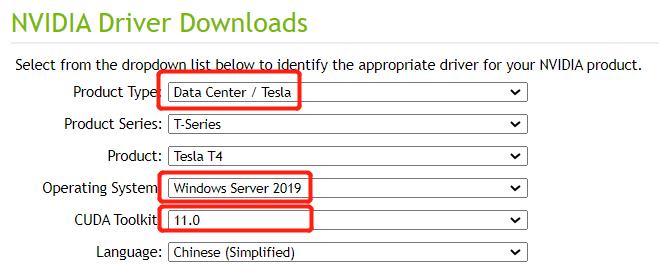

3 一个可行的软件配置组合:- Tesla T4 - windows Server 2019 - CUDA 11.0,主要参考与tensorflow的版本匹配而确定的。- Cudnn 8.05- VS 2017 pro- Anaconda个人版- pycharm社区版

一 服务器安全策略的禁用

windowsserver因为其本身的较强的安全策略影响,如果要在服务器上安装软件,需要在服务器管理器中禁用相关的安全策略。如此从IE等浏览器中可以下载软件,比如谷歌浏览器的下载等。

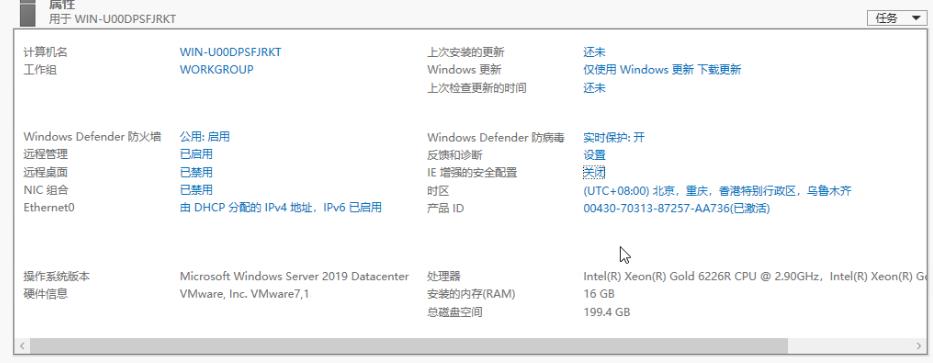

左边的“IE增强的安全配置”点击后出现对话框:

将管理员和用户的选择全部设置为“关闭”即可。

二 Nvidia相关软件的安装(四个软件一个环境变量)

主要参考文献:https://blog.csdn.net/kefnbsow/article/details/102720844

次要参考文献:这里的软件安装与windows10等系统的安装方式一致;同时,关于nvidia等软件的下载网址以及cuda和pytorch、tensorflow的版本匹配问题的讨论,详情参考我的另一篇文章:https://blog.csdn.net/m0_38052500/article/details/116051579

我这里的基本配置信息是:

- Tesla T4

- windows Server 2019

- CUDA 11.0,主要参考与tensorflow的版本匹配而确定的。

- Cudnn 8.05

- VS 2017 pro

- Anaconda个人版

- pycharm社区版

1 Nvidia Driver

- 简介

- 安装方式:双击;在安装驱动过程中,会提示 VS 未安装,可先跳过,VS 安装的具体介绍见下文。

2 Nvidia Cuda

- 简介:

上面已经介绍过了,就是采用cuda11.0; - 安装方式:双击,安装路径一般位置是:C:\\Program Files\\NVIDIA GPU Computing Toolkit\\CUDA\\v11.0

3 Nvidia Cudnn

-

简介

解压cudnn后,将cudnn中得三个文件夹对应地复制到上述的cuda的安装路径下,同时因为cuda原文件中不会存在cudnn中的文件,所以复制过程中不会也不该出现有同名文件的存在;

对应关系比如:

(1)把 cudnn 解压包下的:cuda\\bin 复制到:cuda安装目录\\bin

(2)把 cudnn 解压包下的:cuda\\include 复制到:cuda安装目录\\include

(3)把 cudnn 解压包下的:cuda\\lib\\x64 复制到:cuda安装目录\\lib\\x64 -

配置环境变量

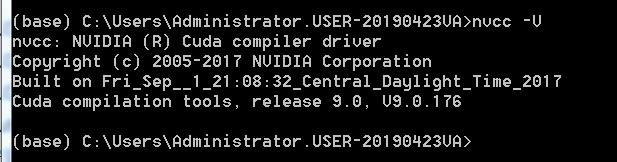

将C:\\Program Files\\NVIDIA GPU Computing Toolkit\\CUDA\\v11.0\\bin,即你安装后的bin路径添加到环境变量,输入nvcc -V检测安装情况,安装成功如下所示 :

4 VisualStudio 2017 pro

- VS2019(目前的最新版本)是否可用不太清楚,之所以说这个是因为最新版本的VS可能与当前的一些编程框架或者软件的版本有匹配冲突问题,具体的,笔者不清。但是VS2017经过笔者测试是没有问题的;重点还是在于尝试,实践出真知!

- VS2017安装的时候,如果只是为了搭建基础的深度学习环境,是不需要额外安装安装界面内罗列出的“工作负载和组件”等内容的。安装完成后,即使下载的是专业版本,也不需要激活便可使用。

三 深度学习编程软件的安装(两个软件三个环境变量)

1 Anaconda

- 选择官网的个人版本下载即可。不需要社区版或者更高版本;

- 配置环境变量,路径大致如下所示:

(1)C:\\Anaconda3

(2)C:\\Anaconda3\\Scripts

(3)C:\\Anaconda3\\Library\\bin

2 Pycharm

- 选择社区版即可满足使用需求;

- 创建项目时,习惯上基于conda创建虚拟环境,而项目基于该虚拟环境;

四 服务器使用感悟

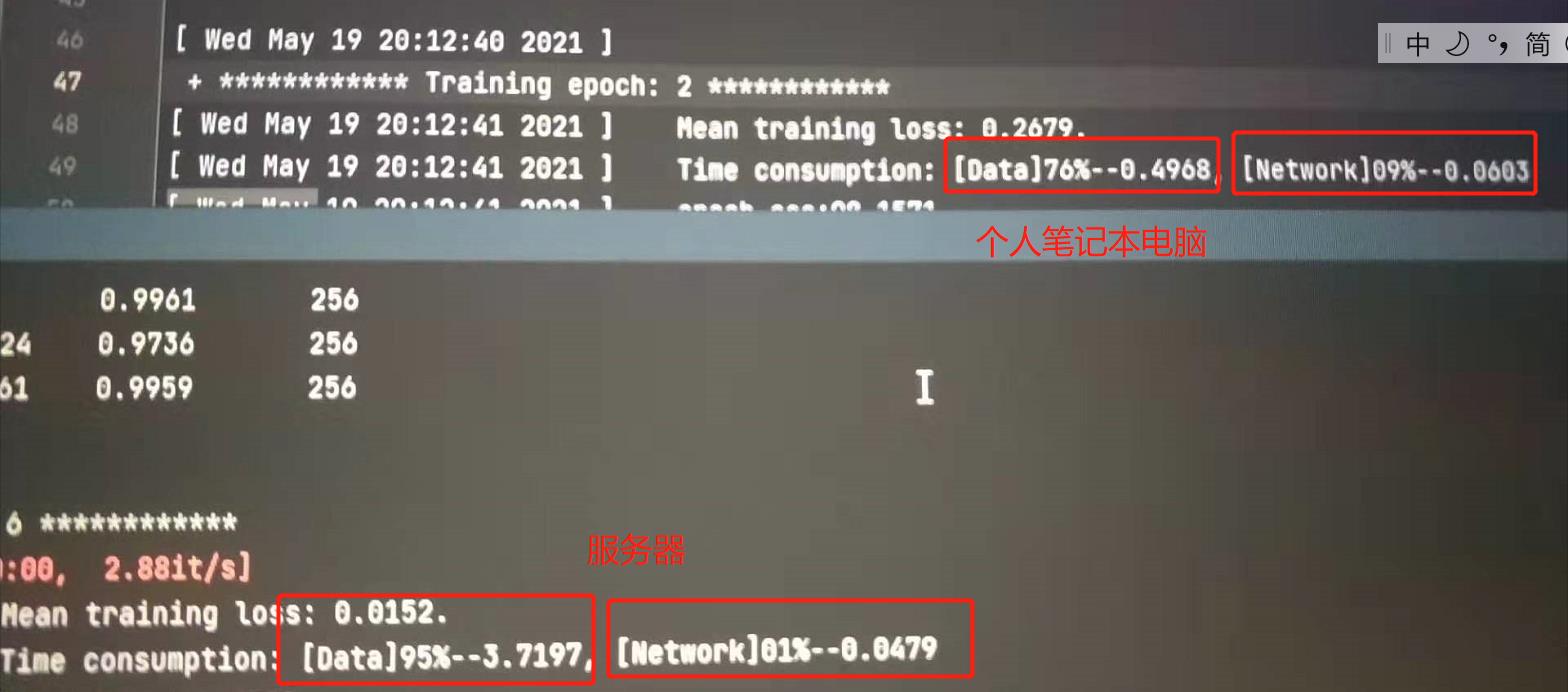

1 发现目前的服务器显卡计算能力强于GTX1650;但是CPU的计算能力弱。具体而言,是通过数据预处理和模型训练两部分的时间来体现的。

个人笔记本电脑的配置是:CPUi7第九代;GPU GTX1650 800多核心数;

服务器配置:CPU 不清楚;GPU :Tesla T4 2560核心数。比RTX2070的2176核心数多一些;

2 服务器学习的意义

- 满足生产需要;

以上是关于WindowsServer2019安装Nvidia驱动+CUDA+CUDNN等深度学习环境的主要内容,如果未能解决你的问题,请参考以下文章