机器学习 Machine Learning- 吴恩达Andrew Ng 第11~15课总结

Posted 架构师易筋

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了机器学习 Machine Learning- 吴恩达Andrew Ng 第11~15课总结相关的知识,希望对你有一定的参考价值。

YouTube课程地址

https://www.youtube.com/playlist?list=PLOXON7BTL9IW7Ggbc09jLqGmzkwPI4-3V

截止2021-5-3, 有112 个视频

1. 第11课 Gradient descent intuition, Linear regression with one variable

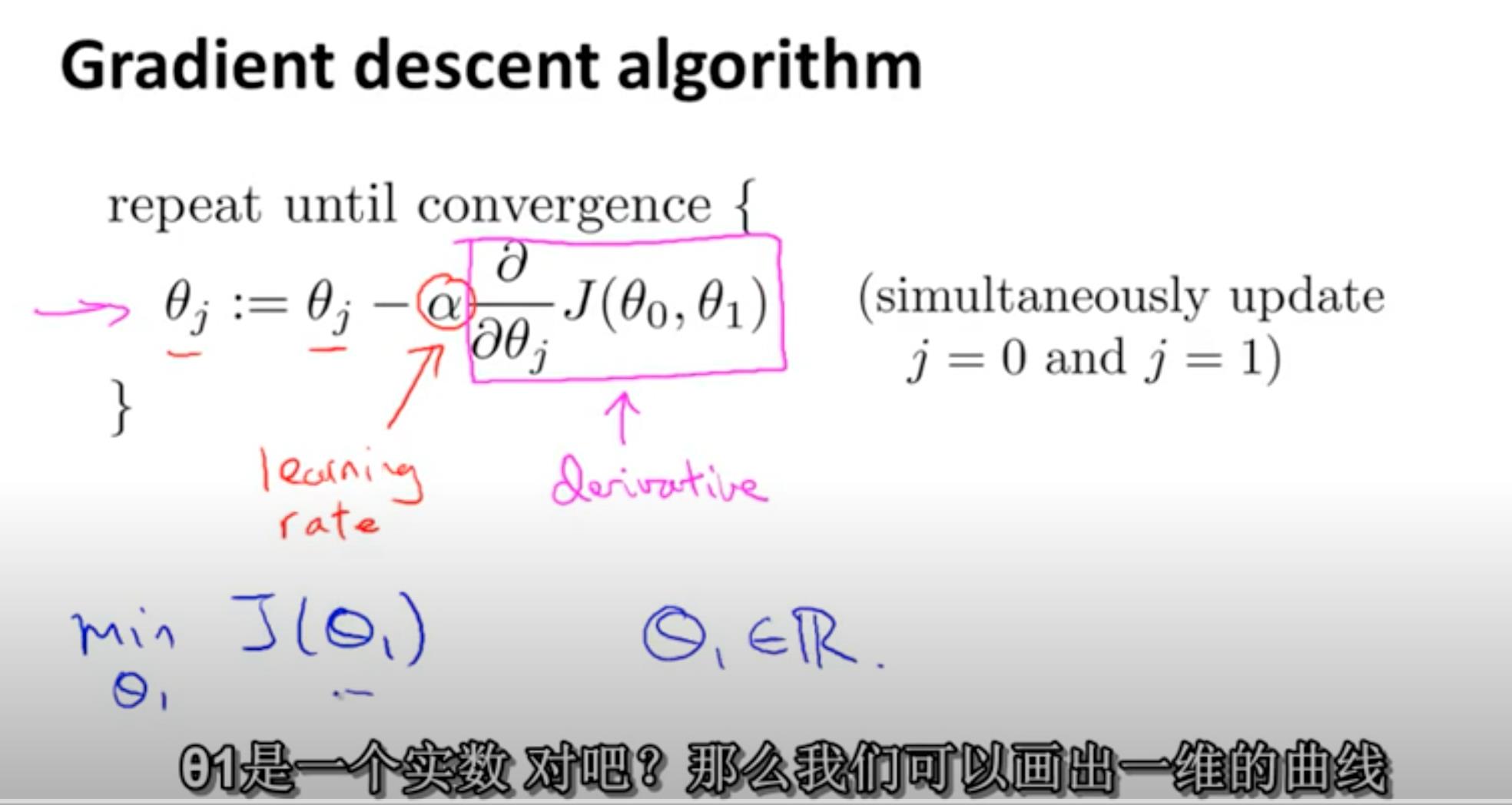

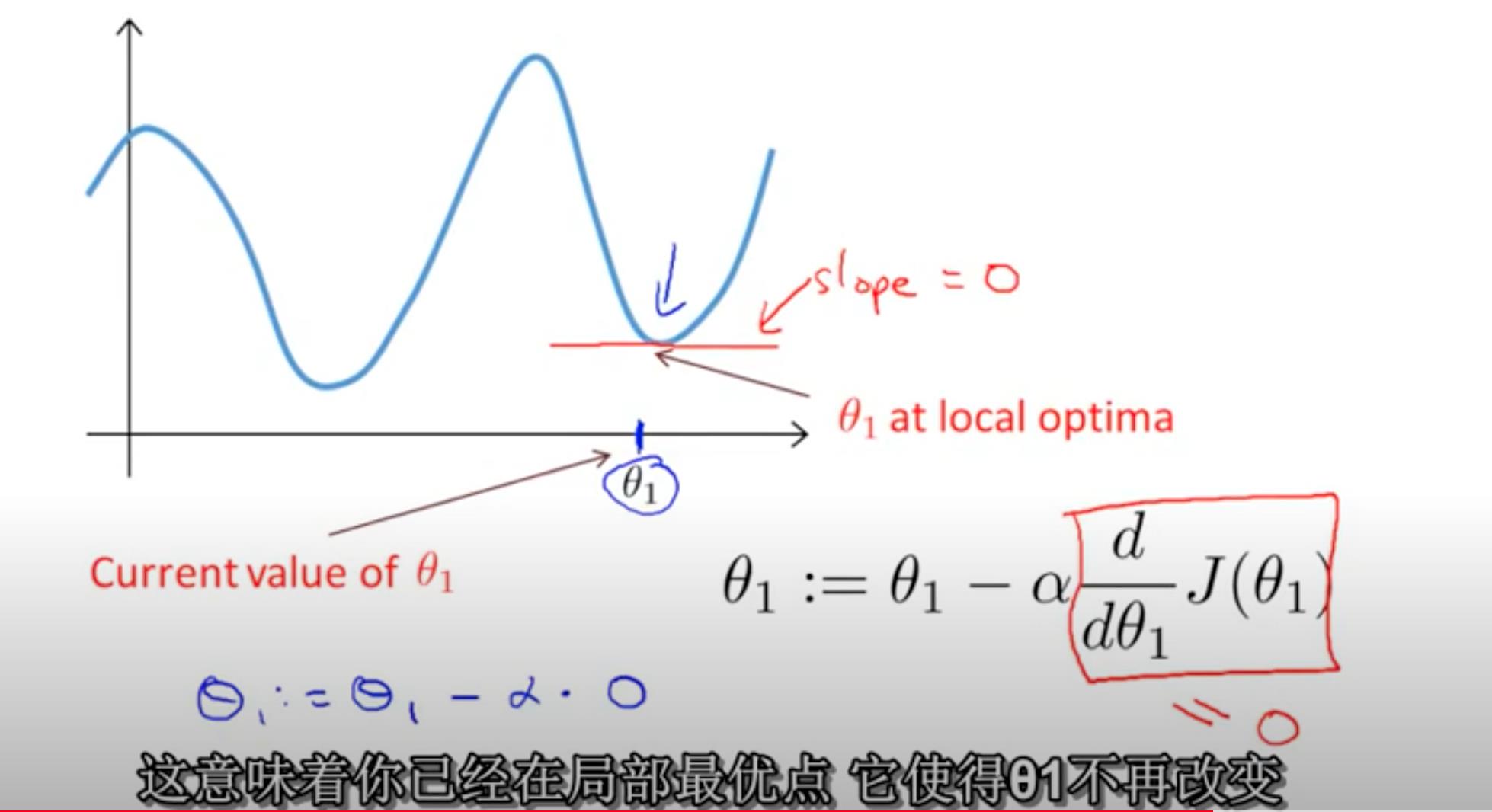

Gradient descent intuition 阶梯下降算法介绍:

- a 表示 learning rate, 学习下降的速度

- 右边的函数 derivative 导数项

导数在微积分中表示斜率: - 当tan为正的时候,相减表示往左边靠近最小值;

- 当tan为负数的时候,相减表示增加,表示往右边靠近最小值;

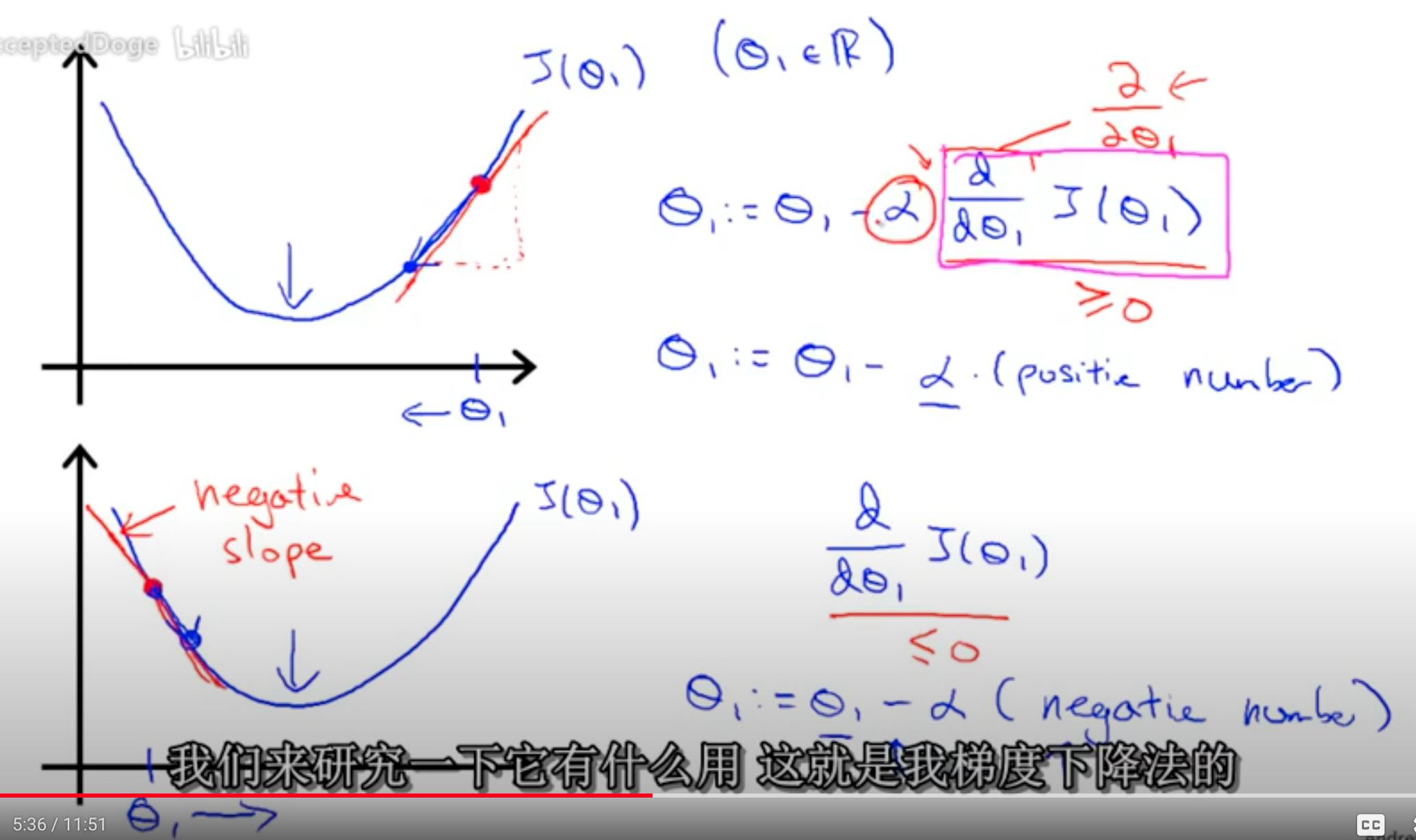

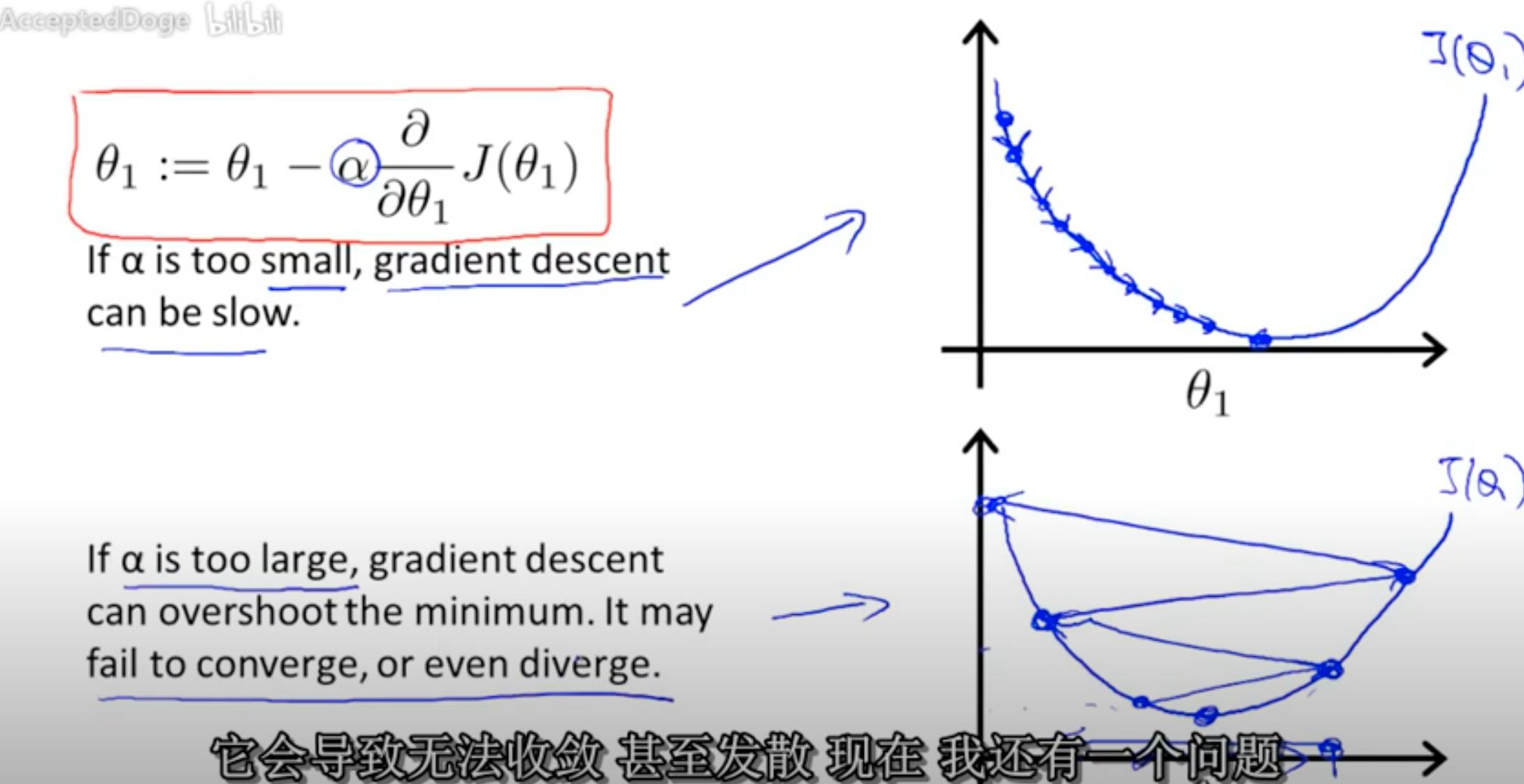

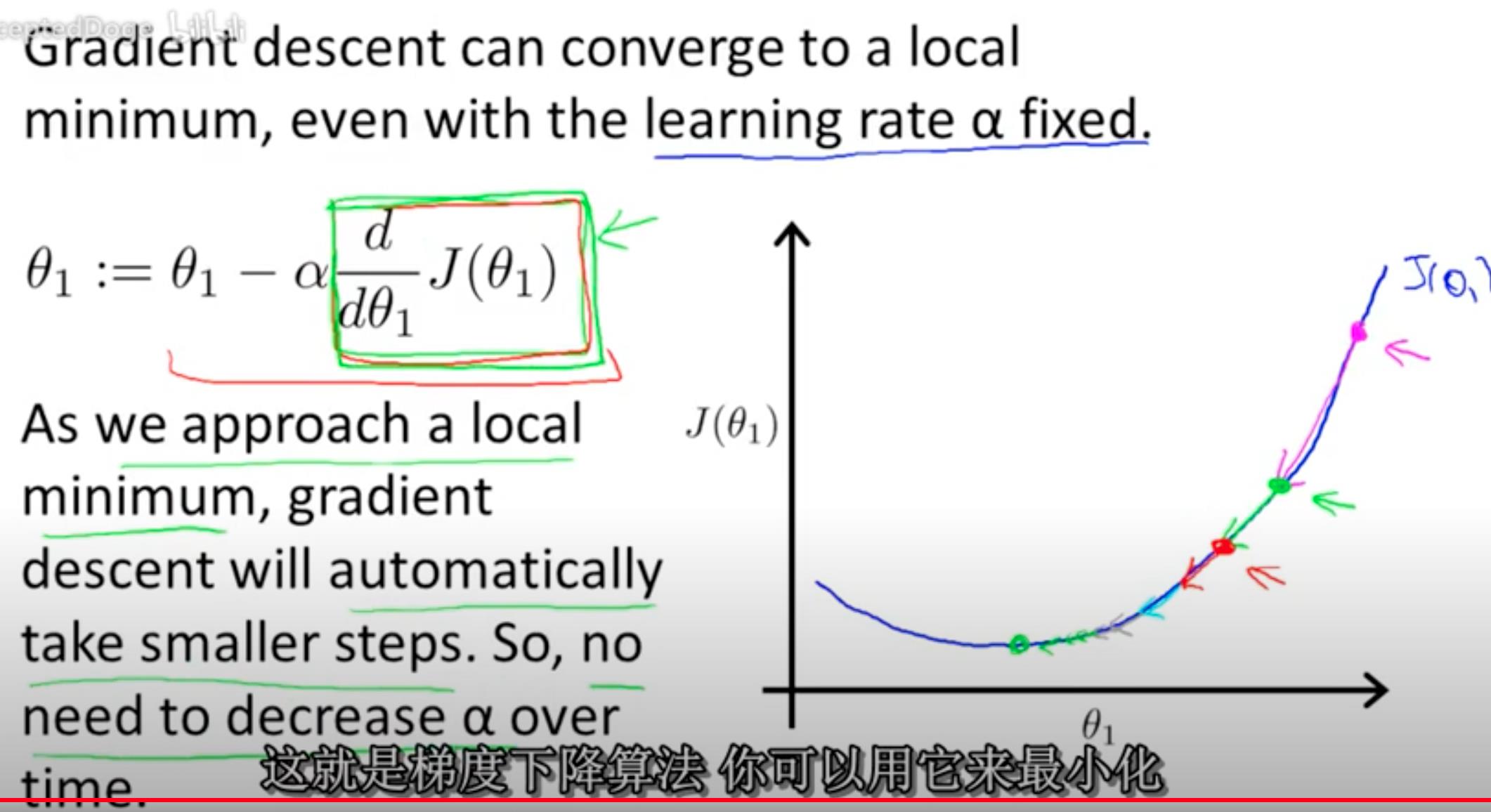

步长选择问题:

5. 步长太小,则拟合比较慢。

6. 步长太大,有概率跨过最优解。

如果一开始就选择了最小值,那么如何确定往哪个方向走呢?

解法:如果已经在局部最优点,则θ1 不再变化。θ1 := θ1 - a * 0

如果θ1 变化比较大,则收敛比较快;越接近最优解,则步长越小。

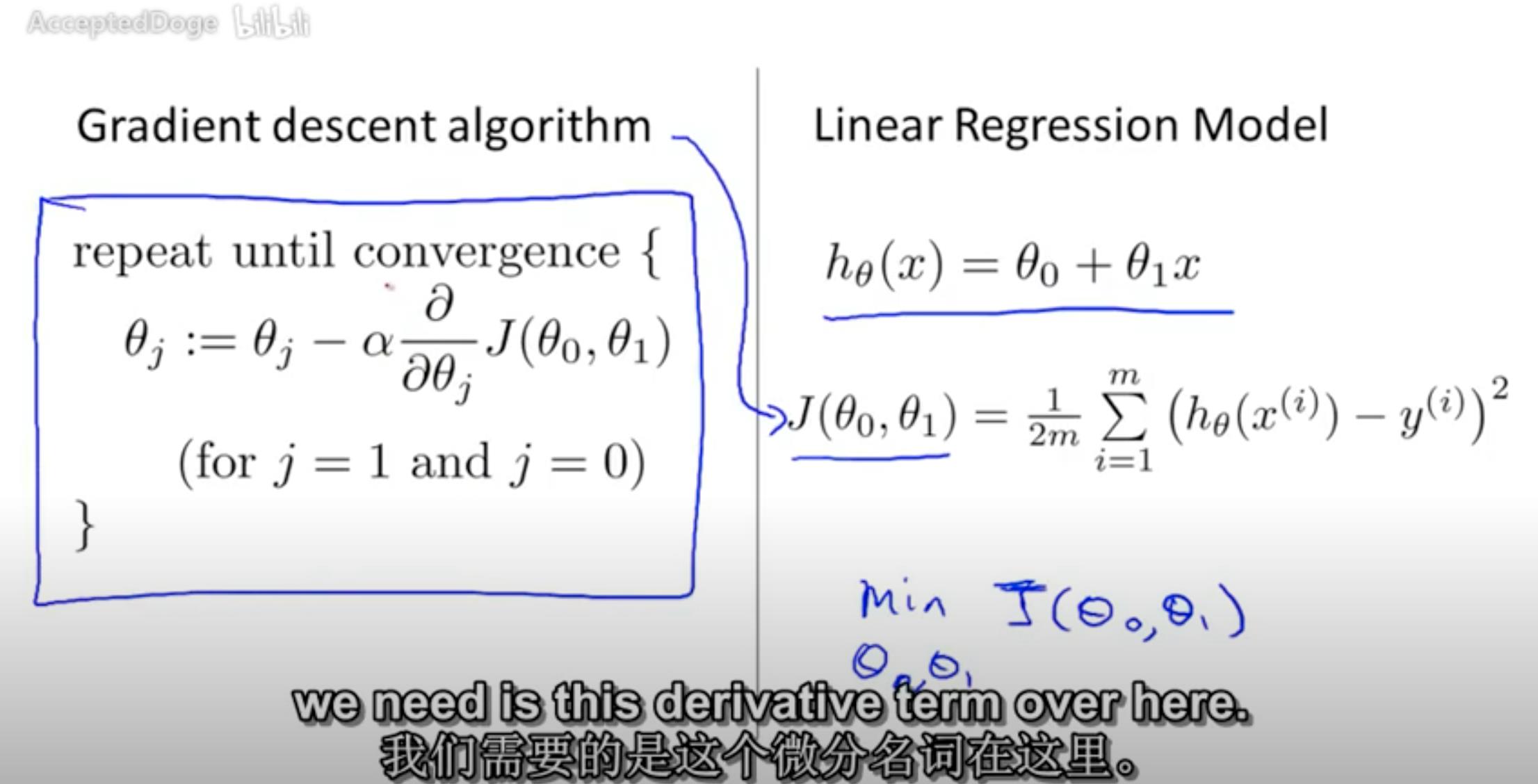

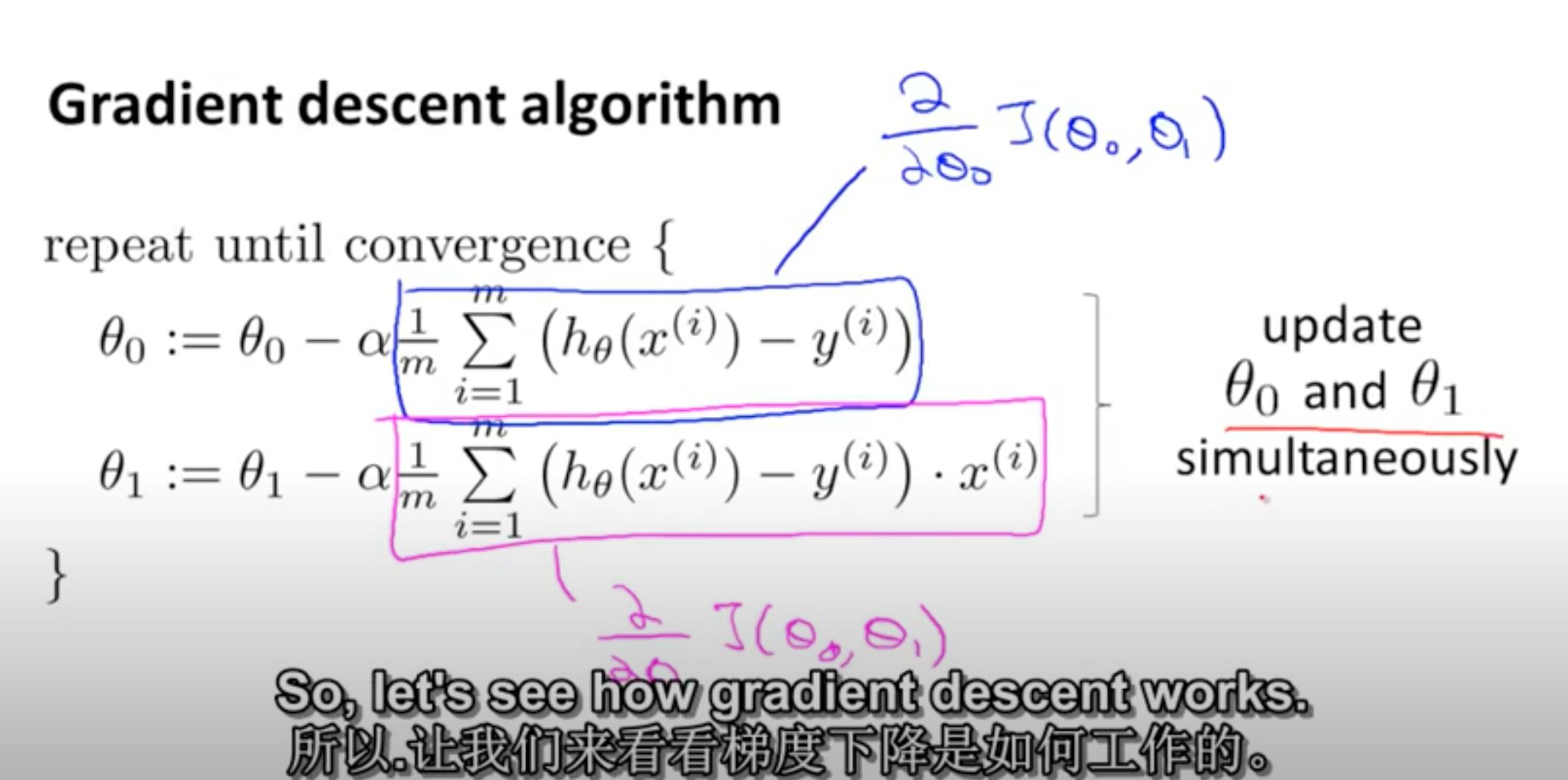

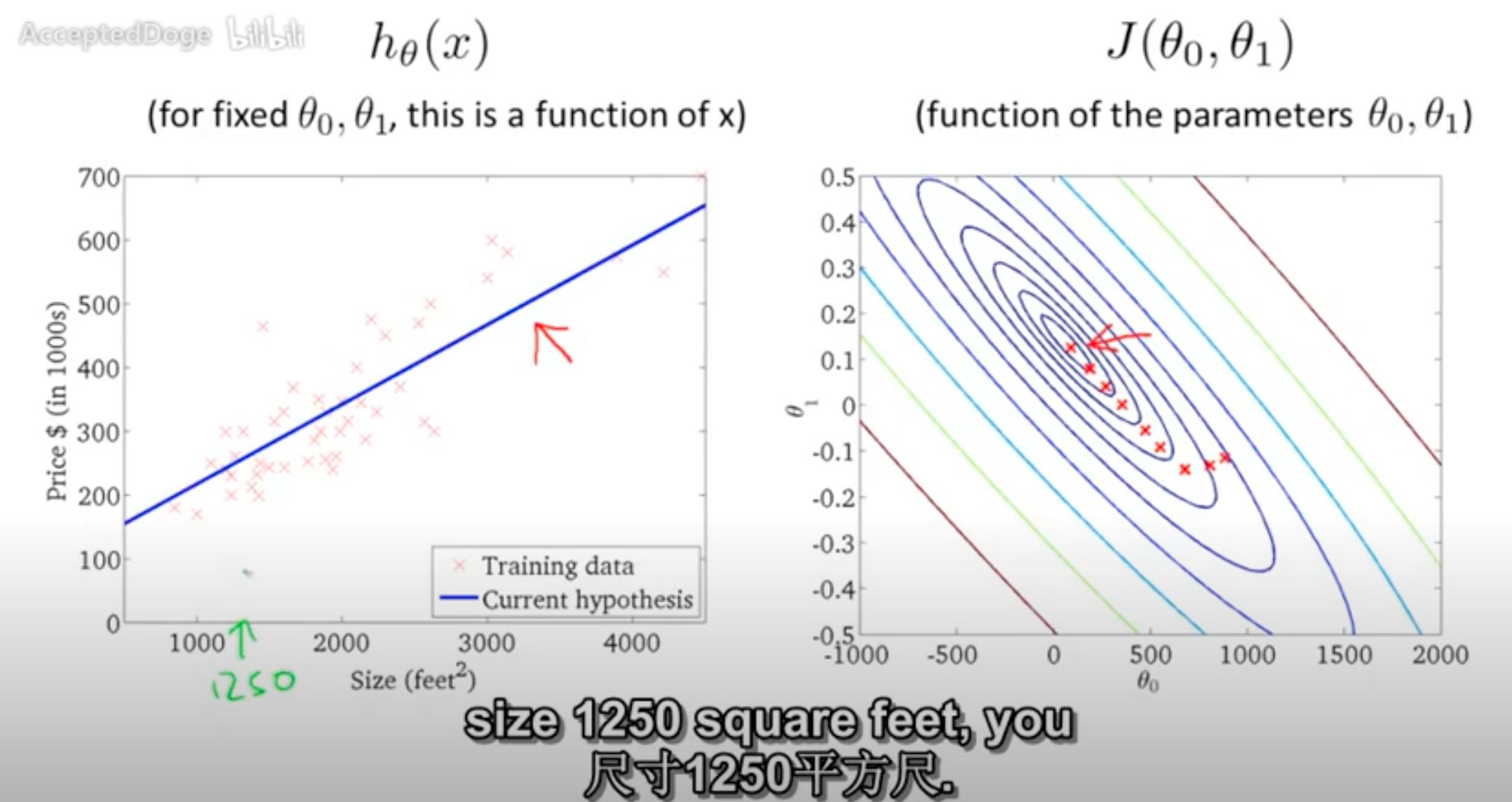

2. 第12课 Gradient descent for Linear regression - Linear regression with one variable

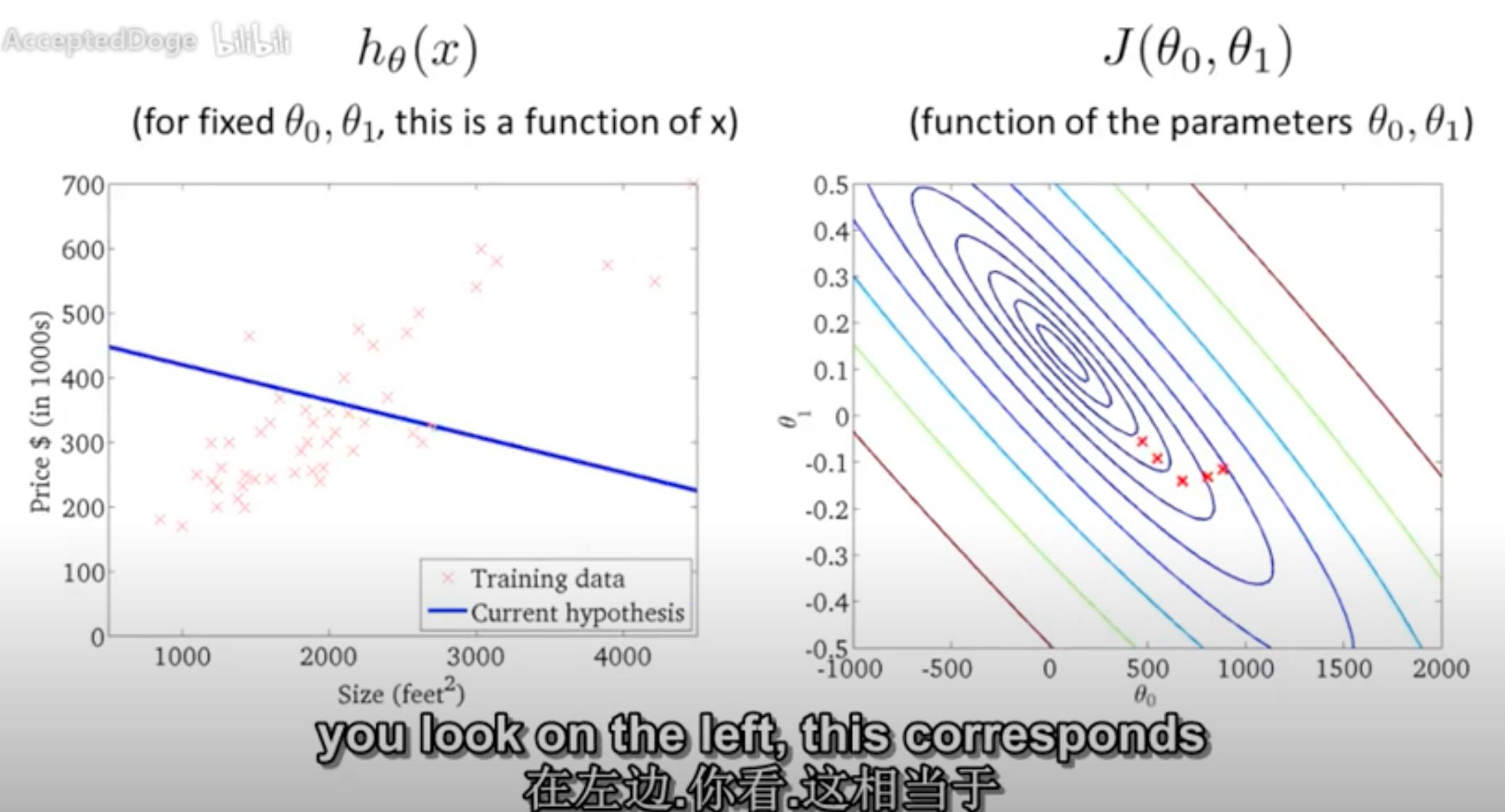

Gradient descent algorithm 阶梯下降算法 代入 到Linear regression线性回归模型中

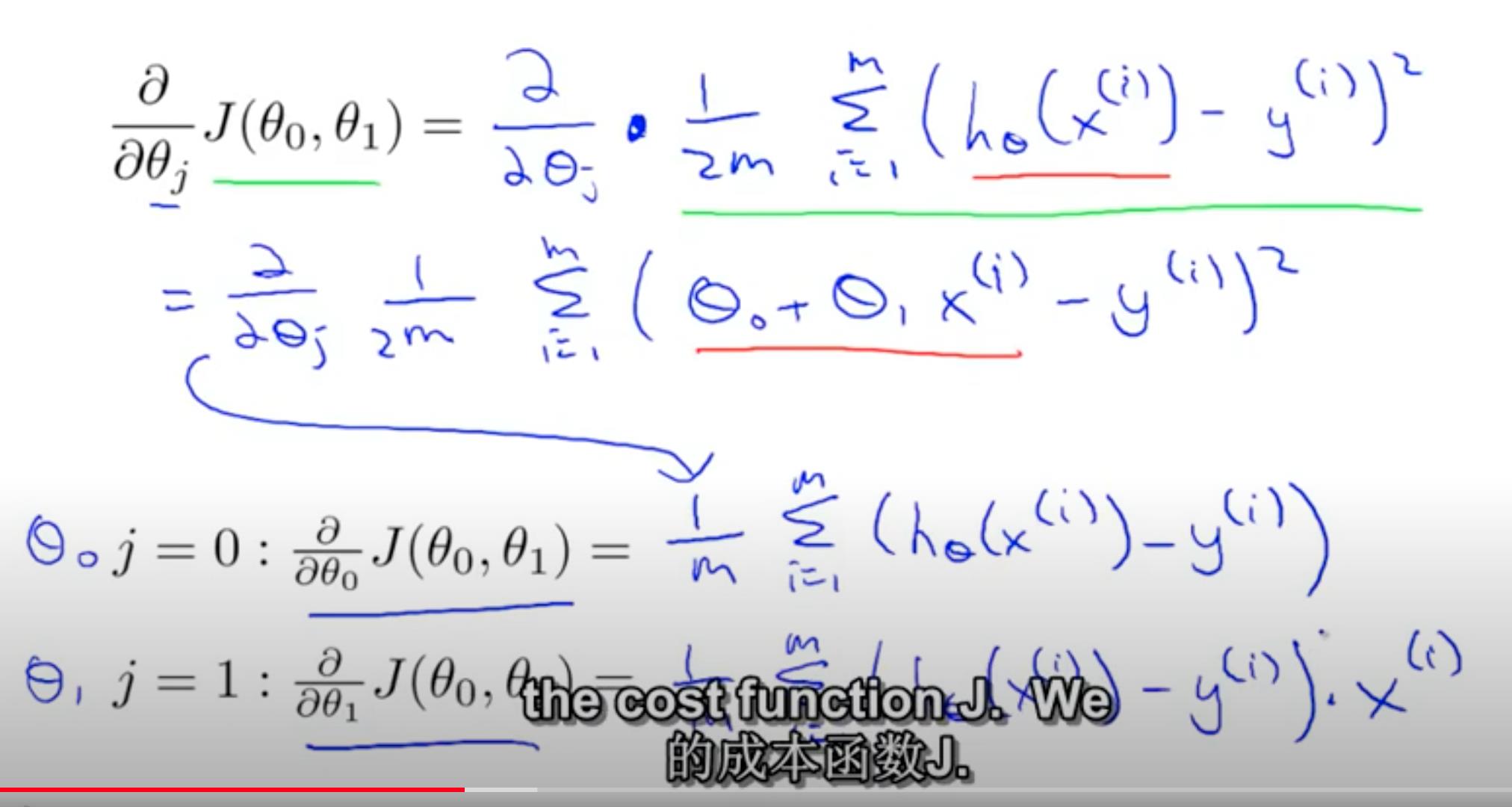

微积分推到过程如下:

同时更新两个参数θ0, θ1

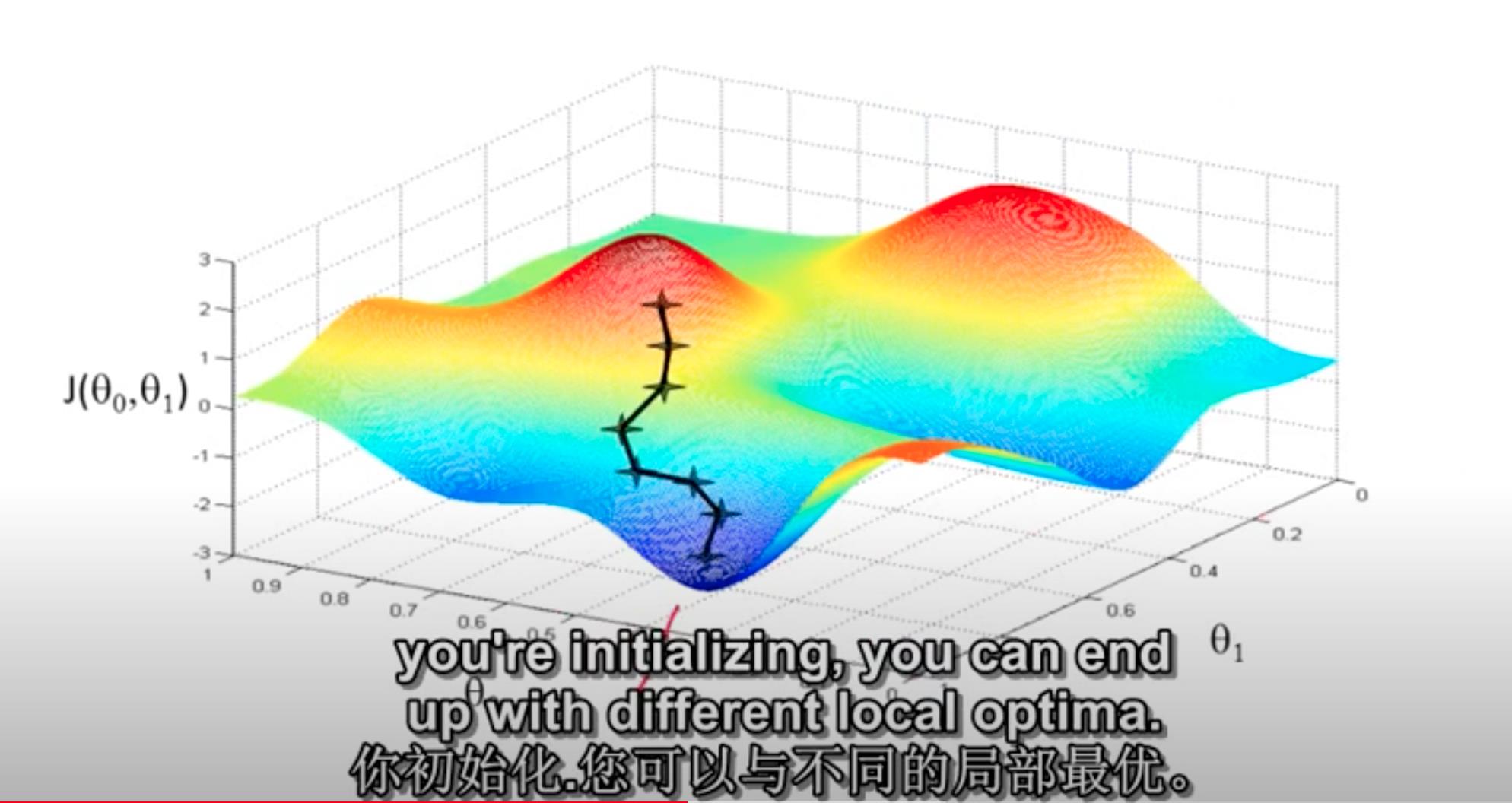

根据初始值,得到局部最优解

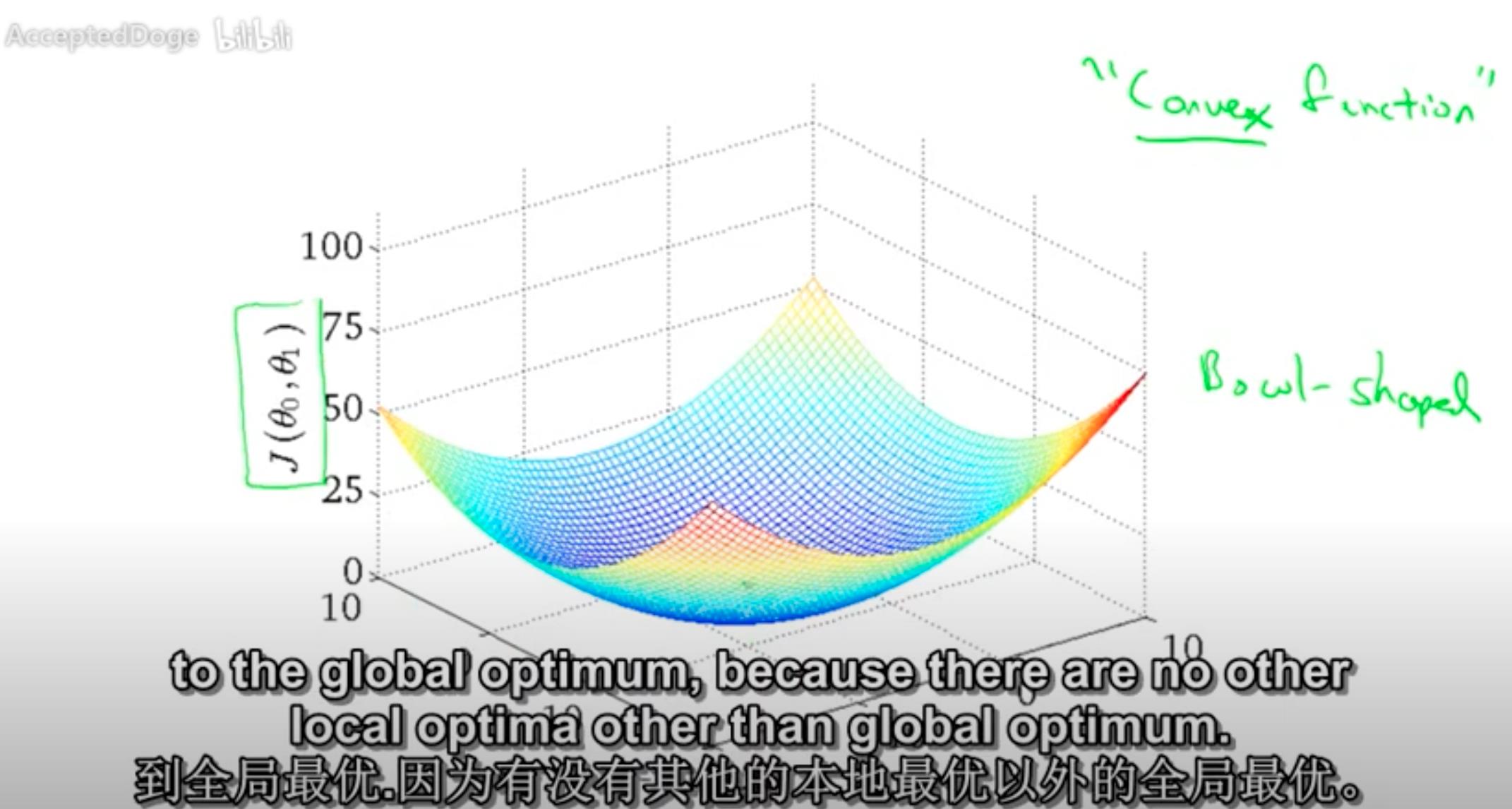

通常线性回归问题,只有一个全局最优解

根据阶梯下降算法,推导能耗方程一

根据阶梯下降算法,推导能耗方程二

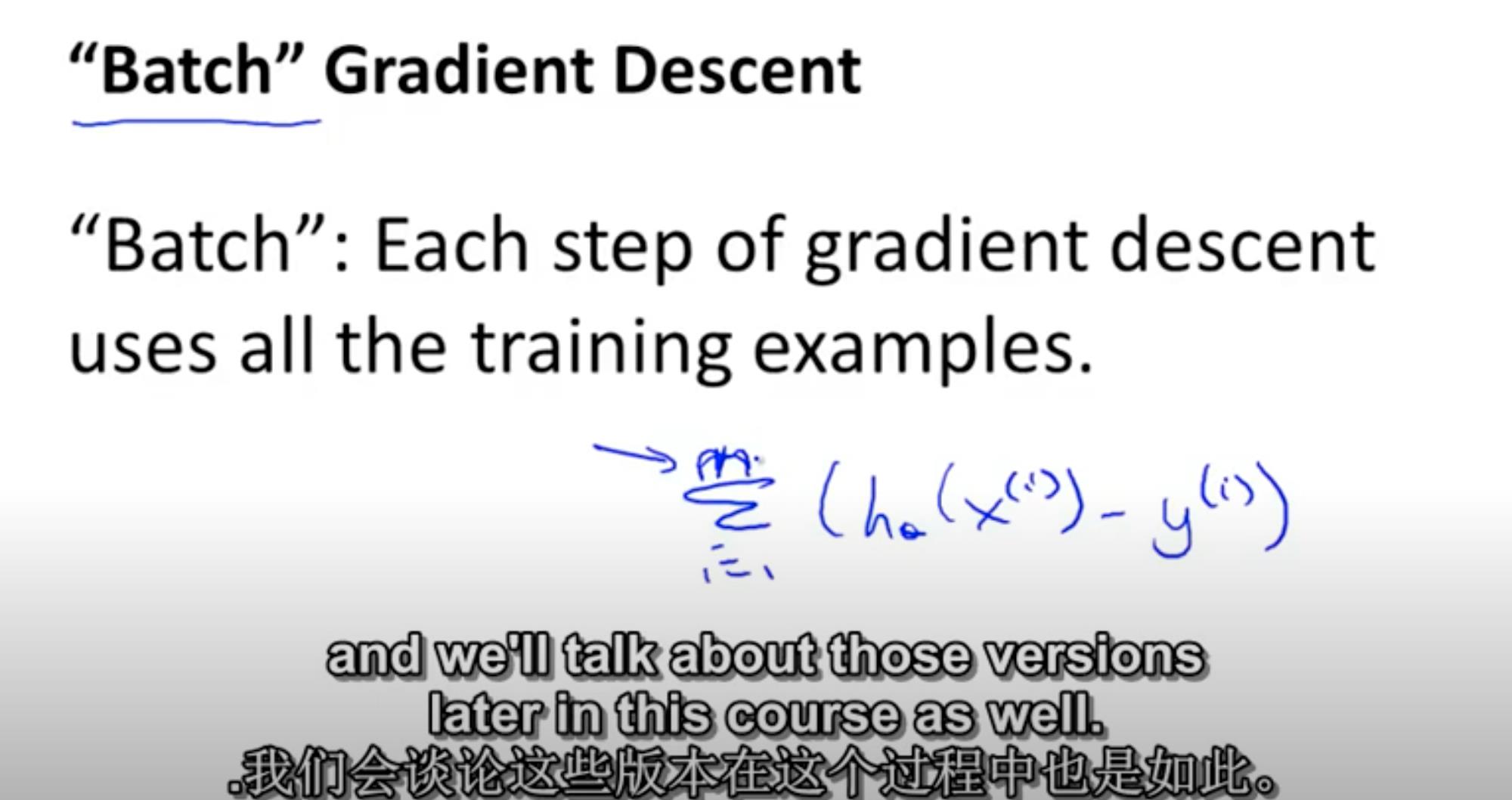

批量阶梯下降算法

3. 第13课 Matrices and vectors 矩阵和向量 - Linear regression with one variable

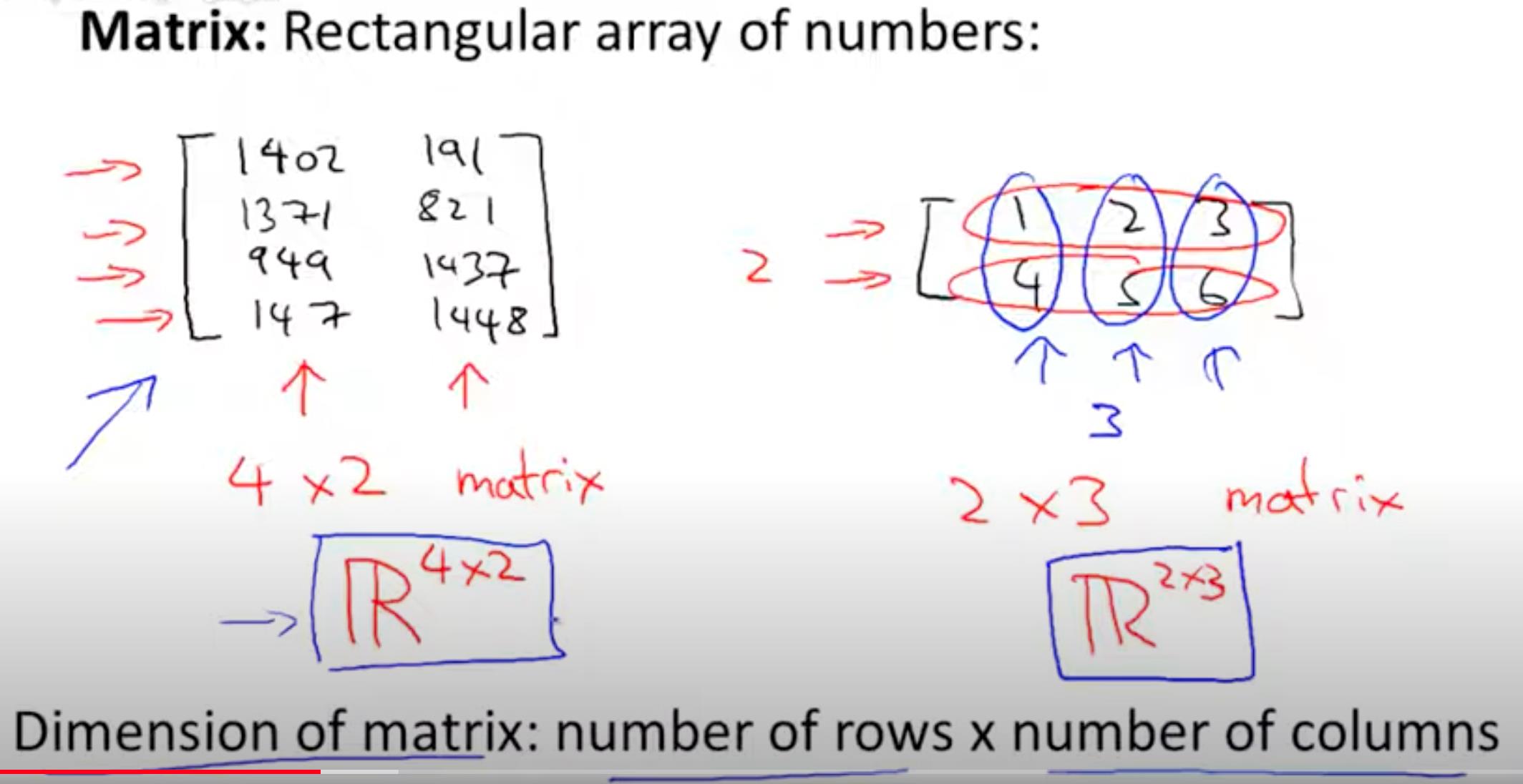

矩阵Matrices:由行和列构成的矩形数组。

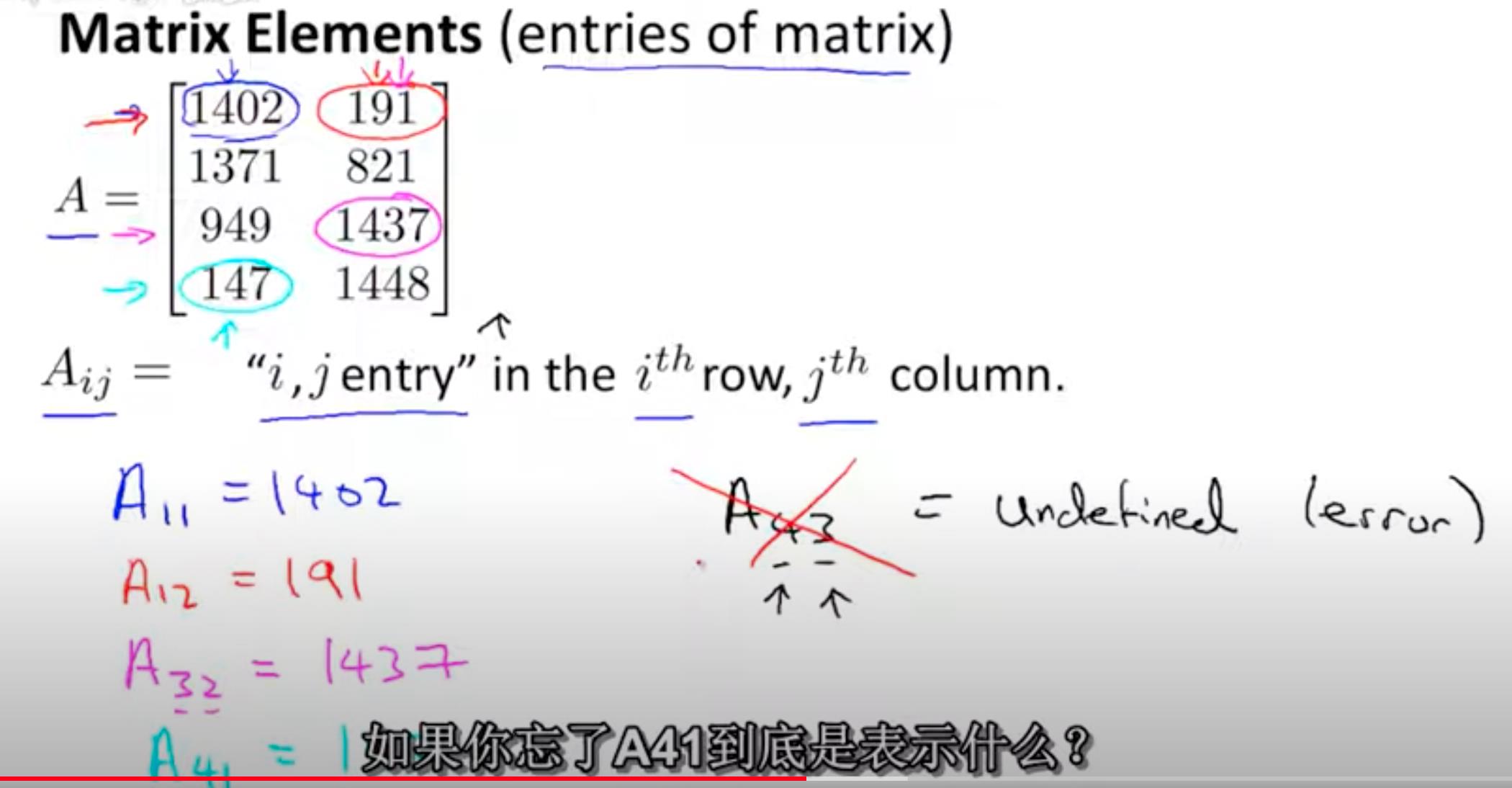

矩阵的元素Matrix Elements 就是用行和列的下标定位的。比如 A-32 = 1437, 表示第三行,第二列的数据。

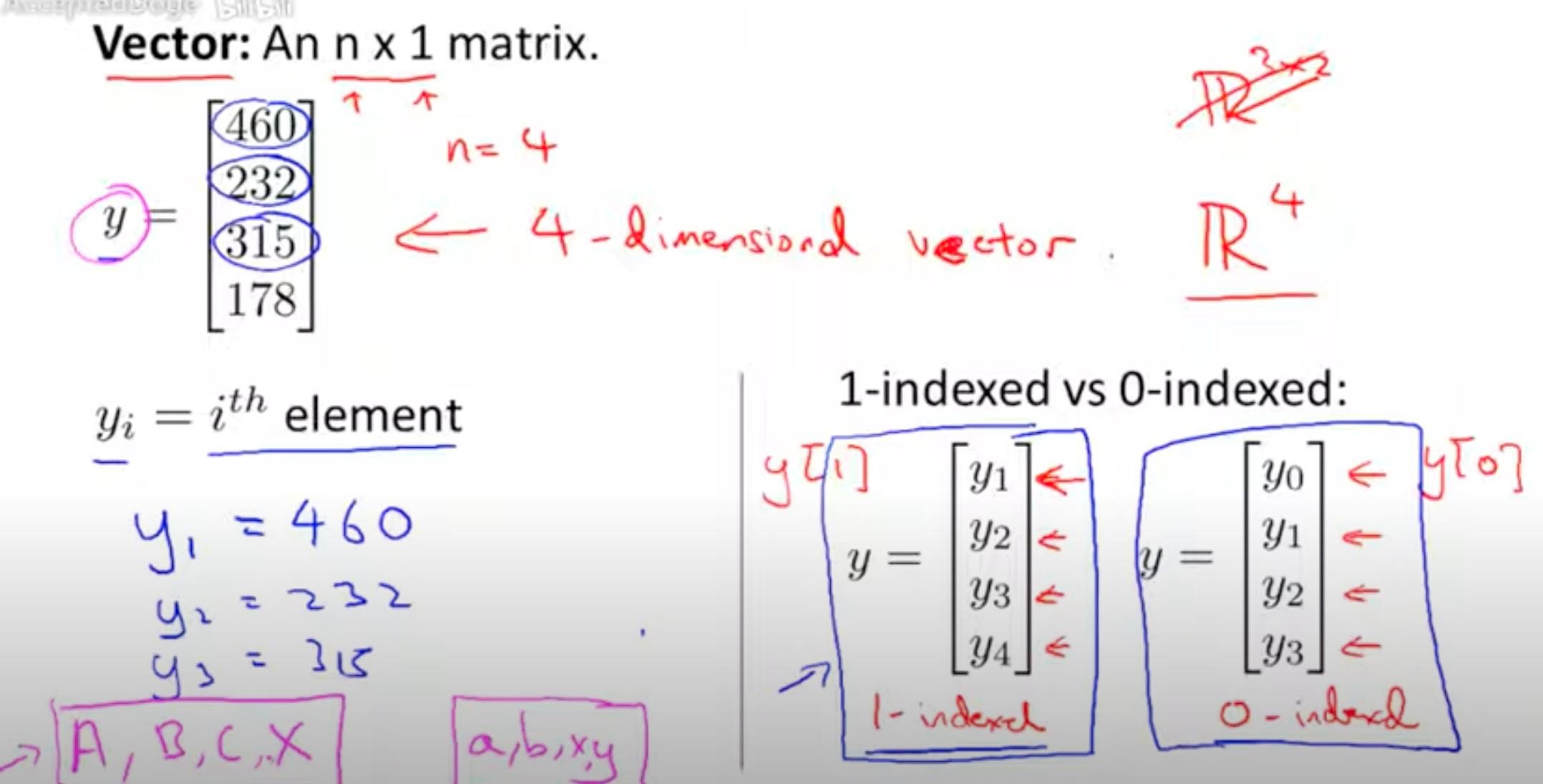

向量表示 n 行 1 列的矩阵。通常矩阵、向量的起始值是以1表示第一个数据。跟编程语言默认0有点差异。一般矩阵用大写字母表示,比如 A, B, C, X; 向量用小写字母表示,比如 a, b, x, y.

4 第14课 Addition and scalar multiplication 矩阵加法和单个数相乘除 - Linear regression with one variable

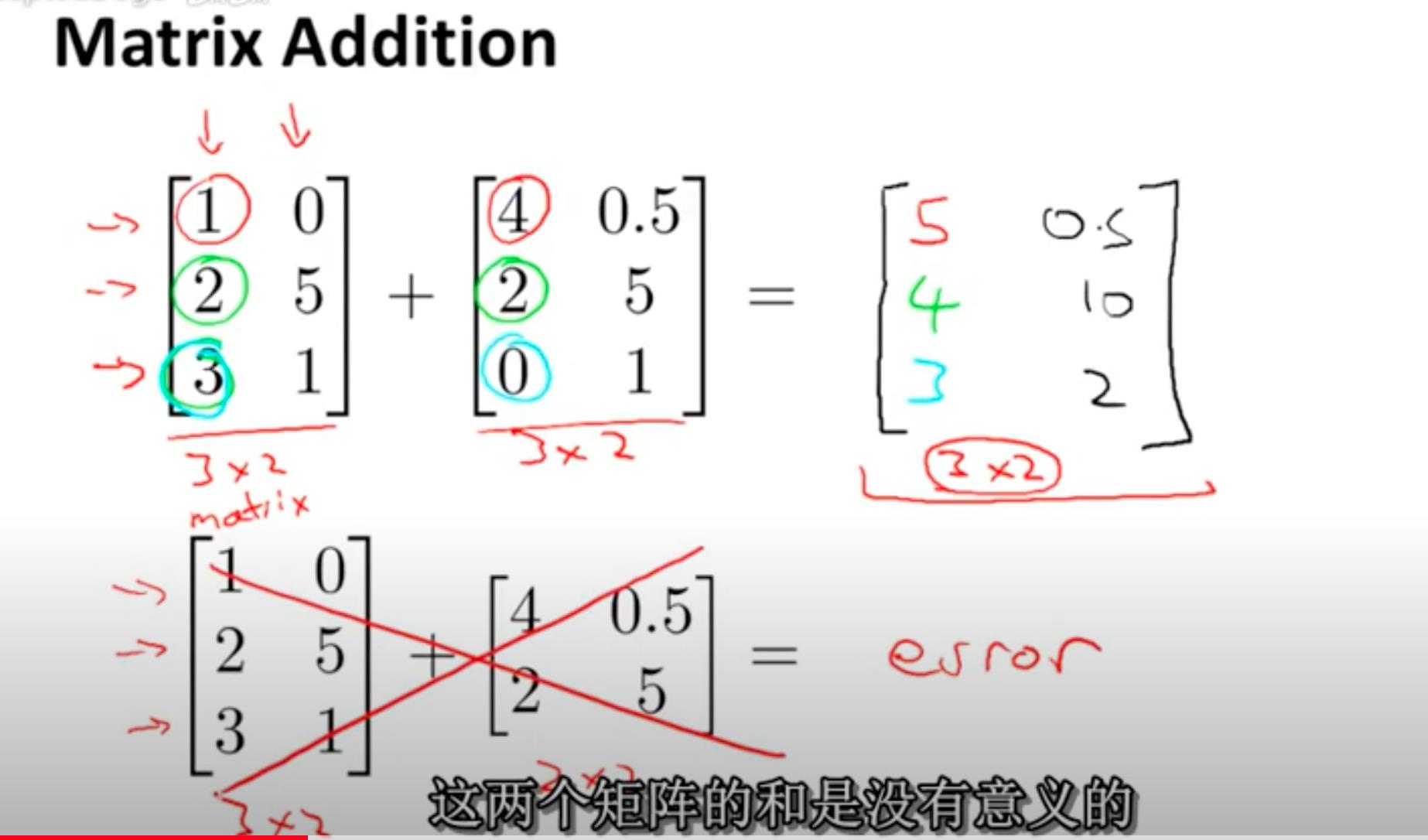

矩阵的加减法,相同的行列项相加减。前提是:两个矩阵的行列数相等,否则没法运算。

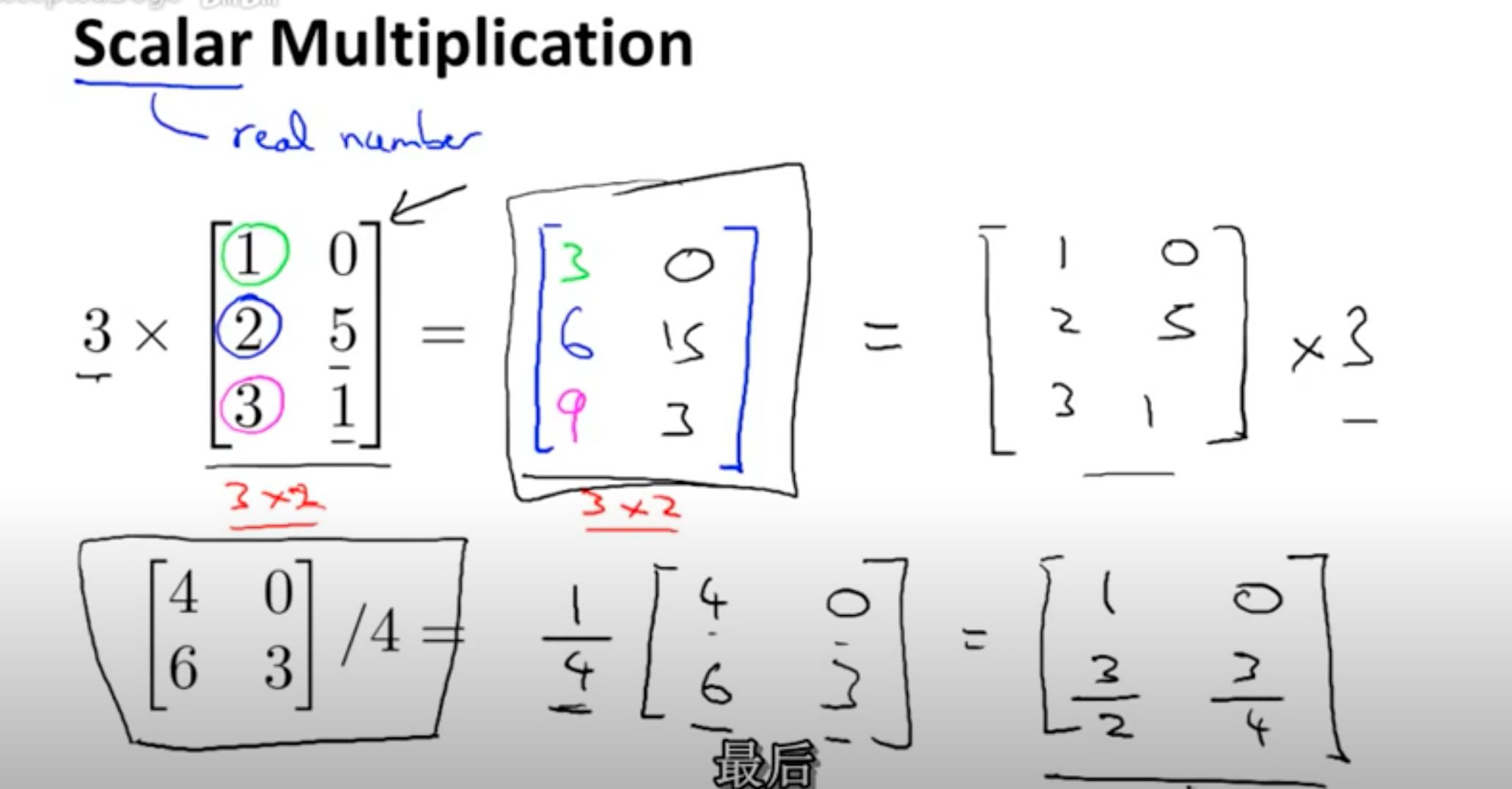

矩阵乘以某个数,矩阵中所有的数都乘以某个数即可。除法可以等价于乘以除数分之一。

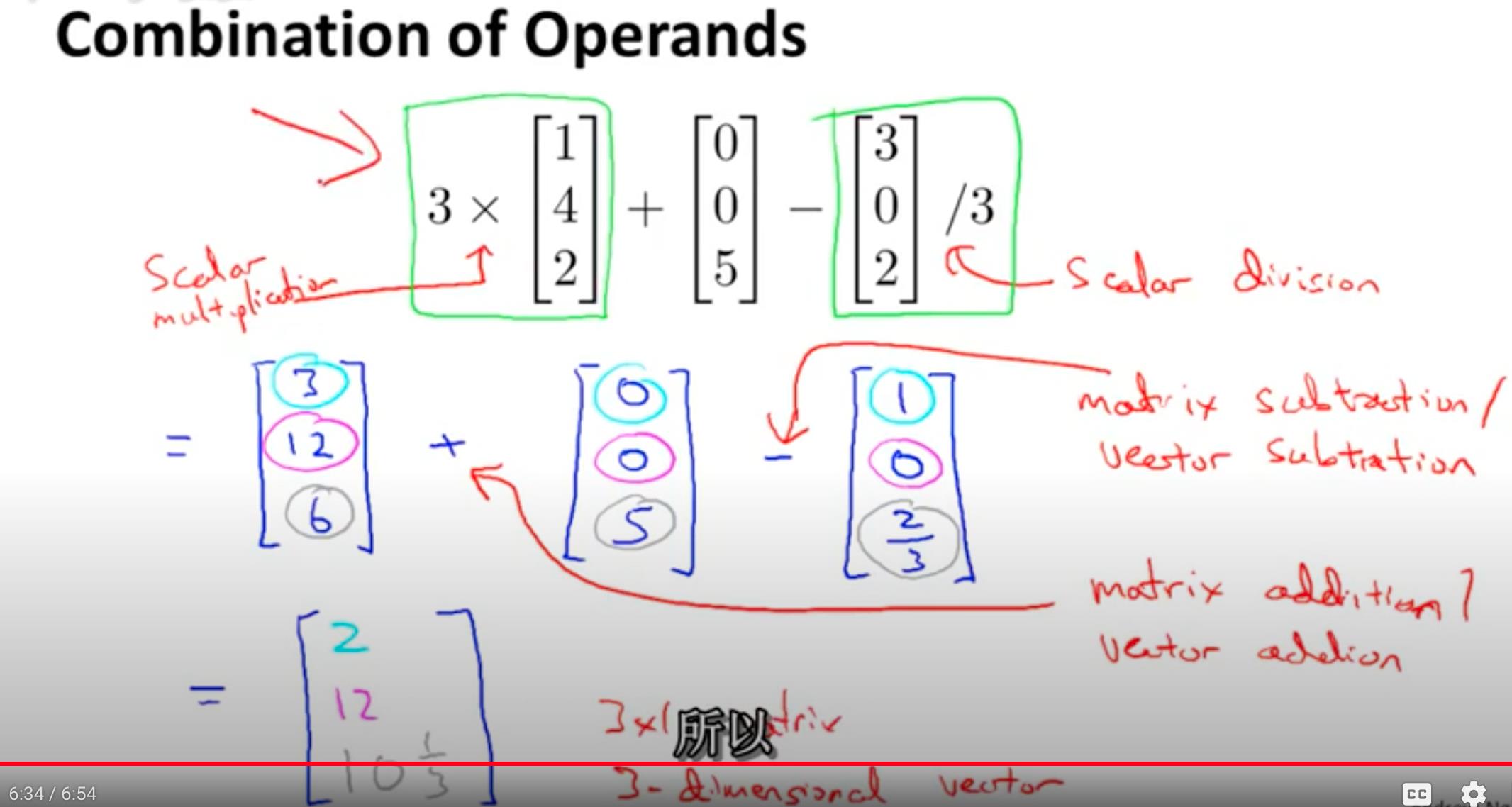

矩阵混合运算,跟四则运算一样,先乘除、后加减。

5 第15课 Matrix-vector multiplication - Linear regression with one variable

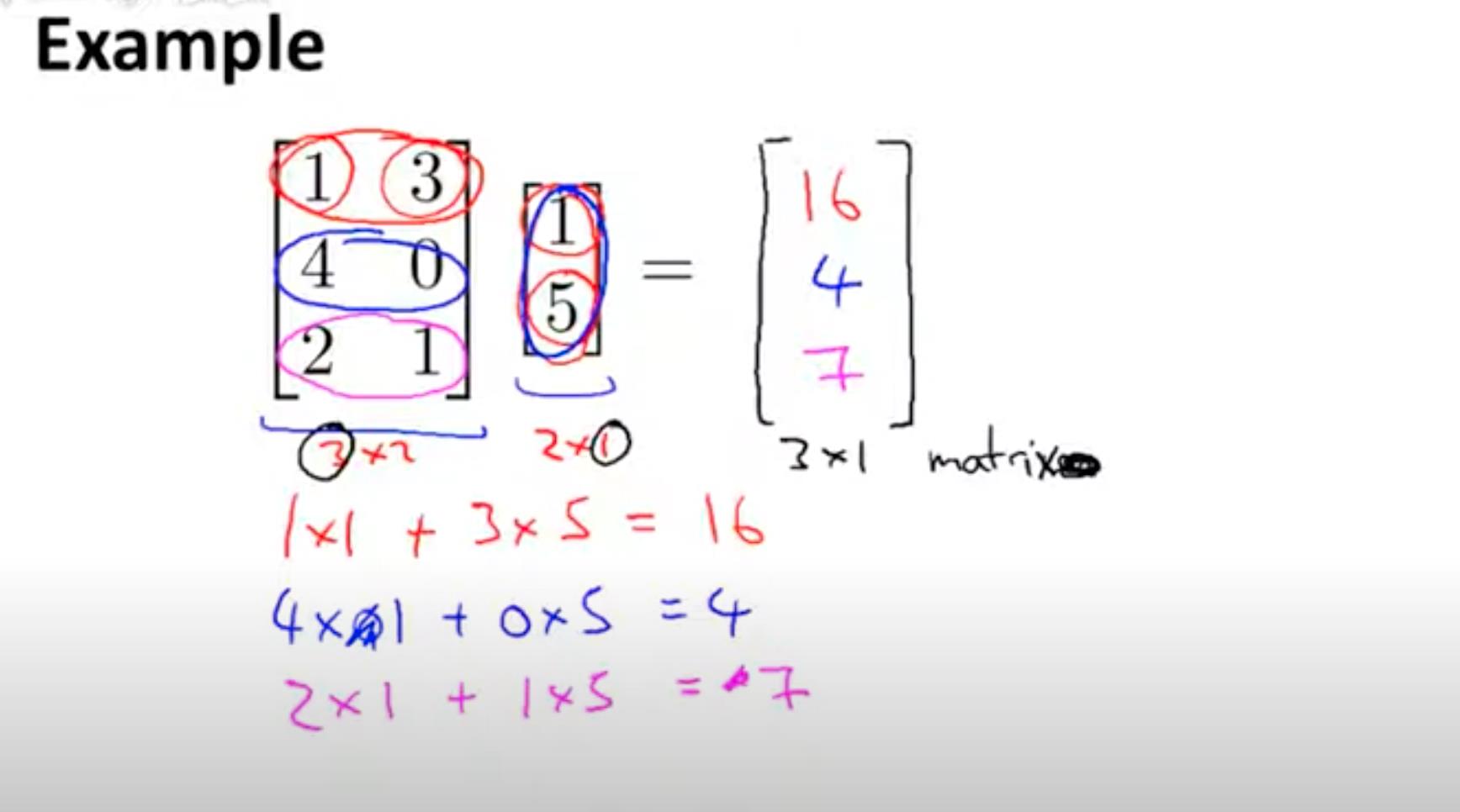

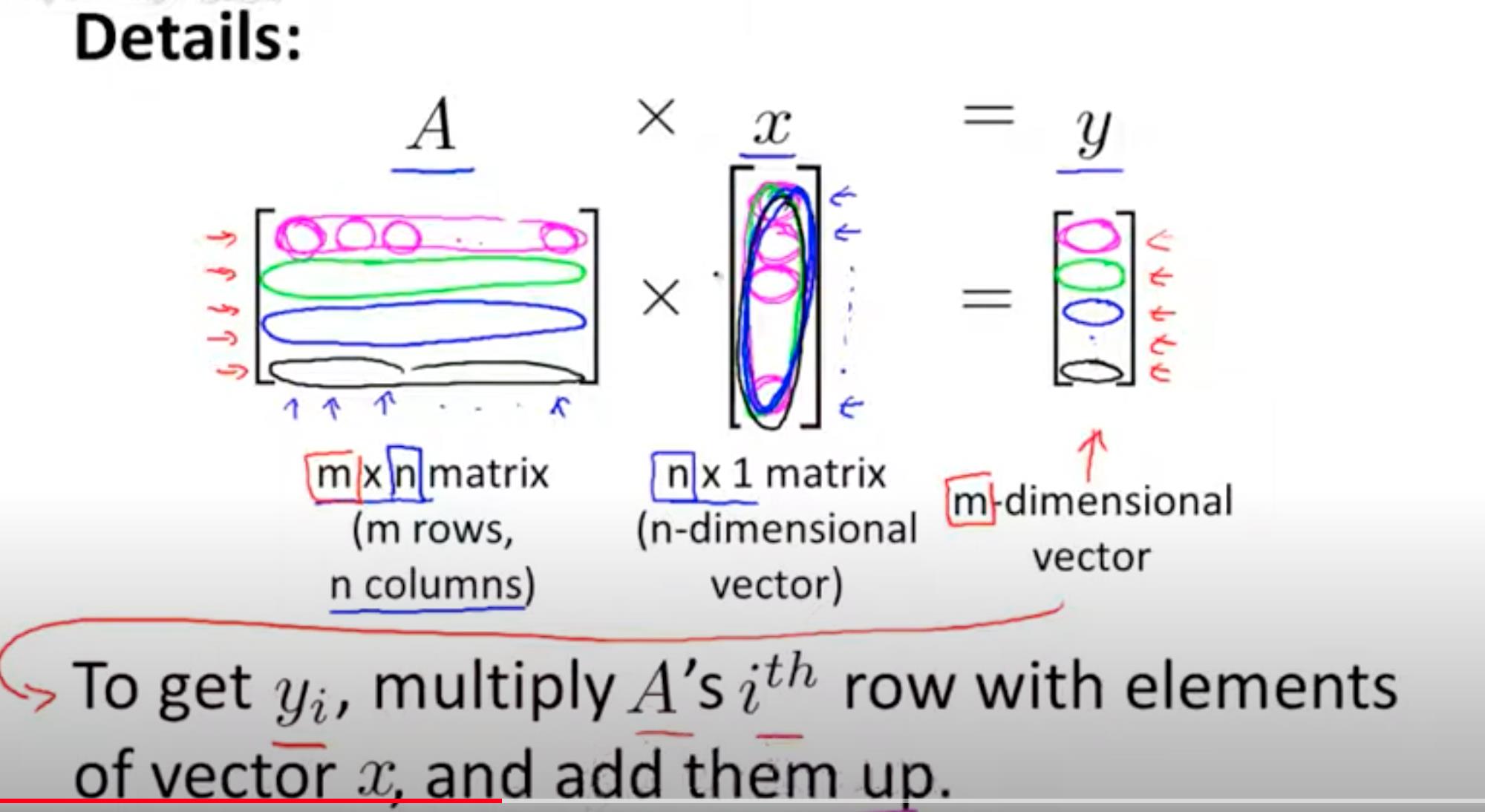

矩阵相乘,用第一个矩阵的每一行和另一个矩阵的每一列相乘的结果之和。注意第一个举证的列数必须和第二个矩阵的行数相等。比如矩阵行列数 x * y, 与矩阵行列数 y * z 相乘, 结果矩阵行列数为 x * z

矩阵运算具体解析:行列数变化如下

[m x n] * [n x 1] = [m x 1]

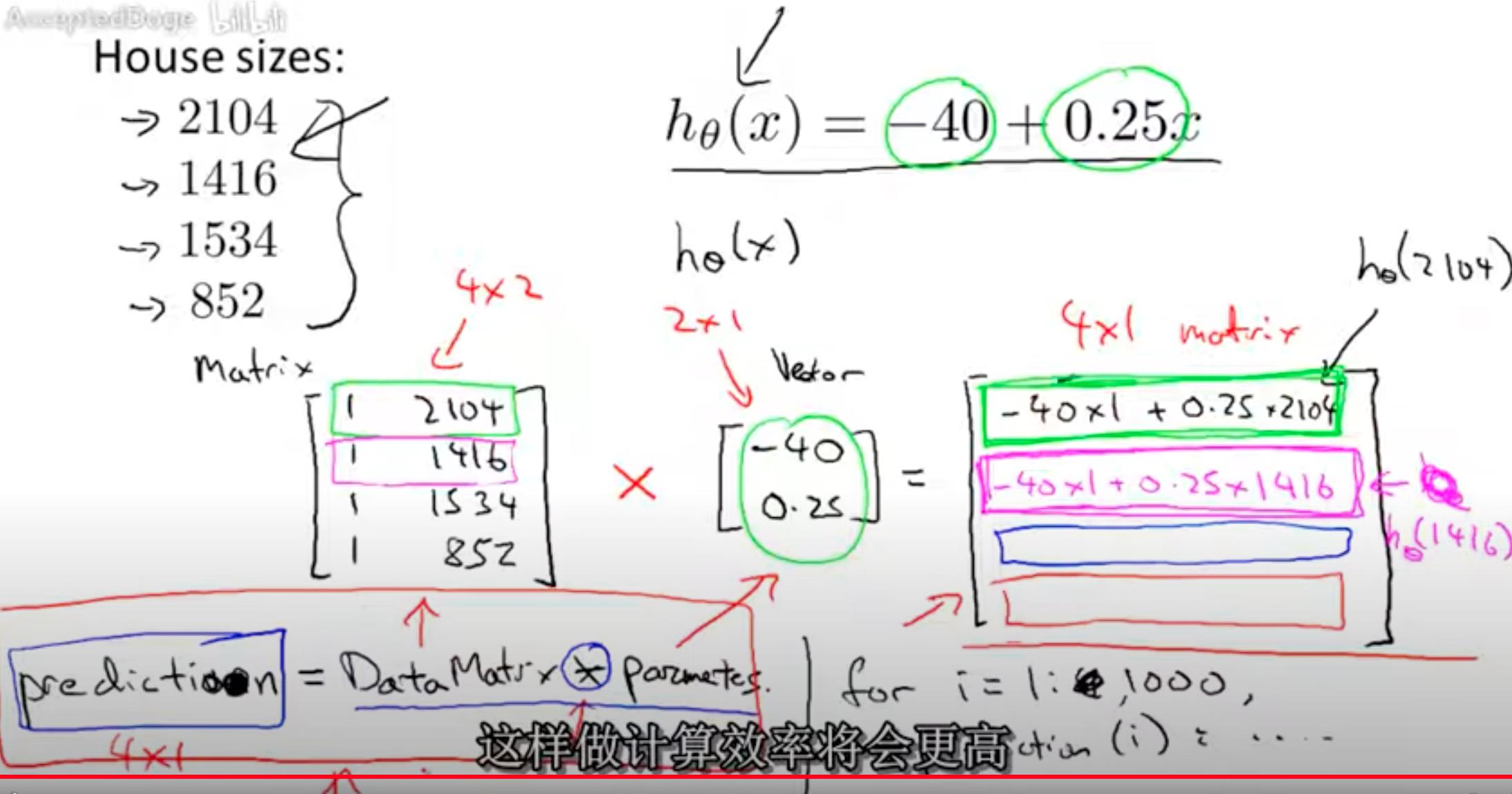

房价预测的结果,比如有1000个房子,可以转换为两个矩阵相乘的解法;用程序计算矩阵,只要一行代码即可解决。(先买个官子)

以上是关于机器学习 Machine Learning- 吴恩达Andrew Ng 第11~15课总结的主要内容,如果未能解决你的问题,请参考以下文章