一线性回归的两种实现方式:sklearn实现

Posted 满目星辰wwq

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了一线性回归的两种实现方式:sklearn实现相关的知识,希望对你有一定的参考价值。

线性回归的sklearn实现

导入必要的模块

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

数据集

x = np.array([50, 30, 15, 40, 55, 20, 45, 10, 60, 25])

y = np.array([5.9, 4.6, 2.7, 4.8, 6.5, 3.6, 5.1, 2.0, 6.3, 3.8])

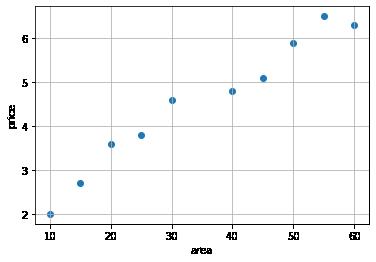

画出数据集的散点图

plt.scatter(x, y)

plt.grid(True)

plt.xlabel('area')

plt.ylabel('price')

plt.show()

数据划分

划分训练集和测试集

使用到的api:

数据划分sklearn.model_selection.train_test_split

用到的参数:

-

*arrays:输入数据集。

-

test_size:划分出来的测试集占总数据量的比例,取值0~1。

-

shuffle:是否在划分前打乱数据的顺序,默认True。

-

random_state:shuffle的随机种子,取值正整数。

返回:

- splitting:列表包含划分后的训练集与测试集。

x_train, x_test, y_train, y_test = train_test_split(

x, y, test_size=0.3, shuffle=True, random_state=23)

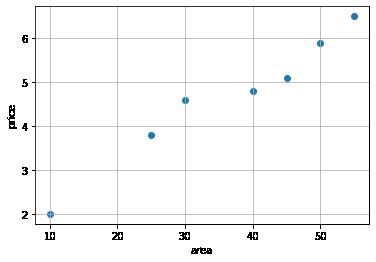

查看训练集的散点图

plt.scatter(x_train,y_train)

plt.grid('True')

plt.xlabel('area')

plt.ylabel('price')

plt.show()

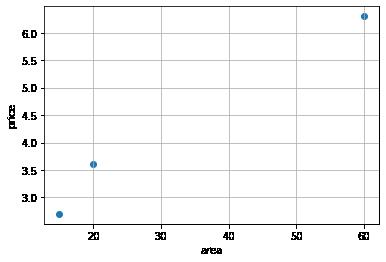

查看测试集的散点图

plt.scatter(x_test,y_test)

plt.grid('True')

plt.xlabel('area')

plt.ylabel('price')

plt.show()

模型搭建

使用到的api:

线性回归sklearn.linear_model.LinearRegression

model = LinearRegression()

模型训练

使用到的api:

线性回归模型训练sklearn.linear_model.LinearRegression.fit

用到的参数:

-

X:输入特征,如果输入是np.array格式,shape必须是(n_sample, n_feature)。

-

y:输入标签。

# x_train的shape由(7,)变为(7,1)

x_train = x_train.reshape(-1,1)

model.fit(X=x_train, y=y_train)

LinearRegression()

模型预测

对测试集做预测

使用到的api:

线性回归模型预测sklearn.linear_model.LinearRegression.predict

用到的参数:

- X:输入特征,如果输入是np.array格式,shape必须是(n_sample, n_feature)。

返回:

- C:预测结果。

# x_test的shape由(7,)变为(7, 1)

x_test = x_test.reshape(-1,1)

y_test_pred = model.predict(x_test)

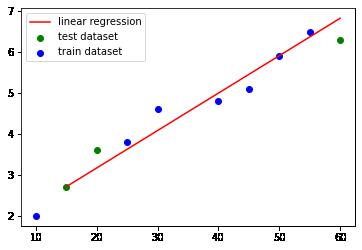

画出数据集的散点图和预测直线

x_test = x_test.reshape(-1)

plt.scatter(x_test, y_test, color='g', label='test dataset')

plt.scatter(x_train, y_train, color='b',label='train dataset')

plt.plot(np.sort(x_test), y_test_pred[np.argsort(x_test)], color='r', label='linear regression')

plt.legend()

plt.show()

计算评价指标mse

使用到的api:

均方误差sklearn.metrics.mean_squared_error

用到的参数:

-

y_true:真实值(ground truth)。

-

y_pred:预测值。

返回:

- loss:mse计算结果。

mse = mean_squared_error(y_true=y_test, y_pred=y_test_pred)

print('MSE: {}'.format(mse))

MSE: 0.15383086014546365

查看线性回归模型的系数w和截距b

使用到的api:

回归系数sklearn.linear_model.LinearRegression.coef_

截距项sklearn.linear_model.LinearRegression.intercept_

w, b = model.coef_[0], model.intercept_

print('Weight={0} bias={1}'.format(w, b))

Weight=0.09139423076923077 bias=1.3420673076923069

以上是关于一线性回归的两种实现方式:sklearn实现的主要内容,如果未能解决你的问题,请参考以下文章