详解神经网络算法所需最基础数据结构Tensor及其相关操作

Posted Coding迪斯尼

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了详解神经网络算法所需最基础数据结构Tensor及其相关操作相关的知识,希望对你有一定的参考价值。

程序=算法+数据结构。神经网络本质上是一种大数据分析算法,任何算法得以运行,都必须依靠特定的数据结构,而用于将各种数据统一封装并输入网络模型的数据结构叫tensor,也就是张量。张量在不同的情况下存有不同的形式,接下来我们逐一分解。

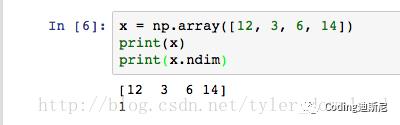

张量一大特征是维度,一个0维张量就是一个常量,在Python中,一个张量的维度可以通过读取它的ndim属性来获取,例如下面代码:

我们常用的数值就等价与一维张量,例如:

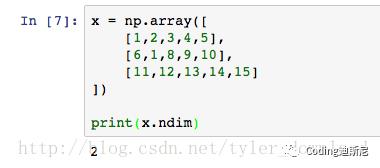

同理可得,一个二维数组就是一个二维张量,相关代码如下:

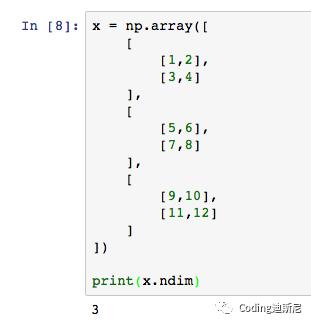

从上面例子我们可以看成张量定义的规律,所谓n维张量,其实就是一维数组,数组中的每个元素都是n-1维张量。由此可见,3维张量其实就是一个一维数组,数组中的每个元素就是2维数组,相关代码如下:

3维张量就是元素为2维数组的一维数组,同理4维张量就是元素为3维张量的一维数组。一个n维张量经常用一组数据来表示,例如上面的3维张量,它可以用(3,2,2)这组数据结合来表示,一个张量是几维度,那么括号里面就有几个数字,面对(3,2,2) 我们可以这么解读,由于括号里有3个数字,因此它表示一个3维张量,这个张量包含3个元素,每个元素是一个2维张量,2维度张量含有两个元素(第二个2),每个元素是一维张量,每个一维张量含有两个(第三个2)常量。

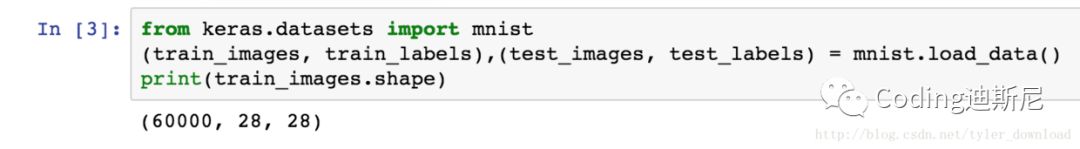

在上一节的例子中,我们加载的用于培训网络的图像数据就是一个三维张量:

上面代码的运行结果就表示,train_images是一个三维张量,张量中含有60000个二维张量,也就是二维数组,每个二维数组表示一张数字图片。

我们可以从张量截取出一部分,例如:

在上面代码中,train_images是含有60000个2维张量的3维张量,代码把从第10个开始,到第100个2维张量抽取出来,形成一个3维张量。在上一节代码中,涉及到一个概念叫batch,batch指的是从全部数据中抽取出一部分形成一个子集,上面代码中的my_slice就是一个batch。

在实际应用中,最多能使用到的张量是5维,一维张量是很常见的,就是一维数组,如果我们需要记录一个人的年龄[27岁],身高[1.78米],收入[10000每月],我们就可以使用一个一维张量[27,1.78,10000]。

如果我们的数据中涉及到时间时,那么很可能需要3维张量。例如每分钟股票的价格,假设我们要记录一分钟内股票的最高点和最低点,那么我们可以用含有3个数据点的一维数组表示,第一个数据点表示分钟,第二个点表示最高点,第三个点表示最低点,例如一天有390分钟,假设第20分钟股票的最高点是10,最低点是8,那么这一分钟的张量表示为[20, 10, 9], 于是一整天的股票信息就可以用一个二维张量表示(390, 3),390表示一天的分钟数。如果我们要记录250天的数据,那么就得使用三维张量(250, 390, 3)。

对于图片来说,假如每个像素点我们用RGB值表示,于是一个像素点就可以用含有三个数据点的一维数组表示,例如红色就是[255,0,0]。一张大小为256*256的图片就可以用3维张量表示(256, 256, 3), 那么一个128张图片的集合就可以用4维数组表示(128, 256, 256, 3)。

我们接着看看张量运算。在上一节实例中,有一行代码是这样的:

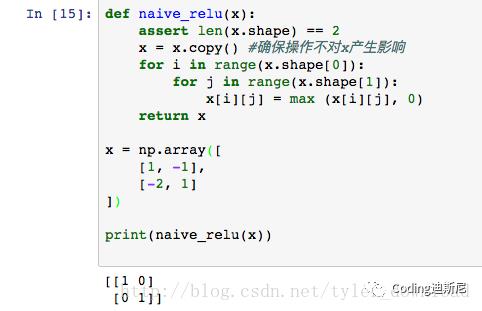

layers.Dense(512, activation='relu')其中的relu其实一种张量操作,也就是max(x,0), 假设x是[1, -1, -2], 那么作为relu操作后,x变为[1, 0, 0], 也就是把x中小于0的元素全部变成0,大于0则保持不变,我们用代码来实现relu操作:

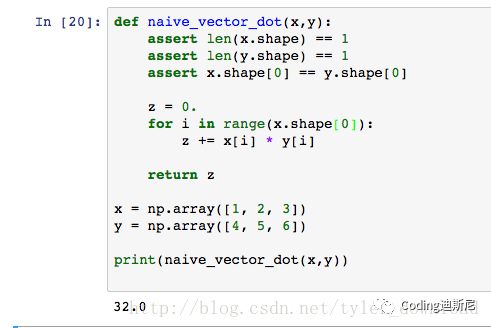

同维度的张量可以做点乘操作,例如[1,2,3] [4,5,6] = 1\4 + 2*5 + 3*6,我们看看一维张量的点乘操作如何用代码实现:

如果是一个2维张量与一个1维张量做点乘时,有前提要求就是2维张量中的每个元素,也就是一维张量它元素的个数要与做点乘的1维度张量中元素的个数相同,例如:

[ [1,2], [34]] \ [5,6] = [ [1,2] * [5,6], [3,4] * [5,6]] = [17, 39]

对应的实现代码如下:

本节我们主要介绍了神经网络算法中最基本的一种数据结构叫张量,以及涉及张量基本运算,下一节我们将深入神经网络的构建细节,抛弃框架,使用代码重新构造一个神经网络,通过把轮子重新建造一遍的办法,搞清楚神经网络的算法原理。

更详细的讲解和代码调试演示过程,请点击’阅读原文’

以上是关于详解神经网络算法所需最基础数据结构Tensor及其相关操作的主要内容,如果未能解决你的问题,请参考以下文章