PMP 小鸟项目回忆录—神经网络算法&启示

Posted 大书绝版煎焦回锅肉

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了PMP 小鸟项目回忆录—神经网络算法&启示相关的知识,希望对你有一定的参考价值。

神经网络算法&启示

肯扬

THE BEAUTY

OF PROJECT

项目往前走,有意思的发现徐徐多了起来, IBM 的同志告知,现在的趋势是ABCD, AI ,Big Data, Cloud ,渗透各行各业,手头的项目也进入深水区。前方一片蓝海,于是和大牛算法专家请教,吹水,懵逼烧脑之后,也有些理解。简单的刻画一篇文章,试试深浅,就当是民科吧。

人工智能的项目预计能写好多集, 现在跑在最前面, 也没有什么章法,边做边写, 这里也当做一面镜子。

1:什么是神经网络?

神经网络是机器学习的里面的一个学习方法的基本结构。

神经网络+策略 组合之后行业一般叫做神经网络算法,也是现在大热的方法。

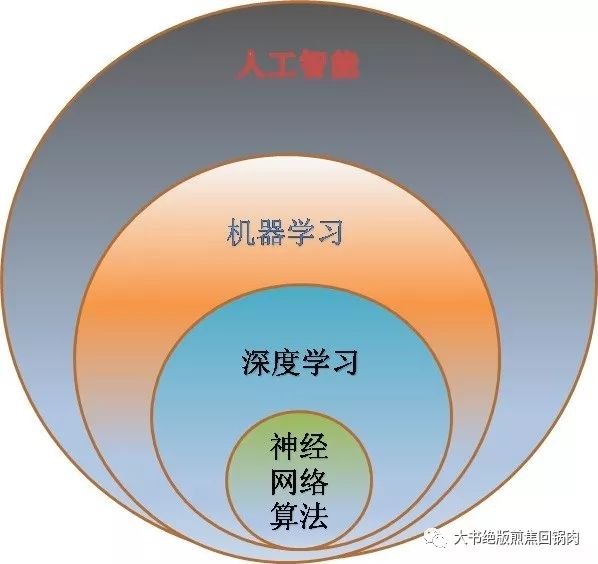

具体的关系如下:

人工智能包含了机器学习,机器里面包含了深度学习,深度学习的一个方法是神经网络算法。

2:机器学习( Machine Learning ) 有什么用处?

学习机的应用,可以用来做 视觉识别,辨认图像,最近用的最多的,人脸识别(火车站, 酒店)

另外识别语音(语音输入法),识别文字,等都是他的应用;

THE BEAUTY

OF PROJECT

3:学习机的内涵是什么?

学习机本质上是一个数学函数+统计归纳 , 函数的构造依据过往的经验,数据拼凑(拟合)出来的, 再用这个函数预测未知。 总的来说输入X 得到Y。Y 验证后是可信的,经得起统计的检验。

学习机是和统计有千丝万缕的联系,主要是归纳总结, 只要求结果好用,不一定完全的精确。

这和人类的经验类似,没有严格的因果, 不确保十拿九稳,拼凑出来,够用就好。

一命二运三风水,四积阴德五读书。 六名七相八敬神,九交贵人十养生,这些组合在一起,你能看出什么严格的因果?

4:神经网络算法为什么可以做一个学习机?

这是模拟人脑的学习概念来建立的模型,和诸多的设计学习生物一致。

我们自身的学习过程,包含输入各种过往的知识和经验,获得对常识,经验的判断,形成一个认知系统,再通过这个认知系统来观察未知的世界。 经文里面也写过 色--受---想---形---识, 一套循环往复的认知过程。

那么我么学习的局限在哪呢?

1: 知识的存取效率;

2: 计算的速度;

3: 情感大脑的影响(疲惫,焦虑,恐惧,兴奋);

4:其它等等;

导致我们不能长时间的, 高效的处理学习。由此演化的机器学习能够弥补缺陷。

那么能否通过机器来模拟我们的认知体系呢? 处理未知?

答案是Yes 。

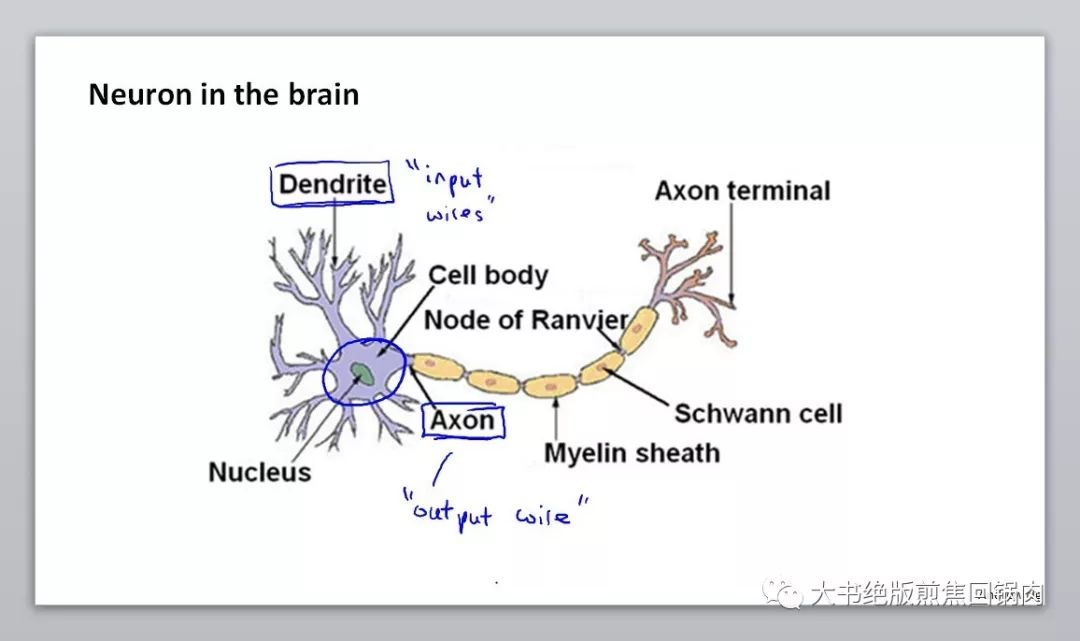

最直观的建造方法是模拟人类的神经元,构建类似人脑的网络。

-----------------------------------------------------------------------------

THE BEAUTY

OF PROJECT

构建这样的一个网络需要三个步骤。

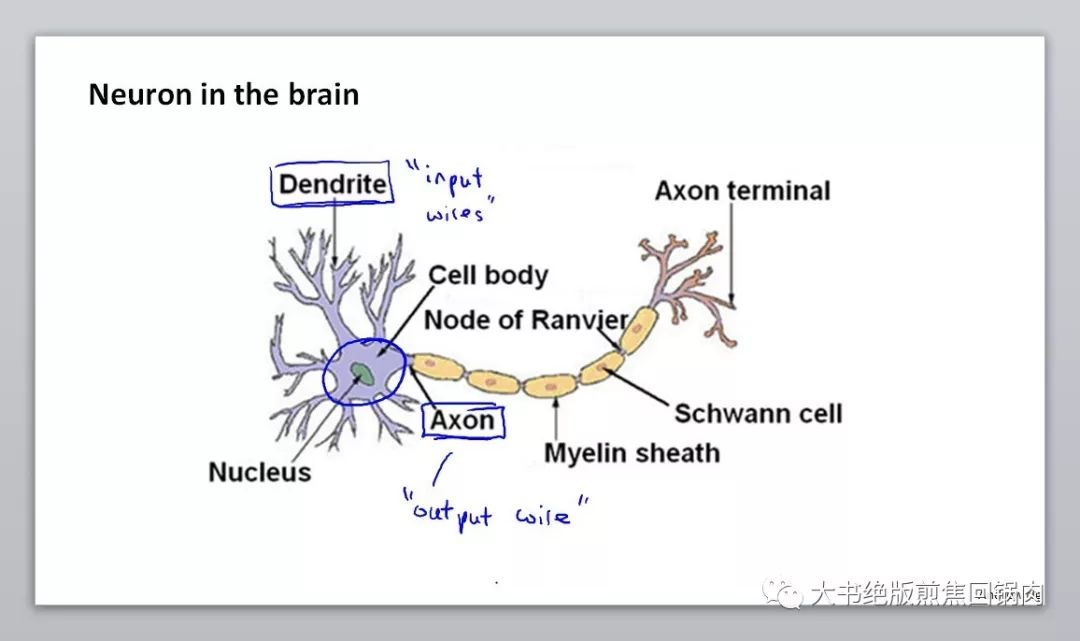

1:找到构建的最基本结构----神经元;

2:将最基本结构组合成一个特定的大结构----神经网络(存储,传递信息);

3:在大结构上建立策略,实现功能----神经网络算法(辨别,预测未知);

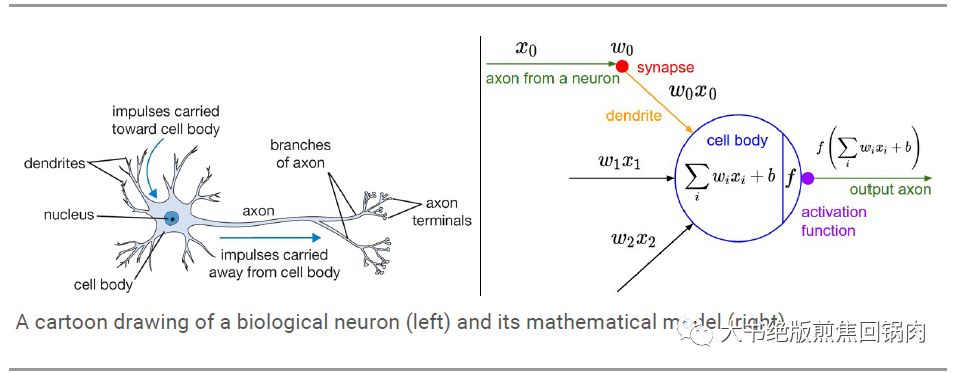

神经元如下图所示,生物学的各路大神应该解释的更清楚, 抽象到数学上简而言之,一个神经元节点, 收到N个其他节点的输入,每个输入有不同的权重, 所有的输入汇总,按照权重叠加,超过当前神经元阈值的,产生输出,否则没有输出。

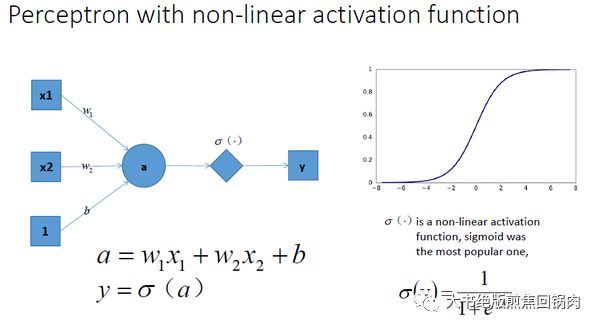

输出与否其实依赖一个激发函数。

具体长得如下样子, 不多解释了, 需要多了解的去网上查吧,民科不含太多数学内容, 本文的数学相关的内容到此为止, 下面开始讲经。

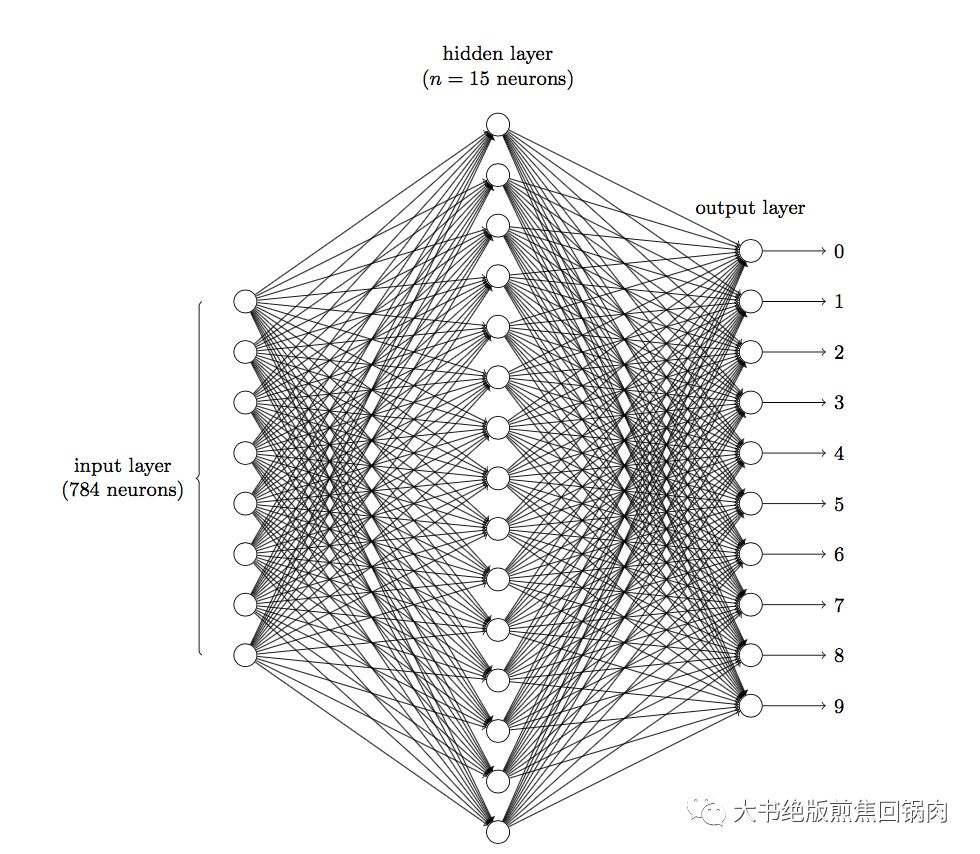

接下来是把这些神经元组合成网络,在不同层次的游戏规则是不一样的, 人类社会,自然科学都遵循这个道理。

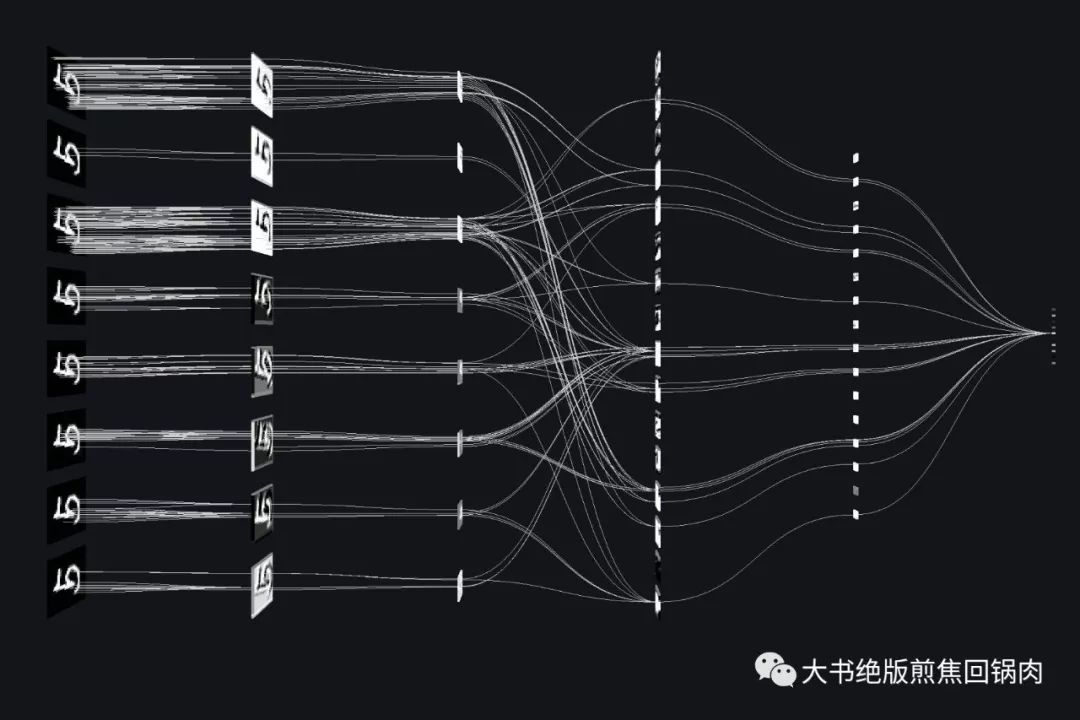

神经网络的组合模型如下

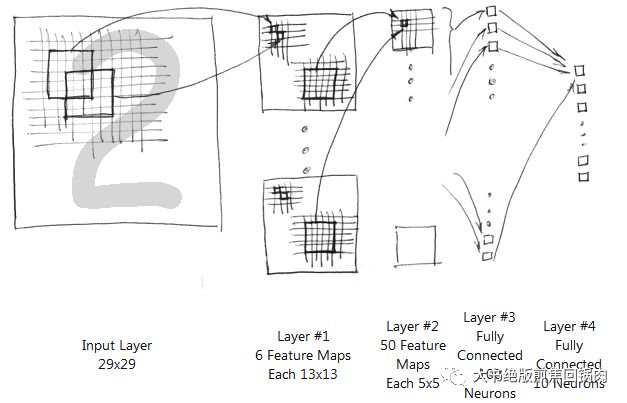

左边输入层, 右边输出层, 中间是隐藏层, 超过3层的称为多层神经网络。

层数越多+节点越多存储的信息量越多,意味着这个网络可以使识别的模式越多。排列组合去算吧,可以多种组合,理论上足以穷尽每一粒沙子。

简单来说,就是分解与整合, 但是技术难度也都在如何分解与如何整合之中。

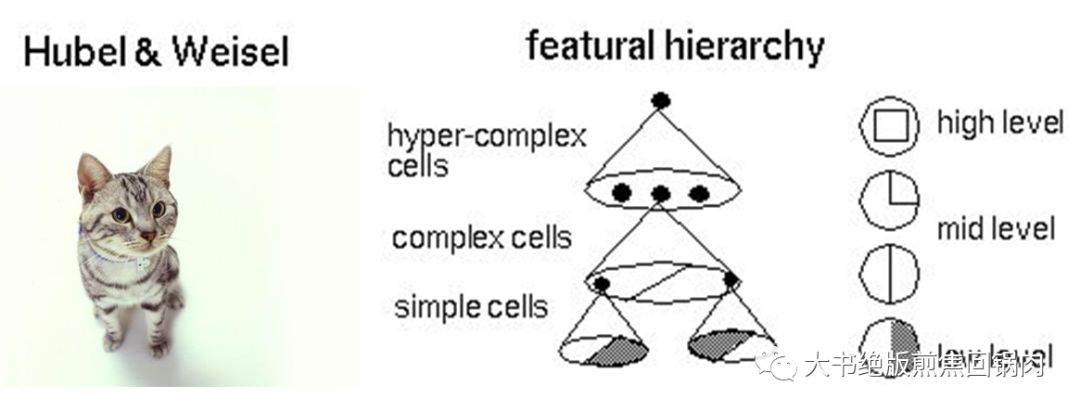

在著名的Hubel-Wiesel试验中,学者们研究猫的视觉分析机理是这样的。

Hubel-Wiesel试验与大脑视觉机理

一个正方形,分解为四个折线进入视觉处理的下一层中。

四个神经元分别处理一个折线。

每个折线再继续被分解为两条直线,每条直线再被分解为黑白两个面。

于是,一个复杂的图像变成了大量的细节进入神经元,神经元处理以后再逆向进行整合,最后得出了看到的是正方形的结论。

这是一个完整的先拆分,再结合的的神经网络工作的机理。

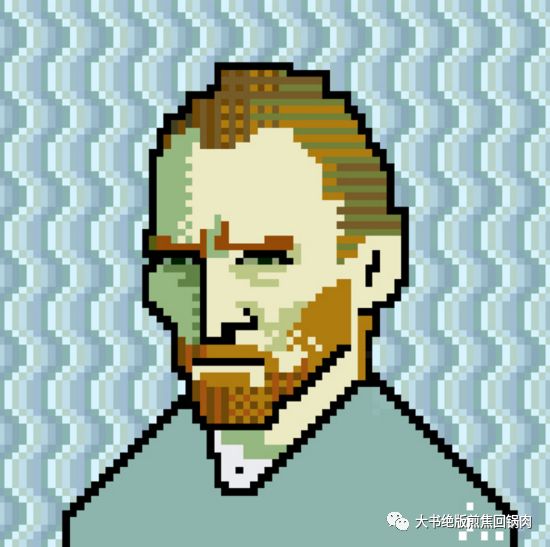

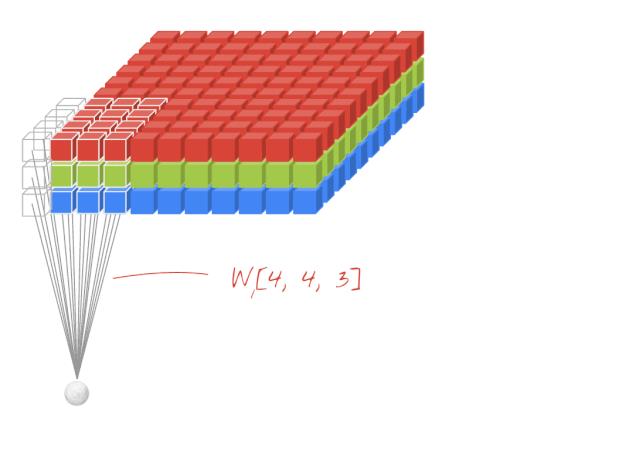

1:图像的分解有多种方法,有按照像素直接来拆分的, 有按照切片通过卷积的方式来拆分的, 这都属于专业内容, 本文不再讨论。

2:关于图像合成后的判断,这里有一个前提,以识别正方形为例, 在能够判定是正方形之前, 应该有一组不同版本的正方形先进行输入,训练这个网络,抽象出判断是正方形的判断特征。

所以技术的难题在这两个方面,

神经网络是贯穿分解与合成的通道。

7:神经网络最终的判断是如何形成的?

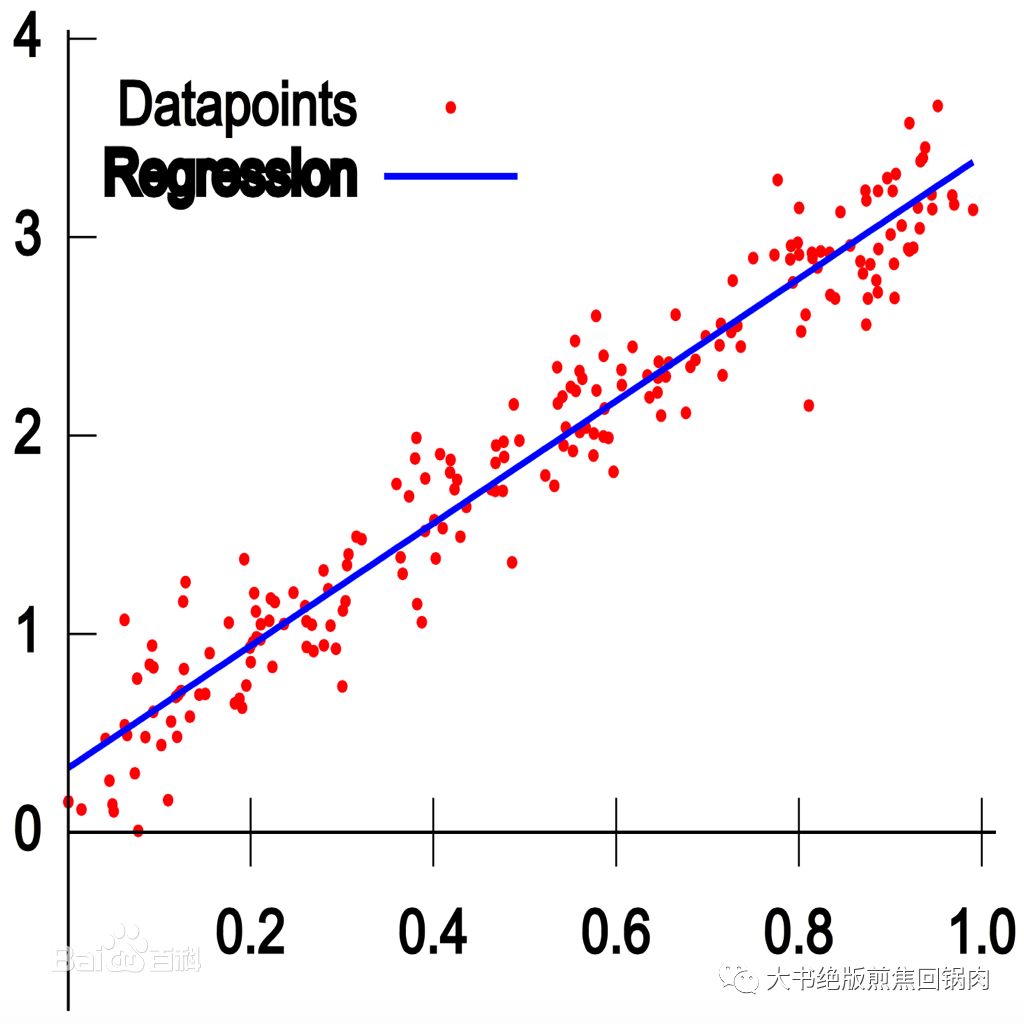

下面讲两个回归,线性回归&逻辑回归。

线性回归: 拟合一条线, 预测数值。一般可以用来预测走势数值

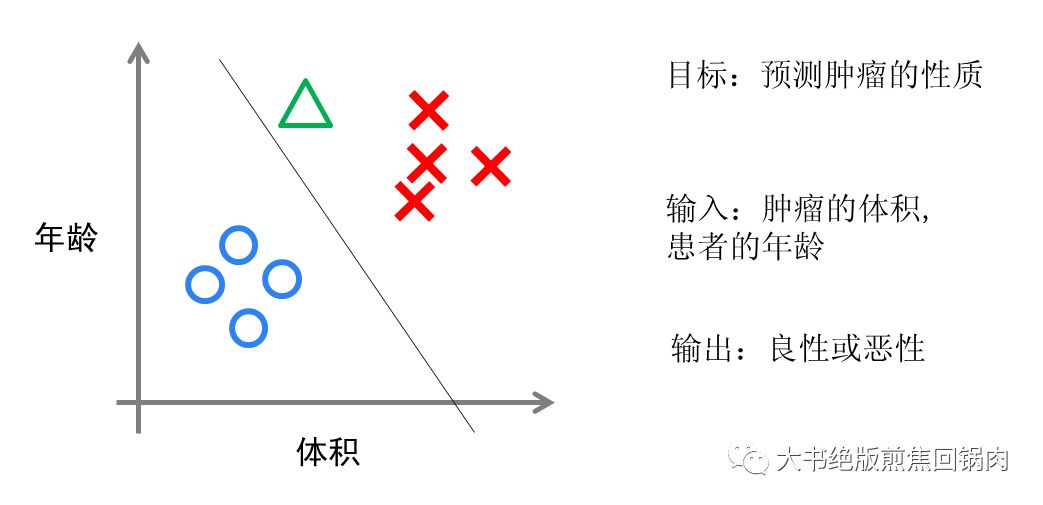

逻辑回归: 用于分类, 这里和统计分类重合度很高, 比如下图的关于肿瘤的预测,两个相关因素, 年龄和体积, 相关, 在象限中可以拟合一条直线,划分良性和恶性肿瘤,再基于此新出现的病例可以预测是良性还是恶性。

这里的预测还有一个成功率的问题, 在后面的文章中会讨论如何衡量一个预测算法是否是最有效的, 当然用的还是统计的知识体系。

神经网络算法搭建完毕之后,多用作逻辑回归的判定。类似,这个人是不是你本人,前方的障碍物是行人还是墙壁,等等。

8:启示录---神经网络算法

以下为作者自说自话

1:量大才是真---若有足够的场景来训练我们的神经网络, 可以提升我们预测未来新事物的准确性。

在诸多的可能性中, 最好的一种便是一开始你已经Well Train 了,孔子还对这类人打过标签,“生而知之者”, 拿着神经网络预测各种不同的新鲜事物, 无往而不利, 有点孔明的味道。

另外一大波,差不多就没有好运道了, 统称钝胎, 这其中无非是五十步笑百步。在剩下的时间长河之中,需要的事不断的在实际场景中调整算法, 以应对不同的Case,毕竟唯一不变的是变化。 那么还需要有足够的多的场景帮你验证有“瑕疵”的神经网络,贝叶斯大爷说的后验概率,调整系数 闪亮登场。

以工作为例, 多尝试不同职位,在不同的岗位之间切换, 在不同的行业之间切换, 在不同的项目中切换, 有助于你建立更加优质的神经网络,结果是你做出来的项目更加的符合干系人期望。当然和不同的人交往, 行遍万水千山,破万卷书也有帮助。在人生幸福上,从某个角度也鼓励各位青年才俊,多交男女朋友,多约一约, 作为输入打磨自己的算法。当然凡是都有风险,本文先不讨论这些。

2:无反馈不调整---BP 神经网络是最常用的神经网络算法,这个算法要求当预测结果和实际不一致的时候, 回去调整神经网络中某层某节点的输入权重以及激发函数,然后再来检测结果。观照到我们自身,无非是一个反思的过程, 不停的反思,调节过往的认知,再达到和实际相接近的结果。孔子说每日三省吾身,实际是在调整自己神经网络的参数, 以应对不断变化的外部环境,诞生新的策略以便行动,这才是真正的智慧。

3:万物皆有边界:------网络的容量不是无限的, 当然有其边界。超出边界行事,不可测,可能好可能坏,谁知道呢?不过日常经验告诉我们,多半没什么好事,FEMA 中会说超出设计的边界后, 会失效失灵。基于此 并不能路行的越多越好, 书读的越多越好,每个人的系统都不一样, 量力而行,超出边界的东西会溢出, 脑袋爆掉有点夸张, 头晕目眩总是免不了的。

4:抹不掉的痕迹------ 凡事皆有代价, 既定形成的神经网络想要调整,需要有事件来Trigger后产生了重要的反馈后再反思进入第一次调整, 再Trigge形成r反馈, 再调整, 这个过程到最后形成定式可能需要多次。远没有一开始刻画输入来的便捷。每一次的调整都会留下痕迹, 若大的神经网络改到完全没有原来初始的痕迹是不可能的,暗含的意思在于,即便在意识中我们已经忘却了过往发生的种种事情,在潜意识中, 在神经网络的边边角角中还有存在, 好的,坏的,都在,一直都在, 午夜梦回之时或在某个激发的时刻,总会时光回朔,触景生情。

5: 谁能永不放弃----- 最后生物神经毕竟不是硅造生命,想改便改,也没有那么坚固可以多次改变。每逢大变,都会改造既有的网络, 一次两次也就罢了, 屡遭变迁的人精神多少有些问题,神经可经不起反复的折腾。你可以创业个三五次, 但禁不起两位数的折腾,这些就不赘言了, 心里明白便好,对成功学之流多一些约束。

文字 / 肯扬

吹水 / 绝版尖叫回锅肉

水磨大脑,胡吃海喝

以上是关于PMP 小鸟项目回忆录—神经网络算法&启示的主要内容,如果未能解决你的问题,请参考以下文章