干货 | 史上最全中文分词工具整理

Posted 磐创AI

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了干货 | 史上最全中文分词工具整理相关的知识,希望对你有一定的参考价值。

作者 | fendouai

编辑 | 安可

出品 | 磐创AI技术团队

一.中文分词

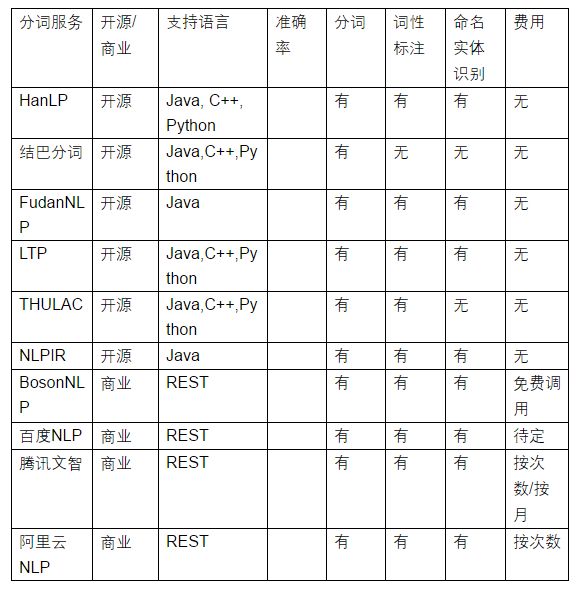

分词服务接口列表

二.准确率评测:

THULAC:与代表性分词软件的性能对比

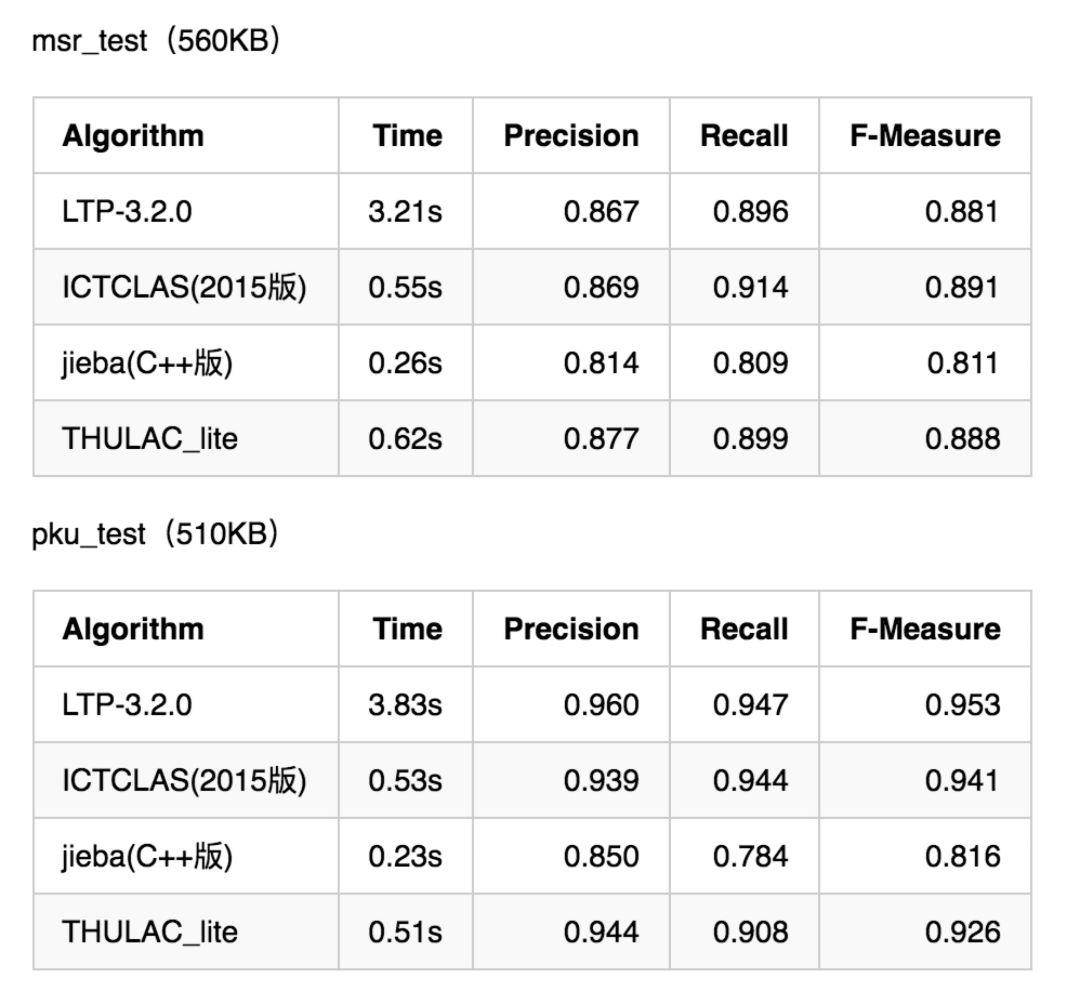

我们选择LTP-3.2.0 、ICTCLAS(2015版) 、jieba(C++版)等国内具代表性的分词软件与THULAC做性能比较。我们选择Windows作为测试环境,根据第二届国际汉语分词测评(The SecondInternational Chinese Word Segmentation Bakeoff)发布的国际中文分词测评标准,对不同软件进行了速度和准确率测试。

在第二届国际汉语分词测评中,共有四家单位提供的测试语料(Academia Sinica、 City University 、Peking University 、MicrosoftResearch), 在评测提供的资源icwb2-data中包含了来自这四家单位的训练集(training)、测试集(testing), 以及根据各自分词标准而提供的相应测试集的标准答案(icwb2-data/scripts/gold).在icwb2-data/scripts目录下含有对分词进行自动评分的perl脚本score。

我们在统一测试环境下,对上述流行分词软件和THULAC进行了测试,使用的模型为各分词软件自带模型。THULAC使用的是随软件提供的简单模型Model_1。评测环境为 Intel Core i5 2.4 GHz 评测结果如下:

评测结果1

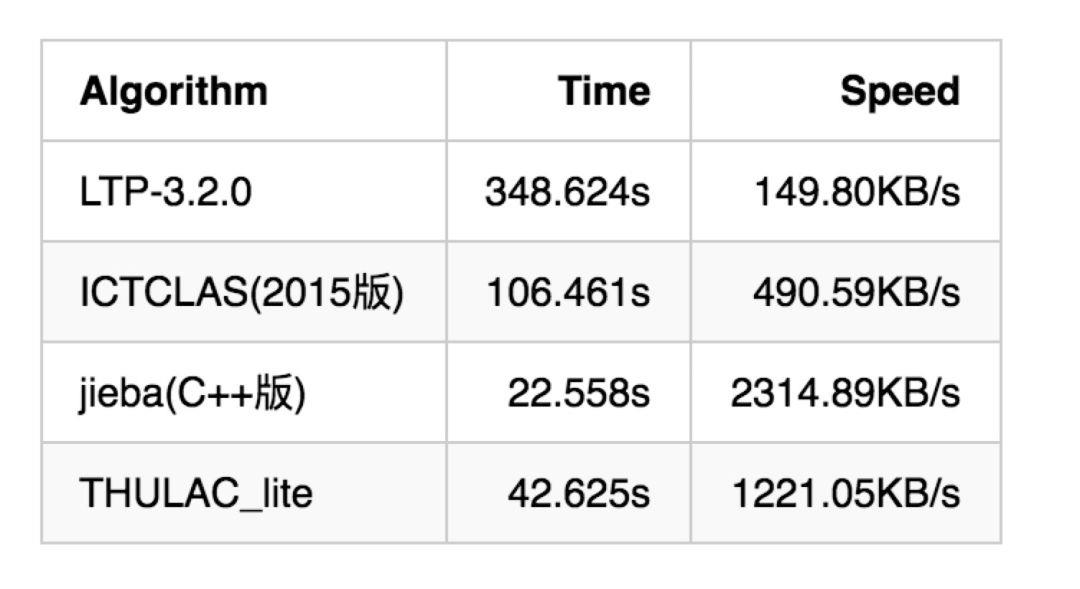

除了以上在标准测试集上的评测,我们也对各个分词工具在大数据上的速度进行了评测,结果如下:

CNKI_journal.txt(51 MB)

评测结果2

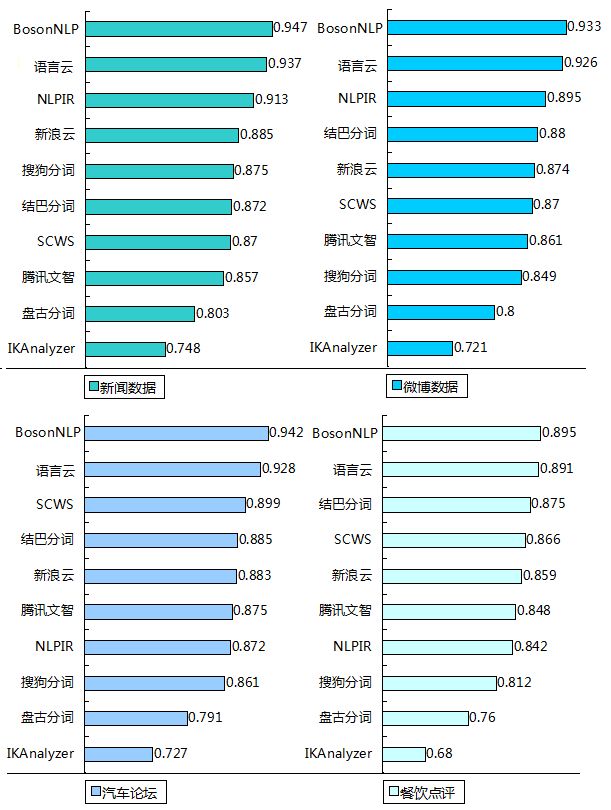

分词数据准备及评测由BosonNLP完成:11 款开放中文分词引擎大比拼(2015年发布)

分词的客观量化测试离不开标注数据,即人工所准备的分词“标准答案”。在数据源方面,我们将测试分为: 1.新闻数据:140篇,共30517词语; 2.微博数据:200篇,共12962词语; 3.汽车论坛数据(汽车之家)100篇:共27452词语; 4.餐饮点评数据(大众点评):100条,共8295词语。

准确度计算规则:

将所有标点符号去除,不做比较

参与测试的部分系统进行了实体识别,可能造成词语认定的不统一。我们将对应位置替换成了人工标注的结果,得到准确率估算的上界。

经过以上处理,用SIGHAN 分词评分脚本比较得到最终的准确率,召回率和F1值。

不同分词系统的分词准确度对比

三.付费价格:

阿里云:

阿里云付费价格

腾讯云:

腾讯云付费价格

玻森中文

免费额度:

玻森中文免费额度

付费价格:

玻森中文付费价格

四.官网

开源工具

HanLP:

https://github.com/hankcs/HanLP

结巴分词:

https://github.com/fxsjy/jieba

盘古分词:

http://pangusegment.codeplex.com/

庖丁解牛:

https://code.google.com/p/paoding/

SCWS中文分词:

http://www.xunsearch.com/scws/docs.php

高校工具

FudanNLP:

https://github.com/FudanNLP/fnlp

LTP:

http://www.ltp-cloud.com/document

THULAC:

http://thulac.thunlp.org/

NLPIR:

http://ictclas.nlpir.org/docs

商业服务

BosonNLP:

http://bosonnlp.com/dev/center

百度NLP:

https://cloud.baidu.com/doc/NLP/NLP-API.html

搜狗分词:

http://www.sogou.com/labs/webservice/

腾讯文智:

https://cloud.tencent.com/document/product/271/2071

腾讯价格单:

https://cloud.tencent.com/document/product/271/1140

阿里云NLP:

https://data.aliyun.com/product/nlp

新浪云:

http://www.sinacloud.com/doc/sae/python/segment.html

测试数据集

1、SIGHANBakeoff 2005 MSR, 560KB

http://sighan.cs.uchicago.edu/bakeoff2005/

2、SIGHANBakeoff 2005 PKU, 510KB

http://sighan.cs.uchicago.edu/bakeoff2005/

3、人民日报 2014,65MB

https://pan.baidu.com/s/1hq3KKXe

前两个数据集是SIGHAN于2005年组织的中文分词比赛所用的数据集,也是学术界测试分词工具的标准数据集,本文用于测试各大分词工具的准确性,而最后一个数据集规模较大,用于测试分词速度。

你也许还想看:

欢迎扫码关注:

点击下方 | 阅读原文 | 了解更多

以上是关于干货 | 史上最全中文分词工具整理的主要内容,如果未能解决你的问题,请参考以下文章