365天深度学习训练营 P1

Posted WHS-_-2022

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了365天深度学习训练营 P1相关的知识,希望对你有一定的参考价值。

目录

>- **🍨 本文为[🔗365天深度学习训练营](https://mp.weixin.qq.com/s/xLjALoOD8HPZcH563En8bQ) 中的学习记录博客**

>- **🍦 参考文章:[365天深度学习训练营-第P1周:实现mnist手写数字识别](https://mp.weixin.qq.com/s/00Z7negmsNuYSHY6nqeEWA)**

>- **🍖 原作者:[K同学啊|接辅导、项目定制](https://mtyjkh.blog.csdn.net/)**

一.前期准备

1.准备GPU

import torch

import torch.nn as nn

import torchvision.transforms as transforms

import torchvision

from torchvision import transforms, datasets

import os,PIL,pathlib

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device我这里一开始出现了一点小问题,torch.cuda.is_available()一直显示是FALSE。后来我Print了版本号,发现是确实CPU版本。

import torch

print(torch.cuda.is_available())

print(torch.__version__)

后来我找到了一篇文章《使用GPU进行深度学习环境的搭建》成功解决了问题

————————————————

版权声明:本文为CSDN博主「一只小小的土拨鼠」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/qq_40379132/article/details/124869378

中间有一个插曲,我是用Pycharm搭建的。pip后下载的文件不会放到pycharm的site-packages文件夹中,所以需要自己手动赋值到里面。成功后如图所示,torch后面有cu116。

2.导入数据

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

import torchvision

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

train_ds = torchvision.datasets.MNIST('data',

train=True,

transform=torchvision.transforms.ToTensor(), # 将数据类型转化为Tensor

download=True)

test_ds = torchvision.datasets.MNIST('data',

train=False,

transform=torchvision.transforms.ToTensor(), # 将数据类型转化为Tensor

download=True)

batch_size = 32

train_dl = torch.utils.data.DataLoader(train_ds,

batch_size=batch_size,

shuffle=True)

test_dl = torch.utils.data.DataLoader(test_ds,

batch_size=batch_size)

# 取一个批次查看数据格式

# 数据的shape为:[batch_size, channel, height, weight]

# 其中batch_size为自己设定,channel,height和weight分别是图片的通道数,高度和宽度。

imgs, labels = next(iter(train_dl))

print(imgs.shape)

print(labels.shape)

'''

iter返回的是一个迭代器,使用next函数可以从迭代器中取出具体的值。

torch.Size([32, 1, 28, 28])

torch.Size([32])

'''简略的查了一下next和iter函数,发现具体的作用就是next生成一个迭代器,next从迭代器中取出具体的值。

3. 数据可视化

第一次复现经典的MNIST数据集,可视化一下。

import numpy as np

# 指定图片大小,图像大小为20宽、5高的绘图(单位为英寸inch)

plt.figure(figsize=(20, 5))

for i, imgs in enumerate(imgs[:20]):

# 维度缩减

# imgs Tensor(1,28,28)

npimg = np.squeeze(imgs.numpy())

# 将整个figure分成2行10列,绘制第i+1个子图。

plt.subplot(2, 10, i+1)#绘制子图

plt.imshow(npimg, cmap=plt.cm.binary)#cmap的备注 The Colormap instance or registered colormap name used to map scalar data to colors.

plt.axis('on')

#plt.show()

plt.imshow似乎是用来画2D的图片的,所以需要squeeze(imgs.numpy()),变成二维的dnumpy类型。

#cmap的备注 The Colormap instance or registered colormap name used to map scalar data to colors. cmap是color map的简称,用来确定是画什么类型的图

二、构建CNN

import torch.nn.functional as F

num_classes = 10 # 图片的类别数

class Model(nn.Module):

def __init__(self):

super().__init__()

# 特征提取网络

self.conv1 = nn.Conv2d(1, 32, kernel_size=3) # 第一层卷积,卷积核大小为3*3,卷积核的数量是32

self.pool1 = nn.MaxPool2d(2) # 设置池化层,池化核大小为2*2

self.conv2 = nn.Conv2d(32, 64, kernel_size=3) # 第二层卷积,卷积核大小为3*3

self.pool2 = nn.MaxPool2d(2)

# 分类网络

self.fc1 = nn.Linear(1600, 64)

self.fc2 = nn.Linear(64, num_classes)

# 前向传播

def forward(self, x):

x = self.pool1(F.relu(self.conv1(x)))

x = self.pool2(F.relu(self.conv2(x)))

x = torch.flatten(x, start_dim=1)

'''

Flattens input by reshaping it into a one-dimensional tensor.

If start_dim or end_dim are passed, only dimensions starting with start_dim and ending with end_dim are flattened.

具体见CSDN,将索引为 start_dim 和 end_dim 之间(包括该位置)的数量相乘,其余位置不变。

t = torch.tensor([[[1, 2, 2, 1],

[3, 4, 4, 3],

[1, 2, 3, 4]],

[[5, 6, 6, 5],

[7, 8, 8, 7],

[5, 6, 7, 8]]])

print(t, t.shape)

运行结果:

torch.Size([2, 3, 4])

'''

x = F.relu(self.fc1(x))

x = self.fc2(x)

return x

from torchinfo import summary

# 将模型转移到GPU中(我们模型运行均在GPU中进行)

model = Model().to(device)

#Summarize the given PyTorch model

summary(model)

三、正式训练

1. model.train()

model.train()的作用是启用 Batch Normalization 和 Dropout。如果模型中有

BN层(Batch Normalization)和Dropout,需要在训练时添加model.train()。model.train()是保证BN层能够用到每一批数据的均值和方差。对于Dropout,model.train()是随机取一部分网络连接来训练更新参数。2. model.eval()

model.eval()的作用是不启用 Batch Normalization 和 Dropout。如果模型中有BN层(Batch Normalization)和Dropout,在测试时添加

model.eval()。model.eval()是保证BN层能够用全部训练数据的均值和方差,即测试过程中要保证BN层的均值和方差不变。对于Dropout,model.eval()是利用到了所有网络连接,即不进行随机舍弃神经元。训练完train样本后,生成的模型model要用来测试样本。在

model(test)之前,需要加上model.eval(),否则的话,有输入数据,即使不训练,它也会改变权值。这是model中含有BN层和Dropout所带来的的性质。

BN层和Dropout层不是很理解,等以后明白了补上了再写。

epochs = 5

train_loss = []

train_acc = []

test_loss = []

test_acc = []

for epoch in range(epochs):

model.train()

epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, opt)

model.eval()

epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)

train_acc.append(epoch_train_acc)

train_loss.append(epoch_train_loss)

test_acc.append(epoch_test_acc)

test_loss.append(epoch_test_loss)

template = ('Epoch::2d, Train_acc::.1f%, Train_loss::.3f, Test_acc::.1f%,Test_loss::.3f')

print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss, epoch_test_acc*100, epoch_test_loss))

print('Done')四、结果可视化

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") #忽略警告信息

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 #分辨率

epochs_range = range(epochs)

plt.figure(figsize=(12, 3))

plt.subplot(1, 2, 1)

plt.plot(epochs_range, train_acc, label='Training Accuracy')

plt.plot(epochs_range, test_acc, label='Test Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')

plt.subplot(1, 2, 2)

plt.plot(epochs_range, train_loss, label='Training Loss')

plt.plot(epochs_range, test_loss, label='Test Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()

图片看起来还行,但是当Test Accuracy 达到99.0%的时候,训练集的正确率会上升,但是Test集会下降,应该是过拟合了。因为篇幅受限,就不放图片了。

五、总结

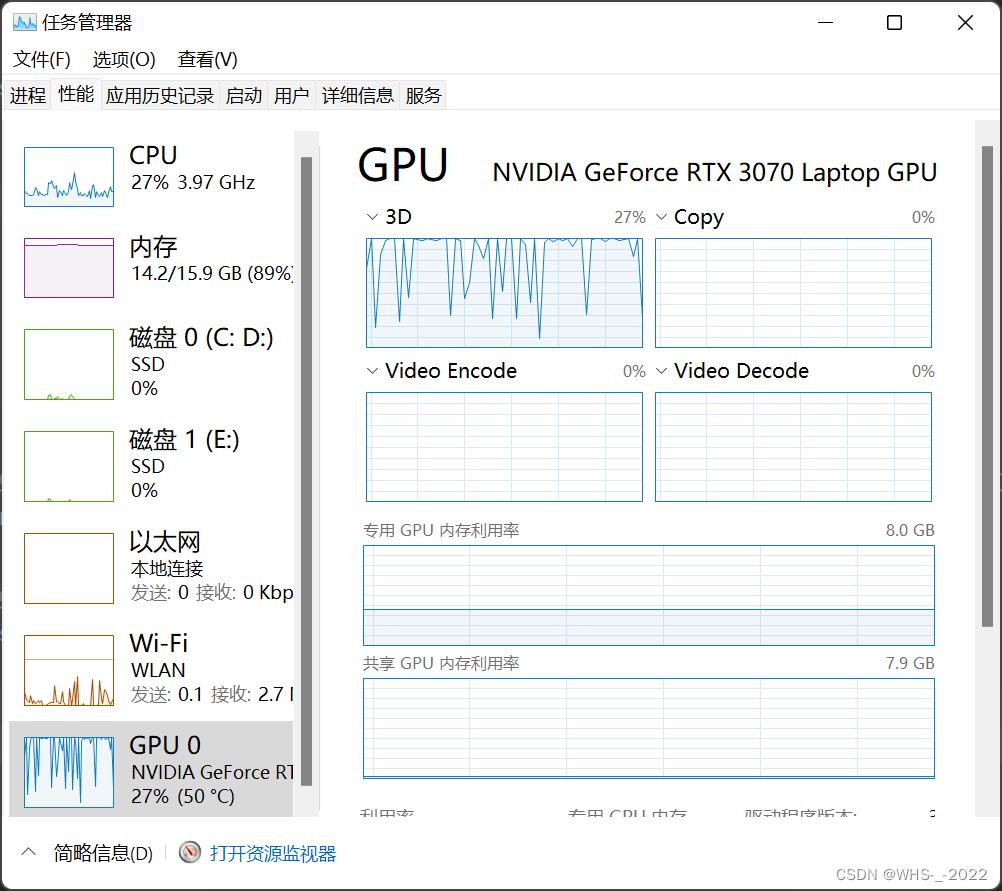

最开心的一点,我成功搞定了GPU环境的配置了!!!

瞧瞧这RTX,还算赏心悦目,终于在打游戏之外跑满显卡了!开森!

以上是关于365天深度学习训练营 P1的主要内容,如果未能解决你的问题,请参考以下文章