Attention Mechanisms in Computer Vision: A Survey

Posted 智安科技*

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Attention Mechanisms in Computer Vision: A Survey相关的知识,希望对你有一定的参考价值。

接上一篇博客:Attention Mechanisms in Computer Vision: A Survey(二)

我又回来了,这篇综述简直信息量巨大,这是我第三天消化这篇综述了,有兴趣的同学可以读一下原文。

一、Branch Attention

分支注意可以被看作是一种动态的分支选择机制:注意哪个分支,与多分支结构一起使用。

(一)、Highway networks

受长短期记忆网络的启发,Srivastava等人提出了Highway networks,该网络采用自适应选通机制,使信息能够跨层流动,以解决训练非常深层网络的问题。 假设一个普通的神经网络由L层组成,并且

H

l

(

X

)

H_l(X)

Hl(X)表示第L层上的非线性变换,那么Highway networks可以表示为

T

l

(

X

)

T_l(X)

Tl(X)表示调节第l层的信息流的变换门。

X

l

X_l

Xl和

Y

l

Y_l

Yl是第l层的输入和输出。

选通机制和跳接结构使得使用简单的梯度下降方法直接训练非常深的Highway networks成为可能。与固定跳过连接不同,选通机制适应输入,这有助于跨层路由信息。Highway networks可以并入任何CNN。

(二)SKNet

(三)、CondConv

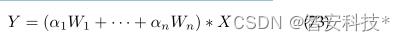

CNN中的一个基本假设是所有卷积核都是相同的。一般情况下增强网络表现力的典型方法是增加其深度或宽度,这会带来大量额外的计算成本。为了更有效地提高卷积神经网络的容量,Yang等人提出了一种新的多分支算子CondConv,可以定义一个普通的卷积 :

∗ 表示卷积。所有样本的可学习参数W都相同。CondConv自适应地组合了多个卷积核,可以写成:

α是一个可学习的权重向量

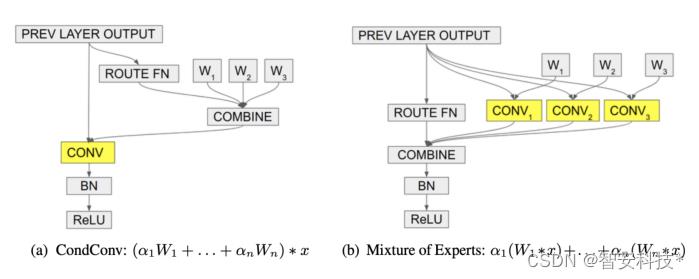

这个过程相当于多个experts的集合,如下图所示:

CondConv充分利用了多分支结构的优点,采用了一种计算量小的分支注意方法。它提供了一种有效提高网络容量的新方法。

(四)、Dynamic Convolution

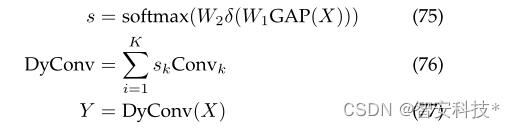

轻量级CNN极低的计算成本限制了网络的深度和宽度,进一步降低了其代表性。为了解决上述问题,Chen等人提出了动态卷积,这是一种新的算子设计,可以增加表征能力,但额外的计算成本可以忽略不计,并且不会与CondConv并行改变网络的宽度或深度。 动态卷积使用K个大小和输入/输出维度相同的并行卷积核,而不是每层一个核。与SE块一样,它采用挤压和激励机制为不同的卷积核生成注意权重。这些卷积核通过加权求和动态聚合,并应用于输入特征映射X:

卷积通过卷积核的权重和偏差之和进行组合。

与将卷积应用于特征映射相比,压缩、激励和加权求和的计算成本极低。因此,动态卷积提供了一种有效的操作来提高表示能力,并且可以轻松地用作任何卷积的替代品。

以上是关于Attention Mechanisms in Computer Vision: A Survey的主要内容,如果未能解决你的问题,请参考以下文章