卷积层里的填充Padding和步幅Stride 动手学深度学习v2 pytorch

Posted AI架构师易筋

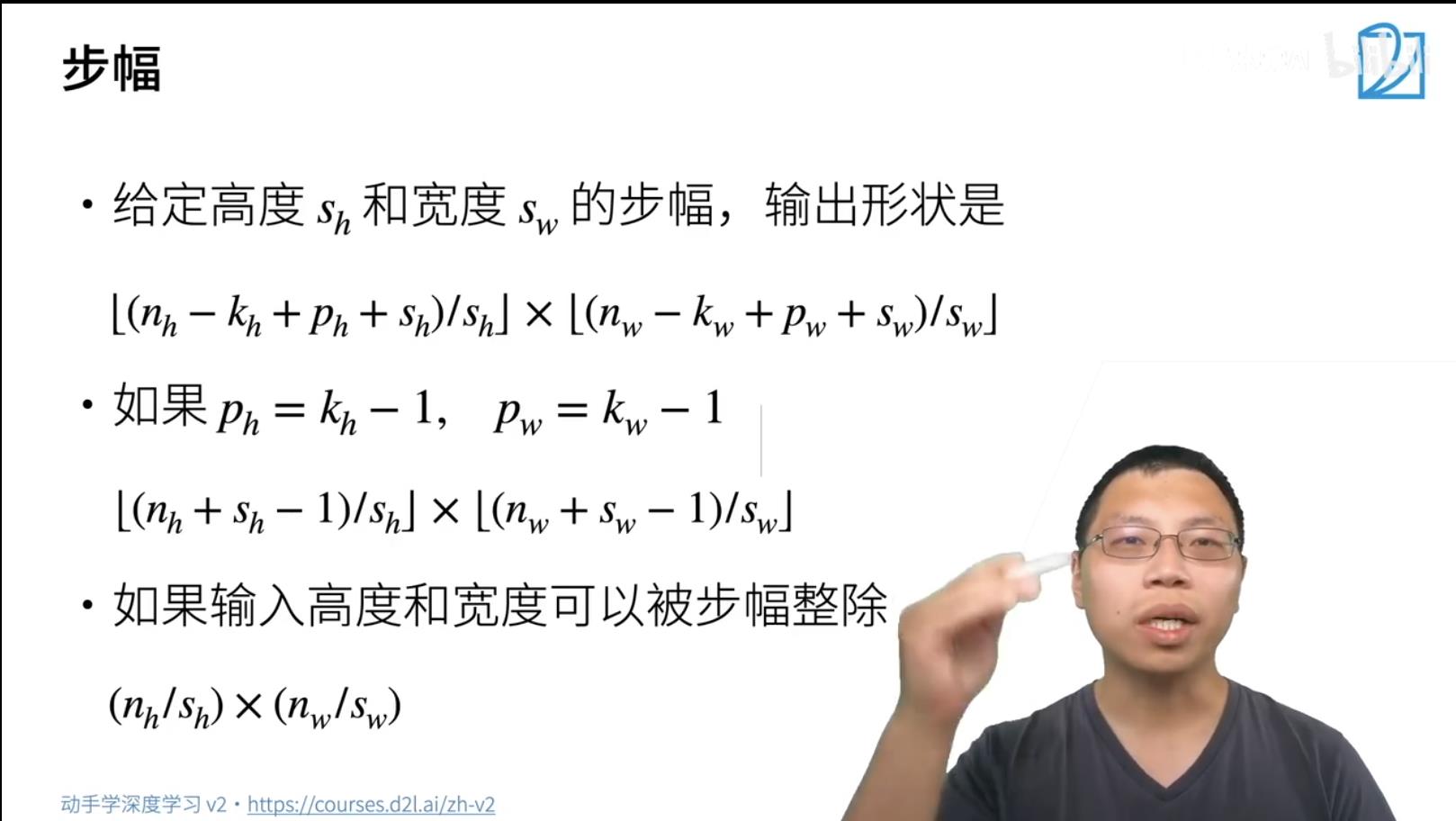

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了卷积层里的填充Padding和步幅Stride 动手学深度学习v2 pytorch相关的知识,希望对你有一定的参考价值。

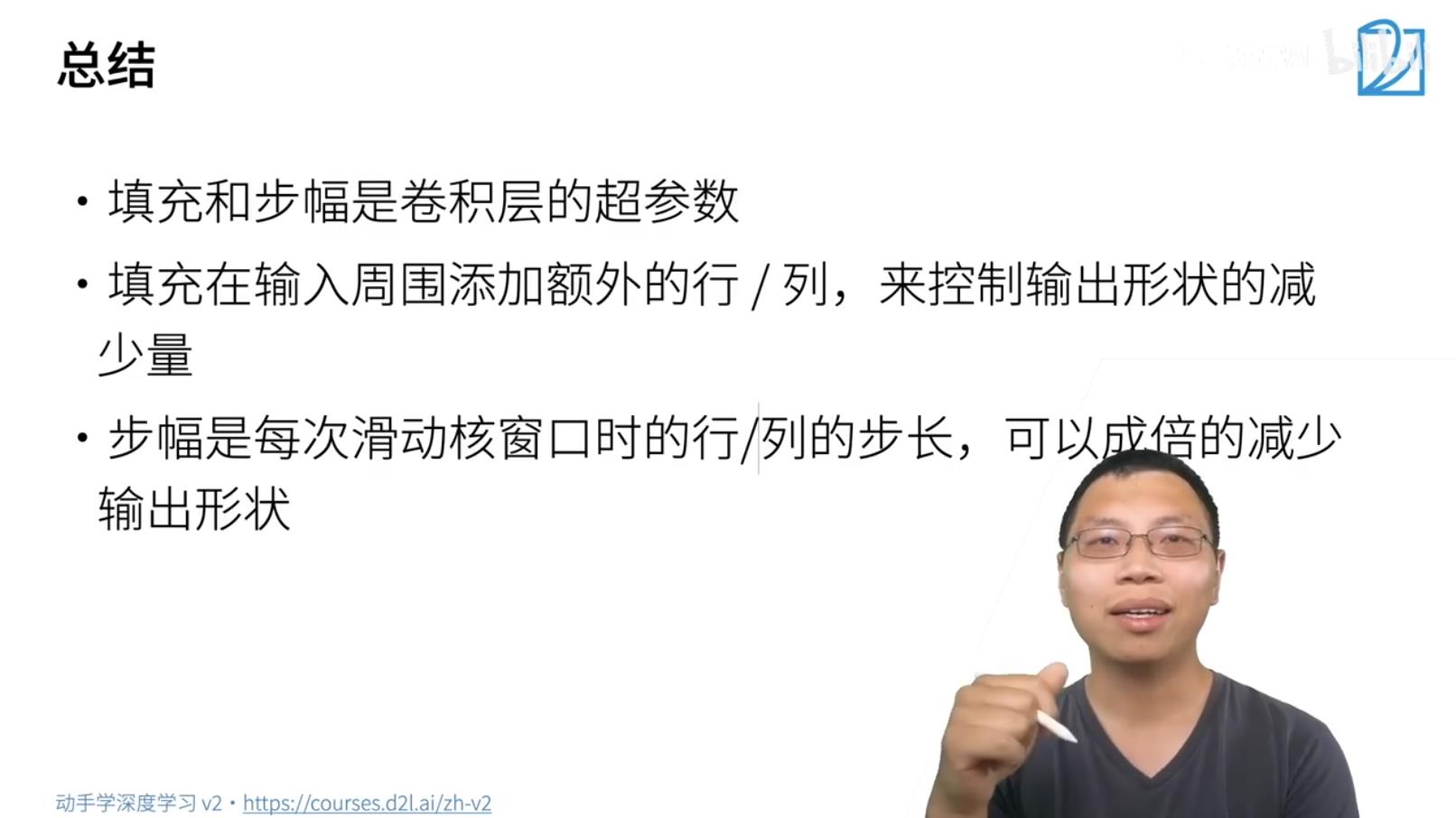

卷积层的超参数:

- Kernel卷积核的大小

- 填充Padding

- 步幅Stride

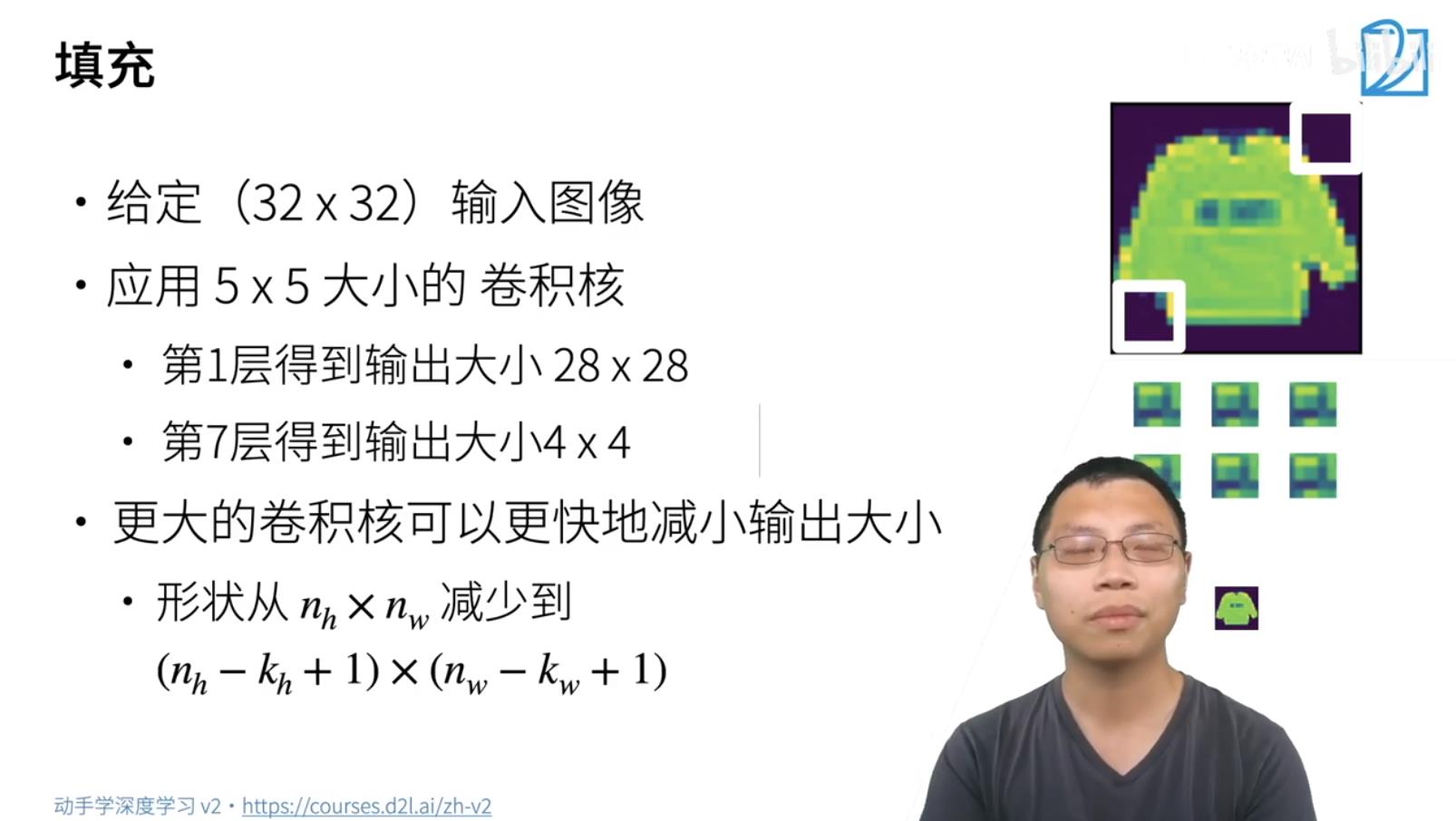

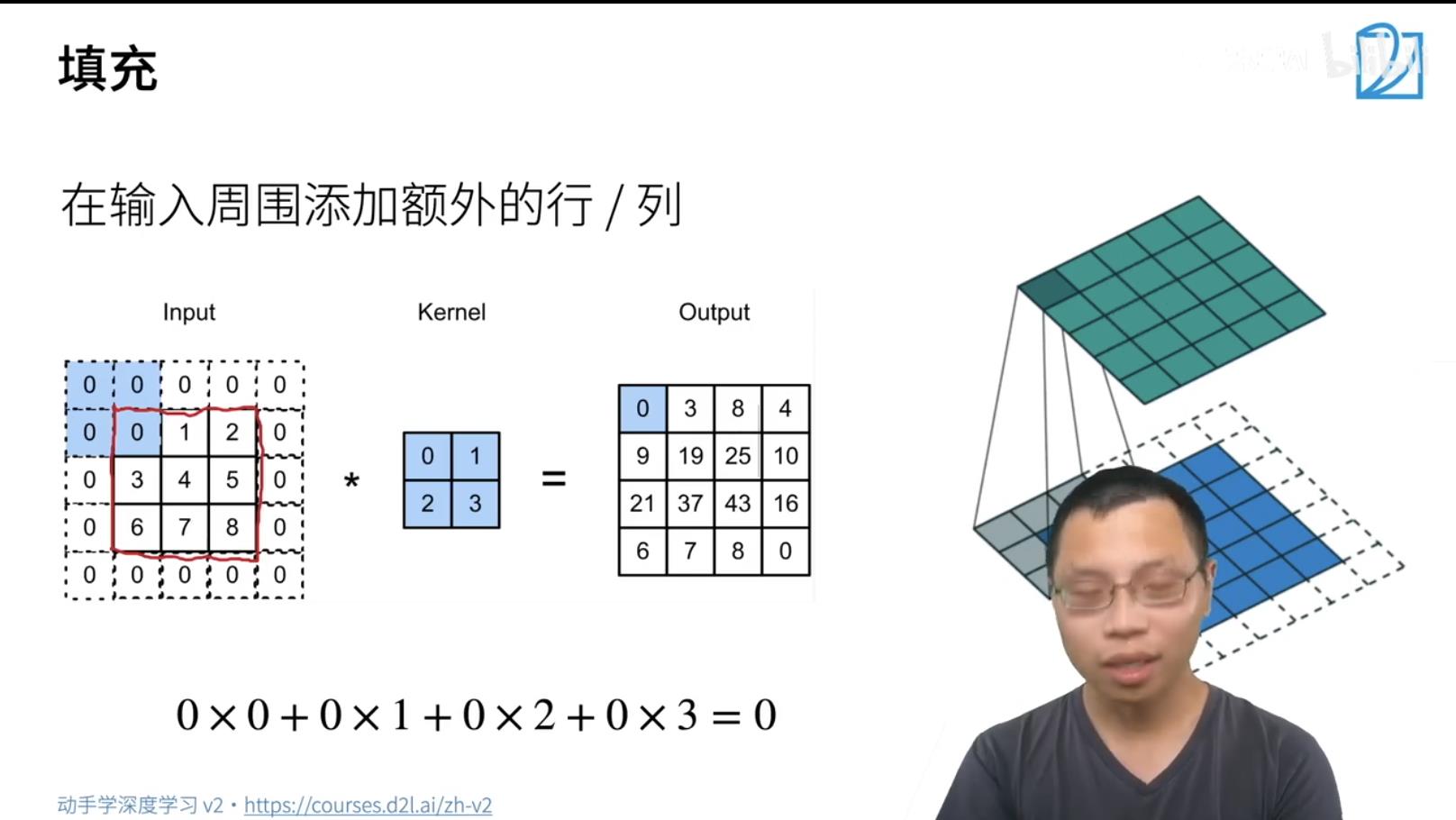

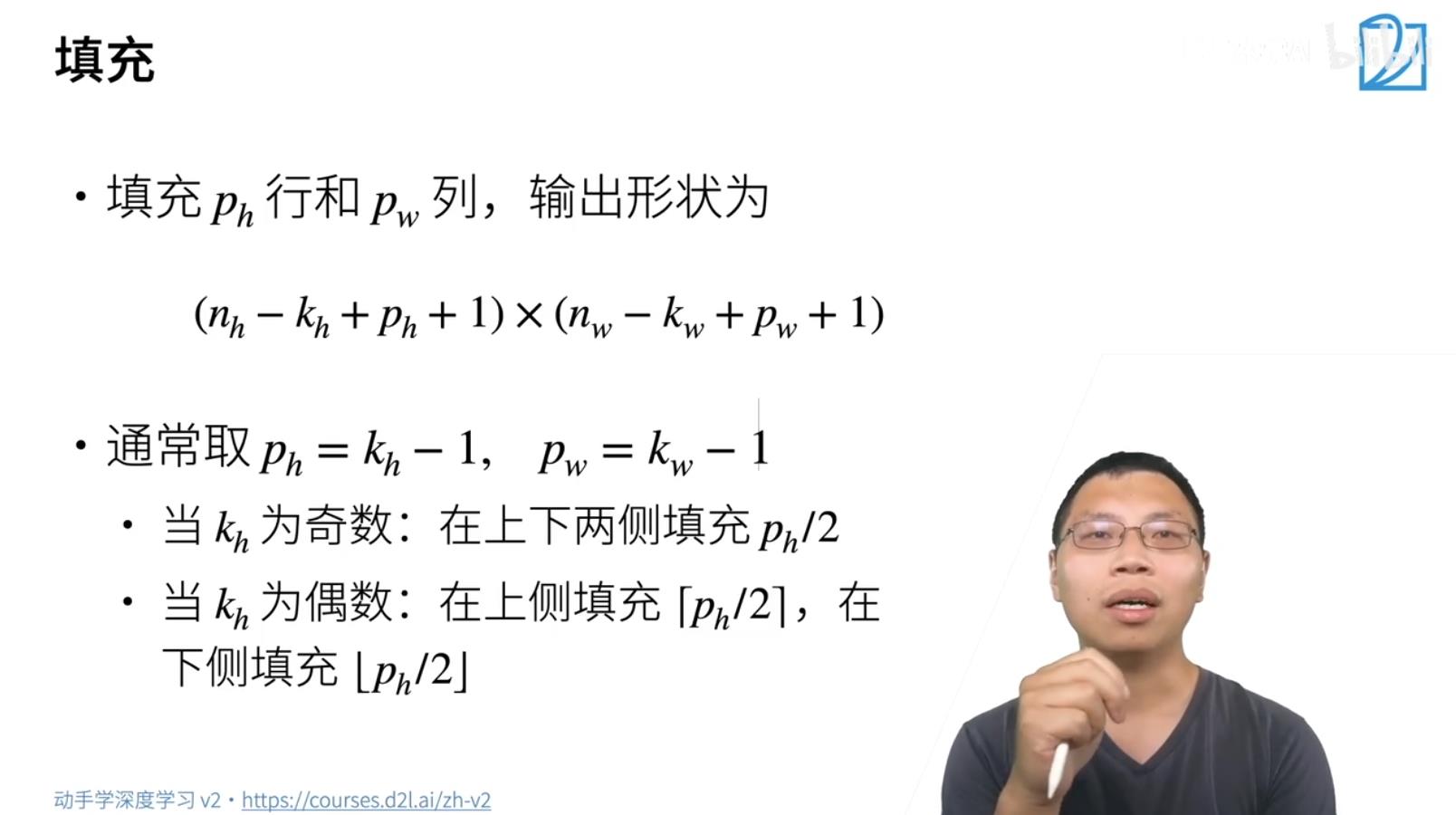

1. 卷积层里的填充Padding

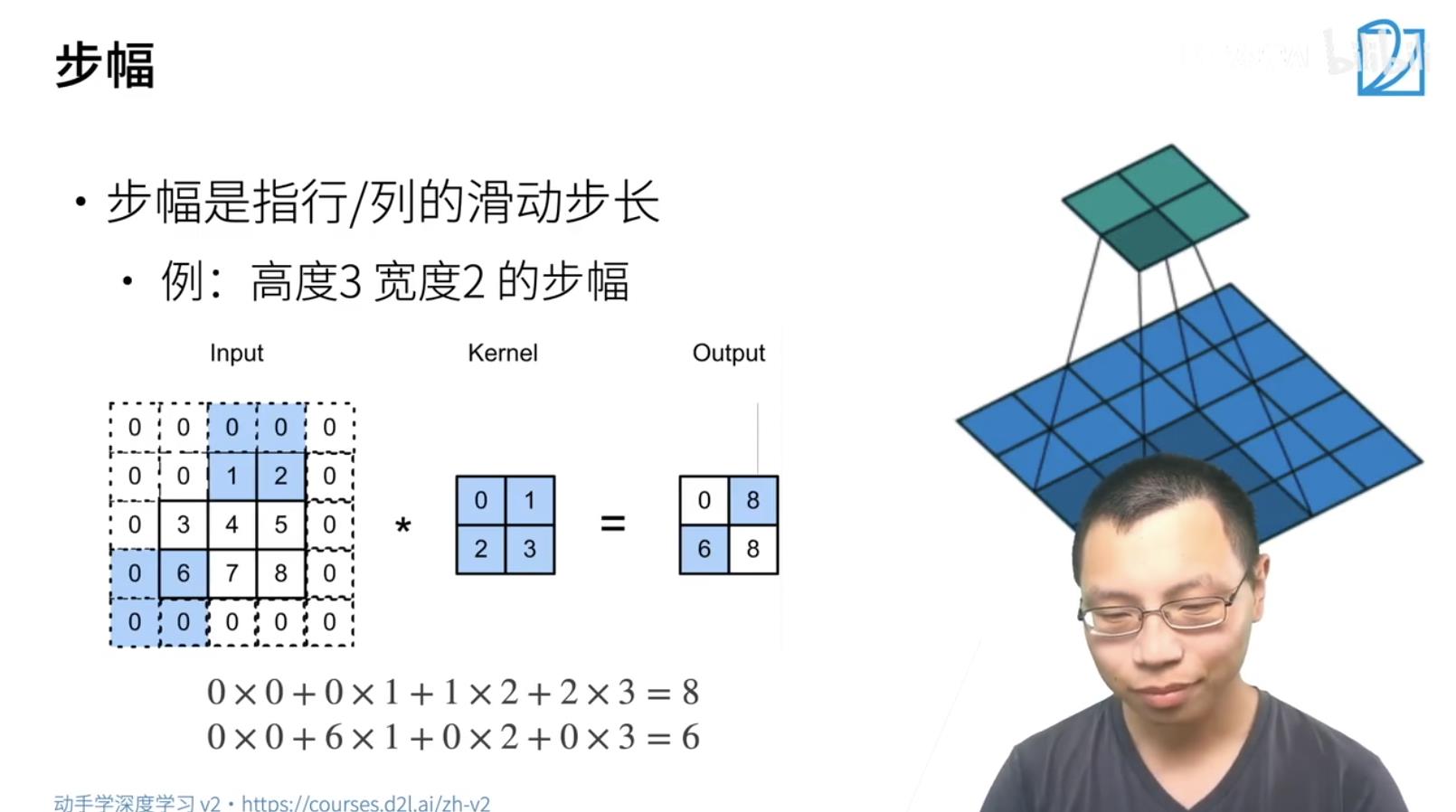

2 卷积层里的步幅Stride

3. 代码实现

3. Q&A

-

- 超参数 核大小,填充一般是核大小-1,步幅一般看是否需要优化计算的速度。

-

- 卷积核的变长一般选奇数,方便计算。

-

- 一般大家直接用经典的网络结构,比如 ResNet 用的居多。

-

- 机器学习本质就是压缩的算法,机器学习永远都会丢失信息的,跟信息论是一样的。

-

- 底层用大Kernel,上层用小Kernel

-

- 不同的卷积层,可以理解成识别图像的多种不同的纹理。

-

- 工业革命就是用机器替代人力。科学的也是从贵变便宜的过程。

参考

https://www.bilibili.com/video/BV1Th411U7UN?p=1

《新程序员》:云原生和全面数字化实践

《新程序员》:云原生和全面数字化实践

50位技术专家共同创作,文字、视频、音频交互阅读

50位技术专家共同创作,文字、视频、音频交互阅读

以上是关于卷积层里的填充Padding和步幅Stride 动手学深度学习v2 pytorch的主要内容,如果未能解决你的问题,请参考以下文章