百万并发设计

Posted gamezouni

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了百万并发设计相关的知识,希望对你有一定的参考价值。

百万并发架构

一 单个机器的并发

- Linux系统系统级的最大文件描述符

1.1 系统级最大文件描述符

理论上系统内存有多大就能打开多少的文件描述符,实际上内核会处理,一般最大打开文件数是系统内存的10%(以KB来计算),比如16G的内存,最大文件数大约是16*1000*1000*10%=1.6million, 可以通过 cat /proc/sys/fs/file-max 或者 sysctl -a | grep fs.file-max 命令查看

1.2 更改系统级限制有临时更改和永久更改两种方式:

临时更改:session断开或者系统重启后会恢复原来的设置值。使用命令 sysctl -w fs.file-max=xxxx,其中xxxx就是要设置的数字。

永久更改:vim编辑 /etc/sysctl.conf 文件,在后面添加 fs.file-max=xxxx,其中xxxx就是要设置的数字。保存退出后还要使用sysctl -p 命令使其生效。

2.Linux系统用户级的最大文件描述符

2.1 用户级最大文件描述符

同时为了控制每个进程消耗的文件资源,内核也会对单个进程最大打开文件数做默认限制,即用户级限制。32位系统默认值一般是1024,64位系统默认值一般是65535,可以使用 ulimit -n 命令查看。

2.2 更改用户级限制也有临时更改和永久更改两种方式:

临时更改:session断开或者系统重启后会恢复原来的设置值。使用命令 ulimit -SHn xxxx 命令来修改,其中xxxx就是要设置的数字。

永久更改:vim编辑 /etc/security/limits.conf 文件,修改其中的 hard nofile xxxx 和 soft nofile xxxx,其中xxxx就是要设置的数字。保存后退出。关于hard和soft的区别,参照下面参考链接中的第5个。

3. nginx并发数

nginx官方说nginx能支撑6万多并发性能最好,那么这里我们设置nginx进程最大能打开60,000个fd,假如是4核的CPU(内存我们假设足够大32G,64G等等),我们设置worker数量为4,那么worker_connection数量为15,000。那么nginx对外能提供多少并发数呢?你以为是60,000?那么你答错了,因为nginx作为反向代理,一个用户的请求实际上占了2个fd,一个fd是用户请求,一个fd是连接后台服务的。所以一个nginx在我们这样配置参数下,可以支持30,000并发

4. tomcat并发数

4.1 acceptCount 最大连接数

默认是100。当http请求数达到tomcat的最大线程数时,还有新的http请求到来,tomcat会把请求数放到队列中。acceptCount就是最大的等待数,超过这个,tomcat会拒绝。

4.2 maxThreads最大线程数

每一个HTTP请求,tomcat都会创建一个线程来处理请求,最大线程数决定了tomcat能同时处理多少个请求。默认是200。

4.3 maxConnections最大连接数

同一时间能接受的最大连接数。

4.4 最大并发

响应时间在50ms,则每个线程1秒可以处理20个请求,tps为20*maxThreads。

5 数据库

数据库的最大连接数。SHOW GLOBAL STATUS LIKE '%max _connections%'

6 Dubbo

Dubbo的默认线程是200.

7 Redis

Redis的默认线程是10000.

8 Jedis

Jedis的maxActive是8.修改为1000.

综上所述,单个机器的默认并发200,通过配置,增加tomcat和dubbo的线程数可以达到1000并发

二 百万并发

- 2个LVS集群(一主一备+keepalived)

- 以nginx的30000并发,40台nginx服务器

- 以tomcat的1000并发,1000台tomcat服务器,实际上大部分场景不可能每秒都是1百万并发。比如10秒有100万个请求,实际上可以用kafka接受,然后分摊到每秒10万个请求,这样tomcat需要100台机器可以满足需求

支撑日活百万用户的高并发系统,应该如何设计其数据库架构?

目录:

用一个创业公司的发展作为背景引入

用多台服务器来分库支撑高并发读写

大量分表来保证海量数据下查询性能

读写分离来支撑按需扩容及性能提升

高并发下的数据库架构设计总结

“ 这篇文章,我们来聊一下对于一个支撑日活百万用户的高并系统,他的数据库架构应该如何设计?

看到这个题目,很多人第一反应就是:

分库分表啊!

但是实际上,数据库层面的分库分表到底是用来干什么的,他的不同的作用如何应对不同的场景,我觉得很多同学可能都没搞清楚。

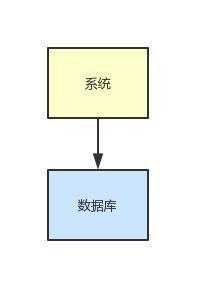

(1)用一个创业公司的发展作为背景引入

假如我们现在是一个小创业公司,注册用户就20万,每天活跃用户就1万,每天单表数据量就1000,然后高峰期每秒钟并发请求最多就10。

天哪!就这种系统,随便找一个有几年工作经验的高级工程师,然后带几个年轻工程师,随便干干都可以做出来。

因为这样的系统,实际上主要就是在前期快速的进行业务功能的开发,搞一个单块系统部署在一台服务器上,然后连接一个数据库就可以了。

接着大家就是不停的在一个工程里填充进去各种业务代码,尽快把公司的业务支撑起来,如下图所示。

结果呢,没想到我们运气这么好,碰上个优秀的CEO带着我们走上了康庄大道!

公司业务发展迅猛,过了几个月,注册用户数达到了2000万!每天活跃用户数100万!每天单表新增数据量达到50万条!高峰期每秒请求量达到1万!

同时公司还顺带着融资了两轮,估值达到了惊人的几亿美金!一只朝气蓬勃的幼年独角兽的节奏!

好吧,现在大家感觉压力已经有点大了,为啥呢?

因为每天单表新增50万条数据,一个月就多1500万条数据,一年下来单表会达到上亿条数据。

经过一段时间的运行,现在咱们单表已经两三千万条数据了,勉强还能支撑着。

但是,眼见着系统访问数据库的性能怎么越来越差呢,单表数据量越来越大,拖垮了一些复杂查询SQL的性能啊!

然后高峰期请求现在是每秒1万,咱们的系统在线上部署了20台机器,平均每台机器每秒支撑500请求,这个还能抗住,没啥大问题。

但是数据库层面呢?

如果说此时你还是一台数据库服务器在支撑每秒上万的请求,负责任的告诉你,每次高峰期会出现下述问题:

你的数据库服务器的磁盘IO、网络带宽、CPU负载、内存消耗,都会达到非常高的情况,数据库所在服务器的整体负载会非常重,甚至都快不堪重负了

高峰期时,本来你单表数据量就很大,SQL性能就不太好,这时加上你的数据库服务器负载太高导致性能下降,就会发现你的SQL性能更差了

最明显的一个感觉,就是你的系统在高峰期各个功能都运行的很慢,用户体验很差,点一个按钮可能要几十秒才出来结果

如果你运气不太好,数据库服务器的配置不是特别的高的话,弄不好你还会经历数据库宕机的情况,因为负载太高对数据库压力太大了

(2)多台服务器分库支撑高并发读写

首先我们先考虑第一个问题,数据库每秒上万的并发请求应该如何来支撑呢?

要搞清楚这个问题,先得明白一般数据库部署在什么配置的服务器上。

通常来说,假如你用普通配置的服务器来部署数据库,那也起码是16核32G的机器配置。

这种非常普通的机器配置部署的数据库,一般线上的经验是:不要让其每秒请求支撑超过2000,一般控制在2000左右。

控制在这个程度,一般数据库负载相对合理,不会带来太大的压力,没有太大的宕机风险。

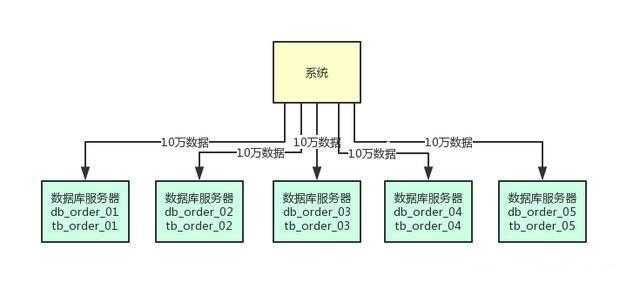

所以首先第一步,就是在上万并发请求的场景下,部署个5台服务器,每台服务器上都部署一个数据库实例。

然后每个数据库实例里,都创建一个一样的库,比如说订单库。

此时在5台服务器上都有一个订单库,名字可以类似为:db_order_01,db_order_02,等等。

然后每个订单库里,都有一个相同的表,比如说订单库里有订单信息表,那么此时5个订单库里都有一个订单信息表。

比如db_order_01库里就有一个tb_order_01表,db_order_02库里就有一个tb_order_02表。

这就实现了一个基本的分库分表的思路,原来的一台数据库服务器变成了5台数据库服务器,原来的一个库变成了5个库,原来的一张表变成了5个表。

然后你在写入数据的时候,需要借助数据库中间件,比如sharding-jdbc,或者是mycat,都可以。

你可以根据比如订单id来hash后按5取模,比如每天订单表新增50万数据,此时其中10万条数据会落入db_order_01库的tb_order_01表,另外10万条数据会落入db_order_02库的tb_order_02表,以此类推。

这样就可以把数据均匀分散在5台服务器上了,查询的时候,也可以通过订单id来hash取模,去对应的服务器上的数据库里,从对应的表里查询那条数据出来即可。

依据这个思路画出的图如下所示,大家可以看看。

做这一步有什么好处呢?

第一个好处,原来比如订单表就一张表,这个时候不就成了5张表了么,那么每个表的数据就变成1/5了。

假设订单表一年有1亿条数据,此时5张表里每张表一年就2000万数据了。

那么假设当前订单表里已经有2000万数据了,此时做了上述拆分,每个表里就只有400万数据了。

而且每天新增50万数据的话,那么每个表才新增10万数据,这样是不是初步缓解了单表数据量过大影响系统性能的问题?

另外就是每秒1万请求到5台数据库上,每台数据库就承载每秒2000的请求,是不是一下子把每台数据库服务器的并发请求降低到了安全范围内?

这样,降低了数据库的高峰期负载,同时还保证了高峰期的性能。

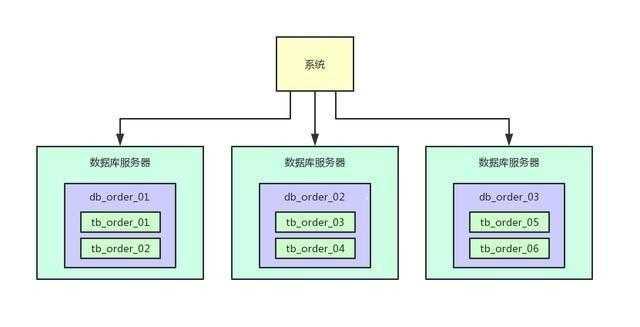

(3)大量分表来保证海量数据下的查询性能

但是上述的数据库架构还有一个问题,那就是单表数据量还是过大,现在订单表才分为了5张表,那么如果订单一年有1亿条,每个表就有2000万条,这也还是太大了。

所以还应该继续分表,大量分表。

比如可以把订单表一共拆分为1024张表,这样1亿数据量的话,分散到每个表里也就才10万量级的数据量,然后这上千张表分散在5台数据库里就可以了。

在写入数据的时候,需要做两次路由,先对订单id hash后对数据库的数量取模,可以路由到一台数据库上,然后再对那台数据库上的表数量取模,就可以路由到数据库上的一个表里了。

通过这个步骤,就可以让每个表里的数据量非常小,每年1亿数据增长,但是到每个表里才10万条数据增长,这个系统运行10年,每个表里可能才百万级的数据量。

这样可以一次性为系统未来的运行做好充足的准备,看下面的图,一起来感受一下:

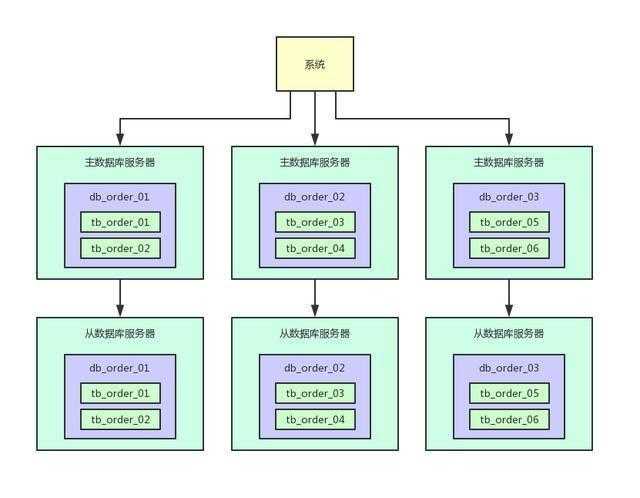

(4)读写分离来支撑按需扩容以及性能提升

这个时候整体效果已经挺不错了,大量分表的策略保证可能未来10年,每个表的数据量都不会太大,这可以保证单表内的SQL执行效率和性能。

然后多台数据库的拆分方式,可以保证每台数据库服务器承载一部分的读写请求,降低每台服务器的负载。

但是此时还有一个问题,假如说每台数据库服务器承载每秒2000的请求,然后其中400请求是写入,1600请求是查询。

也就是说,增删改的SQL才占到了20%的比例,80%的请求是查询。

此时假如说随着用户量越来越大,假如说又变成每台服务器承载4000请求了。

那么其中800请求是写入,3200请求是查询,如果说你按照目前的情况来扩容,就需要增加一台数据库服务器.

但是此时可能就会涉及到表的迁移,因为需要迁移一部分表到新的数据库服务器上去,是不是很麻烦?

其实完全没必要,数据库一般都支持读写分离,也就是做主从架构。

写入的时候写入主数据库服务器,查询的时候读取从数据库服务器,就可以让一个表的读写请求分开落地到不同的数据库上去执行。

这样的话,假如写入主库的请求是每秒400,查询从库的请求是每秒1600,那么图大概如下所示。

写入主库的时候,会自动同步数据到从库上去,保证主库和从库数据一致。

然后查询的时候都是走从库去查询的,这就通过数据库的主从架构实现了读写分离的效果了。

现在的好处就是,假如说现在主库写请求增加到800,这个无所谓,不需要扩容。然后从库的读请求增加到了3200,需要扩容了。

这时,你直接给主库再挂载一个新的从库就可以了,两个从库,每个从库支撑1600的读请求,不需要因为读请求增长来扩容主库。

实际上线上生产你会发现,读请求的增长速度远远高于写请求,所以读写分离之后,大部分时候就是扩容从库支撑更高的读请求就可以了。

而且另外一点,对同一个表,如果你既写入数据(涉及加锁),还从该表查询数据,可能会牵扯到锁冲突等问题,无论是写性能还是读性能,都会有影响。

所以一旦读写分离之后,对主库的表就仅仅是写入,没任何查询会影响他,对从库的表就仅仅是查询。

(5)高并发下的数据库架构设计总结

其实从大的一个简化的角度来说,高并发的场景下,数据库层面的架构肯定是需要经过精心的设计的。

尤其是涉及到分库来支撑高并发的请求,大量分表保证每个表的数据量别太大,读写分离实现主库和从库按需扩容以及性能保证。

这篇文章就是从一个大的角度来梳理了一下思路,各位同学可以结合自己公司的业务和项目来考虑自己的系统如何做分库分表应该怎么做。

另外就是,具体的分库分表落地的时候,需要借助数据库中间件来实现分库分表和读写分离,大家可以自己参考 sharding-jdbc 或者 mycat 的官网即可,里面的文档都有详细的使用描述。

链接:https://www.jianshu.com/p/19746b42d11f

以上是关于百万并发设计的主要内容,如果未能解决你的问题,请参考以下文章