赵强老师在Spark SQL中读取JSON文件

Posted 赵强老师

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了赵强老师在Spark SQL中读取JSON文件相关的知识,希望对你有一定的参考价值。

Spark SQL是Spark用来处理结构化数据的一个模块,它提供了一个编程抽象叫做DataFrame并且作为分布式SQL查询引擎的作用。为什么要学习Spark SQL?如果大家了解Hive的话,应该知道它是将Hive SQL转换成MapReduce然后提交到集群上执行,大大简化了编写MapReduce的程序的复杂性,由于MapReduce这种计算模型执行效率比较慢。所以Spark SQL的应运而生,它是将Spark SQL转换成RDD,然后提交到集群执行,执行效率非常快!同时Spark SQL也支持从Hive中读取数据。

Spark SQL也能自动解析JSON数据集的Schema,读取JSON数据集为DataFrame格式。读取JSON数据集方法为SQLContext.read().json()。该方法将String格式的RDD或JSON文件转换为DataFrame。

需要注意的是,这里的JSON文件不是常规的JSON格式。JSON文件每一行必须包含一个独立的、自满足有效的JSON对象。如果用多行描述一个JSON对象,会导致读取出错。

-

需要用到的测试数据:people.json

{"name":"Michael"}

{"name":"Andy", "age":30}

{"name":"Justin", "age":19}

-

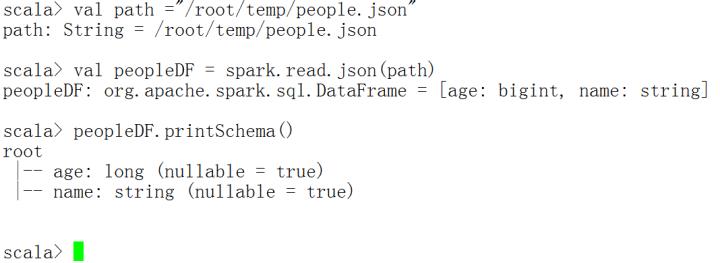

定义路径

val path ="/root/temp/people.json"

-

读取Json文件,生成DataFrame:

val peopleDF = spark.read.json(path)

-

打印Schema结构信息

peopleDF.printSchema()

-

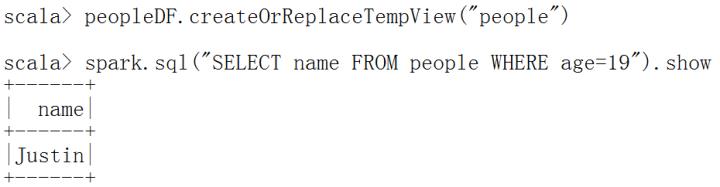

创建临时视图

peopleDF.createOrReplaceTempView("people")

-

执行查询

spark.sql("SELECT name FROM people WHERE age=19").show

以上是关于赵强老师在Spark SQL中读取JSON文件的主要内容,如果未能解决你的问题,请参考以下文章