HDFS练习

Posted 赫嘉益华

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了HDFS练习相关的知识,希望对你有一定的参考价值。

HDFS实践

HDFS练习

1. 实验目的:

1) 掌握Hadoop中HDFS的Shell命令操作

2) 掌握Hadoop中HDFS的API操作

2. 实验原理:

1) HDFS是hadoop平台的核心组成之一

2) HDFS的访问方式有多种,可通过web访问,也可通过shell方式或者API方式访问。

3) 基本操作有:对文件的读、写、追加、删除;新建文件夹、删除文件夹等;还可显示文件及文件夹的属性。

3. 实验准备:

1) 实验一中已经完成配置的伪分布式hadoop环境。

2) 项目1、项目2,可以直接使用上述环境

3) 项目3有可能需要配置自己的虚拟机网络连接模式

4. 实验内容:

1) 项目1:HDFS常见命令练习

可以在终端输入hdfs dfs -help command查询命令用法),执行并查看结果。

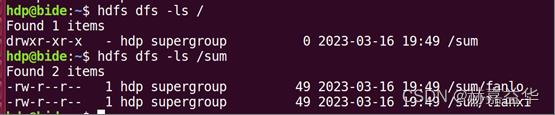

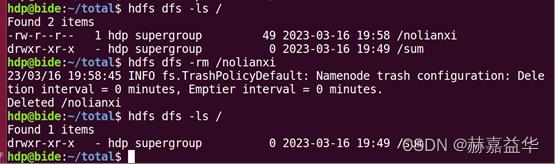

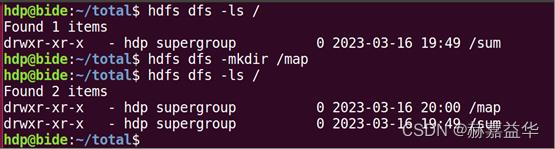

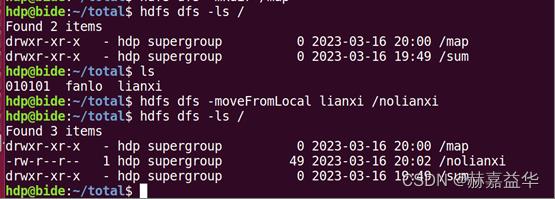

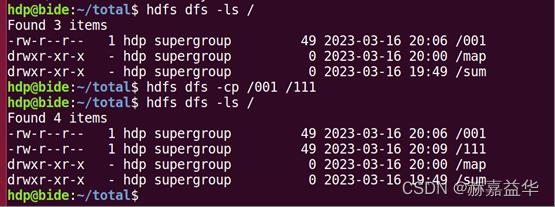

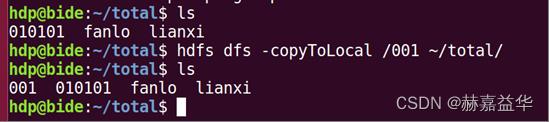

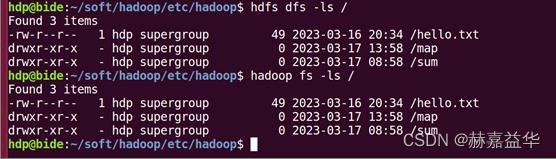

(1) 列出HDFS当前用户家目录下的文件及文件夹:hdfs dfs -ls /

(2) 列出HDFS文件下名为directory的文件夹中的文件: hdfs dfs -ls sum

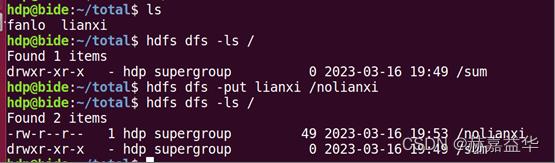

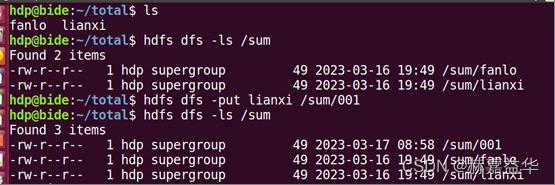

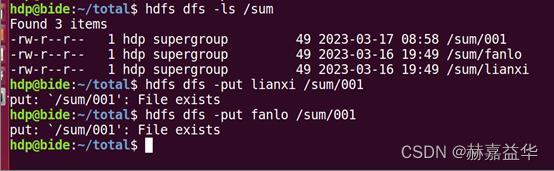

(3) 上传文件,将本地目录file1文件上传到HDFS上并重命名为file2:hdfs dfs -put file1 file2

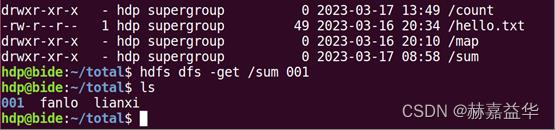

(4) 下载文件,将HDFS中的file2文件复制到本地系统并命名为file1: hdfs dfs -get file2 file1

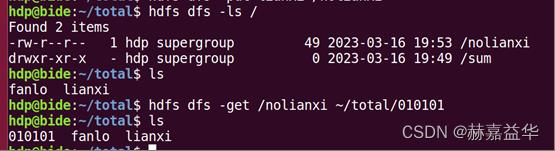

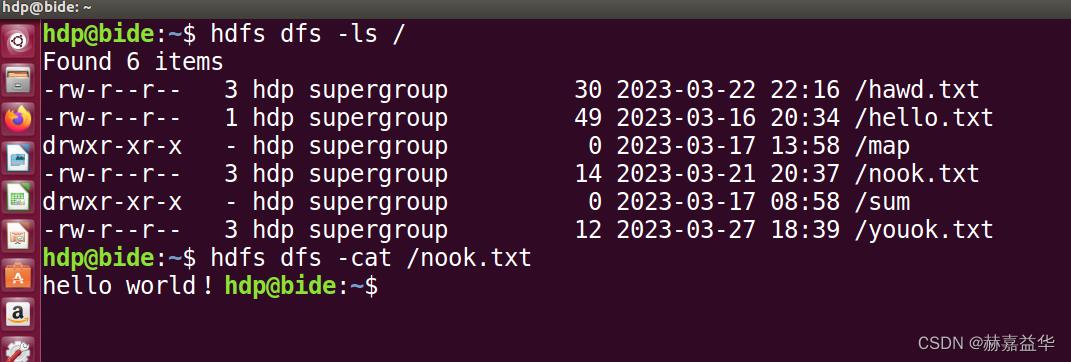

(5) 查看文件,查看HDFS下file1文件中的内容:hdfs dfs -cat file1

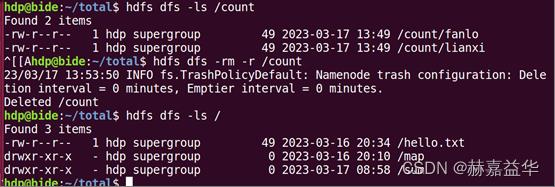

(6) 删除文档,删除HDFS下名为file1的文件:hdfs dfs -rm file1

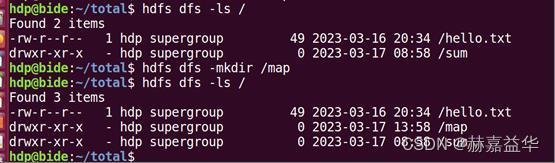

(7) 在HDFS根路径下建立新目录,名为directory: hdfs dfs -mkdir hdfs根目录/directory

(8)本地文件复制到HDFS(注意与put的区别):hdfs dfs -copyFromLocal src dst

(9)本地文件移动到HDFS: hdfs dfs -moveFromLocal src dst

(10)文件或文件夹复制: hdfs dfs -cp src dst

(11)文件或文件夹的移动: hdfs dfs -mv src dst

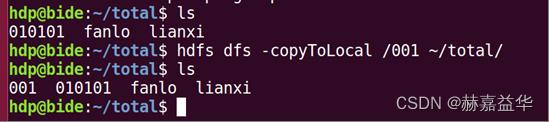

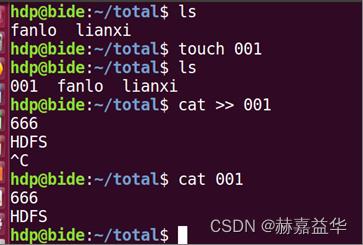

(12)copyToLocal 复制文件到本地: hdfs dfs -copyToLocal src dst

(13) touchz 创建一个空文件file: hdfs dfs -touchz file

(14)追加到文件末尾的指令: hdfs dfs -appendToFile local.txt text.txt

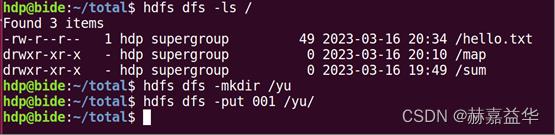

2) 项目2:HDFS命令的综合运用实践

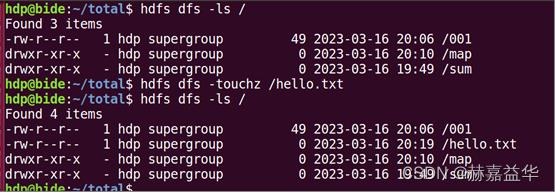

(1) 创建一个文件file1,查看file1是否创建成功,往file1内写一些内容。

(2) 在HDFS上创建一个文件夹folder1,把file1上传到folder1中。

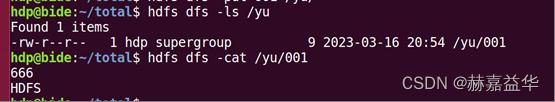

(3) 查看是否上传成功,成功后查看file1的内容。

(4) 把file1下载到本地,查看file1的内容。

(5) 把folder1删除,并查看是否删除成功。

(6) 最后把本地的file1删除

【拓展与思考】思考题1、思考题2、思考题3必做,其余选做

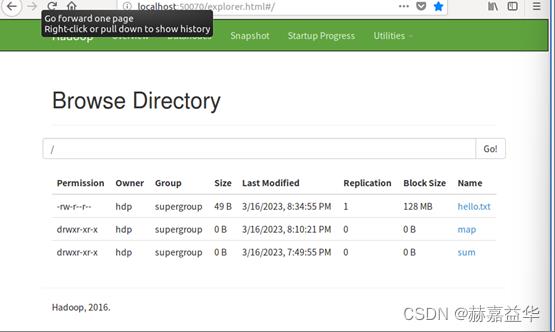

思考题1(必做):对项目1、项目2命令行操作的结果,是否能在Web访问模式下看到?如果能请截图举例说明;如果不能,请查清原因并确认结果。

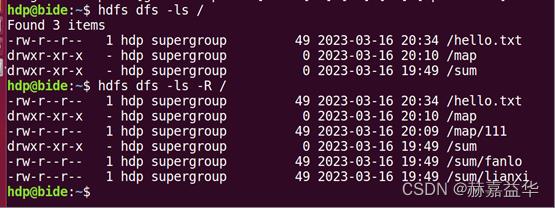

思考题2(必做):hdfs dfs -ls -R 某个HDFS上的目录该命令中“R”参数的作用是什么?请截图并给出相应的说明。

递归显示目录

思考题3(必做):如果已经上传了某个本地A文件到HDFS上,并在HDFS中命名为file1,

那再次上传A文件并在HDFS中命名为file1是否可行(路径一致)?

不行

如果换另一个本地文件B上传到HDFS中也命名为file1是否可行(路径一致)?

不行

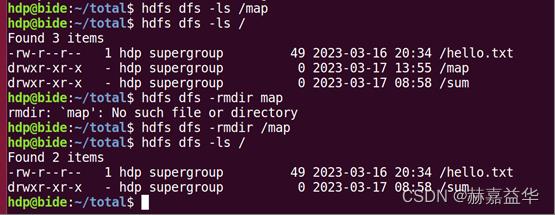

思考题4(必做):如果操作对象是文件夹,如何使用命令完成和文件类似的操作?

(1) 列出HDFS文件下名为directory的文件夹中的文件: hdfs dfs -ls directory

(2) 上传文件,将本地目录folder1文件夹上传到HDFS上并重命名为folder2:hdfs dfs -put folder1 folder2

(3) 下载文件,将HDFS中的folder2文件复制到本地系统并命名为floder1:hdfs dfs -get floder2 floder1

(4) 递归删除文件及目录,删除HDFS下名为floder1的文件: hdfs dfs -rm -r floder1

(5) 删除空目录,删除HDFS下floder2 文件中的内容:hdfs dfs -rmdir floder1

(6) 在HDFS根路径下建立新目录,名为directory:hdfs dfs -mkdir hdfs根目录/directory

思考题5(选做,可加分保命): hdfs dfs -copyFromLocal 与 hdfs dfs -put 有什么区别?

Hdfs dfs -copyFormLocal 只可以将本地文件拷贝到HDFS文件中

hdfs dfs -copyFromLocal和hdfs dfs -put都是HDFS命令,用于将本地文件复制到HDFS集群中。它们的作用是相同的,都可以将本地文件拷贝到HDFS中,但是它们在使用上还是有一些区别的。

hdfs dfs -copyFromLocal命令只能将本地文件拷贝到HDFS文件系统中,而不能将一个HDFS文件系统中的文件复制到另一个HDFS文件系统中。

hdfs dfs -put命令可以将本地文件拷贝到HDFS文件系统中,也可以将一个HDFS文件系统中的文件复制到另一个HDFS文件系统中。

思考题6(选做,可加分保命): linux中每一个命令其实都是对应程序的执行结果,那HDFS命令对应的程序具体在哪些文件中定义呢?

HDFS命令是指用于操作Hadoop分布式文件系统的命令,这些命令的实现程序一般都在Hadoop软件包中的bin目录下。具体地说,HDFS命令对应的程序通常是由Java编写的可执行文件,文件名通常以hdfs-开头,例如hdfs dfs、hdfs fsck、hdfs namenode等。

这些程序的代码实现通常位于Hadoop源代码的src目录下的hadoop-hdfs-project/hadoop-hdfs/src/main/java/org/apache/hadoop/hdfs/tools目录下,其中包含了各种HDFS命令对应的Java类的实现代码。例如,hdfs dfs命令对应的程序实现代码通常在hadoop-hdfs-project/hadoop-hdfs/src/main/java/org/apache/hadoop/hdfs/tools/DFSAdmin.java文件中。

总之,HDFS命令对应的程序实现代码都是由Java编写的,并且通常位于Hadoop软件包的bin目录和源代码的src目录下。

项目3:HDFS的API使用实践**

(1) 改造虚拟机网络

参考我的另一篇博客:VMware NAT虚拟网络改造

(2) 改造Hadoop配置

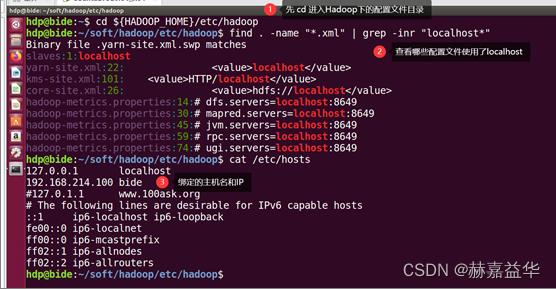

【实操】将hadoop涉及到的5个进程的localhost都调整为新设定的IP,也可以使用/etc/hosts中设定一个名称,方便后续快速更改(这样做更加正规)

step_1 先查看有哪些文件使用了localhost

【实操】step_2-1 在关闭Hadoop所有服务的前提下修改相关配置文件(yarn-site.xml)

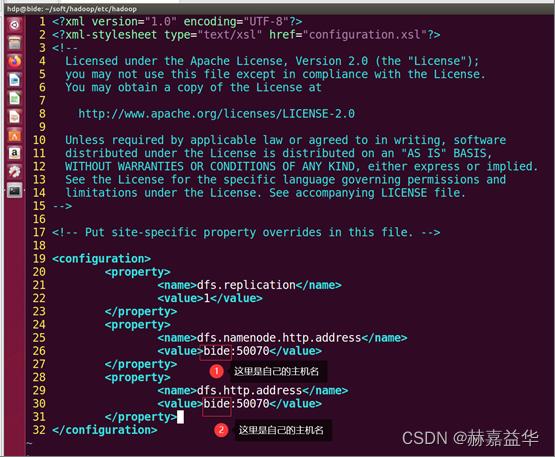

【实操】step_2-2 在关闭Hadoop所有服务的前提下修改相关配置文件(hdfs-site.xml)

step_2-3 在关闭Hadoop所有服务的前提下修改相关配置文件(core-site.xml)

【实操】step_2-4 最后在检查下是否还有遗漏

【实操】step_2-5 启动Hadoop,确认相关JVM进程正常工作

step_2-6 简单测试功能是否可用

(3) 编写代码 ==> 要完成文件的 创建/追加/修改

【实操】只提供eclipse演示与IDEA演示,具体细节请参考Hadoop_Liang的博客,下方有链接

1)eclipse 配置Maven

1. 配置开发环境

(1)我们建议,可先采用非Maven的方式完成开发,因为这样可以规避许多的网络访问问题。

(2)如果非Maven方式完成后,再尝试去做Maven模式。

2. 参考博客,编写代码

(1)非Maven工程API访问HDFS:https://blog.csdn.net/qq_42881421/article/details/83001401

(2)Maven工程API访问HDFS:https://blog.csdn.net/qq_42881421/article/details/100762022

2)IDEA 配置Maven

1. 配置开发环境

需要提前下载Maven:https://pan.baidu.com/s/1VhtAlf2Xf9RM6GT7gVNVIw?pwd=sko1

2. 参考博客,编写代码

Maven工程API访问HDFS:https://blog.csdn.net/qq_42881421/article/details/100717502

【注】

① Maven的相关配置和下载请耐心完成

② 如果遇到海外网络不能访问的问题,请参考实验1介绍的配置国内镜像源的方法解决

③ 其实为了方便,建议直接使用IDEA完成;后续课程《大数据内存计算》(spark)也要使用IDEA

HDFS编程练习

1.从HDFS中下载指定文件

从HDFS中下载指定文件,如果本地文件与要下载的文件名称相同,则自动对下载的文件重命名

shell命令:

su hadoopcd /home/hadoop#进入hadoop用户的本地目录if $(hdfs dfs -test -e file:///home/hadoop/text.txt);then $(hdfs dfs -copyToLocal text.txt ./text2.txt);else $(hdfs dfs -copyToLocal text.txt ./text.txt);fi

代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi{/*** 下载文件到本地* 判断本地路径是否已存在,若已存在,则自动进行重命名*/public static void copyToLocal(Configuration conf,String remoteFilePath,String localFilePath)throwsIOException{FileSystem fs =FileSystem.get(conf);Path remotePath =newPath(remoteFilePath);File f =newFile(localFilePath);/* 如果文件名存在,自动重命名(在文件名后面加上 _0, _1 ...) */if(f.exists()){System.out.println(localFilePath +"已存在.");Integer i =0;boolean isExist =true;while(isExist){f =newFile(localFilePath +"_"+ i.toString());if(!f.exists()){localFilePath = localFilePath +"_"+ i.toString();break;}else{i++;}}System.out.println("将重新命名为: "+ localFilePath);}// 下载文件到本地Path localPath =newPath(localFilePath);fs.copyToLocalFile(remotePath, localPath);fs.close();}/*** 主函数*/public static void main(String[] args){Configuration conf =newConfiguration();conf.set("fs.default.name","hdfs://localhost:9000");String localFilePath ="/home/hadoop/text.txt"; //本地路径String remoteFilePath ="/user/hadoop/text.txt"; //HDFS路径try{HDFSApi.copyToLocal(conf, remoteFilePath, localFilePath);System.out.println("下载完成");}catch(Exception e){e.printStackTrace();}}}

2.将HDFS中指定文件的内容输出到终端

shell命令:

hdfs dfs -cat text.txt代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 读取文件内容*/public static void cat(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);FSDataInputStream in = fs.open(remotePath);BufferedReader d = new BufferedReader(new InputStreamReader(in));String line = null;while ( (line = d.readLine()) != null ) {System.out.println(line);}d.close();in.close();fs.close();}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "/user/hadoop/text.txt"; // HDFS路径try {System.out.println("读取文件: " + remoteFilePath);HDFSApi.cat(conf, remoteFilePath);System.out.println("n读取完成");} catch (Exception e) {e.printStackTrace();}}}

3.显示HDFS中指定文件的信息:(大小,权限,路径,创建时间 等)

shell命令:

hdfs dfs -ls -h text.txt代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;import java.text.SimpleDateFormat;public class HDFSApi {/*** 显示指定文件的信息*/public static void ls(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);FileStatus[] fileStatuses = fs.listStatus(remotePath);for (FileStatus s : fileStatuses) {System.out.println("路径: " + s.getPath().toString());System.out.println("权限: " + s.getPermission().toString());System.out.println("大小: " + s.getLen());/* 返回的是时间戳,转化为时间日期格式 */Long timeStamp = s.getModificationTime();SimpleDateFormat format = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");String date = format.format(timeStamp);System.out.println("时间: " + date);}fs.close();}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "/user/hadoop/text.txt"; // HDFS路径try {System.out.println("读取文件信息: " + remoteFilePath);HDFSApi.ls(conf, remoteFilePath);System.out.println("n读取完成");} catch (Exception e) {e.printStackTrace();}}}

4.给定HDFS中某一个目录,输出该目录下的所有文件的读写权限、大小、创建时间、路径等信息,如果该文件是目录,则递归输出该目录下所有文件相关信息:

shell命令:

hdfs dfs -ls -R -h /user/hadoop代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;import java.text.SimpleDateFormat;public class HDFSApi {/*** 显示指定文件夹下所有文件的信息(递归)*/public static void lsDir(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);/* 递归获取目录下的所有文件 */RemoteIterator<LocatedFileStatus> remoteIterator = fs.listFiles(dirPath, true);/* 输出每个文件的信息 */while (remoteIterator.hasNext()) {FileStatus s = remoteIterator.next();System.out.println("路径: " + s.getPath().toString());System.out.println("权限: " + s.getPermission().toString());System.out.println("大小: " + s.getLen());/* 返回的是时间戳,转化为时间日期格式 */Long timeStamp = s.getModificationTime();SimpleDateFormat format = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");String date = format.format(timeStamp);System.out.println("时间: " + date);System.out.println();}fs.close();}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteDir = "/user/hadoop"; // HDFS路径try {System.out.println("(递归)读取目录下所有文件的信息: " + remoteDir);HDFSApi.lsDir(conf, remoteDir);System.out.println("读取完成");} catch (Exception e) {e.printStackTrace();}}}

5.创建、删除HDFS文件:

shell命令:

#创建文件if $(hdfs dfs -test -d dir1/dir2);then $(hdfs dfs -touchz dir1/dir2/filename);else $(hdfs dfs -mkdir -p dir1/dir2 && hdfs dfs -touchz dir1/dir2/filename);fi

#删除文件hdfs dfs -rm dir1/dir2/filename

代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 判断路径是否存在*/public static boolean test(Configuration conf, String path) throws IOException {FileSystem fs = FileSystem.get(conf);return fs.exists(new Path(path));}/*** 创建目录*/public static boolean mkdir(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);boolean result = fs.mkdirs(dirPath);fs.close();return result;}/*** 创建文件*/public static void touchz(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);FSDataOutputStream outputStream = fs.create(remotePath);outputStream.close();fs.close();}/*** 删除文件*/public static boolean rm(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);boolean result = fs.delete(remotePath, false);fs.close();return result;}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "/user/hadoop/input/text.txt"; // HDFS路径String remoteDir = "/user/hadoop/input"; // HDFS路径对应的目录try {/* 判断路径是否存在,存在则删除,否则进行创建 */if ( HDFSApi.test(conf, remoteFilePath) ) {HDFSApi.rm(conf, remoteFilePath); // 删除System.out.println("删除路径: " + remoteFilePath);} else {if ( !HDFSApi.test(conf, remoteDir) ) { // 若目录不存在,则进行创建HDFSApi.mkdir(conf, remoteDir);System.out.println("创建文件夹: " + remoteDir);}HDFSApi.touchz(conf, remoteFilePath);System.out.println("创建路径: " + remoteFilePath);}} catch (Exception e) {e.printStackTrace();}}}

6.创建和删除HDFS目录:创建目录时,如果目录文件所在目录不存在则自动创建相应目录;删除目录时,由用户指定当该目录不为空时是否还删除该目录

shell命令:

hdfs dfs -mkdir -p dir1/dir2 #创建目录:hdfs dfs -rmdir dir1/dir2#删除目录(目录为空时可以)hdfs dfs -rm -R dir1/dir2#强制删除目录

代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 判断路径是否存在*/public static boolean test(Configuration conf, String path) throws IOException {FileSystem fs = FileSystem.get(conf);return fs.exists(new Path(path));}/*** 判断目录是否为空* true: 空,false: 非空*/public static boolean isDirEmpty(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);RemoteIterator<LocatedFileStatus> remoteIterator = fs.listFiles(dirPath, true);return !remoteIterator.hasNext();}/*** 创建目录*/public static boolean mkdir(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);boolean result = fs.mkdirs(dirPath);fs.close();return result;}/*** 删除目录*/public static boolean rmDir(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);/* 第二个参数表示是否递归删除所有文件 */boolean result = fs.delete(dirPath, true);fs.close();return result;}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteDir = "/user/hadoop/input"; // HDFS目录Boolean forceDelete = false; // 是否强制删除try {/* 判断目录是否存在,不存在则创建,存在则删除 */if ( !HDFSApi.test(conf, remoteDir) ) {HDFSApi.mkdir(conf, remoteDir); // 创建目录System.out.println("创建目录: " + remoteDir);} else {if ( HDFSApi.isDirEmpty(conf, remoteDir) || forceDelete ) { // 目录为空或强制删除HDFSApi.rmDir(conf, remoteDir);System.out.println("删除目录: " + remoteDir);} else { // 目录不为空System.out.println("目录不为空,不删除: " + remoteDir);}}} catch (Exception e) {e.printStackTrace();}}}

7.向HDFS中指定的文件追加内容,由用户指定内容追加到原有文件的开头或结尾

shell命令:

#追加到文件末尾hdfs dfs -appendToFile local.txt text.txt

#追加到文件开头cd /home/hadoophdfs dfs -get text.txtcat text.txt >> local.txthdfs dfs -copyFromLocal -f local.txt text.txt

代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 判断路径是否存在*/public static boolean test(Configuration conf, String path) throws IOException {FileSystem fs = FileSystem.get(conf);return fs.exists(new Path(path));}/*** 追加文本内容*/public static void appendContentToFile(Configuration conf, String content, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);/* 创建一个文件输出流,输出的内容将追加到文件末尾 */FSDataOutputStream out = fs.append(remotePath);out.write(content.getBytes());out.close();fs.close();}/*** 追加文件内容*/public static void appendToFile(Configuration conf, String localFilePath, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);/* 创建一个文件读入流 */FileInputStream in = new FileInputStream(localFilePath);/* 创建一个文件输出流,输出的内容将追加到文件末尾 */FSDataOutputStream out = fs.append(remotePath);/* 读写文件内容 */byte[] data = new byte[1024];int read = -1;while ( (read = in.read(data)) > 0 ) {out.write(data, 0, read);}out.close();in.close();fs.close();}/*** 移动文件到本地* 移动后,删除源文件*/public static void moveToLocalFile(Configuration conf, String remoteFilePath, String localFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);Path localPath = new Path(localFilePath);fs.moveToLocalFile(remotePath, localPath);}/*** 创建文件*/public static void touchz(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);FSDataOutputStream outputStream = fs.create(remotePath);outputStream.close();fs.close();}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");conf.set("dfs.support.append","true");conf.set("dfs.client.block.write.replace-datanode-on-failure.enable","true");conf.set("dfs.client.block.write.replace-datanode-on-failure.policy","NEVER");String remoteFilePath = "/user/hadoop/text.txt"; // HDFS文件String content = "新追加的内容n";String choice = "after"; //追加到文件末尾// String choice = "before"; // 追加到文件开头try {/* 判断文件是否存在 */if ( !HDFSApi.test(conf, remoteFilePath) ) {System.out.println("文件不存在: " + remoteFilePath);} else {if ( choice.equals("after") ) { // 追加在文件末尾HDFSApi.appendContentToFile(conf, content, remoteFilePath);System.out.println("已追加内容到文件末尾" + remoteFilePath);} else if ( choice.equals("before") ) { // 追加到文件开头/* 没有相应的api可以直接操作,因此先把文件移动到本地,创建一个新的HDFS,再按顺序追加内容 */String localTmpPath = "/user/hadoop/tmp.txt";HDFSApi.moveToLocalFile(conf, remoteFilePath, localTmpPath); // 移动到本地HDFSApi.touchz(conf, remoteFilePath); // 创建一个新文件HDFSApi.appendContentToFile(conf, content, remoteFilePath); // 先写入新内容HDFSApi.appendToFile(conf, localTmpPath, remoteFilePath); // 再写入原来内容System.out.println("已追加内容到文件开头: " + remoteFilePath);}}} catch (Exception e) {e.printStackTrace();}}}

8.删除HDFS中的指定文件

shell命令::

hdfs dfs -rm text.txtimport org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 删除文件*/public static boolean rm(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);boolean result = fs.delete(remotePath, false);fs.close();return result;}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "/user/hadoop/text.txt"; // HDFS文件try {if ( HDFSApi.rm(conf, remoteFilePath) ) {System.out.println("文件删除: " + remoteFilePath);} else {System.out.println("操作失败(文件不存在或删除失败)");}} catch (Exception e) {e.printStackTrace();}}}

9.删除HDFS中指定的目录(由用户指定目录中如果存在文件时是否删除目录)

shell命令:

hdfs dfs -rmdir dir1/dir2 #删除目录(如果目录非空则会提示not empty,不执行删除):hdfs dfs -rm -R dir1/dir2 #强制删除目录

代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 判断目录是否为空* true: 空,false: 非空*/public static boolean isDirEmpty(Configuration conf, String remoteDir) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);RemoteIterator<LocatedFileStatus> remoteIterator = fs.listFiles(dirPath, true);return !remoteIterator.hasNext();}/*** 删除目录*/public static boolean rmDir(Configuration conf, String remoteDir, boolean recursive) throws IOException {FileSystem fs = FileSystem.get(conf);Path dirPath = new Path(remoteDir);/* 第二个参数表示是否递归删除所有文件 */boolean result = fs.delete(dirPath, recursive);fs.close();return result;}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteDir = "/user/hadoop/input"; // HDFS目录Boolean forceDelete = false; // 是否强制删除try {if ( !HDFSApi.isDirEmpty(conf, remoteDir) && !forceDelete ) {System.out.println("目录不为空,不删除");} else {if ( HDFSApi.rmDir(conf, remoteDir, forceDelete) ) {System.out.println("目录已删除: " + remoteDir);} else {System.out.println("操作失败");}}} catch (Exception e) {e.printStackTrace();}}}

10.HDFS文件移动:将hdfs文件从源文件路径移动到目的路径

shell命令:

hdfs dfs -mv text.txt text2.txt代码实现:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.*;import java.io.*;public class HDFSApi {/*** 移动文件*/public static boolean mv(Configuration conf, String remoteFilePath, String remoteToFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path srcPath = new Path(remoteFilePath);Path dstPath = new Path(remoteToFilePath);boolean result = fs.rename(srcPath, dstPath);fs.close();return result;}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "hdfs:///user/hadoop/text.txt"; // 源文件HDFS路径String remoteToFilePath = "hdfs:///user/hadoop/new.txt"; // 目的HDFS路径try {if ( HDFSApi.mv(conf, remoteFilePath, remoteToFilePath) ) {System.out.println("将文件 " + remoteFilePath + " 移动到 " + remoteToFilePath);} else {System.out.println("操作失败(源文件不存在或移动失败)");}} catch (Exception e) {e.printStackTrace();}}}

11.输出HDFS中指定文件的文本到终端中:

import org.apache.hadoop.fs.*;import org.apache.hadoop.io.IOUtils;import java.io.*;import java.net.URL;public class HDFSApi {static{URL.setURLStreamHandlerFactory(new FsUrlStreamHandlerFactory());}/*** 主函数*/public static void main(String[] args) throws Exception {String remoteFilePath = "hdfs://localhost:9000/user/hadoop/text.txt"; // HDFS文件InputStream in = null;try{/* 通过URL对象打开数据流,从中读取数据 */in = new URL(remoteFilePath).openStream();IOUtils.copyBytes(in,System.out,4096,false);} finally{IOUtils.closeStream(in);}}}

12.按行读取HDFS中指定文件:

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.FSDataInputStream;import org.apache.hadoop.fs.FileSystem;import org.apache.hadoop.fs.Path;import java.io.*;public class MyFSDataInputStream extends FSDataInputStream {public MyFSDataInputStream(InputStream in) {super(in);}/*** 实现按行读取* 每次读入一个字符,遇到"\n"结束,返回一行内容*/public static String readline(BufferedReader br) throws IOException {char[] data = new char[1024];int read = -1;int off = 0; // 循环执行时,br 每次会从上一次读取结束的位置继续读取,因此该函数里,off 每次都从0开始while ( (read = br.read(data, off, 1)) != -1 ) {if (String.valueOf(data[off]).equals("\n") ) {off += 1;break;}off += 1;}if (off > 0) {return String.valueOf(data);} else {return null;}}/*** 读取文件内容*/public static void cat(Configuration conf, String remoteFilePath) throws IOException {FileSystem fs = FileSystem.get(conf);Path remotePath = new Path(remoteFilePath);FSDataInputStream in = fs.open(remotePath);BufferedReader br = new BufferedReader(new InputStreamReader(in));String line = null;while ( (line = MyFSDataInputStream.readline(br)) != null ) {System.out.println(line);}br.close();in.close();fs.close();}/*** 主函数*/public static void main(String[] args) {Configuration conf = new Configuration();conf.set("fs.default.name","hdfs://localhost:9000");String remoteFilePath = "/user/hadoop/text.txt"; // HDFS路径try {MyFSDataInputStream.cat(conf, remoteFilePath);} catch (Exception e) {e.printStackTrace();}}}

以上是关于HDFS练习的主要内容,如果未能解决你的问题,请参考以下文章