卷积神经网络

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了卷积神经网络相关的知识,希望对你有一定的参考价值。

关于花书中卷积网络的笔记记录于 https://www.jianshu.com/p/5a3c90ea0807 。

卷积神经网络(Convolutional Neural Network,CNN或ConvNet)是一种具有 局部连接、权重共享 等特性的深层前馈神经网络。卷积神经网络是受生物学上感受野的机制而提出。 感受野(Receptive Field) 主要是指听觉、视觉等神经系统中一些神经元的特性,即 神经元只接受其所支配的刺激区域内的信号 。

卷积神经网络最早是主要用来处理图像信息。如果用全连接前馈网络来处理图像时,会存在以下两个问题:

目前的卷积神经网络一般是由卷积层、汇聚层和全连接层交叉堆叠而成的前馈神经网络,使用反向传播算法进行训练。 卷积神经网络有三个结构上的特性:局部连接,权重共享以及汇聚 。这些特性使卷积神经网络具有一定程度上的平移、缩放和旋转不变性。

卷积(Convolution)是分析数学中一种重要的运算。在信号处理或图像处理中,经常使用一维或二维卷积。

一维卷积经常用在信号处理中,用于计算信号的延迟累积。假设一个信号发生器每个时刻t 产生一个信号 ,其信息的衰减率为 ,即在 个时间步长后,信息为原来的 倍。假设 ,那么在时刻t收到的信号 为当前时刻产生的信息和以前时刻延迟信息的叠加:

我们把 称为 滤波器(Filter)或卷积核(Convolution Kernel) 。假设滤波器长度为 ,它和一个信号序列 的卷积为:

信号序列 和滤波器 的卷积定义为:

一般情况下滤波器的长度 远小于信号序列长度 ,下图给出一个一维卷积示例,滤波器为 :

二维卷积经常用在图像处理中。因为图像为一个两维结构,所以需要将一维卷积进行扩展。给定一个图像 和滤波器 ,其卷积为:

下图给出一个二维卷积示例:

注意这里的卷积运算并不是在图像中框定卷积核大小的方框并将各像素值与卷积核各个元素相乘并加和,而是先把卷积核旋转180度,再做上述运算。

在图像处理中,卷积经常作为特征提取的有效方法。一幅图像在经过卷积操作后得到结果称为 特征映射(Feature Map) 。

最上面的滤波器是常用的高斯滤波器,可以用来对图像进行 平滑去噪 ;中间和最下面的过滤器可以用来 提取边缘特征 。

在机器学习和图像处理领域,卷积的主要功能是在一个图像(或某种特征)上滑动一个卷积核(即滤波器),通过卷积操作得到一组新的特征。在计算卷积的过程中,需要进行卷积核翻转(即上文提到的旋转180度)。 在具体实现上,一般会以互相关操作来代替卷积,从而会减少一些不必要的操作或开销。

互相关(Cross-Correlation)是一个衡量两个序列相关性的函数,通常是用滑动窗口的点积计算来实现 。给定一个图像 和卷积核 ,它们的互相关为:

互相关和卷积的区别仅在于卷积核是否进行翻转。因此互相关也可以称为不翻转卷积 。当卷积核是可学习的参数时,卷积和互相关是等价的。因此,为了实现上(或描述上)的方便起见,我们用互相关来代替卷积。事实上,很多深度学习工具中卷积操作其实都是互相关操作。

在卷积的标准定义基础上,还可以引入滤波器的 滑动步长 和 零填充 来增加卷积多样性,更灵活地进行特征抽取。

滤波器的步长(Stride)是指滤波器在滑动时的时间间隔。

零填充(Zero Padding)是在输入向量两端进行补零。

假设卷积层的输入神经元个数为 ,卷积大小为 ,步长为 ,神经元两端各填补 个零,那么该卷积层的神经元数量为 。

一般常用的卷积有以下三类:

因为卷积网络的训练也是基于反向传播算法,因此我们重点关注卷积的导数性质:

假设 。

, , 。函数 为一个标量函数。

则由 有:

可以看出, 关于 的偏导数为 和 的卷积 :

同理得到:

当 或 时, ,即相当于对 进行 的零填充。从而 关于 的偏导数为 和 的宽卷积 。

用互相关的“卷积”表示,即为(注意 宽卷积运算具有交换性性质 ):

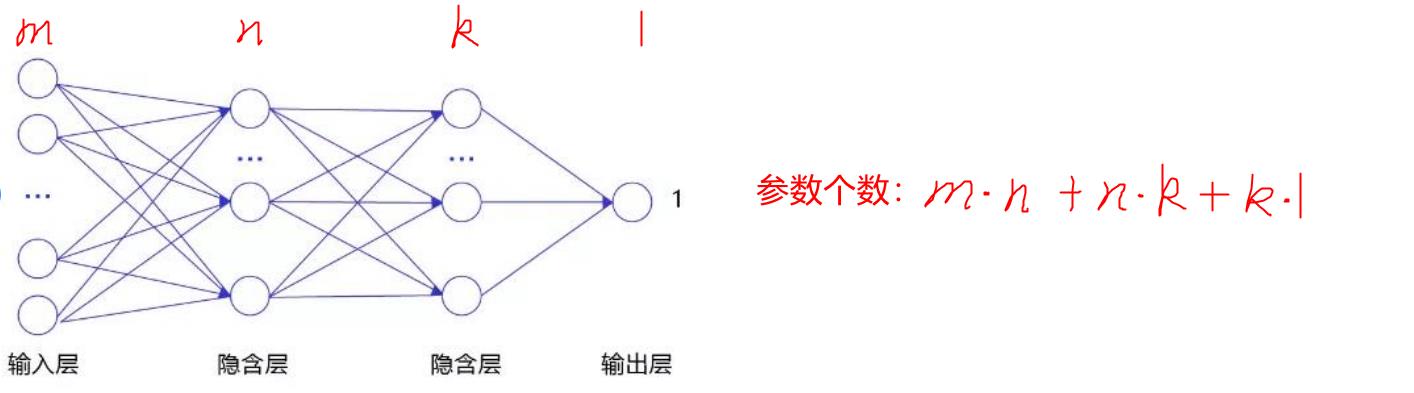

在全连接前馈神经网络中,如果第 层有 个神经元,第 层有 个神经元,连接边有 个,也就是权重矩阵有 个参数。当 和 都很大时,权重矩阵的参数非常多,训练的效率会非常低。

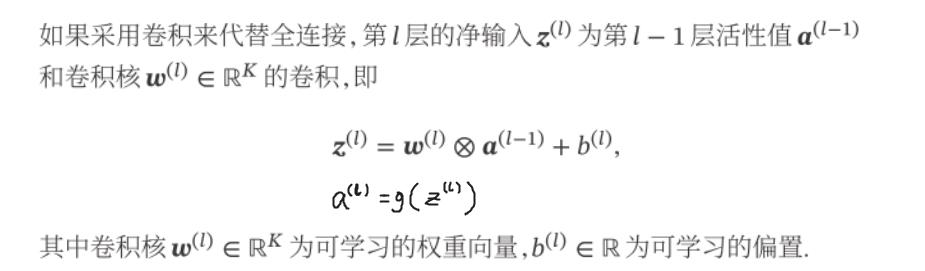

如果采用卷积来代替全连接,第 层的净输入 为第 层活性值 和滤波器 的卷积,即:

根据卷积的定义,卷积层有两个很重要的性质:

由于局部连接和权重共享,卷积层的参数只有一个m维的权重 和1维的偏置 ,共 个参数。参数个数和神经元的数量无关。此外,第 层的神经元个数不是任意选择的,而是满足 。

卷积层的作用是提取一个局部区域的特征,不同的卷积核相当于不同的特征提取器。

特征映射(Feature Map)为一幅图像(或其它特征映射)在经过卷积提取到的特征,每个特征映射可以作为一类抽取的图像特征。 为了提高卷积网络的表示能力,可以在每一层使用多个不同的特征映射,以更好地表示图像的特征。

在输入层,特征映射就是图像本身。如果是灰度图像,就是有一个特征映射,深度 ;如果是彩色图像,分别有RGB三个颜色通道的特征映射,深度 。

不失一般性,假设一个卷积层的结构如下:

为了计算输出特征映射 ,用卷积核 分别对输入特征映射 进行卷积,然后将卷积结果相加,并加上一个标量偏置 得到卷积层的净输入 再经过非线性激活函数后得到输出特征映射 。

在输入为 ,输出为 的卷积层中,每个输出特征映射都需要 个滤波器以及一个偏置。假设每个滤波器的大小为 ,那么共需要 个参数。

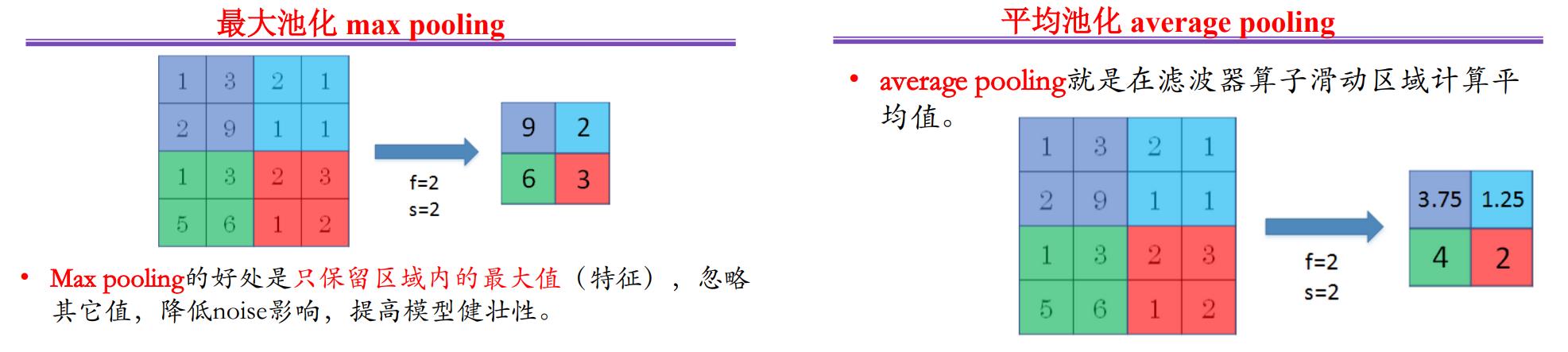

汇聚层(Pooling Layer)也叫子采样层(Subsampling Layer),其作用是进行特征选择,降低特征数量,并从而减少参数数量。

常用的汇聚函数有两种:

其中 为区域 内每个神经元的激活值。

可以看出,汇聚层不但可以有效地减少神经元的数量,还可以使得网络对一些小的局部形态改变保持不变性,并拥有更大的感受野。

典型的汇聚层是将每个特征映射划分为 大小的不重叠区域,然后使用最大汇聚的方式进行下采样。汇聚层也可以看做是一个特殊的卷积层,卷积核大小为 ,步长为 ,卷积核为 函数或 函数。过大的采样区域会急剧减少神经元的数量,会造成过多的信息损失。

一个典型的卷积网络是由卷积层、汇聚层、全连接层交叉堆叠而成。

目前常用卷积网络结构如图所示,一个卷积块为连续 个卷积层和 个汇聚层( 通常设置为 , 为 或 )。一个卷积网络中可以堆叠 个连续的卷积块,然后在后面接着 个全连接层( 的取值区间比较大,比如 或者更大; 一般为 )。

目前,整个网络结构 趋向于使用更小的卷积核(比如 和 )以及更深的结构(比如层数大于50) 。此外,由于卷积的操作性越来越灵活(比如不同的步长),汇聚层的作用变得也越来越小,因此目前比较流行的卷积网络中, 汇聚层的比例也逐渐降低,趋向于全卷积网络 。

在全连接前馈神经网络中,梯度主要通过每一层的误差项 进行反向传播,并进一步计算每层参数的梯度。在卷积神经网络中,主要有两种不同功能的神经层:卷积层和汇聚层。而参数为卷积核以及偏置,因此 只需要计算卷积层中参数的梯度。

不失一般性,第 层为卷积层,第 层的输入特征映射为 ,通过卷积计算得到第 层的特征映射净输入 ,第 层的第 个特征映射净输入

由 得:

同理可得,损失函数关于第 层的第 个偏置 的偏导数为:

在卷积网络中,每层参数的梯度依赖其所在层的误差项 。

卷积层和汇聚层中,误差项的计算有所不同,因此我们分别计算其误差项。

第 层的第 个特征映射的误差项 的具体推导过程如下:

其中 为第 层使用的激活函数导数, 为上采样函数(upsampling),与汇聚层中使用的下采样操作刚好相反。如果下采样是最大汇聚(max pooling),误差项 中每个值会直接传递到上一层对应区域中的最大值所对应的神经元,该区域中其它神经元的误差项的都设为0。如果下采样是平均汇聚(meanpooling),误差项 中每个值会被平均分配到上一层对应区域中的所有神经元上。

第 层的第 个特征映射的误差项 的具体推导过程如下:

其中 为宽卷积。

LeNet-5虽然提出的时间比较早,但是是一个非常成功的神经网络模型。基于LeNet-5 的手写数字识别系统在90年代被美国很多银行使用,用来识别支票上面的手写数字。LeNet-5 的网络结构如图:

不计输入层,LeNet-5共有7层,每一层的结构为:

AlexNet是第一个现代深度卷积网络模型,其首次使用了很多现代深度卷积网络的一些技术方法,比如采用了ReLU作为非线性激活函数,使用Dropout防止过拟合,使用数据增强来提高模型准确率等。AlexNet 赢得了2012 年ImageNet 图像分类竞赛的冠军。

AlexNet的结构如图,包括5个卷积层、3个全连接层和1个softmax层。因为网络规模超出了当时的单个GPU的内存限制,AlexNet 将网络拆为两半,分别放在两个GPU上,GPU间只在某些层(比如第3层)进行通讯。

AlexNet的具体结构如下:

在卷积网络中,如何设置卷积层的卷积核大小是一个十分关键的问题。 在Inception网络中,一个卷积层包含多个不同大小的卷积操作,称为Inception模块。Inception网络是由有多个inception模块和少量的汇聚层堆叠而成 。

v1版本的Inception模块,采用了4组平行的特征抽取方式,分别为1×1、3× 3、5×5的卷积和3×3的最大汇聚。同时,为了提高计算效率,减少参数数量,Inception模块在进行3×3、5×5的卷积之前、3×3的最大汇聚之后,进行一次1×1的卷积来减少特征映射的深度。如果输入特征映射之间存在冗余信息, 1×1的卷积相当于先进行一次特征抽取 。

参考技术A 卷积神经网络(Convolutional Neural Network,CNN)是一种常用于图像处理、计算机视觉和自然语言处理等领域的深度学习模型。它通过卷积操作来提取输入数据中的特征,具有平移不变性、参数共享和稀疏连接等优点。卷积神经网络主要由卷积层、池化层和全连接层等组成。其中,卷积层是卷积神经网络的核心部分,它通过滑动一个卷积核在输入数据上进行卷积操作,提取出数据的局部特征。池化层用于降低特征图的维度,减少计算量和内存消耗,一般采用最大池化或平均池化等方式。全连接层用于将卷积层和池化层提取的特征进行分类或回归等操作。

卷积神经网络的训练过程一般采用反向传播算法进行优化,通过对网络的参数进行迭代更新来使损失函数最小化。在训练过程中,常用的优化算法包括随机梯度下降(SGD)、Adam、Adagrad等。

卷积神经网络已经在图像分类、物体检测、语义分割、人脸识别等领域取得了广泛的应用,并且在深度学习领域中成为了非常重要的模型之一。

:卷积神经网络

文章目录

1. 为什么要使用卷积神经网络?

因为前馈神经网络存在如下缺点:

- 处理图像时,参数过多,导致训练效率低,也容易导致过拟合。 因为图像的维度比较高,而前馈神经网络参数个数是层之间乘积之和的形式,比如:

- 输入数据的空间信息被丢失。 因为全连接层的输入层是一维的,如果数据是多维的,比如二维的黑白图片,那么必须把它拉伸为一维数据才可以使用前馈神经网络,但这样就将空间信息丢失了。

因为卷积可以解决上面的两个问题,所以引入卷积代替全连接网络的点积运算。而全连接的隐藏层

2. 卷积

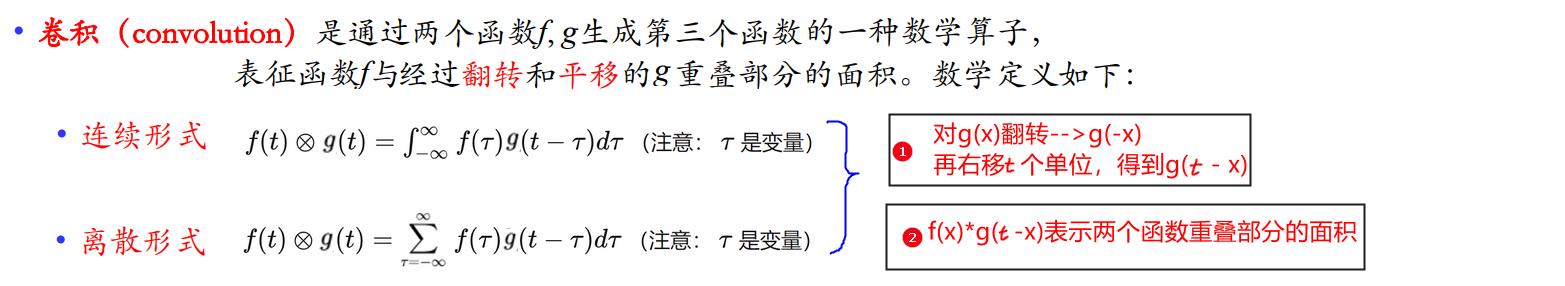

2.1 数学上的卷积

卷积本质上就是先将一个函数翻转,然后进行滑动叠加,从运算上来看就是先乘后加。整体流程是:翻转——>滑动——>叠加——>滑动——>叠加——>滑动——>叠加…

- 问:卷积中为什么要将g(x)翻转再平移?

- 答:卷积和加减乘除一样是个运算,规定的卷积运算过程就是这样。

① 从几何上看,就是翻转平移之后,能够将离散化的重叠面积整合到一起,能够用一个积分式表示;

② 从现实意义上看,f(x)、g(x)通过卷积运算得到的函数a(x)与f(x)具有很强的相关性。

2.2 深度学习的卷积

前面提到,f(x)、g(x)通过卷积运算得到的函数a(x)与f(x)具有很强的相关性。因此,将图片当做f(x),权重当做g(x),那么f(x)与g(x)通过卷积运算就可以得到图片f(x)的特征a(x)。

注意:在深度学习中的卷积运算,只是对卷积核平移,并不需要对卷积核做翻转。因为没有必要,卷积核本来就是参数,旋转只是将参数的位置变了,而特征翻转并为改变特征之间的相对位置,类似于做了一次线性变换,并不会影响训练结果。

因此,在深度学习中:

- 卷积:代表特征提取器

- 卷积核:代表权重参数

- 计算结果:代表图片的特征,即 特征图

- 感受野:卷积神经网络每一层输出的特征图(feature map)上的像素点在原始图像上映射的区域大小。

卷积网络卷积层越多,提取到的特征就越抽象,感受野将会越大,输出特征图中的一个像素点将会包含更多的图像语义信息。就像看一张照片,离的越远,越能看到完整的图片,同时更加的模糊抽象。所以,卷积层不可太多也不可太少。

相对于全连接神经网络来说就是:用卷积来代替全连接

3. 卷积的构成

- 卷积核:里面存放是权重参数,其维度通常与输入图像维度一样。

- 步长:每次滑动的长度

- 问:为什么要使用步长?

- 答:在卷积操作时,通常希望输出图像分辨率与输入图像分辨率相比会逐渐减少,即图像被约减。因此,可以通过改变卷积核在输入图像中移动步长大小来跳过一些像素,进行卷积滤波。

- 零填充:在图片扩大后在四周填零

问:为什么要零填充?

答:原始图片边缘信息对输出贡献得少,输出图片丢失边缘信息,使用零填充能够充分的利用边缘信息,使得最终模型预测效果更好。 - 特征图:图像与卷积核进行卷积运算得到的结

4. 卷积的特征

- 卷积层的卷积特征:

- 局部连接:在卷积层(假设是第 𝑙层)中的每一个神经元都只和上一层(第 𝑙 −1层)中某个窗口内的神经元都连接。

- 权重共享:第 𝑙 -1层的每个窗口都和相同的卷积核做内积,而卷积核就是权重参数。

- 局部连接:在卷积层(假设是第 𝑙层)中的每一个神经元都只和上一层(第 𝑙 −1层)中某个窗口内的神经元都连接。

- 池化层的卷积特征:空间或时间上的下采样

5. 卷积的计算

把握两个点:

- 卷积计算过程:无论是输入是几维,即无论是几通道,都是:内积求和–>滑动–>内积求和–>滑动…

- 给出输入大小、卷积核大小、零填充数、步长大小,能够计算输出大小。无论是输入是几维,计算公式都一样:

(1) 一维卷积计算

(2) 二维卷积计算(黑白图片)

黑白图片能够用一个二维矩阵表示,每一个像素点的范围是[0, 255]。

注意:

- 卷积核一般是正方形的。

- 输入图片可能不是正方形,这时计算输出大小时,长宽要分别计算。

(2) 三维卷积计算(彩色图片)

因为任意彩色可以用红绿黄三种颜色调和而成。所以彩色图片能够用一个三维矩阵表示,即能够用一个张量表示 𝑋 = (𝑋𝑅, 𝑋𝐺, 𝑋𝐵) 。其中𝑋𝑅, 𝑋𝐺, 𝑋𝐵是三个通道的数据,各自用矩阵表示。

注意:卷积核的维数通常与图片维数一样。

6. 卷积的优势

-

保留空间信息:对比全连接层将输入展开成一维的计算方式,卷积运算可以有效学习到输入数据的空间信息。

-

局部连接:对于二维图像,局部像素关联性较强,这种局部连接保证了训练后的滤波器能够对局部特征有最强的响应,使神经网络可以提取数据的局部特征。

-

权重共享:与图像计算的过程中,卷积核的权重是共享的,这就大大降低了网络的训练难度。

-

不同层级卷积提取不同特征:在卷积神经网络中,通过使用多层卷积进行堆叠,从而达到提取不同类型特征的作用。比如,浅层卷积提取的是图像中的边缘等信息;中层卷积提取的是图像中的局部信息;深层卷积提取的则是图像中的全局信息。这样,通过加深网络层数,CNN就可以有效地学习到图像从细节到全局的所有特征了

7. 卷积神经网络

- 本质:卷积网络本质上是一种输入到输出的映射,它能够学习大量的输入与输出之间的映射关系,而不需要任何输入和输出之间的精确的数学表达式,只要用已知的模式对卷积网络加以训练,网络就具有输入输出对之间的映射能力。

- 组成:

- 应用场景:卷积神经网络以其局部权值共享的特殊结构在语音识别和图像处理方面有着独特的优越性。

7.1 卷积层

- 作用:提取一个图片的特征,不同的卷积核相当于不同的特征提取器。

- 计算:卷积后还要加上偏置,再经过激活函数

7.2 池化层

-

作用:Pooling layers是CNN中用来对特征进行缩小概括的,降低特征数量,从而减少参数数量,提高运算速度的,同样能减小noise影响,让各特征更具有健壮性。

-

关于上采样和下采样:

① 上采样:使数据矩阵变大

② 下采样:使数据矩阵变小 -

池化标准:采样下采样,一般是Max或Average

7.3 全连接层

在全连接层中,我们将最后一个卷积层的输出展平,然后与下一次进行全连接。

8. 前向传播

9. 反向传播

CNN反向传播的不同之处:

-

首先要注意的是,一般神经网络中每一层输入输出a,z都只是一个向量,而CNN中的a,z是一个三维张量,即由若干个输入的子矩阵组成。

-

其次:

- 池化层没有激活函数。这个问题倒比较好解决,令池化层的激活函数为其本身,即𝑓(𝑧) = 𝑧。这样池化层激活函数的导数为1。

- 池化层在前向传播的时候,对输入进行了压缩,那么我们向前反向推导上一层的误差时,需要做upsample(上采样) 处理。

- 卷积层是通过张量卷积,或者说若干个矩阵卷积求和而得到当前层的输出,这和一般的网络直接进行矩阵乘法得到当前层的输出不同。这样在卷积层反向传播的时候,上一层误差的计算方法肯定有所不同。

- 卷积层 W使用的运算是卷积,那么由该层误差推导出该层的所有卷积核的W,b的方式也不同。

虽然CNN的反向传播和DNN有所不同,但本质上还是4个核心公式的变形,思路是一样的。

9.1 池化层的反向传播算法

- 第一步:正向求激活值:前面已经介绍使用max或average求输出

- 第二步:反向求误差:

首先,回顾一下全连接神经网络的反向传播的四个核心公式:

反向传播就是要从缩小后的误差δ𝑙+1,还原池化前较大区域对应的误差δ𝑙。也就是说要根据上面的第二个式子计算误差:- f 𝑙 ′ ( z ( 𝑙 ) ) f_𝑙^' (z^(𝑙)) fl′(z(l)) 是已知的

-

(

W

l

+

1

)

T

δ

l

+

1

(W^l+1)^T\\delta ^l+1

(Wl+1)Tδl+1 不知道,如何求?

- 第三步:更新参数w,b:由于池化层没有参数,所以没有w,b的更新

9.2 卷积层的反向传播

-

第一步:正向求激活值

-

第二步:反向求误差:

-

第三步:更新参数w,b

-

更新w

-

更新b

-

10. 典型的卷积神经网络

- LeNet:典型的卷积神经网络

- AlexNet

- VGG

- GooLeNet

- ResNet

- DenseNet

11. 总结

11.1 关于输出尺寸和参数个数的计算

例题:

11.2 与全连接神经网络的区别

- CNN一个非常重要的特点就是头重脚轻(越往输入权值越少,越往输出权值越多),呈现出一个倒三角的形态,这就很好地避免了BP神经网络中反向传播的时候梯度损失得太快。

- 由于CNN的特征检测层通过训练数据进行学习,所以在使用CNN时,避免了显式的特征抽取,而隐式地从训练数据中进行学习;而全连接神经网络的特征抽取和模型训练分开独立的。

- 由于同一特征映射面上的神经元权值相同,所以网络可以并行学习,这也是卷积网络相对于神经元彼此相连网络的一大优势

以上是关于卷积神经网络的主要内容,如果未能解决你的问题,请参考以下文章