15.容错机制Checkpoint和State执行流程状态后端/存储介质State状态后端/State存储介质可选的状态存储方式状态恢复和重启策略自动重启策略和恢复Savepoint

Posted 涂作权的博客

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了15.容错机制Checkpoint和State执行流程状态后端/存储介质State状态后端/State存储介质可选的状态存储方式状态恢复和重启策略自动重启策略和恢复Savepoint相关的知识,希望对你有一定的参考价值。

本文来自:Flink1.12-2021黑马程序员贺岁视频 的学习笔记

15.容错机制

15.1.Checkpoint

15.1.1.Checkpoint和State

15.1.2.Checkpoint执行流程

15.1.3.状态后端/存储介质

15.1.3.1.State状态后端/State存储介质

15.1.3.2.可选的状态存储方式–MemoryStateBackend

15.1.3.3.可选的状态存储方式–FsStateBackend

15.1.3.4.可选的状态存储方式–RocksDBStateBackend

15.1.4.Checkpoint代码演示

15.2.状态恢复和重启策略

15.2.1.自动重启策略和恢复

15.2.2.手动重启-半自动-了解

15.3.Savepoint–全手动–了解

15.3.1.Savepoint VS Checkpoint

15.3.2.演示

15.容错机制

15.1.Checkpoint

15.1.1.Checkpoint和State

State

维护/存储的是某一个Operator的运行的状态/历史值,是维护在内存中!

一般指一个具体的Operator的状态(operator的状态表示一些算子在运行的过程中会产生的一些历史结果,如前面的maxBy底层会维护当前的最大值,也就是会维护一个keyedOperator,这个State里面存放就是maxBy这个Operator中的最大值)。

State数据默认保存在Java的堆内存中/TaskManager节点的内存中。

State可以被记录,在失败的情况下数据还可以恢复。

Checkpoint

某一时刻,Flink中所有的Operator的当前State的全局快照,一般存在磁盘上。

表示一个Flink Job在一个特定时刻的一份全局状态快照,即包含了所有Operator的状态。

可以理解为Checkpoint是把State数据定时持久存储了。

比如KafkaConsumer算子中维护的Offset状态,当任务重新恢复的时候可以从Checkpoint中获取。

15.1.2.Checkpoint执行流程

0.Flink的JobManager创建CheckpointCoordinator

1.Coordinator向所有的SourceOperator发送Barrier栅栏(理解为执行Checkpoint的信号)

2.SourceOperator接收到Barrier之后,暂停当前的操作(暂停的时间很短,因为后续的写快照是异步的),并制作State快照, 然后将自己的快照保存到指定的介质中(如HDFS), 一切 ok之后向Coordinator汇报并将Barrier发送给下游的其他Operator

3.其他的如TransformationOperator接收到Barrier,重复第2步,最后将Barrier发送给Sink

4.Sink接收到Barrier之后重复第2步

5.Coordinator接收到所有的Operator的执行ok的汇报结果,认为本次快照执行成功

Flink中的Checkpoint底层使用了Chandy-Lamport algorithm分布式快照算法可以保证数据的在分布式环境下的一致性!

https://zhuanlan.zhihu.com/p/53482103

Chandy-Lamport algorithm算法的作者也是ZK中Paxos 一致性算法的作者.

https://www.cnblogs.com/shenguanpu/p/4048660.html

Flink中使用Chandy-Lamport algorithm分布式快照算法取得了成功,后续Spark的StructuredStreaming也借鉴了该算法.

15.1.3.状态后端/存储介质

15.1.3.1.State状态后端/State存储介质

注意:

前面学习了Checkpoint其实就是Flink中某一时刻,所有的Operator的全局快照,那么快照应该要有一个地方进行存储,而这个存储的地方叫做状态后端。

Flink中的State状态后端有很多种:

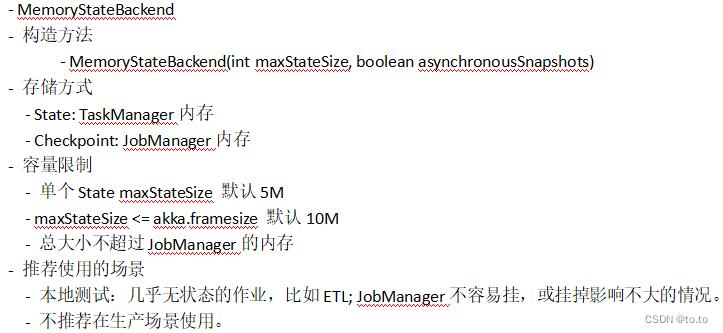

15.1.3.2.可选的状态存储方式–MemoryStateBackend

15.1.3.3.可选的状态存储方式–FsStateBackend

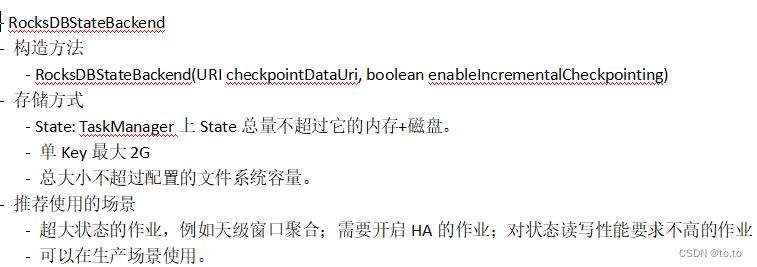

15.1.3.4.可选的状态存储方式–RocksDBStateBackend

所需的依赖:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-statebackend-rocksdb_2.12</artifactId>

<version>1.12.0</version>

</dependency>

15.1.4.Checkpoint代码演示

https://ci.apache.org/projects/flink/flink-docs-release-1.12/dev/stream/state/checkpointing.html

package day4;

import org.apache.commons.lang.SystemUtils;

import org.apache.flink.api.common.RuntimeExecutionMode;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.common.functions.RichMapFunction;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.runtime.state.filesystem.FsStateBackend;

import org.apache.flink.streaming.api.CheckpointingMode;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.datastream.KeyedStream;

import org.apache.flink.streaming.api.datastream.SingleOutputStreamOperator;

import org.apache.flink.streaming.api.environment.CheckpointConfig;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaProducer;

import org.apache.flink.util.Collector;

import java.util.Properties;

/**

* @author tuzuoquan

* @date 2022/5/30 21:32

*/

public class CheckpointDemo01

public static void main(String[] args) throws Exception

//1.env

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.setRuntimeMode(RuntimeExecutionMode.AUTOMATIC);

//TODO ===========Checkpoint参数设置====

//===========类型1:必须参数=============

//设置Checkpoint的时间间隔为1000ms做一次Checkpoint/其实就是每隔1000ms发一次Barrier!

env.enableCheckpointing(1000);

//设置State状态存储介质/状态后端

//Memory:State存内存,Checkpoint存内存--开发不用!

//Fs:State存内存,Checkpoint存FS(本地/HDFS)--一般情况下使用

//RocksDB:State存RocksDB(内存+磁盘),Checkpoint存FS(本地/HDFS)--超大状态使用,但是对于状态的读写效率要低一点

/*if(args.length > 0)

env.setStateBackend(new FsStateBackend(args[0]));

else

env.setStateBackend(new FsStateBackend("file:///D:\\\\data\\\\ckp"));

*/

if (SystemUtils.IS_OS_WINDOWS)

env.setStateBackend(new FsStateBackend("file:///D:/ckp"));

else

env.setStateBackend(new FsStateBackend("hdfs://node1:8020/flink-checkpoint/checkpoint"));

//===========类型2:建议参数===========

//设置两个Checkpoint 之间最少等待时间,如设置Checkpoint之间最少是要等 500ms(为了避免每隔1000ms做一次Checkpoint的时候,前一次太慢和后一次重叠到一起去了)

//如:高速公路上,每隔1s关口放行一辆车,但是规定了两车之前的最小车距为500m

env.getCheckpointConfig().setMinPauseBetweenCheckpoints(500);//默认是0

//设置如果在做Checkpoint过程中出现错误,是否让整体任务失败:true是 false不是

//env.getCheckpointConfig().setFailOnCheckpointingErrors(false);//默认是true

env.getCheckpointConfig().setTolerableCheckpointFailureNumber(10);//默认值为0,表示不容忍任何检查点失败

//设置是否清理检查点,表示 Cancel 时是否需要保留当前的 Checkpoint,默认 Checkpoint会在作业被Cancel时被删除

//ExternalizedCheckpointCleanup.DELETE_ON_CANCELLATION:true,当作业被取消时,删除外部的checkpoint(默认值)

//ExternalizedCheckpointCleanup.RETAIN_ON_CANCELLATION:false,当作业被取消时,保留外部的checkpoint

env.getCheckpointConfig().enableExternalizedCheckpoints(CheckpointConfig.ExternalizedCheckpointCleanup.RETAIN_ON_CANCELLATION);

//===========类型3:直接使用默认的即可===============

//设置checkpoint的执行模式为EXACTLY_ONCE(默认)

env.getCheckpointConfig().setCheckpointingMode(CheckpointingMode.EXACTLY_ONCE);

//设置checkpoint的超时时间,如果 Checkpoint在 60s内尚未完成说明该次Checkpoint失败,则丢弃。

env.getCheckpointConfig().setCheckpointTimeout(60000);//默认10分钟

//设置同一时间有多少个checkpoint可以同时执行

//env.getCheckpointConfig().setMaxConcurrentCheckpoints(1);//默认为1

//2.Source

DataStream<String> linesDS = env.socketTextStream("node1", 9999);

//3.Transformation

//3.1切割出每个单词并直接记为1

DataStream<Tuple2<String, Integer>> wordAndOneDS = linesDS.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>()

@Override

public void flatMap(String value, Collector<Tuple2<String, Integer>> out) throws Exception

//value就是每一行

String[] words = value.split(" ");

for (String word : words)

out.collect(Tuple2.of(word, 1));

);

//3.2分组

//注意:批处理的分组是groupBy,流处理的分组是keyBy

KeyedStream<Tuple2<String, Integer>, String> groupedDS = wordAndOneDS.keyBy(t -> t.f0);

//3.3聚合

DataStream<Tuple2<String, Integer>> aggResult = groupedDS.sum(1);

DataStream<String> result = (SingleOutputStreamOperator<String>) aggResult.map(new RichMapFunction<Tuple2<String, Integer>, String>()

@Override

public String map(Tuple2<String, Integer> value) throws Exception

return value.f0 + ":::" + value.f1;

);

//4.sink

result.print();

Properties props = new Properties();

props.setProperty("bootstrap.servers", "node1:9092");

FlinkKafkaProducer<String> kafkaSink = new FlinkKafkaProducer<>("flink_kafka", new SimpleStringSchema(), props);

result.addSink(kafkaSink);

//5.execute

env.execute();

// /export/server/kafka/bin/kafka-console-consumer.sh --bootstrap-server node1:9092 --topic flink_kafka

15.2.状态恢复和重启策略

15.2.1.自动重启策略和恢复

重启策略分类

- 默认重启策略

- 无重启策略

- 固定延迟重启策略—开发中使用

- 失败率重启策略–开发偶尔使用

import org.apache.commons.lang3.SystemUtils;

import org.apache.flink.api.common.RuntimeExecutionMode;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.common.functions.RichMapFunction;

import org.apache.flink.api.common.restartstrategy.RestartStrategies;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.api.common.time.Time;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.runtime.state.filesystem.FsStateBackend;

import org.apache.flink.streaming.api.CheckpointingMode;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.datastream.KeyedStream;

import org.apache.flink.streaming.api.datastream.SingleOutputStreamOperator;

import org.apache.flink.streaming.api.environment.CheckpointConfig;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaProducer;

import org.apache.flink.util.Collector;

import java.util.Properties;

import java.util.concurrent.TimeUnit;

/**

* Desc 演示Flink-Checkpoint+重启策略实现状态恢复

*

* @author tuzuoquan

* @date 2022/6/1 0:15

*/

public class CheckpointDemo02_Restart

public static void main(String[] args) throws Exception

//1.env

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.setRuntimeMode(RuntimeExecutionMode.AUTOMATIC);

//TODO ===========Checkpoint参数设置====

//===========类型1:必须参数=============

//设置Checkpoint的时间间隔为1000ms做一次Checkpoint/其实就是每隔1000ms发一次Barrier!

env.enableCheckpointing(1000);

//设置State状态存储介质/状态后端

//Memory:State存内存,Checkpoint存内存--开发不用!

//Fs:State存内存,Checkpoint存FS(本地/HDFS)--一般情况下使用

//RocksDB:State存RocksDB(内存+磁盘),Checkpoint存FS(本地/HDFS)--超大状态使用,但是对于状态的读写效率要低一点

/*if(args.length > 0)

env.setStateBackend(new FsStateBackend(args[0]));

else

env.setStateBackend(new FsStateBackend("file:///D:\\\\data\\\\ckp"));

*/

if (SystemUtils.IS_OS_WINDOWS)

env.setStateBackend(new FsStateBackend("file:///D:/ckp"));

else

env.setStateBackend(new FsStateBackend("hdfs://node1:8020/flink-checkpoint/checkpoint"));

//===========类型2:建议参数===========

//设置两个Checkpoint 之间最少等待时间,如设置Checkpoint之间最少是要等 500ms(为了避免每隔1000ms做一次Checkpoint的时候,前一次太慢和后一次重叠到一起去了)

//如:高速公路上,每隔1s关口放行一辆车,但是规定了两车之前的最小车距为500m

env.getCheckpointConfig().setMinPauseBetweenCheckpoints(500);//默认是0

//设置如果在做Checkpoint过程中出现错误,是否让整体任务失败:true是 false不是

//env.getCheckpointConfig().setFailOnCheckpointingErrors(false);//默认是true

env.getCheckpointConfig().setTolerableCheckpointFailureNumber(10);//默认值为0,表示不容忍任何检查点失败

//设置是否清理检查点,表示 Cancel 时是否需要保留当前的 Checkpoint,默认 Checkpoint会在作业被Cancel时被删除

//ExternalizedCheckpointCleanup.DELETE_ON_CANCELLATION:true,当作业被取消时,删除外部的checkpoint(默认值)

//ExternalizedCheckpointCleanup.RETAIN_ON_CANCELLATION:false,当作业被取消时,保留外部的checkpoint

env.getCheckpointConfig().enableExternalizedCheckpoints(CheckpointConfig.ExternalizedCheckpointCleanup.RETAIN_ON_CANCELLATION);

//===========类型3:直接使用默认的即可===============

//设置checkpoint的执行模式为EXACTLY_ONCE(默认)

env.getCheckpointConfig().setCheckpointingMode(CheckpointingMode.EXACTLY_ONCE);

//设置checkpoint的超时时间,如果 Checkpoint在 60s内尚未完成说明该次Checkpoint失败,则丢弃。

env.getCheckpointConfig().setCheckpointTimeout(60000);//默认10分钟

//设置同一时间有多少个checkpoint可以同时执行

env.getCheckpointConfig().setMaxConcurrentCheckpoints(1);//默认为1

//TODO ===配置重启策略:

//1.配置了Checkpoint的情况下不做任务配置:默认是无限重启并自动恢复,可以解决小问题,但是可能会隐藏真正的bug

//2.单独配置无重启策略

//env.setRestartStrategy(RestartStrategies.noRestart());

//3.固定延迟重启--开发中常用

env.setRestartStrategy(RestartStrategies.fixedDelayRestart(

3, // 最多重启3次数

Time.of(5, TimeUnit.SECONDS) // 重启时间间隔

));

//上面的设置表示:如果job失败,重启3次, 每次间隔5s

//4.失败率重启--开发中偶尔使用

/*env.setRestartStrategy(RestartStrategies.failureRateRestart(

3, // 每个测量阶段内最大失败次数

Time.of(1, TimeUnit.MINUTES), //失败率测量的时间间隔

Time.of(3, TimeUnit.SECONDS) // 两次连续重启的时间间隔

));*/

//上面的设置表示:如果1分钟内job失败不超过三次,自动重启,每次重启间隔3s (如果1分钟内程序失败达到3次,则程序退出)

//2.Source

DataStream<String> linesDS = env.socketTextStream("node1", 9999);

//3.Transformation

//3.1切割出每个单词并直接记为1

DataStream<Tuple2<String, Integer>> wordAndOneDS = linesDS.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>()

@Override

public void flatMap(String value, Collector<Tuple2<String, Integer>> out) throws Exception

//value就是每一行

String[] words = value.split(" ");

for (String word : words)

if (word.equals("bug"))

System.out.println("bug.....");

throw new Exception("bug.....");

out.collect(Tuple2.of(word, 1));

);

//3.2分组

//注意:批处理的分组是groupBy,流处理的分组是keyBy

KeyedStream<Tuple2<String, Integer>, String> groupedDS = wordAndOneDS.keyBy(t -> t.f0);

//3.3聚合

DataStream<Tuple2<String, Integer>> aggResult = groupedDS.sum(1);

DataStream<String> result = (SingleOutputStreamOperator<String>) aggResult.map(new RichMapFunction<Tuple2<String, Integer>, String>()

@Override

public String map(Tuple2<String, Integer> value) throws Exception

return value.f0 + ":::" + value.f1;

);

//4.sink

result.print();

Properties props = new Properties();

props.setProperty("bootstrap.servers", "node1:9092");

FlinkKafkaProducer以上是关于15.容错机制Checkpoint和State执行流程状态后端/存储介质State状态后端/State存储介质可选的状态存储方式状态恢复和重启策略自动重启策略和恢复Savepoint的主要内容,如果未能解决你的问题,请参考以下文章