NNDL第三次作业

Posted 刘先生TT

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了NNDL第三次作业相关的知识,希望对你有一定的参考价值。

文章目录

前言

写这次作业的时候,由于正逢疫情,要统计各种日报表,核酸信息,没有腾出来大部分时间来进行作业。利用各种业余时间给写完了,真诚的感受到了疫情带给人们的生活上的困苦,希望疫情早日过去。

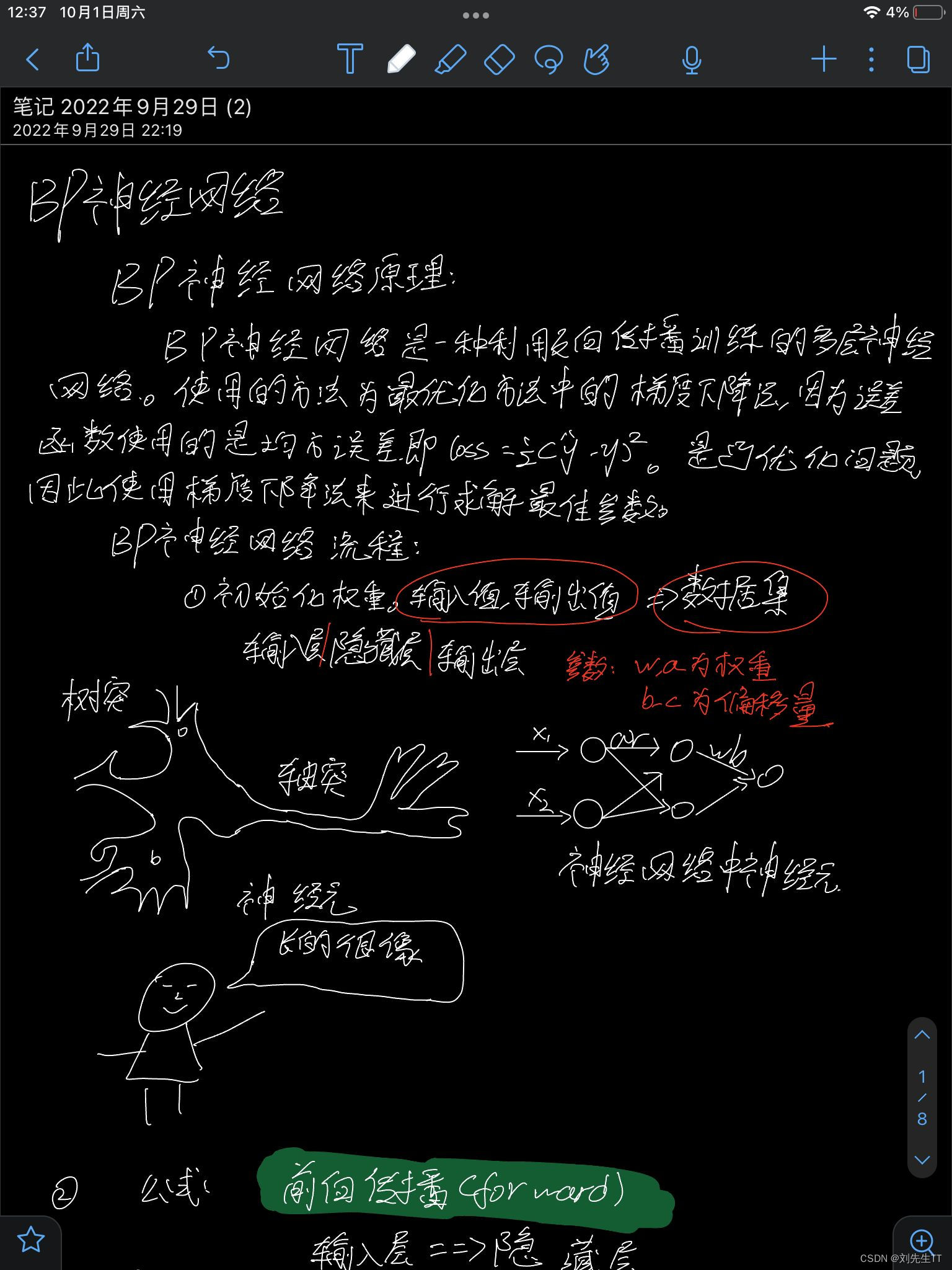

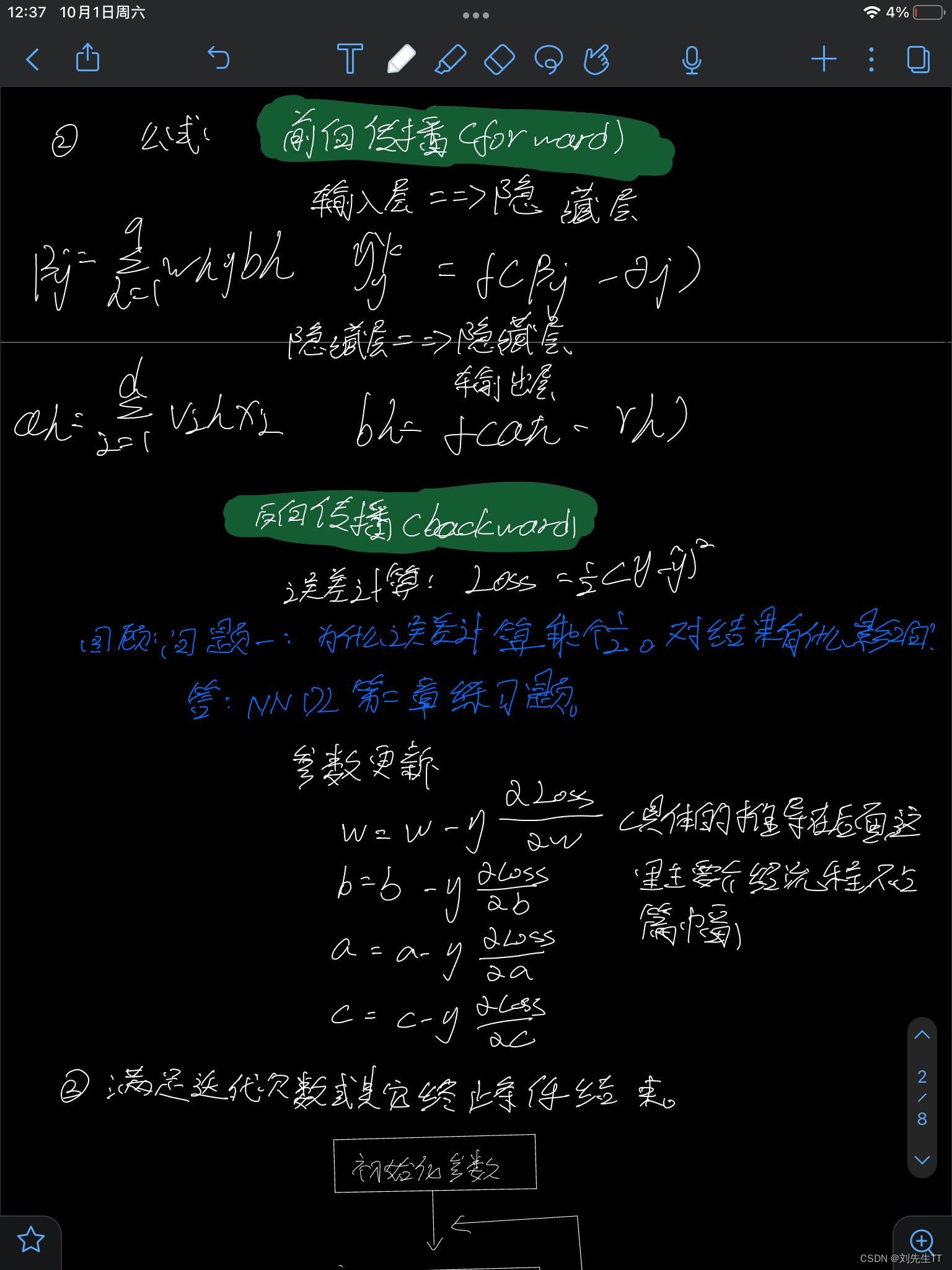

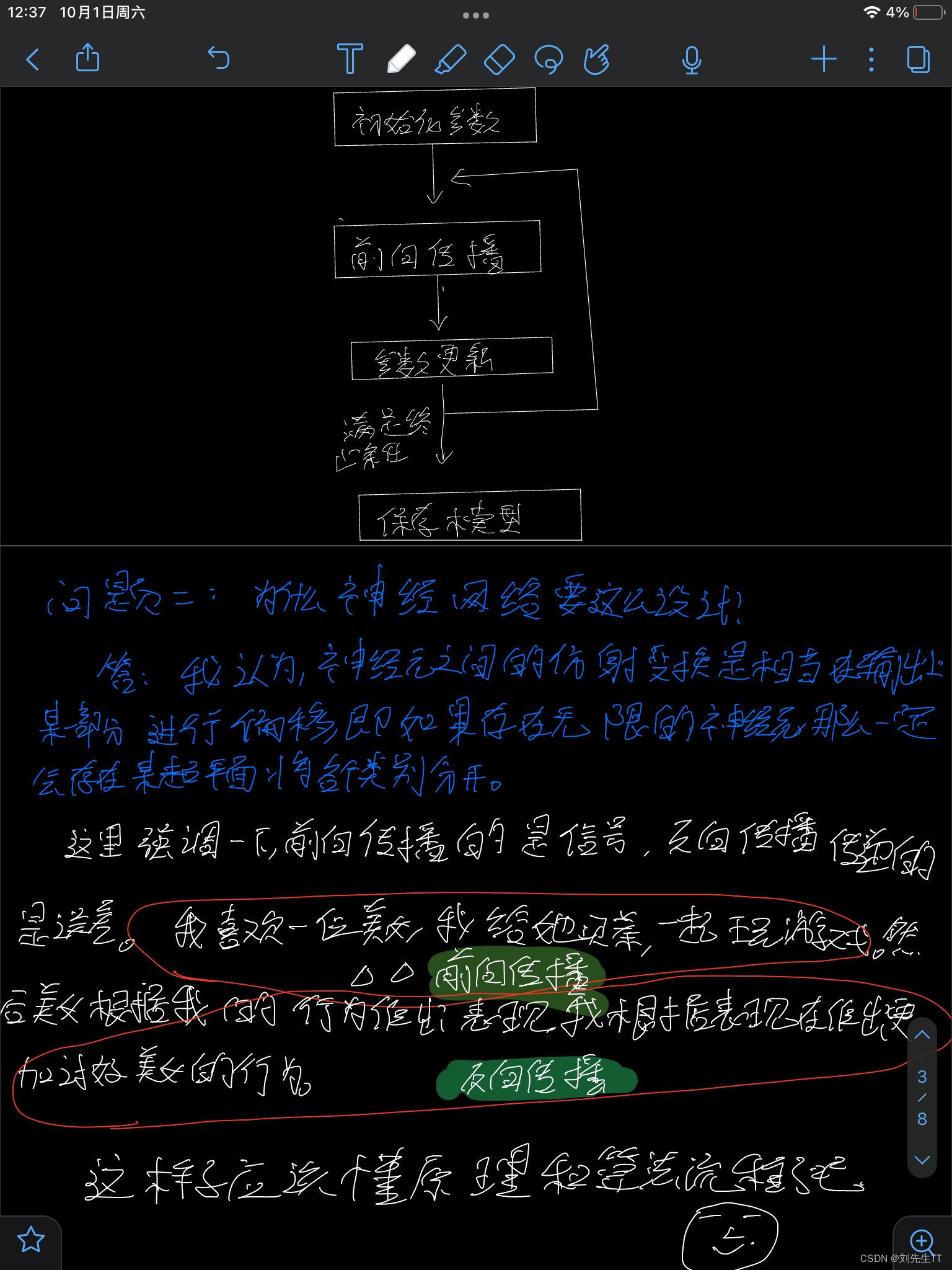

下面说说这次作业,神经网络主要是拟合人的神经来实现预测,原理这方面,我的思路是在人工神经的基础上进行分析,通过人工神经工作的原理,进而推出人工神经网络的工作的原理,而公式推导在机器学习中已经推导过了,相当于一个回顾了,代码实现则是对算法的体现,

作业

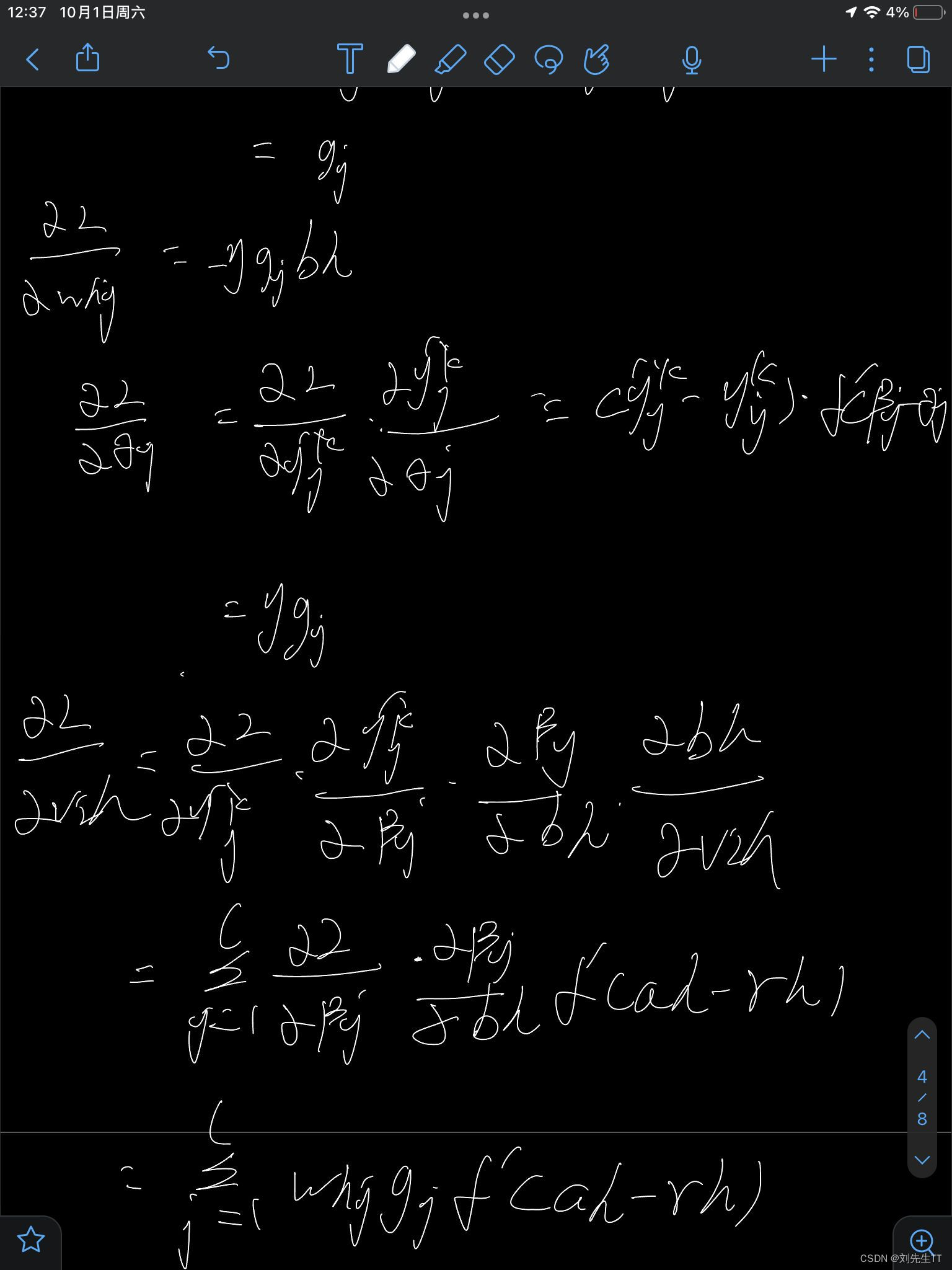

神经网络原理

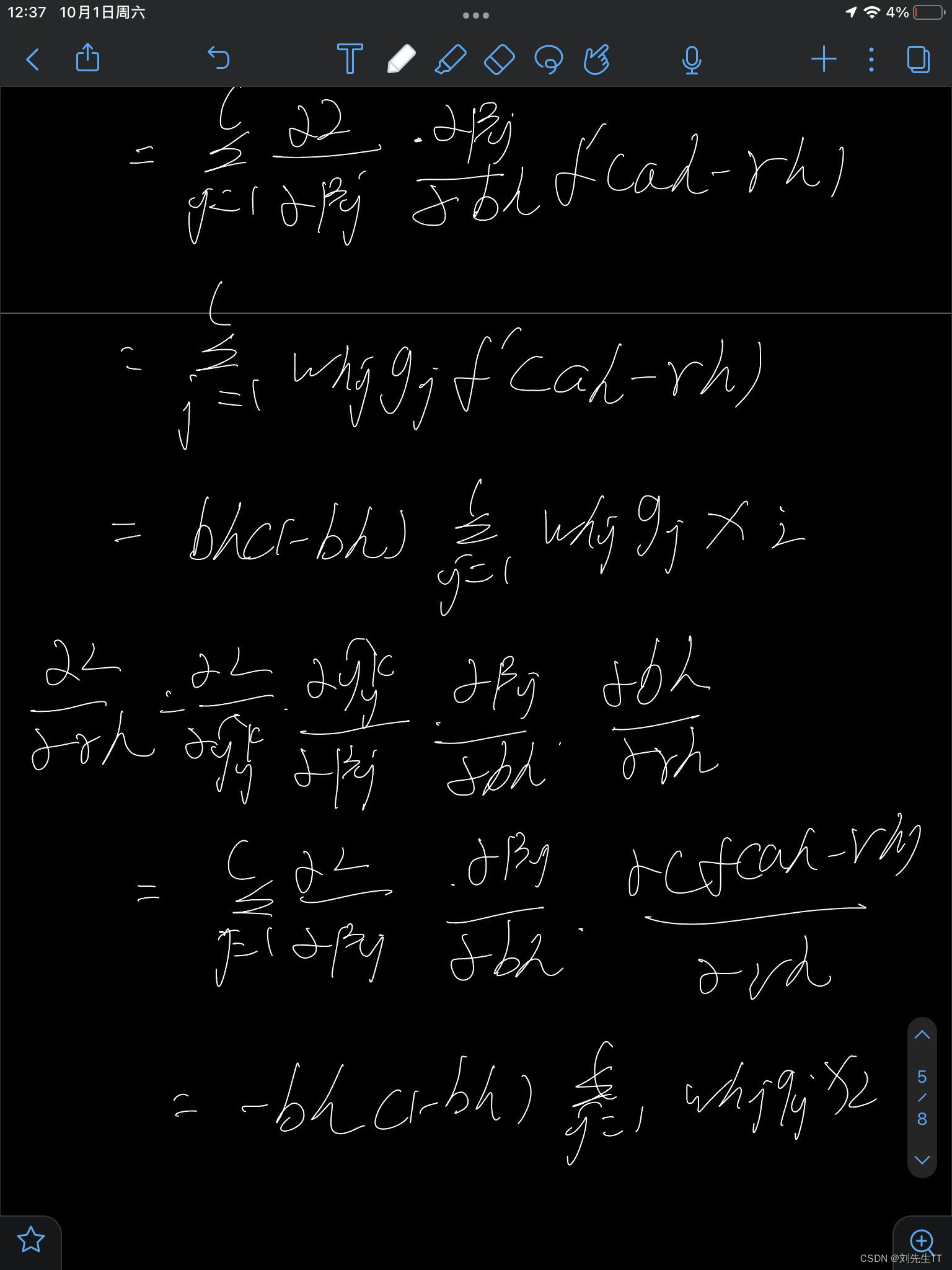

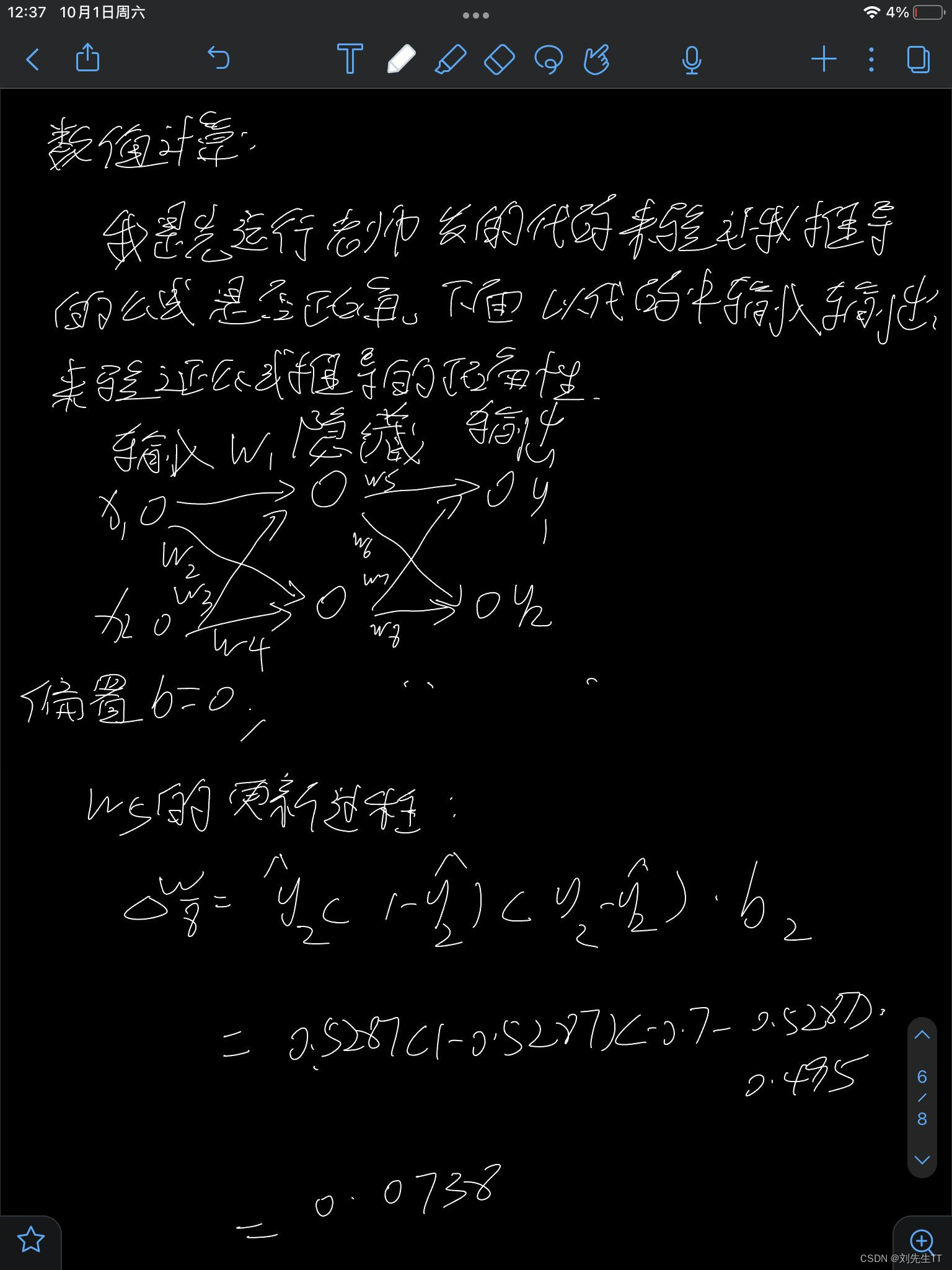

数值计算

代码实现

代码

'''

torch版本

'''

# -*- coding: utf-8 -*-

# @Time : 2022-10-01 12:11

# @Author : Mr.Liu

# @Email : 2781700291@qq.com

# @File : torch版本.py

# @ProjectName: python

# https://blog.csdn.net/qq_41033011/article/details/109325070

# https://github.com/Darwlr/Deep_learning/blob/master/06%20Pytorch%E5%AE%9E%E7%8E%B0%E5%8F%8D%E5%90%91%E4%BC%A0%E6%92%AD.ipynb

# torch.nn.Sigmoid(h_in)

import torch

x1, x2 = torch.Tensor([0.5]), torch.Tensor([0.3])

y1, y2 = torch.Tensor([0.23]), torch.Tensor([-0.07])

print("=====输入值:x1, x2;真实输出值:y1, y2=====")

print(x1, x2, y1, y2)

w1, w2, w3, w4, w5, w6, w7, w8 = torch.Tensor([0.2]), torch.Tensor([-0.4]), torch.Tensor([0.5]), torch.Tensor(

[0.6]), torch.Tensor([0.1]), torch.Tensor([-0.5]), torch.Tensor([-0.3]), torch.Tensor([0.8]) # 权重初始值

w1.requires_grad = True

w2.requires_grad = True

w3.requires_grad = True

w4.requires_grad = True

w5.requires_grad = True

w6.requires_grad = True

w7.requires_grad = True

w8.requires_grad = True

def sigmoid(z):

a = 1 / (1 + torch.exp(-z))

return a

def forward_propagate(x1, x2):

in_h1 = w1 * x1 + w3 * x2

out_h1 = sigmoid(in_h1) # out_h1 = torch.sigmoid(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = sigmoid(in_h2) # out_h2 = torch.sigmoid(in_h2)

print("out_h1 ".format(out_h2))

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = sigmoid(in_o1) # out_o1 = torch.sigmoid(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = sigmoid(in_o2) # out_o2 = torch.sigmoid(in_o2)

print("正向计算:o1 ,o2")

print(out_o1.data, out_o2.data)

return out_o1, out_o2

def loss_fuction(x1, x2, y1, y2): # 损失函数

y1_pred, y2_pred = forward_propagate(x1, x2) # 前向传播

loss = (1 / 2) * (y1_pred - y1) ** 2 + (1 / 2) * (y2_pred - y2) ** 2 # 考虑 : t.nn.MSELoss()

print("损失函数(均方误差):", loss.item())

return loss

def update_w(w1, w2, w3, w4, w5, w6, w7, w8):

# 步长

step = 1

w1.data = w1.data - step * w1.grad.data

w2.data = w2.data - step * w2.grad.data

w3.data = w3.data - step * w3.grad.data

w4.data = w4.data - step * w4.grad.data

w5.data = w5.data - step * w5.grad.data

w6.data = w6.data - step * w6.grad.data

w7.data = w7.data - step * w7.grad.data

w8.data = w8.data - step * w8.grad.data

w1.grad.data.zero_() # 注意:将w中所有梯度清零

w2.grad.data.zero_()

w3.grad.data.zero_()

w4.grad.data.zero_()

w5.grad.data.zero_()

w6.grad.data.zero_()

w7.grad.data.zero_()

w8.grad.data.zero_()

return w1, w2, w3, w4, w5, w6, w7, w8

if __name__ == "__main__":

print("=====更新前的权值=====")

print(w1.data, w2.data, w3.data, w4.data, w5.data, w6.data, w7.data, w8.data)

for i in range(1):

print("=====第" + str(i) + "轮=====")

L = loss_fuction(x1, x2, y1, y2) # 前向传播,求 Loss,构建计算图

L.backward() # 自动求梯度,不需要人工编程实现。反向传播,求出计算图中所有梯度存入w中

print("\\tgrad W: ", round(w1.grad.item(), 2), round(w2.grad.item(), 2), round(w3.grad.item(), 2),

round(w4.grad.item(), 2), round(w5.grad.item(), 2), round(w6.grad.item(), 2), round(w7.grad.item(), 2),

round(w8.grad.item(), 2))

w1, w2, w3, w4, w5, w6, w7, w8 = update_w(w1, w2, w3, w4, w5, w6, w7, w8)

print("更新后的权值")

print(w1.data, w2.data, w3.data, w4.data, w5.data, w6.data, w7.data, w8.data)

'''

numpy

''''

# -*- coding: utf-8 -*-

# @Time : 2022-10-01 12:10

# @Author : Mr.Liu

# @Email : 2781700291@qq.com

# @File : NNDL作业.py

# @ProjectName: python

import numpy as np

def sigmoid(z):

a = 1 / (1 + np.exp(-z))

return a

def forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8):

in_h1 = w1 * x1 + w3 * x2

out_h1 = sigmoid(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = sigmoid(in_h2)

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = sigmoid(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = sigmoid(in_o2)

print("正向计算:o1 ,o2")

print(round(out_o1, 5), round(out_o2, 5))

error = (1 / 2) * (out_o1 - y1) ** 2 + (1 / 2) * (out_o2 - y2) ** 2

print("损失函数:均方误差")

print(round(error, 5))

return out_o1, out_o2, out_h1, out_h2

def back_propagate(out_o1, out_o2, out_h1, out_h2):

# 反向传播

d_o1 = out_o1 - y1

d_o2 = out_o2 - y2

# print(round(d_o1, 2), round(d_o2, 2))

d_w5 = d_o1 * out_o1 * (1 - out_o1) * out_h1

d_w7 = d_o1 * out_o1 * (1 - out_o1) * out_h2

# print(round(d_w5, 2), round(d_w7, 2))

d_w6 = d_o2 * out_o2 * (1 - out_o2) * out_h1

d_w8 = d_o2 * out_o2 * (1 - out_o2) * out_h2

# print(round(d_w6, 2), round(d_w8, 2))

d_w1 = (d_w5 + d_w6) * out_h1 * (1 - out_h1) * x1

d_w3 = (d_w5 + d_w6) * out_h1 * (1 - out_h1) * x2

# print(round(d_w1, 2), round(d_w3, 2))

d_w2 = (d_w7 + d_w8) * out_h2 * (1 - out_h2) * x1

d_w4 = (d_w7 + d_w8) * out_h2 * (1 - out_h2) * x2

# print(round(d_w2, 2), round(d_w4, 2))

print("反向传播:误差传给每个权值")

print(round(d_w1, 5), round(d_w2, 5), round(d_w3, 5), round(d_w4, 5), round(d_w5, 5), round(d_w6, 5),

round(d_w7, 5), round(d_w8, 5))

return d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8

def update_w(w1, w2, w3, w4, w5, w6, w7, w8):

# 步长

step = 5

w1 = w1 - step * d_w1

w2 = w2 - step * d_w2

w3 = w3 - step * d_w3

w4 = w4 - step * d_w4

w5 = w5 - step * d_w5

w6 = w6 - step * d_w6

w7 = w7 - step * d_w7

w8 = w8 - step * d_w8

return w1, w2, w3, w4, w5, w6, w7, w8

if __name__ == "__main__":

w1, w2, w3, w4, w5, w6, w7, w8 = 0.2, -0.4, 0.5, 0.6, 0.1, -0.5, -0.3, 0.8

x1, x2 = 0.5, 0.3

y1, y2 = 0.23, -0.07

print("=====输入值:x1, x2;真实输出值:y1, y2=====")

print(x1, x2, y1, y2)

print("=====更新前的权值=====")

print(round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

for i in range(1000):

print("=====第" + str(i) + "轮=====")

out_o1, out_o2, out_h1, out_h2 = forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8)

d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8 = back_propagate(out_o1, out_o2, out_h1, out_h2)

w1, w2, w3, w4, w5, w6, w7, w8 = update_w(w1, w2, w3, w4, w5, w6, w7, w8)

print("更新后的权值")

print(round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

问:Numpy和torch代码的对比

答:就目前来看的话代码量是差不多的,但是Pytoch是深度学习的框架,而Numpy是数学计算包,底层代码。按正常情况来说,pytorch代码量是比Numpy少的。

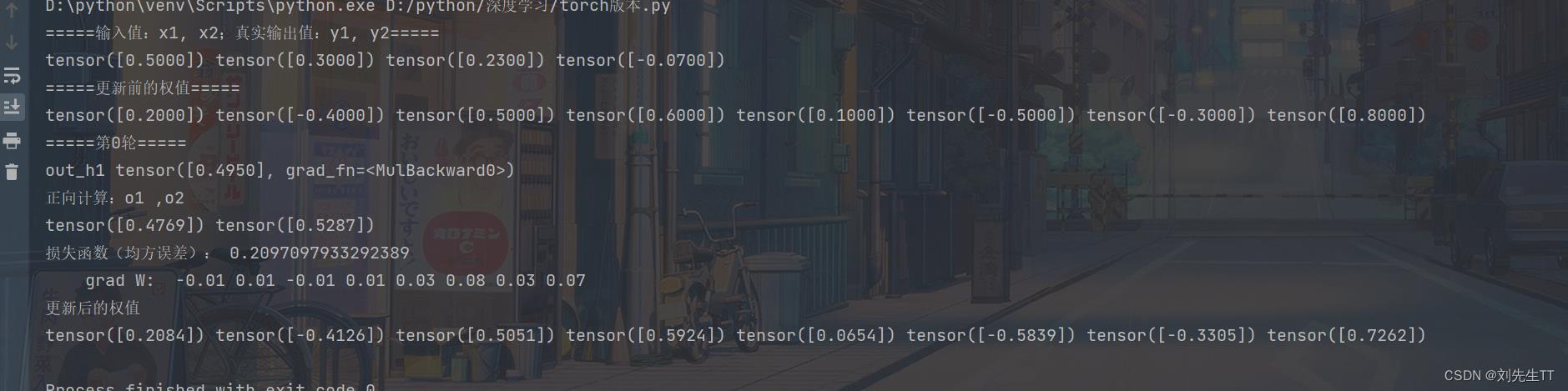

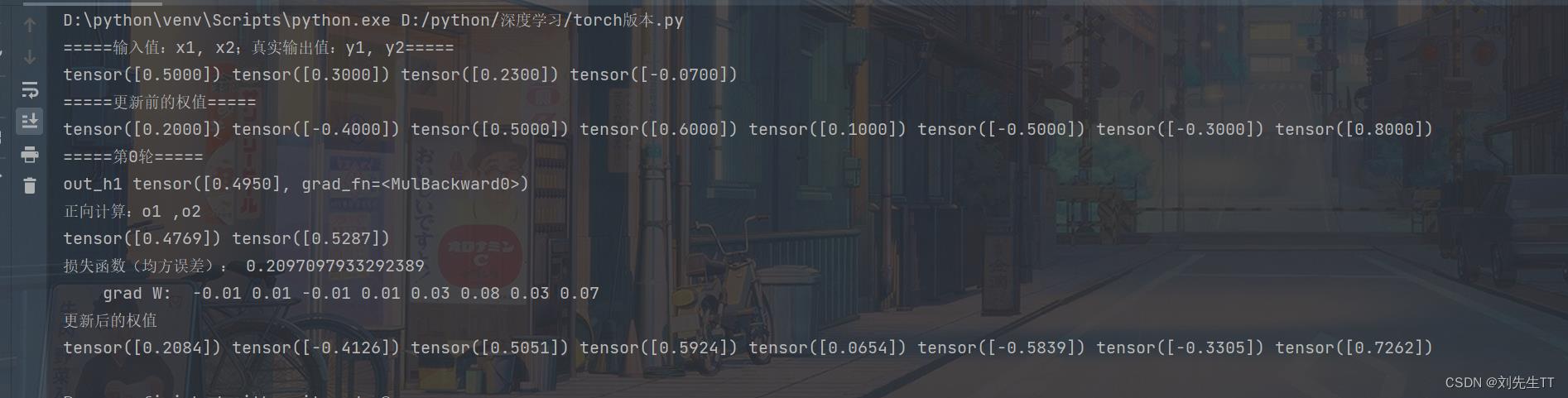

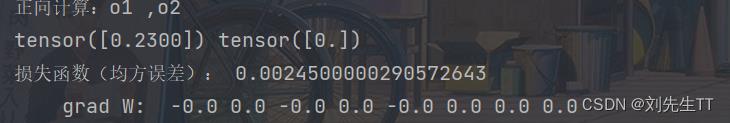

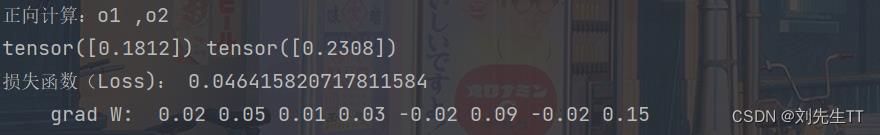

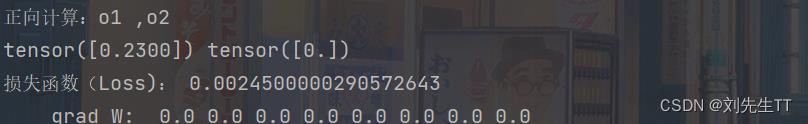

结果:

numpy版本

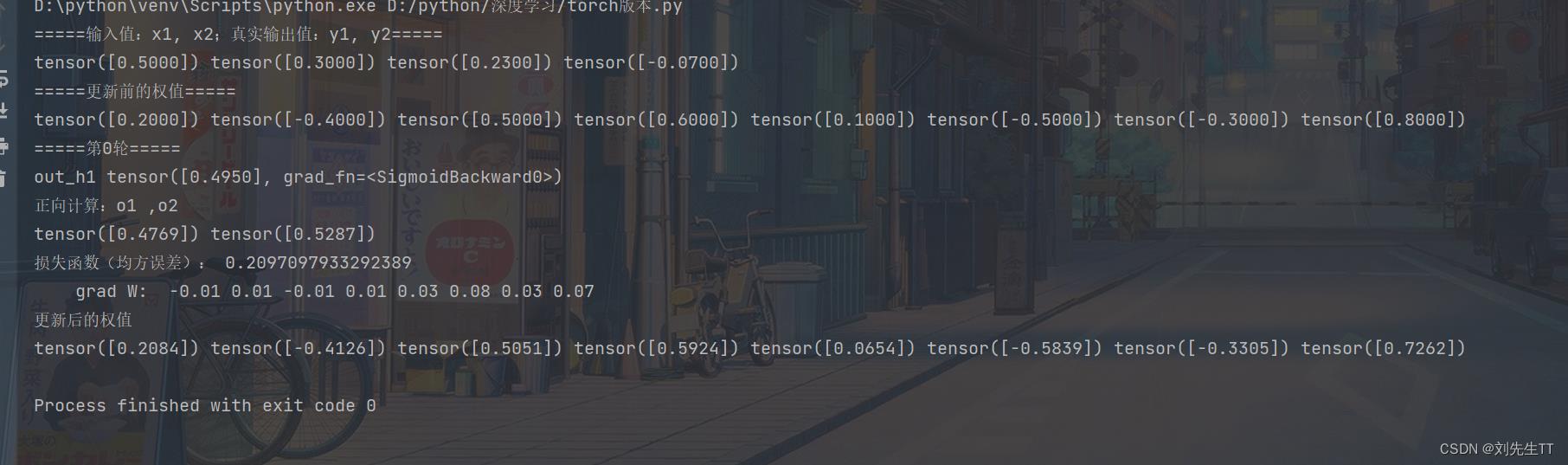

torch版本

激活函数Sigmoid用PyTorch自带函数torch.sigmoid(),观察、总结并陈述。

第一轮

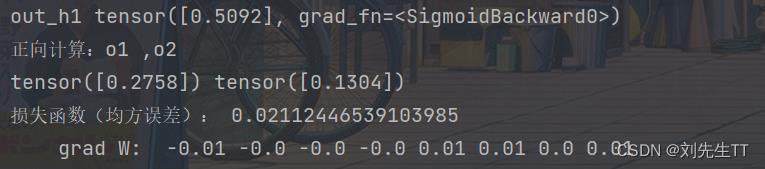

第五十轮

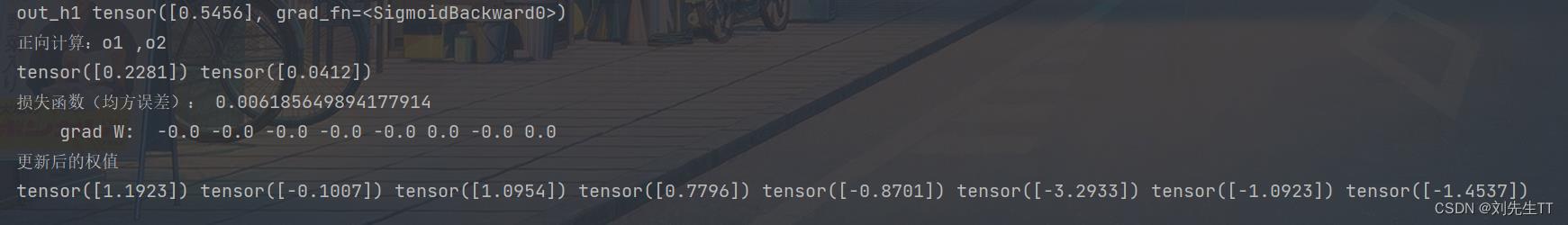

第二百轮

将sigmoid更改为torch.sigmoid函数后,并未出现明显变化,但是通过分析可知,torch是专业机器学习的包,在数据的计算上会有明显的效率提升,

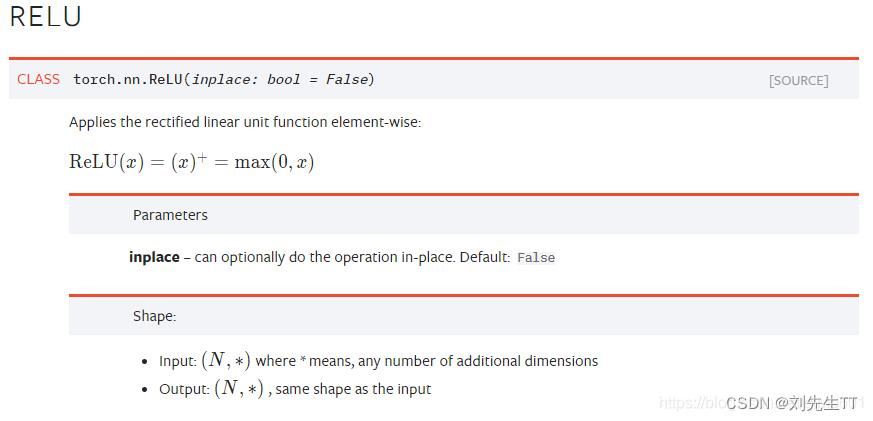

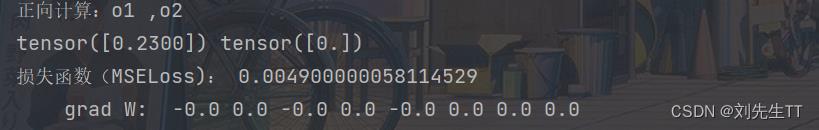

激活函数Sigmoid改变为Relu,观察、总结并陈述。

第一次

第五十次

第二百次

与sigmoid的区别:

1、通过实验结果和损失函数图像,发现激活函数为Sigmoid函数收敛的较快,而relu函数收敛的较慢。

2、sigmoid函数反向传播时,很容易就会出现梯度消失的情况(在sigmoid接近饱和区时,变换太缓慢,导数趋于0,这种情况会造成信息丢失,从而无法完成深层网络的训练;而ReLU就不会

3、Relu会使一部分神经元的输出为0,这样就造成了网络的稀疏性(对于特征选取更好),并且减少了参数的相互依存关系,缓解了过拟合问题的发生

性能上:

采用sigmoid等函数,算激活函数时(指数运算),计算量大,反向传播求误差梯度时,求导涉及除法,计算量相对大,而采用Relu激活函数,整个过程的计算量节省很多

拓展

ReLU函数有个inplace参数,如果设为True,它会把输出直接覆盖到输入中,这样可以节省内存/显存。之所以可以覆盖是因为在计算ReLU的反向传播时,只需根据输出就能够推算出反向传播的梯度。但是只有少数的autograd操作支持inplace操作(如tensor.sigmoid_()),除非你明确地知道自己在做什么,否则一般不要使用inplace操作。

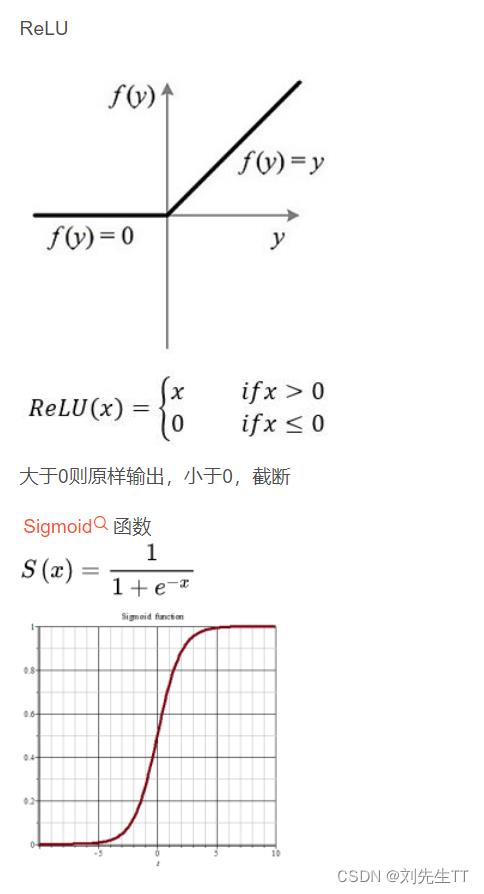

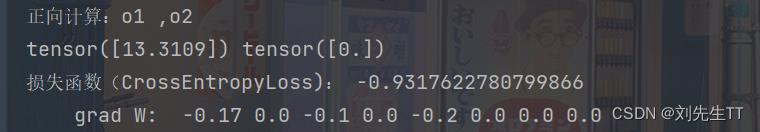

损失函数MSE用PyTorch自带函数 t.nn.MSELoss()替代,观察、总结并陈述。

更改损失函数,代码如下

def loss_fuction(x1, x2, y1, y2): # 损失函数

y1_pred, y2_pred = forward_propagate(x1, x2) # 前向传播

loss = torch.nn.MSELoss() # 考虑 : t.nn.MSELoss()

loss1 = loss(y1_pred,y1)

loss2 = loss(y2_pred,y2)

loss = loss1 + loss2

print("损失函数(MSELoss):", loss.item())

return loss

运行结果

第一轮

第五十轮

第二百轮

损失函数用Torch.NN.MSEloss替代,通过实验结果我们发现MSEloss损失函数在Numpy的实验结果较差。

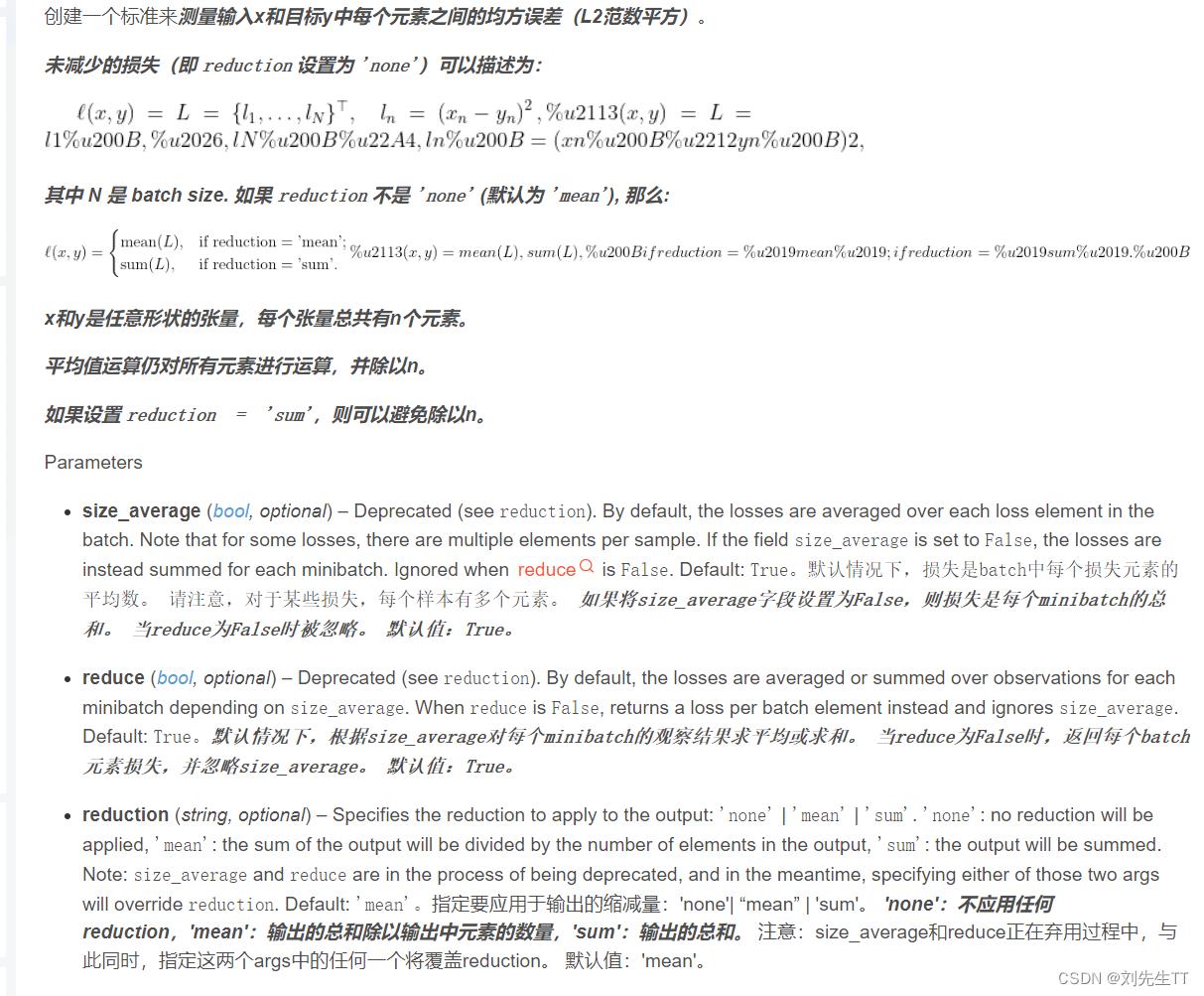

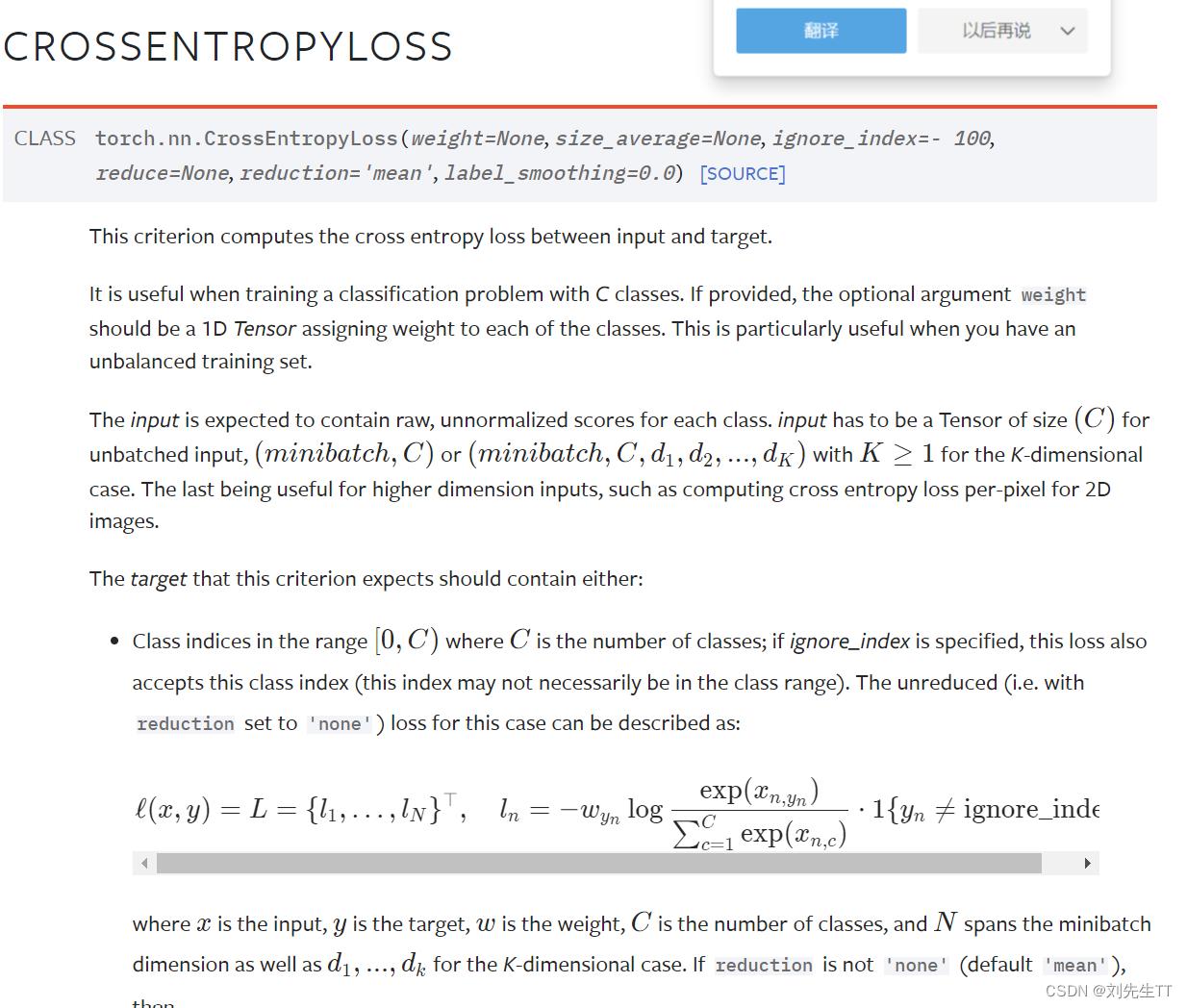

损失函数MSE改变为交叉熵,观察、总结并陈述。

将代码更改如下

def loss_fuction(x1, x2, y1, y2): # 损失函数

y1_pred, y2_pred = forward_propagate(x1, x2) # 前向传播

loss = torch.nn.CrossEntropyLoss() # 考虑 : t.nn.MSELoss()

loss1 = loss(y1_pred,y1)

loss2 = loss(y2_pred,y2)

loss = loss1 + loss2

print("损失函数(MSELoss):", loss.item())

return loss

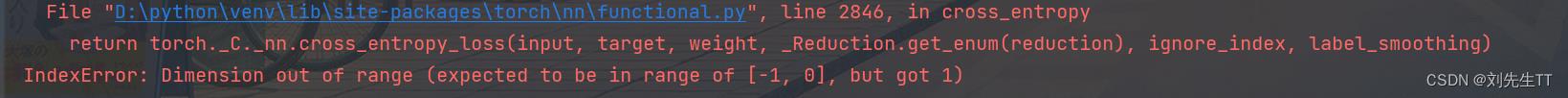

发现报错

原因是输出的维度不一致,我们使用torch.stack将其转换为同一维度的大小。

y_pred = torch.stack([y1_pred, y2_pred], dim=1)

y = torch.stack([y1, y2], dim=1)

输出结果

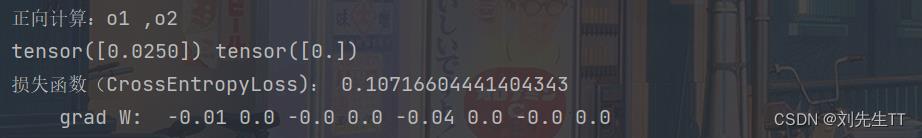

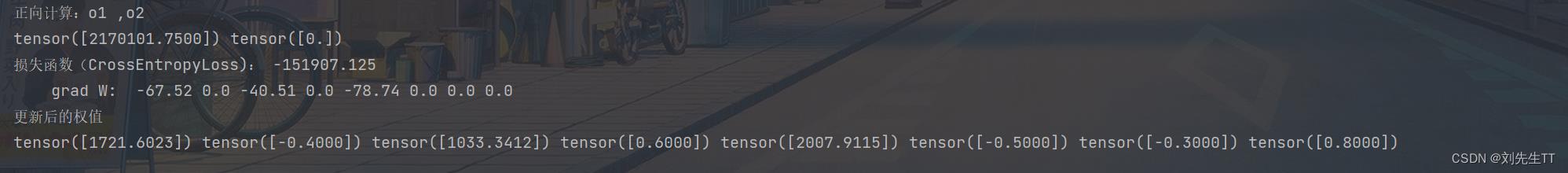

第一轮

第五十轮

第二百轮

交叉熵损失函数与其他损失函数的区别,在200轮的时候出现了负数,这个时候我们只需进行softmax转换为0-1即可。同时通过回顾可知,我们可以发现交叉熵损失函数更实用于分类,而不是预测。

改变步长,训练次数,观察、总结并陈述。

改变步长和训练次数

更改步长为0.5

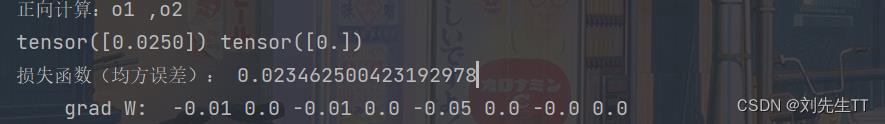

第一轮

第五十轮

第二百轮

更改步长为2

第一轮

第五十轮

第二百轮

通过实验结果,我们发现训练次数50次和200次的时候误差和参数一样,即已经达到了局部或者全局收敛,这个以后就是无效训练,次时我们可以设计一个超参数,当准确率或者误差不变时,停止训练,来提升系统的性能,同时我们发现步长为0.5时候比2的时候效果要好一些,我们可以发现无论是线性模型还是神经网络模型训练的好坏都是由超参数来确定的。合适的训练次数和学习率会提升模型的稳健性。

权值w1-w8初始值换为随机数,对比“指定权值”的结果,观察、总结并陈述。

# -*- coding: utf-8 -*-

# &以上是关于NNDL第三次作业的主要内容,如果未能解决你的问题,请参考以下文章