大数据技术原理与应用实验1——熟悉常用的HDFS操作

Posted 虚神公子

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了大数据技术原理与应用实验1——熟悉常用的HDFS操作相关的知识,希望对你有一定的参考价值。

文章目录

- 一、实验目的

- 二、实验环境

- 三、实验内容

- 四、心得体会:

一、实验目的

(1)理解HDFS在Hadoop体系结构中的角色。

(2)熟练使用HDFS操作常用的Shell命令。

(3)熟悉HDFS操作常用的JavaAPI。

二、实验环境

Windows操作系统

VMware Workstation Pro 15.5

远程终端工具Xshell7

Xftp7传输工具

CentOS7.5

三、实验内容

(一)编程实现以下功能,并利用Hadoop提供的Shell命令完成相同任务:

1. 向HDFS中上传任意文本文件

(1) 向HDFS中上传任意文本文件,如果指定的文件在HDFS中已经存在,则由用户来指定是追加到原有文件末尾还是覆盖原有的文件;

Shell命令:

检查文件是否存在,可以使用如下命令:

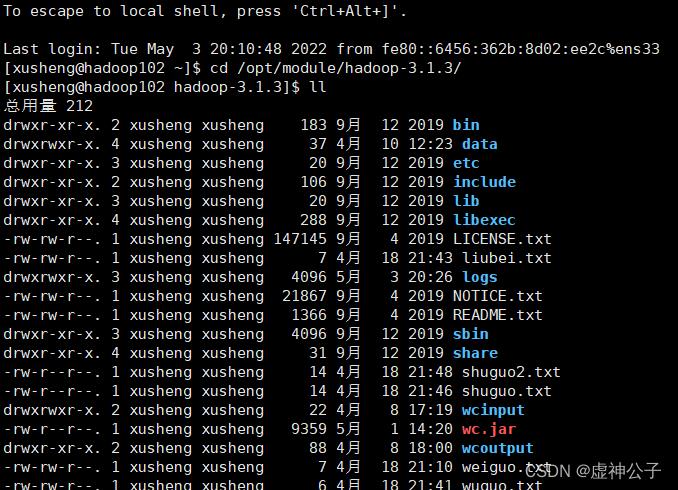

cd /opt/module/hadoop-3.1.3/

$ ./bin/hdfs dfs -test -e weiguo.txt

执行完上述命令不会输出结果,需要继续输入命令查看结果:

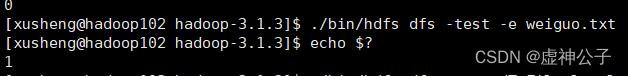

$ echo $?

如果结果显示文件已经存在,则用户可以选择追加到原来文件末尾或者覆盖原来文件,具体命令如下:

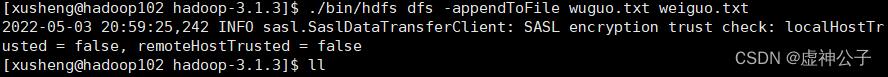

$ ./bin/hdfs dfs -appendToFile wuguo.txt weiguo.txt #追加到原文件末尾

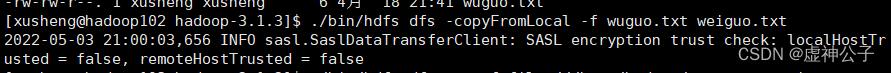

$ ./bin/hdfs dfs -copyFromLocal -f wuguo.txt weiguo.txt#覆盖原来文件,第一种命令形式

代码:

package com.xusheng.hdfs;

//import org.apache.commons.configuration2.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.FileInputStream;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

public class HDFSApi

/**

* 判断路径是否存在

*/

public static boolean test(Configuration conf, String path) throws IOException

FileSystem fs = FileSystem.get(conf);

return fs.exists(new Path(path));

/**

* 复制文件到指定路径

* 若路径已存在,则进行覆盖

*/

public static void copyFromLocalFile(Configuration conf, String localFilePath, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path localPath = new Path(localFilePath);

Path remotePath = new Path(remoteFilePath);

/* fs.copyFromLocalFile 第一个参数表示是否删除源文件,第二个参数表示是否覆盖 */

fs.copyFromLocalFile(false, true, localPath, remotePath);

fs.close();

/**

* 追加文件内容

*/

public static void appendToFile(Configuration conf, String localFilePath, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

/* 创建一个文件读入流 */

FileInputStream in = new FileInputStream(localFilePath);

/* 创建一个文件输出流,输出的内容将追加到文件末尾 */

FSDataOutputStream out = fs.append(remotePath);

/* 读写文件内容 */

byte[] data = new byte[1024];

int read = -1;

while ( (read = in.read(data)) > 0 )

out.write(data, 0, read);

out.close();

in.close();

fs.close();

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name"," hdfs://hadoop102:8020");

//String localFilePath = "/home/hadoop/text.txt"; // 本地路径

//String remoteFilePath = "/user/hadoop/text.txt"; // HDFS路径

String localFilePath = "/user/xusheng/weiguo.txt"; // 本地路径

String remoteFilePath = "/opt/module/hadoop-3.1.3/weiguo.txt"; // HDFS路径

String choice = "append"; // 若文件存在则追加到文件末尾

// String choice = "overwrite"; // 若文件存在则覆盖

try

/* 判断文件是否存在 */

Boolean fileExists = false;

if (HDFSApi.test(conf, remoteFilePath))

fileExists = true;

System.out.println(remoteFilePath + " 已存在.");

else

System.out.println(remoteFilePath + " 不存在.");

/* 进行处理 */

if ( !fileExists) // 文件不存在,则上传

HDFSApi.copyFromLocalFile(conf, localFilePath, remoteFilePath);

System.out.println(localFilePath + " 已上传至 " + remoteFilePath);

else if ( choice.equals("overwrite") ) // 选择覆盖

HDFSApi.copyFromLocalFile(conf, localFilePath, remoteFilePath);

System.out.println(localFilePath + " 已覆盖 " + remoteFilePath);

else if ( choice.equals("append") ) // 选择追加

HDFSApi.appendToFile(conf, localFilePath, remoteFilePath);

System.out.println(localFilePath + " 已追加至 " + remoteFilePath);

catch (Exception e)

e.printStackTrace();

结果:

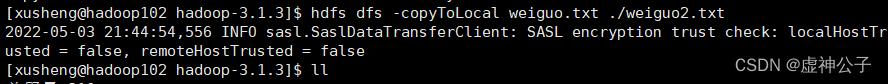

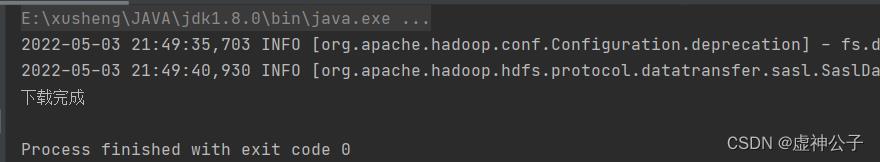

2. 从HDFS中下载指定文件

(2) 从HDFS中下载指定文件,如果本地文件与要下载的文件名称相同,则自动对下载的文件重命名;

Shell命令:

$ if $(hdfs dfs -test -e file:///home/hadoop/weiguo.txt);

$ then $(hdfs dfs -copyToLocal weiguo.txt ./ weiguo2.txt);

$ else $(hdfs dfs -copyToLocal weiguo.txt ./ weiguo.txt);

$ fi

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

public class HDFSApi2

/**

* 下载文件到本地

* 判断本地路径是否已存在,若已存在,则自动进行重命名

*/

public static void copyToLocal(Configuration conf, String remoteFilePath, String localFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

File f = new File(localFilePath);

/* 如果文件名存在,自动重命名(在文件名后面加上 _0, _1 ...) */

if (f.exists())

System.out.println(localFilePath + " 已存在.");

Integer i = 0;

while (true)

f = new File(localFilePath + "_" + i.toString());

if (!f.exists())

localFilePath = localFilePath + "_" + i.toString();

break;

System.out.println("将重新命名为: " + localFilePath);

// 下载文件到本地

Path localPath = new Path(localFilePath);

fs.copyToLocalFile(remotePath, localPath);

fs.close();

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String localFilePath = "/home/hadoop/weiguo.txt"; // 本地路径

String remoteFilePath = "/user/xusheng/weiguo.txt"; // HDFS路径

try

HDFSApi2.copyToLocal(conf, remoteFilePath, localFilePath);

System.out.println("下载完成");

catch (Exception e)

e.printStackTrace();

结果:

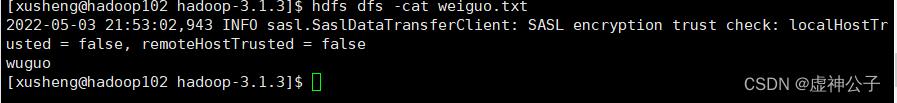

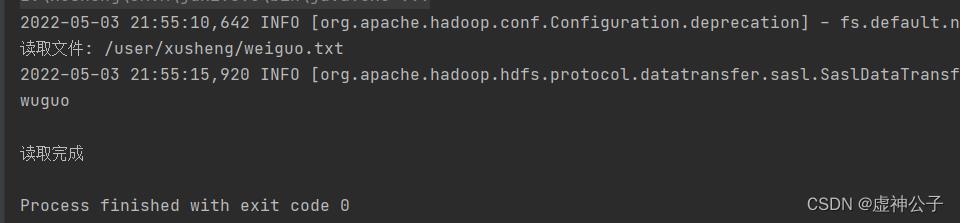

3. 将HDFS中指定文件的内容输出到终端中

(3) 将HDFS中指定文件的内容输出到终端中;

Shell命令:

$ hdfs dfs -cat weiguo.txt

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

public class HDFSApi3

/**

* 读取文件内容

*/

public static void cat(Configuration conf, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

FSDataInputStream in = fs.open(remotePath);

BufferedReader d = new BufferedReader(new InputStreamReader(in));

String line = null;

while ( (line = d.readLine()) != null )

System.out.println(line);

d.close();

in.close();

fs.close();

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String remoteFilePath = "/user/xusheng/weiguo.txt"; // HDFS路径

try

System.out.println("读取文件: " + remoteFilePath);

HDFSApi3.cat(conf, remoteFilePath);

System.out.println("\\n读取完成");

catch (Exception e)

e.printStackTrace();

结果:

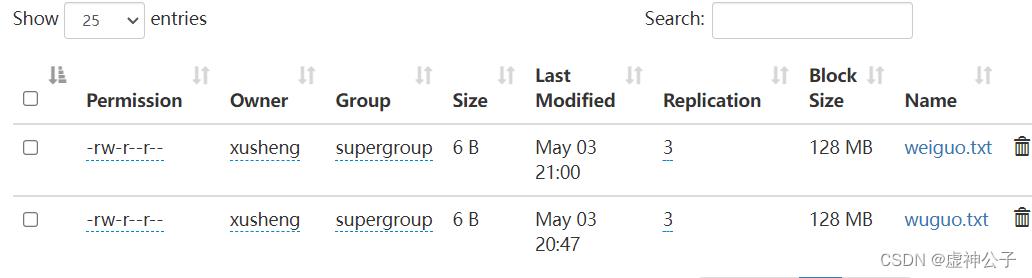

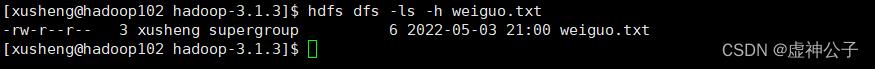

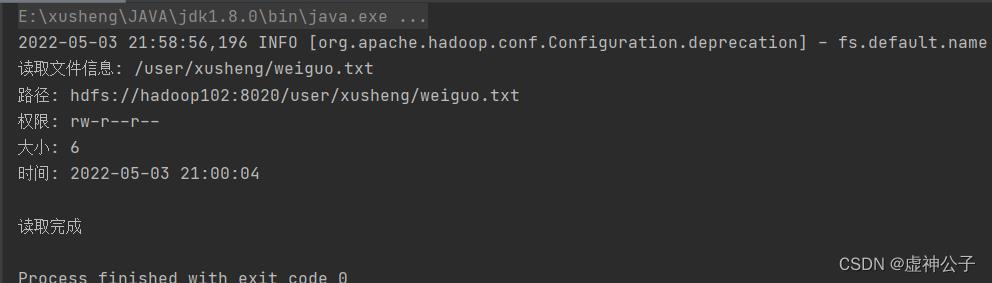

4. 显示HDFS中指定的文件的读写权限、大小、创建时间、路径等信息

(4) 显示HDFS中指定的文件的读写权限、大小、创建时间、路径等信息;

Shell命令:

$ hdfs dfs -ls -h weiguo.txt

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

import java.text.SimpleDateFormat;

public class HDFSApi4

/**

* 显示指定文件的信息

*/

public static void ls(Configuration conf, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

FileStatus[] fileStatuses = fs.listStatus(remotePath);

for (FileStatus s : fileStatuses)

System.out.println("路径: " + s.getPath().toString());

System.out.println("权限: " + s.getPermission().toString());

System.out.println("大小: " + s.getLen());

/* 返回的是时间戳,转化为时间日期格式 */

Long timeStamp = s.getModificationTime();

SimpleDateFormat format = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");

String date = format.format(timeStamp);

System.out.println("时间: " + date);

fs.close();

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String remoteFilePath = "/user/xusheng/weiguo.txt"; // HDFS路径

try

System.out.println("读取文件信息: " + remoteFilePath);

HDFSApi4.ls(conf, remoteFilePath);

System.out.println("\\n读取完成");

catch (Exception e)

e.printStackTrace();

结果:

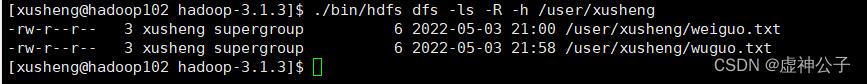

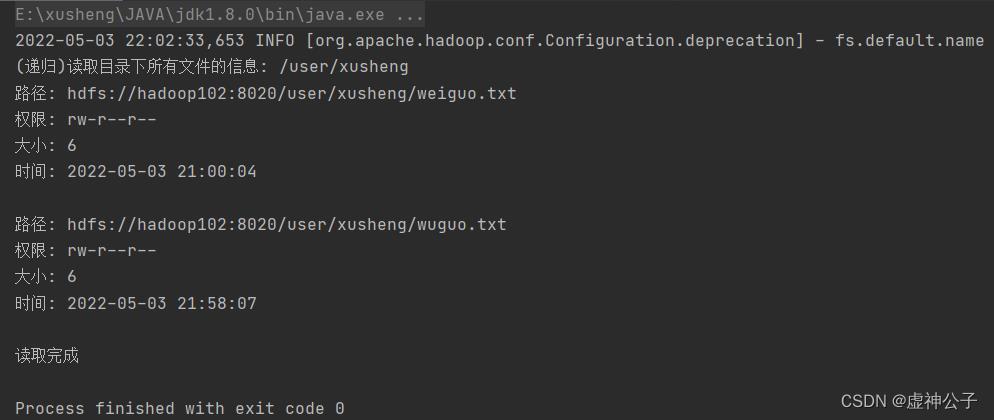

5. 给定HDFS中某一个目录,输出该目录下的所有文件的读写权限、大小、创建时间等信息

(5) 给定HDFS中某一个目录,输出该目录下的所有文件的读写权限、大小、创建时间、路径等信息,如果该文件是目录,则递归输出该目录下所有文件相关信息;

Shell命令:

$ ./bin/hdfs dfs -ls -R -h /user/xusheng

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

import java.text.SimpleDateFormat;

public class HDFSApi5

/**

* 显示指定文件夹下所有文件的信息(递归)

*/

public static void lsDir(Configuration conf, String remoteDir) throws IOException

FileSystem fs = FileSystem.get(conf);

Path dirPath = new Path(remoteDir);

/* 递归获取目录下的所有文件 */

RemoteIterator<LocatedFileStatus> remoteIterator = fs.listFiles(dirPath, true);

/* 输出每个文件的信息 */

while (remoteIterator.hasNext())

FileStatus s = remoteIterator.next();

System.out.println("路径: " + s.getPath().toString());

System.out.println("权限: " + s.getPermission().toString());

System.out.println("大小: " + s.getLen());

/* 返回的是时间戳,转化为时间日期格式 */

Long timeStamp = s.getModificationTime();

SimpleDateFormat format = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");

String date = format.format(timeStamp);

System.out.println("时间: " + date);

System.out.println();

fs.close();

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String remoteDir = "/user/xusheng"; // HDFS路径

try

System.out.println("(递归)读取目录下所有文件的信息: " + remoteDir);

HDFSApi5.lsDir(conf, remoteDir);

System.out.println("读取完成");

catch (Exception e)

e.printStackTrace();

结果:

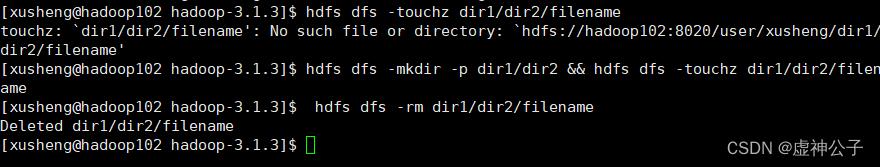

6.提供一个HDFS内的文件的路径,对该文件进行创建和删除操作

(6) 提供一个HDFS内的文件的路径,对该文件进行创建和删除操作。如果文件所在目录不存在,则自动创建目录;

Shell命令:

$ hdfs dfs -test -d dir1/dir2

$ hdfs dfs -touchz dir1/dir2/filename

$ hdfs dfs -mkdir -p dir1/dir2 && hdfs dfs -touchz dir1/dir2/filename

$ hdfs dfs -rm dir1/dir2/filename#删除文件

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

public class HDFSApi6

/**

* 判断路径是否存在

*/

public static boolean test(Configuration conf, String path) throws IOException

FileSystem fs = FileSystem.get(conf);

return fs.exists(new Path(path));

/**

* 创建目录

*/

public static boolean mkdir(Configuration conf, String remoteDir) throws IOException

FileSystem fs = FileSystem.get(conf);

Path dirPath = new Path(remoteDir);

boolean result = fs.mkdirs(dirPath);

fs.close();

return result;

/**

* 创建文件

*/

public static void touchz(Configuration conf, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

FSDataOutputStream outputStream = fs.create(remotePath);

outputStream.close();

fs.close();

/**

* 删除文件

*/

public static boolean rm(Configuration conf, String remoteFilePath) throws IOException

FileSystem fs = FileSystem.get(conf);

Path remotePath = new Path(remoteFilePath);

boolean result = fs.delete(remotePath, false);

fs.close();

return result;

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String remoteFilePath = "/user/xusheng/input/text.txt"; // HDFS路径

String remoteDir = "/user/xusheng/input"; // HDFS路径对应的目录

try

/* 判断路径是否存在,存在则删除,否则进行创建 */

if ( HDFSApi6.test(conf, remoteFilePath) )

HDFSApi6.rm(conf, remoteFilePath); // 删除

System.out.println("删除路径: " + remoteFilePath);

else

if ( !HDFSApi6.test(conf, remoteDir) ) // 若目录不存在,则进行创建

HDFSApi6.mkdir(conf, remoteDir);

System.out.println("创建文件夹: " + remoteDir);

HDFSApi6.touchz(conf, remoteFilePath);

System.out.println("创建路径: " + remoteFilePath);

catch (Exception e)

e.printStackTrace();

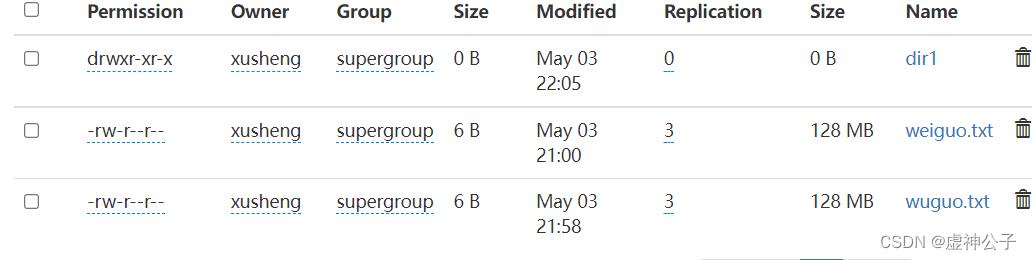

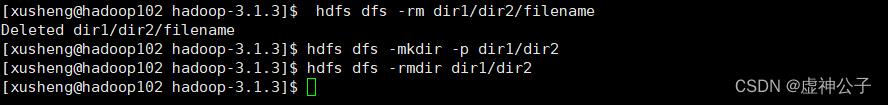

7.供一个HDFS的目录的路径,对该目录进行创建和删除操作

(7) 提供一个HDFS的目录的路径,对该目录进行创建和删除操作。创建目录时,如果目录文件所在目录不存在,则自动创建相应目录;删除目录时,由用户指定当该目录不为空时是否还删除该目录;

Shell命令:

创建目录的命令如下:$ hdfs dfs -mkdir -p dir1/dir2

删除目录的命令如下:$ hdfs dfs -rmdir dir1/dir2

上述命令执行以后,如果目录非空,则会提示not empty,删除操作不会执行。如果要强制删除目录,可以使用如下命令:

$ hdfs dfs -rm -R dir1/dir2

代码:

package com.xusheng.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import java.io.*;

public class HDFSApi7

/**

* 判断路径是否存在

*/

public static boolean test(Configuration conf, String path) throws IOException

FileSystem fs = FileSystem.get(conf);

return fs.exists(new Path(path));

/**

* 判断目录是否为空

* true: 空,false: 非空

*/

public static boolean isDirEmpty(Configuration conf, String remoteDir) throws IOException

FileSystem fs = FileSystem.get(conf);

Path dirPath = new Path(remoteDir);

RemoteIterator<LocatedFileStatus> remoteIterator = fs.listFiles(dirPath, true);

return !remoteIterator.hasNext();

/**

* 创建目录

*/

public static boolean mkdir(Configuration conf, String remoteDir) throws IOException

FileSystem fs = FileSystem.get(conf);

Path dirPath = new Path(remoteDir);

boolean result = fs.mkdirs(dirPath);

fs.close();

return result;

/**

* 删除目录

*/

public static boolean rmDir(Configuration conf, String remoteDir) throws IOException

FileSystem fs = FileSystem.get(conf);

Path dirPath = new Path(remoteDir);

/* 第二个参数表示是否递归删除所有文件 */

boolean result = fs.delete(dirPath, true);

fs.close();

return result;

/**

* 主函数

*/

public static void main(String[] args)

Configuration conf = new Configuration();

conf.set("fs.default.name","hdfs://hadoop102:8020");

String remoteDir = "/user/xusheng/dir1/dir2"; // HDFS目录

Boolean forceDelete = false; // 是否强制删除

try

/* 判断目录是否存在,不存在则创建,存在则删除 */

if ( !HDFSApi7.test(conf, remoteDir) )

HDFSApi7.mkdir(conf, remoteDir); // 创建目录

System.out.println("创建目录: " + remoteDir);

else

if ( HDFSApi7.isDirEmpty(conf, remoteDir) || forceDelete ) // 目录为空或强制删除

HDFSApi7.rmDir(conf, remoteDir);

System.out.println("删除目录: " + remoteDir);

else // 目录不为空

System.out.println("目录不为空,不删除: " + remoteDir);

catch (Exception e)

e.printStackTrace();

8. 向HDFS中指定的文件追加内容,由用户指定内容追加到原有文件的开头或结尾

(8) 向HDFS中指定的文件追加内容,由用户指定内容追加到原有文件的开头或结尾;

Shell命令:

$ hdfs dfs -appendToFile wuguo.txt weiguo.txt

追加到原文件的开头,在HDFS中不存在与这种操作对应的命令,因此,无法使用一条命令来完成。可以先移动到本地进行操作,再进行上传覆盖,具体命令如下:

$ hdfs dfs -get weiguo.txt

$ 以上是关于大数据技术原理与应用实验1——熟悉常用的HDFS操作的主要内容,如果未能解决你的问题,请参考以下文章