大数据技术——Hadoop3.X入门搭建+安装调优(1.入门)

Posted 虚神公子

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了大数据技术——Hadoop3.X入门搭建+安装调优(1.入门)相关的知识,希望对你有一定的参考价值。

文章目录

一、大数据概论

1.1.大数据概念

大数据(Big Data):指无法在一定时间范围内用常规软件工具进行捕捉、管理和处理的数据集合,是需要新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。

按顺序给出数据存储单位:

bit、Byte、KB、MB、GB、TB、PB、EB、ZB、YB、BB、NB、DB。

1Byte = 8bit 1K = 1024Byte 1MB = 1024K

1G = 1024M 1T = 1024G 1P= 1024T

大数据主要解决,海量数据的采集、存储和分析计算问题。

1.2.大数据特点(4V)

(1)Volume(大量)

截至目前,人类生产的所有印刷材料的数据量是200PB,而历史上全人类总共说过的话的数据量大约是5EB。当前,典型个人计算机硬盘的容量为TB量级,而一些大企业的数据量已经接近EB量级。

(2)Velocity(高速)

这是大数据区分于传统数据挖掘的最显著特征。根据IDC的“数字宇宙”的报

告,预计到2025年,全球数据使用量将达到163ZB。在如此海量的数据面前,处理数据的效率就是企业的生命。

(3)Variety(多样)

这种类型的多样性也让数据被分为结构化数据和非结构化数据。相对于以往便于存储的以数据库/文本为主的结构化数据,非结构化数据越来越多,包括网络日志、音频、视频、图 片、地理位置信息等,这些多类型的数据对数据的处理能力提出了更高要求。

(4)Value(低价值密度)

价值密度的高低与数据总量的大小成反比。如何快速对有价值数据“提纯”成为目前大数据背景下待解决的难题。

1.3.大数据应用场景

(1)抖音:推荐的都是你喜欢的视频

(2)电商站内广告推荐:给用户推荐可能喜欢的商品

(3)零售:分析用户消费习惯,为用户购买商品提供方便,从而提升商品销量。经典案例,纸尿布+啤酒。

(4)物流仓储:京东物流,上午下单下午送达、下午下单次日上午送达

(5)保险:海量数据挖掘及风险预测,助力保险行业精准营销,提升精细化定价能力。

(6)金融:多维度体现用户特征,帮助金融机构推荐优质客户,防范欺诈风险。

(7)房产:大数据全面助力房地产行业,打造精准投策与营销,选出更合适的地,建造更合适的楼,卖给更合适的人。

(8)人工智能 + 5G + 物联网 + 虚拟与现实

1.4.大数据发展前景

(1)党的十九大提出“推动互联网、大数据、人工智能和实体经济深度融合”。

(2)2020年初,中央推出34万亿“新基建”投资计划

(3)下一个风口

2020年是5G的元年,国家在大力铺设5G设备,2021年就是5G手机应用的开始,也是大数据要爆发的1年。5G带来的是每秒钟10g的数据,会给每家公司都带来海量的数据。那么传统的Java工具根本解决不了海量数据的存储。就更不用说海量数据的计算了。如果你对5G的感触不够深,可以回忆一下3G和4G的区别。3G时只能打电话、发短信,当时还觉得很好,觉得3G不错。但是4G来了后,大家很少打电话和发短信了,都改为语音、视频、直播、网上购物等生活方式,带火了淘宝、京东、美团、字节跳动等企业。没有跟上节奏的百度,有点摇摇欲坠。

自古不变的真理:先入行者吃肉,后入行者喝汤,最后到的买单!

(4)人才紧缺、竞争压力小

1.5.大数据部门间业务流程分析

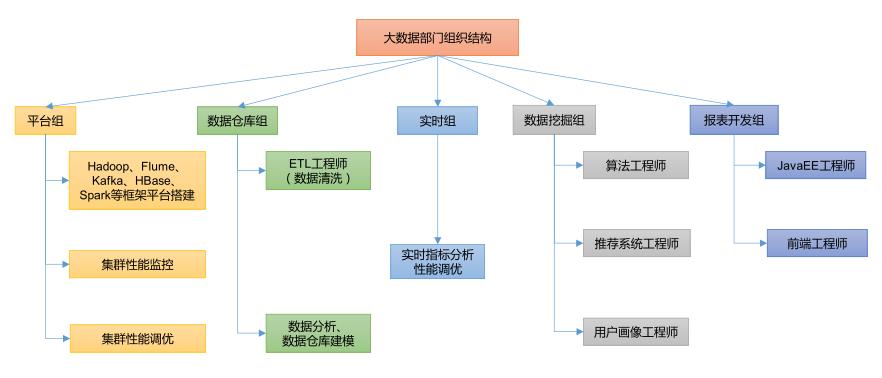

1.6.大数据部门内组织结构

二、Hadoop概述

2.1. Hadoop 是什么

1) Hadoop是一个由Apache基金会所开发的分布式系统基础架构。

2)主要解决,海量数据的存储和海量数据的分析计算问题。

3)广义上来说,Hadoop通常是指一个更广泛的概念——Hadoop生态圈。

2.2. Hadoop发展历史(了解)

1)Hadoop创始人Doug Cutting,为了实现与Google类似的全文搜索功能,他在Lucene框架基础上进行优化升级,查询引擎和索引引擎。

2)2001年年底Lucene成为Apache基金会的一个子项目。

3)对于海量数据的场景,Lucene框架面对与Google同样的困难,存储海量数据困难,检索海量速度慢。

4)学习和模仿Google解决这些问题的办法 :微型版Nutch。

5)可以说Google是Hadoop的思想之源(Google在大数据方面的三篇论文)

GFS —>HDFS

Map-Reduce —>MR

BigTable —>HBase

6)2003-2004年,Google公开了部分GFS和MapReduce思想的细节,以此为基础Doug Cutting等人用

了2年业余时间实现了DFS和MapReduce机制,使Nutch性能飙升。

7)2005 年Hadoop 作为 Lucene的子项目 Nutch的一部分正式引入Apache基金会。

8)2006 年 3 月份,Map-Reduce和Nutch Distributed File System (NDFS)分别被纳入到 Hadoop 项目中,Hadoop就此正式诞生,标志着大数据时代来临。

9)名字来源于Doug Cutting儿子的玩具大象

2.3. Hadoop三大发行版本(了解)

Hadoop 三大发行版本:Apache、Cloudera、Hortonworks。

Apache 版本最原始(最基础)的版本,对于入门学习最好。2006

Cloudera 内部集成了很多大数据框架,对应产品 CDH。2008

Hortonworks 文档较好,对应产品 HDP。2011

Hortonworks 现在已经被 Cloudera 公司收购,推出新的品牌 CDP。

1 )Apache Hadoop

官网地址:http://hadoop.apache.org

下载地址:https://hadoop.apache.org/releases.html

2 )Cloudera Hadoop

官网地址:https://www.cloudera.com/downloads/cdh

下载地址:https://docs.cloudera.com/documentation/enterprise/6/release-

notes/topics/rg_cdh_6_download.html

(1)2008 年成立的 Cloudera 是最早将 Hadoop 商用的公司,为合作伙伴提供 Hadoop 的商用解决方案,主要是包括支持、咨询服务、培训。

(2 )2009 年 年 Hadoop 的创始人 Doug Cutting 也加盟Cloudera 公司。Cloudera 产品主要为 CDH,Cloudera Manager,Cloudera Support

(3)CDH 是 Cloudera 的 Hadoop 发行版,完全开源,比 Apache Hadoop

在兼容性,安全性,稳定性上有所增强。Cloudera 的标价为每年每个节点 10000 美元。

(4)Cloudera Manager是集群的软件分发及管理监控平台,可以在几个小时内部署好一个 Hadoop 集群,并对集群的节点及服务进行实时监控。

3) Hortonworks Hadoop

官网地址:https://hortonworks.com/products/data-center/hdp/

下载地址:https://hortonworks.com/downloads/#data-platform

(1)2011 年成立的 Hortonworks 是雅虎与硅谷风投公司 Benchmark Capital 合资组建。

(2)公司成立之初就吸纳了大约 25 名至 30 名专究 门研究 Hadoop 的雅虎工程师,上述 工程师均在 2005 年开始协助雅虎开发 Hadoop ,贡献了 Hadoop80% 的代码。

(3)Hortonworks 的主打产品是 Hortonworks Data Platform(HDP),也同样是 100%开 源的产品,HDP 除常见的项目外还包括了 Ambari,一款开源的安装和管理系统。

(4)2018 年 Hortonworks 目前 已经被 Cloudera 公司收购。

2.4. Hadoop优势(4高)

1)高可靠性:Hadoop底层维护多个数据副本,所以即使Hadoop某个计算元素或存储出现故障,也不会导致数据的丢失。

2)高扩展性:在集群间分配任务数据,可方便的扩展数以千计的节点。

3)高效性:在MapReduce的思想下,Hadoop是并行工作的,以加快任务处

理速度。

4)高容错性:能够自动将失败的任务重新分配。

2.5. Hadoop组成(面试重点)

在 Hadoop1.x 时 代 ,Hadoop中的MapReduce同时处理业务逻辑运算和资源的调度,耦合性较大。在Hadoop2.x时代,增加了Yarn。Yarn只负责资 源 的 调 度 ,MapReduce只负责运算。Hadoop3.x在组成上没有变化。

2.5.1 HDFS架构概述

Hadoop Distributed File System,简称 HDFS,是一个分布式文件系统。

1)NameNode(nn):存储文件的元数据,如文件名,文件目录结构,文件属性(生成时间、副本数、文件权限),以及每个文件的块列表和块所在的DataNode等。

2)DataNode(dn):在本地文件系统存储文件块数据,以及块数据的校验和。 3)Secondary

NameNode(2nn):每隔一段时间对NameNode元数据备份。

2.5.2 YARN架构概述

Yet Another Resource Negotiator 简称 YARN ,另一种资源协调者,是 Hadoop 的资源管理器。

1)ResourceManager(RM):整个集群资源(内存、CPU等)的老大

3)ApplicationMaster(AM):单个任务运行的老大 2)NodeManager(NM):单个节点服务器资源老大

4)Container:容器,相当一台独立的服务器,里面封装了任务运行所需要的资源,如内存、CPU、磁盘、网络等。

说明1:客户端可以有多个

说明2:集群上可以运行多个ApplicationMaster

说明3:每个NodeManager上可以有多个Container

2.5.3. MapReduce架构概述

MapReduce 将计算过程分为两个阶段:Map 和 Reduce

1)Map 阶段并行处理输入数据

2)Reduce 阶段对 Map 结果进行汇总

2.5.4. HDFS、YARN、MapReduce三者关系

2.6. 大数据技术生态体系

图中涉及的技术名词解释如下:

1)Sqoop:Sqoop 是一款开源的工具,主要用于在 Hadoop、Hive

与传统的数据库(mysql)间进行数据的传递,可以将一个关系型数据库(例如 :MySQL,Oracle 等)中的数据导进到 Hadoop 的

HDFS 中,也可以将 HDFS 的数据导进到关系型数据库中。 2)Flume:Flume

是一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的系统,Flume 支持在日志系统中定制各类数据发送方,用于收集数据;

3)Kafka:Kafka 是一种高吞吐量的分布式发布订阅消息系统; 4)Spark:Spark

是当前最流行的开源大数据内存计算框架。可以基Hadoop 上存储的大数据进行计算。 5)Flink:Flink

是当前最流行的开源大数据内存计算框架。用于实时计算的场景较多。 6)Oozie:Oozie 是一个管理 Hadoop

作业(job)的工作流程调度管理系统。 7)Hbase:HBase 是一个分布式的、面向列的开源数据库。HBase

不同于一般的关系数据库,它是一个适合于非结构化数据存储的数据库。 8)Hive:Hive 是基于 Hadoop

的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的 SQL 查询功能,可以将 SQL 语句转换为 MapReduce

任务进行运行。其优点是学习成本低,可以通过类 SQL 语句快速实现简单的 MapReduce 统计,不必开发专门的 MapReduce

应用,十分适合数据仓库的统计分析。

9)ZooKeeper:它是一个针对大型分布式系统的可靠协调系统,提供的功能包括:配置维护、名字服务、分布式同步、组服务等。

2.7. 推荐系统框架图

三、Hadoop 运行环境搭建 (开发 重点)

3.1 模板虚拟机环境准备

0)安装模板虚拟机

IP地址192.168.10.100、主机名称hadoop100、内存4G、硬盘50G

参考链接: 大数据技术——模板虚拟机环境准备.

1)hadoop100虚拟机配置要求如下(本文Linux系统全部以CentOS-7.5-x86-1804为例)

(1)使用yum安装需要虚拟机可以正常上网,yum安装前可以先测试下虚拟机联网情况

(2)安装 epel-release

注:Extra Packages for Enterprise Linux 是为“红帽系”的操作系统提供额外的软件包,适用于RHEL、CentOS 和 Scientific Linux。相当于是一个软件仓库,大多数 rpm 包在官方repository中是找不到的)

[root@hadoop100 ~]# yum install -y epel-release

(3)注意:如果 Linux 安装的是最小系统版,还需要安装如下工具;如果安装的是 Linux桌面标准版,不需要执行如下操作

net-tool:工具包集合,包含 ifconfig 等命令

[root@hadoop100 ~]# yum install -y net-tools

vim:编辑器

[root@hadoop100 ~]# yum install -y vim

2 ) 关闭防火墙

[root@hadoop100 ~]# systemctl stop firewalld

[root@hadoop100 ~]# systemctl disable firewalld.service

注意:在企业开发时,通常单个服务器的防火墙时关闭的。公司整体对外会设置非常安全的防火墙

3 ) 创建 xusheng用户 ,并修改 xusheng用户的密码

[root@hadoop100 ~]# useradd xusheng

[root@hadoop100 ~]# passwd xusheng

自己设置名称和密码

4 ) 配置 xusheng用户具有 root 权限 , 方便 后期加 加 sudo 执行 root 权限的命令

[root@hadoop100 ~]# vim /etc/sudoers

修改/etc/sudoers 文件,在%wheel 这行下面添加一行,如下所示:

## Allow root to run any commands anywhere

root ALL=(ALL) ALL

## Allows people in group wheel to run all commands

%wheel ALL=(ALL) ALL

xushengALL=(ALL) NOPASSWD:ALL

注意:xusheng这一行不要直接放到 root 行下面,因为所有用户都属于 wheel 组,你先配置了 xusheng具有免密功能,但是程序执行到%wheel 行时,该功能又被覆盖回需要密码。所以 xusheng要放到%wheel 这行下面。

5 ) 在/opt 目录下创建文件夹 ,并修改所属主和所属组

(1)在/opt 目录下创建 module、software 文件夹

[root@hadoop100 ~]# mkdir /opt/module

[root@hadoop100 ~]# mkdir /opt/software

(2)修改 module、software 文件夹的所有者和所属组均为 xusheng用户

[root@hadoop100 ~]# chown xusheng:xusheng /opt/module

[root@hadoop100 ~]# chown xusheng:xusheng /opt/software

(3)查看 module、software 文件夹的所有者和所属组

[xusheng@hadoop100 opt]$ ll

总用量 0

drwxr-xr-x. 2 xusheng xusheng 6 4月 7 20:36 module

drwxr-xr-x. 2 xusheng xusheng 6 4月 7 20:36 software

6)卸载虚拟机自带的 JDK

注意:如果你的虚拟机是最小化安装不需要执行这一步。

[root@hadoop100 ~]# rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

➢ rpm -qa:查询所安装的所有 rpm 软件包

➢ grep -i:忽略大小写

➢ xargs -n1:表示每次只传递一个参数

➢ rpm -e –nodeps:强制卸载软件

查询

卸载

7 )重启虚拟机

[root@hadoop100 ~]# reboot

3.2 克隆虚拟机

1 ) 利用模板机 hadoop100 ,克隆 三台虚拟机: :hadoop102 hadoop103 hadoop104

注意:克隆时,要先关闭 hadoop100

hadoop100右键–》管理–》克隆

2 )修改 克隆机 IP ,以下以 hadoop102 举例说明

(1)修改克隆虚拟机的静态 IP

[root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg- ens33

[root@hadoop100 ~]# vim /etc/hostname

[root@hadoop100 ~]# vim /etc/hosts

改成

DEVICE=ens33

TYPE=Ethernet

ONBOOT=yes

BOOTPROTO=static

NAME="ens33"

IPADDR=192.168.10.102

PREFIX=24

GATEWAY=192.168.10.2

DNS1=192.168.10.2

(2)查看 Linux 虚拟机的虚拟网络编辑器,编辑->虚拟网络编辑器->VMnet8

3.3 在hadoop102安装JDK

1)卸载现有JDK

注意:安装JDK前,一定确保提前删除了虚拟机自带的JDK。详细步骤见问文档3.1(6)节中卸载JDK步骤。

2)用XShell传输工具将JDK导入到opt目录下面的software文件夹下面

3)在Linux系统下的opt目录中查看软件包是否导入成功

[xusheng@hadoop102 ~]$ ls /opt/software/

看到如下结果:

jdk-8u212-linux-x64.tar.gz

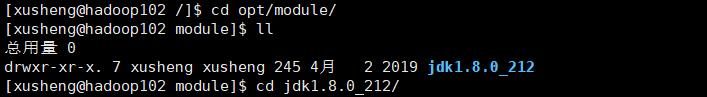

4)解压JDK到/opt/module目录下

[xusheng@hadoop102 software]$ tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/

5)配置JDK环境变量

(1)新建/etc/profile.d/my_env.sh文件

[xusheng@hadoop102 ~]$ sudo vim /etc/profile.d/my_env.sh

添加如下内容

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_212

export PATH=$PATH:$JAVA_HOME/bin

(2)保存后退出

:wq

(3)source一下/etc/profile文件,让新的环境变量PATH生效

[xusheng@hadoop102 ~]$ source /etc/profile

6)测试JDK是否安装成功

[xusheng@hadoop102 ~]$ java -version

如果能看到以下结果,则代表Java安装成功。

java version “1.8.0_212”

注意:重启(如果java -version可以用就不用重启)

[xusheng@hadoop102 ~]$ sudo reboot

3.4 在hadoop102安装Hadoop

Hadoop下载地址:https://archive.apache.org/dist/hadoop/common/hadoop-3.1.3/

1)用XShell文件传输工具将hadoop-3.1.3.tar.gz导入到opt目录下面的software文件夹下面

2)进入到Hadoop安装包路径下

[xusheng@hadoop102 ~]$ cd /opt/software/

3)解压安装文件到/opt/module下面

[xusheng@hadoop102 software]$ tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/

4)查看是否解压成功

[xusheng@hadoop102 software]$ ls /opt/module/ hadoop-3.1.3

5)将Hadoop添加到环境变量

(1)获取Hadoop安装路径

[xusheng@hadoop102 hadoop-3.1.3]$ pwd

/opt/module/hadoop-3.1.3

(2)打开/etc/profile.d/my_env.sh文件

[xusheng@hadoop102 hadoop-3.1.3]$ sudo vim /etc/profile.d/my_env.sh

在my_env.sh文件末尾添加如下内容:(shift+g)

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

保存并退出: :wq

(3)让修改后的文件生效

[xusheng@hadoop102 hadoop-3.1.3]$ source /etc/profile

6)测试是否安装成功

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop version

Hadoop 3.1.3

7)重启(如果Hadoop命令不能用再重启虚拟机)

[xusheng@hadoop102 hadoop-3.1.3]$ sudo reboot

3.5 Hadoop目录结构

1)查看Hadoop目录结构

[xusheng@hadoop102 hadoop-3.1.3]$ ll

总用量 176

drwxr-xr-x. 2 xusheng xusheng 183 9月 12 2019 bin

drwxr-xr-x. 3 xusheng xusheng 20 9月 12 2019 etc

drwxr-xr-x. 2 xusheng xusheng 106 9月 12 2019 include

drwxr-xr-x. 3 xusheng xusheng 20 9月 12 2019 lib

drwxr-xr-x. 4 xusheng xusheng 288 9月 12 2019 libexec

-rw-rw-r--. 1 xusheng xusheng 147145 9月 4 2019 LICENSE.txt

-rw-rw-r--. 1 xusheng xusheng 21867 9月 4 2019 NOTICE.txt

-rw-rw-r--. 1 xusheng xusheng 1366 9月 4 2019 README.txt

drwxr-xr-x. 3 xusheng xusheng 4096 9月 12 2019 sbin

drwxr-xr-x. 4 xusheng xusheng 31 9月 12 2019 share

[xusheng@hadoop102 hadoop-3.1.3]$

2)重要目录

(1)bin目录:存放对Hadoop相关服务(hdfs,yarn,mapred)进行操作的脚本

(2)etc目录:Hadoop的配置文件目录,存放Hadoop的配置文件

(3)lib目录:存放Hadoop的本地库(对数据进行压缩解压缩功能)

(4)sbin目录:存放启动或停止Hadoop相关服务的脚本

(5)share目录:存放Hadoop的依赖jar包、文档、和官方案例

四、Hadoop运行模式

1)Hadoop官方网站:http://hadoop.apache.org/

2)Hadoop运行模式包括:本地模式、伪分布式模式以及完全分布式模式。

本地模式:单机运行,只是用来演示一下官方案例。生产环境不用。

伪分布式模式:也是单机运行,但是具备Hadoop集群的所有功能,一台服务器模拟一个分布式的环境。个别缺钱的公司用来测试,生产环境不用。

完全分布式模式:多台服务器组成分布式环境。生产环境使用。

4.1 本地运行模式(官方WordCount)

1)创建在hadoop-3.1.3文件下面创建一个wcinput文件夹

[xusheng@hadoop102 hadoop-3.1.3]$ mkdir wcinput

2)在wcinput文件下创建一个word.txt文件

[xusheng@hadoop102 hadoop-3.1.3]$ cd wcinput

3)编辑word.txt文件

[xusheng@hadoop102 wcinput]$ vim word.txt

在文件中输入如下内容

hadoop yarn

hadoop mapreduce

xusheng

xusheng

保存退出::wq

4)回到Hadoop目录/opt/module/hadoop-3.1.3

5)执行程序

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount wcinput wcoutput

6)查看结果

[xusheng@hadoop102 hadoop-3.1.3]$ cat wcoutput/part-r-00000

看到如下结果:

xusheng2

hadoop 2

mapreduce 1

yarn 1

4.2 完全分布式运行模式(开发重点)

分析:

1)准备3台客户机(关闭防火墙、静态IP、主机名称)

2)安装JDK

3)配置环境变量

4)安装Hadoop

5)配置环境变量

6)配置集群

7)单点启动

8)配置ssh

9)群起并测试集群

4.2.1 虚拟机准备

详见2.1、2.2两节。

4.2.2 编写集群分发脚本xsync

1)scp(secure copy)安全拷贝

(1)scp 定义

scp 可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

(2)基本语法

scp -r $pdir/$fname $user@$host:$pdir/$fname

命令 递归 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称

(3)案例实操

➢ 前提:在 hadoop102、hadoop103、hadoop104 都已经创建好的/opt/module、/opt/software 两个目录,并且已经把这两个目录修改为 xusheng:xusheng

[xusheng@hadoop102 ~]$ sudo chown xusheng:xusheng -R

/opt/module

(a)在 hadoop102 上,将 hadoop102 中/opt/module/jdk1.8.0_212 目录拷贝到hadoop103 上。

[xusheng@hadoop102 ~]$ scp -r /opt/module/jdk1.8.0_212

xusheng@hadoop103:/opt/module

(b)在 hadoop103 上,将 hadoop102 中/opt/module/hadoop-3.1.3 目录拷贝到hadoop103 上。

[xusheng@hadoop103 ~]$ scp -r

xusheng@hadoop102:/opt/module/hadoop-3.1.3 /opt/module/

(c)在 hadoop103 上操作,将 hadoop102 中/opt/module 目录下所有目录拷贝到hadoop104 上。

[xusheng@hadoop103 opt]$ scp -r

xusheng@hadoop102:/opt/module/*

xusheng@hadoop104:/opt/module

2 )rsync 远程 同步

rsync 主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

rsync 和 scp 区别:用 rsync做文件的复制要比 scp 的速度快,rsync 只对差异文件做更新。scp 是把所有文件都复制过去。

(1)基本语法

rsync -av $pdir/$fname $user@$host:$pdir/$fname

命令 选项参数 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称

选项参数说明

选项 功能

-a 归档拷贝

-v 显示复制过程

(2)案例实操

(a)删除 hadoop103 中/opt/module/hadoop-3.1.3/wcinput

[xusheng@hadoop103 hadoop-3.1.3]$ rm -rf wcinput/

(b)同步 hadoop102 中的/opt/module/hadoop-3.1.3 到 hadoop103

[xusheng@hadoop102 module]$ rsync -av hadoop-3.1.3/

xusheng@hadoop103:/opt/module/hadoop-3.1.3/

3 )xsync 集群分发 脚本

(1)需求:循环复制文件到所有节点的相同目录下

(2)需求分析:

(a)rsync 命令原始拷贝:

rsync -av /opt/module xusheng@hadoop103:/opt/

(b)期望脚本:

xsync 要同步的文件名称

(c)期望脚本在任何路径都能使用(脚本放在声明了全局环境变量的路径)

[xusheng@hadoop102 ~]$ echo $PATH

/usr/local/bin:/usr/bin:/usr/local/sbin:/usr/sbin:/home/xusheng/.local/bin:/home/xusheng/bin:/opt/module/jdk1.8.0_212/bin

(3)脚本实现

(a)在/home/xusheng/bin 目录下创建 xsync 文件

[xusheng@hadoop102 opt]$ cd /home/xusheng

[xusheng@hadoop102 ~]$ mkdir bin

[xusheng@hadoop102 ~]$ cd bin/

[xusheng@hadoop102 bin]$ vim xsync

在该文件中编写如下代码

#!/bin/bash

#1. 判断参数个数

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

#2. 遍历集群所有机器

for host in hadoop102 hadoop103 hadoop104

do

echo ==================== $host ====================

#3. 遍历所有目录,挨个发送

for file in $@

do

#4. 判断文件是否存在

if [ -e $file ]

then

#5. 获取父目录

pdir=$(cd -P $(dirname $file); pwd)

#6. 获取当前文件的名称

fname=$(basename $file)

ssh $host "mkdir -p $pdir"

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

(b)修改脚本 xsync 具有执行权限

[xusheng@hadoop102 bin]$ chmod +x xsync

(c)测试脚本

[xusheng@hadoop102 ~]$ xsync /home/xusheng/bin

(d)将脚本复制到/bin 中,以便全局调用

[xusheng@hadoop102 bin]$ sudo cp xsync /bin/

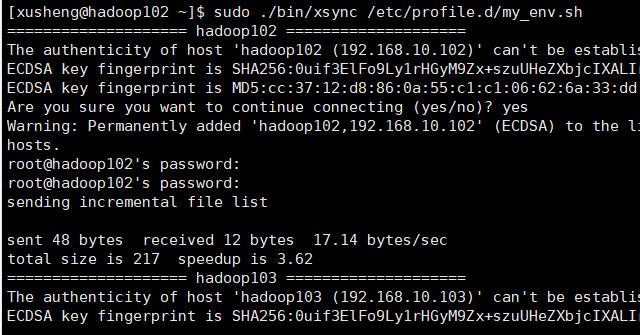

(e)同步环境变量配置(root 所有者)

[xusheng@hadoop102 ~]$ sudo ./bin/xsync /etc/profile.d/my_env.sh

注意:如果用了 sudo,那么 xsync 一定要给它的路径补全。

让环境变量生效

[xusheng@hadoop103 bin]$ source /etc/profile

[xusheng@hadoop104 opt]$ source /etc/profile

4.2.3 SSH无密登录配置

1 )置 配置 ssh

(1)基本语法

ssh 另一台电脑的 IP 地址

(2)ssh 连接时出现 Host key verification failed 的解决方法

[xusheng@hadoop102 ~]$ ssh hadoop103

➢ 如果出现如下内容

Are you sure you want to continue connecting (yes/no)?

➢ 输入 yes,并回车

(3)退回到 hadoop102

[xusheng@hadoop103 ~]$ exit

2 ) 无密钥配置

(1)免密登录原理

(2)生成公钥和私钥

[xusheng@hadoop102 .ssh]$ pwd

/home/xusheng/.ssh

[xusheng@hadoop102 .ssh]$ ssh-keygen -t rsa

然后敲(三个回车),就会生成两个文件 id_rsa(私钥)、id_rsa.pub(公钥)

(3)将公钥拷贝到要免密登录的目标机器上

[xusheng@hadoop102 .ssh]$ ssh-copy-id hadoop102

[xusheng@hadoop102 .ssh]$ ssh-copy-id hadoop103

[xusheng@hadoop102 .ssh]$ ssh-copy-id hadoop104

注意:

还需要在 hadoop103 上采用 xusheng 账号配置一下无密登录hadoop102、hadoop103、hadoop104 服务器上。

还需要在 hadoop104 上采用 xusheng账号配置一下无密登录hadoop102、hadoop103、hadoop104 服务器上。

还需要在 hadoop102 上采用 root 账号,配置一下无密登录到 hadoop102、hadoop103、hadoop104;

3 ).ssh 文件夹下 (~/.ssh )

4.2.4 集群配置

1 ) 集群部署规划

注意:

➢ NameNode 和 SecondaryNameNode 不要安装在同一台服务器

➢ ResourceManager 也很消耗内存,不要和 NameNode、SecondaryNameNode 配置在同一台机器上。

2 )配置文件说明

Hadoop 配置文件分两类:默认配置文件和自定义配置文件,只有用户想修改某一默认配置值时,才需要修改自定义配置文件,更改相应属性值。

(1)默认配置文件:

网盘链接:

链接:https://pan.baidu.com/s/14IG2U66z8TrAyi8lT0629A

提取码:nd6u

(2)自定义配置文件:

core-site.xml 、hdfs-site.xml 、yarn-site.xml 、mapred-site.xml 四个配置文件存放在

$HADOOP_HOME/etc/hadoop

这个路径上,用户可以根据项目需求重新进行修改配置。

3 ) 配置 集群

(1)核心配置文件

配置 core-site.xml

[xusheng@hadoop102 ~]$ cd $HADOOP_HOME/etc/hadoop

[xusheng@hadoop102 hadoop]$ vim core-site.xml

文件内容如下:

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 指定 NameNode 的地址 -->