Neural Factorization Machines(NFM)

Posted zhiyong_will

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Neural Factorization Machines(NFM)相关的知识,希望对你有一定的参考价值。

1. 概述

Neural Factorization Machines(NFM)[1]是在2017年提出的用于求解CTR问题的算法模型,在Wide & Deep模型被提出后,相继出现了一些改进的算法模型,如DeepFM和DCN可以看成是对于Wide & Deep模型中Wide部分的改进,而此处的NFM模型则是可以看作是对Deep部分的改进。从模型的名字来看,NFM包含了两个部分,第一为Neural,这部分与神经网络相关,第二为Factorization Machines,这部分与FM相关。对于FM模型,文章中提到了可以从深度学习网络结构的角度来看待,此时FM就可以看作是由单层LR和二阶特征交叉组成的Wide & Deep模型,与Google提出的Wide & Deep模型的不同之处就是Deep部分是二阶隐向量相乘。从这个角度上来看,NFM是在FM的基础上利用NN模型代替FM中的Deep部分,而这个NN与Wide & Deep中的Deep的不同是NFM中的Deep中包含了Bi-Interaction的层,用于对特征做二阶交叉运算。综上,NFM的优化点主要为:

- 在深度网络中引入Bi-Interaction做进一步的特征交叉。

- 对比FM,深度网络能够学习更高阶的非线形的特征交叉。

2. 算法原理

2.1. NFM模型的网络结构

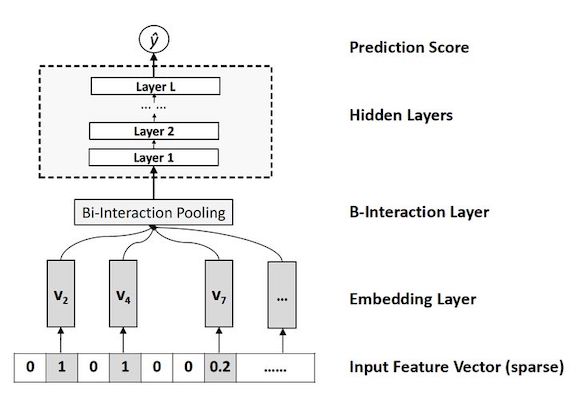

完整的NFM的网络结构如下图所示:

对于NFM模型,假设输入的稀疏经one-hot编码后的向量为

x

∈

R

n

\\mathbfx\\in \\mathbbR^n

x∈Rn,NFM模型的输出为:

y ^ N F M ( x ) = w 0 + ∑ i = 1 n w i x i + f ( x ) \\haty_NFM\\left ( \\mathbfx \\right )=w_0+\\sum_i=1^nw_ix_i+f\\left ( \\mathbfx \\right ) y^NFM(x)=w0+i=1∑nwixi+f(x)

其中, w 0 + ∑ i = 1 n w i x i w_0+\\sum_i=1^nw_ix_i w0+∑i=1nwixi如上图中的linear regression, f ( x ) f\\left ( \\mathbfx \\right ) f(x)为上图中的右半部分。对于FM算法,其表达式为:

y ^ F M ( x ) = w 0 + ∑ i = 1 n w i x i + ∑ i = 1 n − 1 ∑ j = i + 1 n ⟨ v i , v j ⟩ x i x j \\haty_FM\\left ( \\mathbfx \\right )=w_0+\\sum_i=1^nw_ix_i+\\sum_i=1^n-1\\sum_j=i+1^n\\left \\langle v_i,v_j \\right \\rangle x_ix_j y^FM(x)=w0+i=1∑nwixi+i=1∑n−1j=i+1∑n⟨vi,vj⟩xixj

从两者的数学表达式可以看出,FM模型是NFM的特殊形式,即满足: f ( x ) = ∑ i = 1 n − 1 ∑ j = i + 1 n ⟨ v i , v j ⟩ x i x j f\\left ( \\mathbfx \\right )=\\sum_i=1^n-1\\sum_j=i+1^n\\left \\langle v_i,v_j \\right \\rangle x_ix_j f(x)=∑i=1n−1∑j=i+1n⟨vi,vj⟩xixj。我们发现如何构造 f ( x ) f\\left ( \\mathbfx \\right ) f(x)式NFM模型中的关键部分。

2.2. NFM模型中的特征交叉

NFM模型中的特征交叉 f ( x ) f\\left ( \\mathbfx \\right ) f(x)的结构如下图所示:

如上图,NFM中特征交叉部分

f

(

x

)

f\\left ( \\mathbfx \\right )

f(x)是一个深度神经网络模型,在特征交叉部分

f

(

x

)

f\\left ( \\mathbfx \\right )

f(x)的网络中,主要包括Embedding层,Bi-Interaction层,隐含层以及预测层。

2.2.1. Embedding层

Embedding层的作用是将稀疏的one-hot特征转换成稠密的向量表示,这个操作是深度神经网络的必备操作方法。假设转换后的embeding向量为:

V x = x 1 v 1 , ⋯ , x n v n \\mathbfV_x=\\left\\x_1\\mathbfv_1,\\cdots ,x_n\\mathbfv_n \\right\\ Vx=x1v1,⋯,xnvn

2.2.2. Bi-Interaction层

对稀疏特征处理后就可以进入到深度学习模型的计算中,在NFM中,首先进入到Bi-Interaction层中,Bi-Interaction Pooling的主要作用是对Embedding后的特征学习特征交叉,其具体格式为:

f B I ( V x ) = ∑ i = 1 n − 1 ∑ j = i + 1 n x i v i ⊙ x j v j f_BI\\left ( \\mathbfV_x \\right )=\\sum_i=1^n-1\\sum_j=i+1^nx_i\\mathbfv_i\\odot x_j\\mathbfv_j fBI(Vx)=i=1∑n−1j=i+1∑nxivi⊙xjvj

其中, ⊙ \\odot ⊙表示的是两个向量的元素乘积,即 ( v i ⊙ v j ) k = v i k v j k \\left ( \\mathbfv_i\\odot \\mathbfv_j \\right )_k=v_ikv_jk (vi⊙vj)k=vikvjk。可以看到Bi-Interaction的输出为两个向量的交叉。

2.2.3. Hidden层

在Bi-Interaction层之上是堆叠了一系列的隐含层,主要的目的是学习更高阶的特征交叉,用数学的表述为:

z 1 = σ 1 ( W 1 f B I ( V x ) + b 1 ) z 2 = σ 2 ( W 2 z 1 + b 2 ) ⋯ ⋯ z L = σ L ( W L z L − 1 + b L ) \\beginmatrix \\mathbfz_1=\\sigma _1\\left ( \\mathbfW_1f_BI\\left ( \\mathbfV_x \\right )+\\mathbfb_1 \\right )\\\\ \\mathbfz_2=\\sigma _2\\left ( \\mathbfW_2\\mathbfz_1+\\mathbfb_2 \\right )\\\\ \\cdots \\cdots \\\\ \\mathbfz_L=\\sigma _L\\left ( \\mathbfW_L\\mathbfz_L-1+\\mathbfb_L \\right ) \\endmatrix z1=σ1(W1f以上是关于Neural Factorization Machines(NFM)的主要内容,如果未能解决你的问题,请参考以下文章