最优化建模算法理论之Goldstein准则(数学原理及MATLAB实现)

Posted Z.Q.Feng

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了最优化建模算法理论之Goldstein准则(数学原理及MATLAB实现)相关的知识,希望对你有一定的参考价值。

文章目录

一、前言

为了克服 Armijo 准则的缺陷,我们需要引入其他准则来保证每一步的 α k \\alpha^k αk 不会太小。

既然 Armijo 准则只要求点 ( α , ϕ ( α ) ) (\\alpha, \\phi(\\alpha)) (α,ϕ(α)) 必须处在某直线下方,我们也可使用相同的形式使得该点必须处在另一条直线的上方。

这就是 Armijo-Goldstein 准则,简称 Goldstein 准则。

二、Goldstein准则

1. 定义

设 d k d^k dk 是点 x k x^k xk 处的下降方向,若

f ( x k + α d k ) ≤ f ( x k ) + c α ∇ f ( x k ) T d k , f ( x k + α d k ) ≥ f ( x k ) + ( 1 − c ) α ∇ f ( x k ) T d k \\beginaligned &f(x^k + \\alpha d^k) \\le f(x^k) + c\\alpha \\nabla f(x^k)^Td^k,\\\\ &f(x^k + \\alpha d^k) \\ge f(x^k) + (1 - c)\\alpha \\nabla f(x^k)^Td^k \\endaligned f(xk+αdk)≤f(xk)+cα∇f(xk)Tdk,f(xk+αdk)≥f(xk)+(1−c)α∇f(xk)Tdk

则称步长

α

\\alpha

α 满足 Goldstein 准则,其中

c

∈

(

0

,

1

2

)

c \\in (0, \\dfrac12)

c∈(0,21)。

2. 几何含义

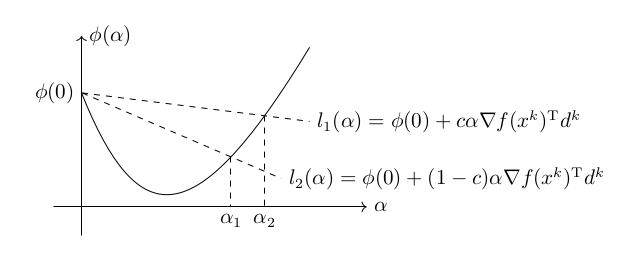

与 Armjio 准则相类似,Goldstein 准则也有非常直观的几何含义,它指的是点 ( α , ϕ ( α ) ) (\\alpha, \\phi(\\alpha)) (α,ϕ(α)) 必须在两条直线

l 1 ( α ) = ϕ ( 0 ) + c α ∇ f ( x k ) T d k , l 2 ( α ) = ϕ ( 0 ) + ( 1 − c ) α ∇ f ( x k ) T d k \\beginaligned &l_1(\\alpha) = \\phi(0) + c\\alpha \\nabla f(x^k)^Td^k,\\\\ &l_2(\\alpha) = \\phi(0) + (1 - c)\\alpha \\nabla f(x^k)^Td^k \\endaligned l1(α)=ϕ(0)+cα∇f(xk)Tdk,l2(α)=ϕ(0)+(1−c)α∇f(xk)Tdk

之间。如下图所示:

区间

[

α

1

,

α

2

]

[\\alpha_1, \\alpha_2]

[α1,α2] 中的点均满足 Goldstein 准则,同时我们也注意到 Goldstein 准则确实去掉了过小的

α

\\alpha

α。

三、代码实现

MATLAB 代码如下:

function [alpha, xk, f, k] = Goldstein(fun, grid, x0, dk)

%

% Function [alpha, xk, fx, k] = Goldstein(fun, grid, x0, dk)

% 求出函数fun在x0处以dk为下降方向时的步长alpha,同时返回相对应的下

% 一个下降点xk以及xk处的函数值fx,k为迭代次数

% -----------------------------------------------------------

% 输入:

% fun 函数名称(字符变量)

% grid 梯度函数名称(字符变量)

% x0 迭代点(列向量)

% dk 函数在迭代点处的下降方向(列向量)

%

% 输出:

% alpha 函数在x0处以dk为下降方向时的下降步长

% xk 函数在x0处以dk为下降方向,以alpha为步长

% 求得的下降点

% f 函数在下降点xk处的函数值

% k 求步长算法迭代次数

% -----------------------------------------------------------

% by Zhi Qiangfeng

%

c = 0.3; % 泰勒展开式补足系数,0 < c < 1/2

alpha = 1; % 初始步长为 1

k = 0; % 统计迭代次数

a = 0; b = inf; % 二分法确定 alpha 值

gk = feval(grid, x0); % x0处的梯度值

fk = feval(fun, x0 + alpha * dk); % 函数在下一个迭代点处的目标函数值

l1 = feval(fun, x0) + c * alpha * gk' * dk; % Armjio准则

l2 = feval(fun, x0) + (1 - c) * alpha * gk' * dk; % Armjio准则的补全

while true

if fk > l1

K = k + 1;

b = alpha;

alpha = (a + b) / 2;

fk = feval(fun, x0 + alpha * dk);

l1 = feval(fun, x0) + c * alpha * gk' * dk;

l2 = feval(fun, x0) + (1 - c) * alpha * gk' * dk;

continue;

end

if fk < l2

k = k + 1;

a = alpha;

alpha = min([2 * alpha, (a + b) / 2]);

fk = feval(fun, x0 + alpha * dk);

l1 = feval(fun, x0) + c * alpha * gk' * dk;

l2 = feval(fun, x0) + (1 - c) * alpha * gk' * dk;

continue;

end

break;

end

xk = x0 + alpha * dk; % 下降点

f = feval(fun, xk); % 下降点处函数值

end

四、与Armjio准则的对比

以求解 Rosenbrock 函数为例,这是优化领域中一个著名的检验函数,函数表达式如下:

f ( x ) = 100 ( x 2 − x 1 2 ) 2 + ( 1 − x 1 ) 2 , g ( x ) = [ − 400 x 1 x 2 + 400 x 1 3 + 2 x 1 − 2 ; 200 x 2 − 200 x 1 2 ] \\beginaligned &f(x) = 100(x_2 - x_1^2)^2 + (1 - x_1)^2,\\\\ &g(x) = \\left[\\beginaligned-400x_1x_2 + 400x_1^3 + 2x_1 - 2;\\\\200x_2 - 200x_1^2\\endaligned\\right] \\endaligned f(x)=100(x2−x12)2+(1−x1)2,g(x)=[−400x1x2+400x13+2x1−2;200x2−200x12]

编写函数文件 fun.m 如下:

function f = fun(x)

f = 100 * (x(2) - x(1)^2)^2 + (1 - x(1))^2;

end

随后是梯度函数文件 grid.m 如下:

function g = grid(x)

g = [-400 * x(1) * x(2) + 400 * x(1)^3 + 2 * x(1) - 2;

200 * x(2) - 200 * x(1)^2];

end

Armjio 准则代码参考此篇博客:最优化建模算法理论之Armjio准则(数学原理及MATLAB实现)

求解方法采用 BFGS 拟牛顿方法,代码参考此篇博客:最优化建模算法理论之BFGS/DFP拟牛顿方法(数学原理及MATLAB实现)

编写求解代码如下:

x0 = [-