Keras之RNN和LSTM

Posted 月疯

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Keras之RNN和LSTM相关的知识,希望对你有一定的参考价值。

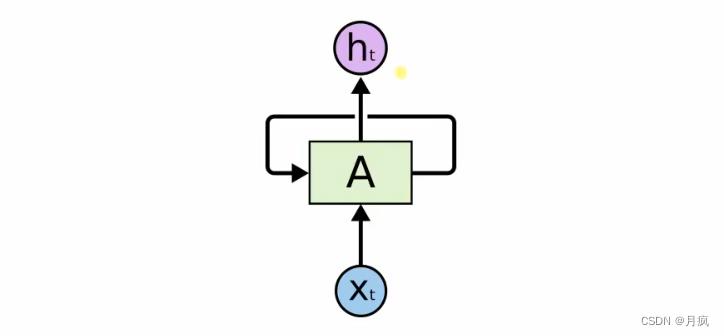

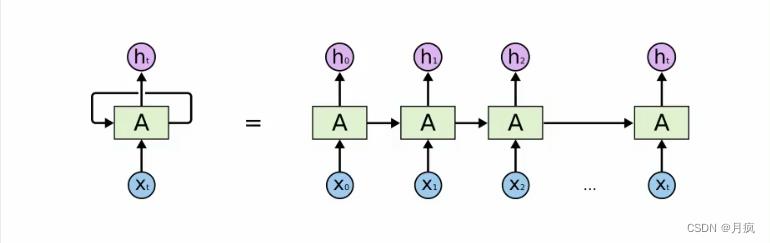

RNN是循环神经网络:主要场景是语音识别、机器学习翻译、文本分类

RNN是简单的循环网络,无法处理长文本的分类,所以提出LSTM长短型记忆循环神经网络,

还有RNN双向循环神经网络、RNN双层循环神经网络、还有GRU门循环神经网络。

RNN会出现梯度爆炸和梯度消失的问题,升级LSTM级GRU

tanh导数在0-1之间,当其与w相乘小于1时,随着循环次数的增加,最终会导致趋于0,造成梯度消失,相反如果w和tanh乘积大于1时,随着循环次数增加会出现梯度爆炸。

展开之后:

import numpy as np

from keras.datasets import mnist #直接从keras里面应用数据集

from keras.utils import np_utils #keras 里面用到的一个 np 的工具包

from keras.models import Sequential

from keras.layers import Dense

from keras.layers.recurrent import SimpleRNN,LSTM,GRU #常见的就这三种

from keras.optimizers import Adam

#载入数据

(x_train,y_train),(x_test,y_test)=mnist.load_data() #分为测试集和训练集

x_train=x_train/255.0

x_test=x_test/255.0

#标签转换成 one hot 格式

y_train=np_utils.to_categorical(y_train,num_classes=10)#专门用来转格式的包

y_test=np_utils.to_categorical(y_test,num_classes=10)

#定义模型的顺序

#写一个的话是有两层,写两个的话是有3层

model=Sequential()

model.add(SimpleRNN(

units=50, #输出是50

input_shape=(28,28) #输入的形状.

))

#输出层

model.add(Dense(10,activation='softmax'))

#定义优化器

adam=Adam(lr=1e-4)

#使用优化器和 loss函数,在训练的过程中计算精确度

model.compile(optimizer=adam,loss='categorical_crossentropy',metrics=["acc"])

model.fit(x_train,y_train,batch_size=64,epochs=10)

loss,accuracy=model.evaluate(x_test,y_test)

print("损失函数*********",loss)

print("精确度**********",accuracy)以上是关于Keras之RNN和LSTM的主要内容,如果未能解决你的问题,请参考以下文章