机器学习中「正则化来防止过拟合」到底是一个啥原理?

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了机器学习中「正则化来防止过拟合」到底是一个啥原理?相关的知识,希望对你有一定的参考价值。

过度拟合的问题通常发生在变量(特征)过多的时候。这种情况下训练出的方程总是能很好的拟合训练数据,也就是说,我们的代价函数可能非常接近于 0 或者就为 0。但是,这样的曲线千方百计的去拟合训练数据,这样会导致它无法泛化到新的数据样本中,以至于无法预测新样本价格。在这里,术语"泛化"指的是一个假设模型能够应用到新样本的能力。新样本数据是指没有出现在训练集中的数据。

具体而言,我们可以人工检查每一项变量,并以此来确定哪些变量更为重要,然后,保留那些更为重要的特征变量。至于,哪些变量应该舍弃,我们以后在讨论,这会涉及到模型选择算法,这种算法是可以自动选择采用哪些特征变量,自动舍弃不需要的变量。这类做法非常有效,但是其缺点是当你舍弃一部分特征变量时,你也舍弃了问题中的一些信息。例如,也许所有的特征变量对于预测房价都是有用的,我们实际上并不想舍弃一些信息或者说舍弃这些特征变量。正则化中我们将保留所有的特征变量,但是会减小特征变量的数量级(参数数值的大小θ(j))。这个方法非常有效,当我们有很多特征变量时,其中每一个变量都能对预测产生一点影响。正如我们在房价预测的例子中看到的那样,我们可以有很多特征变量,其中每一个变量都是有用的,因此我们不希望把它们删掉,这就导致了正则化概念的发生。

假设我们考虑一个最简单的线性模型,我们比较两个估计结果:(1) 最小二乘估计(2) 岭估计其中(2)中的第二项即可看成一个正则项。那么我们如何说明加入了这个正则项后,相较于来说,确实避免了过拟合呢?因为从数学上可以证明,,注意这里的小于是严格的小于。这里的证明是要用到矩阵范数和向量范数的相容性。这个性质本身告诉了我们这样一个及其重要的本质:加入正则项后,估计出的(向量)参数的长度变短了(数学上称为shrinkage)。换句话说,长度变短了就意味着,向量中的某些分量在总体程度上比的分量变小了。极端来说,向量中的某些分量可能(因为也可能是因为每个分量都变小一点点最后造成整体长度变小)被压缩到了0。虽然这里其实还没有完整说明我们实现了避免过拟合,但至少从某种程度上说,加入正则项和的参数估计是符合我们之前的预定目标的,即用尽量少的变量去拟合数据。

机器学习中的数学原理——过拟合正则化与惩罚函数

通过这篇博客,你将清晰的明白什么是过拟合、正则化、惩罚函数。这个专栏名为白话机器学习中数学学习笔记,主要是用来分享一下我在 机器学习中的学习笔记及一些感悟,也希望对你的学习有帮助哦!感兴趣的小伙伴欢迎私信或者评论区留言!这一篇就更新一下《 白话机器学习中的数学——过拟合、正则化与惩罚函数》

文章目录

一、过拟合

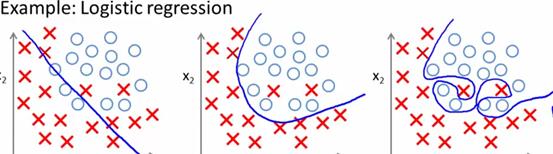

之前我们提到过的模型只能拟合训练数据的状态被称为过拟合,英文是 overfitting。记得在学习回归的时候,过度增加函数 fθ(x)的次数会导致过拟合。过拟合不止在回归时出现,在分类时也经常发生,我们要时常留意它。

避免过拟合有以下方法:

- 增加全部训练数据的数量

- 使用简单的模型

- 正则化

首先,重要的是增加全部训练数据的数量。之前我也讲过,机器学习是从数据中学习的,所以数据最重要。另外,使用更简单的模型也有助于防止过拟合。

二、正则化

2.1 正则化的方法

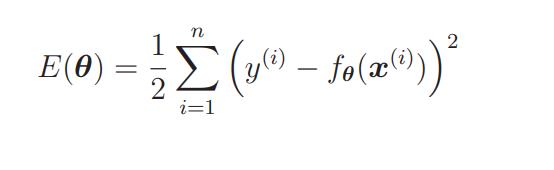

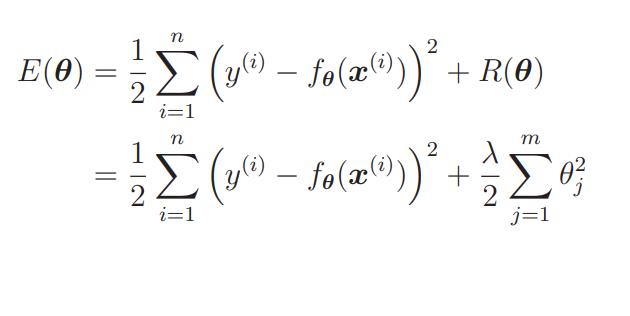

还记得我们在讲解回归的时候提到的目标函数吗?

我们要向这个目标函数增加下面这样的正则化项:

那么现在的

E

(

θ

)

E(\\boldsymbol\\theta)

E(θ)就变为:

我们要对这个新的目标函数进行最小化,这种方法就称为正则化。

m 是参数的个数,不过一般来说不对 θ0 应用正则化。所以仔细看会发现 j 的取值是从 1 开始的。也就是说,假如预测函数的表达式为 fθ(x) = θ0 + θ1x + θ2x2,那么 m = 2 就意味着正则化的对象参数为 θ1 和 θ2,θ0 这种只有参数的项称为偏置项,一般不对它进行正则化。λ 是决定正则化项影响程度的正的常数。这个值需要我们自己来定。

2.2 正则化的效果

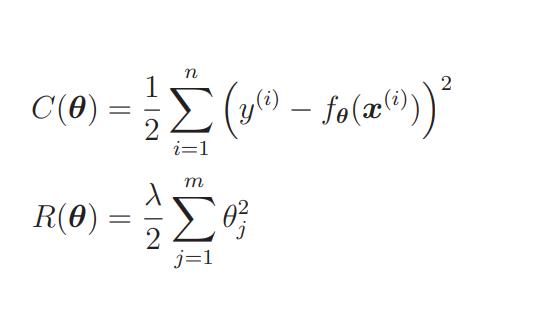

光看表达式可能不容易理解。我们结合图来想象一下吧:首先把目标函数分成两个部分。

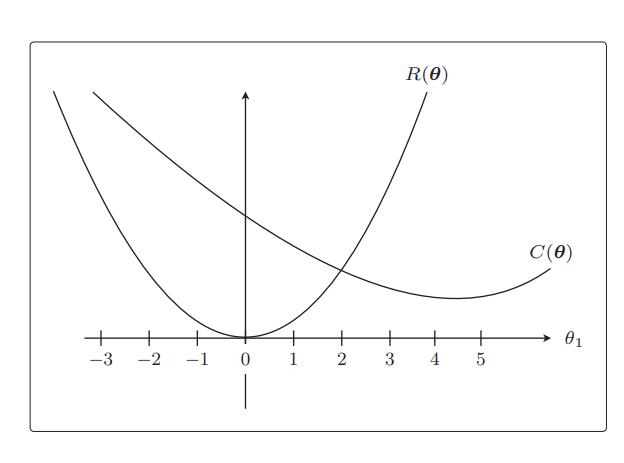

C(θ) 是本来就有的目标函数项,R(θ) 是正则化项。 C(θ) 和 R(θ) 相加之后就是新的目标函数,所以我们实际地把这两个函数的图形画出来,加起来看看。不过参数太多就画不出图来了,所以这里我们只关注 θ1。而且为了更加易懂,先不考虑 λ。

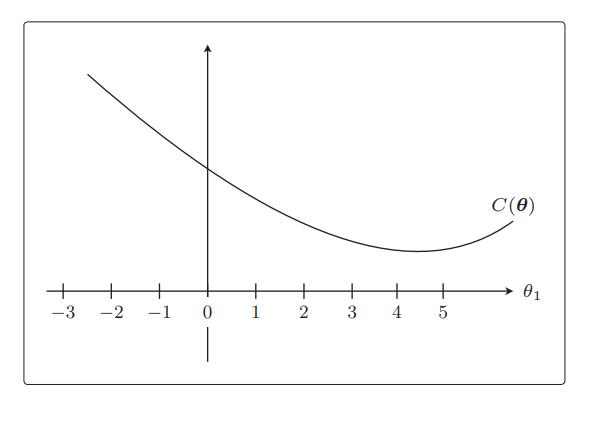

我们先从C(θ) 开始画起,不用太在意形状是否精确。在讲回归的时候,我们说过这个目

标函数开口向上,还记得吗?所以,我们假设它的形状是这样的:

从图中马上就可以看出最小值在哪里,是在θ1 = 4.5 附近。

从这个目标函数在没有正则化项时的形状来看,θ1 = 4.5 附近是最小值。接下来是 R(θ),它就相当于

1

2

θ

1

2

\\frac12 \\theta_1^2

21θ12所以是过原点的简单二次函数。

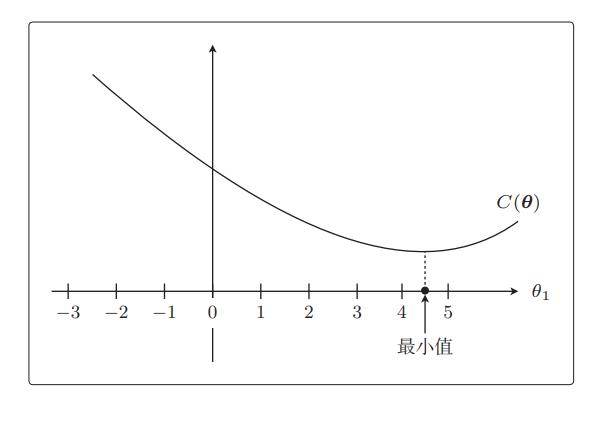

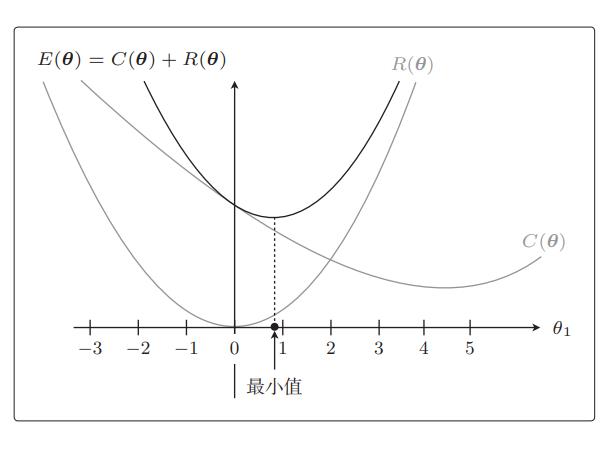

实际的目标函数是这两个函数之和E(θ) = C(θ) + R(θ),我们来画一下它的图形。顺便考虑一下最小值在哪里。把 θ1 各点上的 C(θ) 和 R(θ) 的高相加,然后用线把它们相连就好:

从图中我们可以看出来最小值是 θ1 = 0.9,与加正则化项之前相比,θ1 更接近 0 了。本来是在 θ1 = 4.5 处最小,现在是在 θ1 = 0.9 处最小,的确更接近 0 了。这就是正则化的效果。它可以防止参数变得过大,有助于参数接近较小的值。虽然我们只考虑了 θ1,但其他 θj 参数的情况也是类似的。

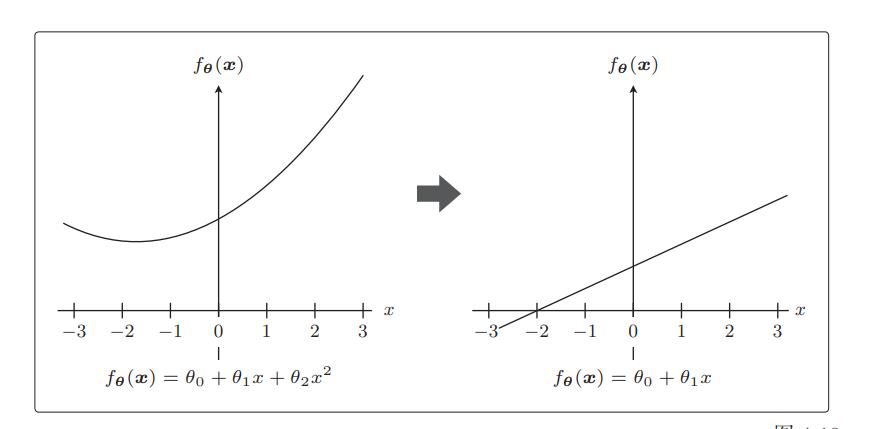

参数的值变小,意味着该参数的影响也会相应地变小。比如,有这样的一个预测函数 fθ(x):

f

θ

(

x

)

=

θ

0

+

θ

1

x

+

θ

2

x

2

f_\\boldsymbol\\theta(\\boldsymbolx)=\\theta_0+\\theta_1 x+\\theta_2 x^2

fθ(x)=θ0+θ1x+θ2x2

极端一点,假设 θ2 = 0,这个表达式就从二次变为一次了,这就意味着本来是曲线的预测函数变为直线了:

这正是通过减小不需要的参数的影响,将复杂模型替换为简单模型来防止过拟合的方式。

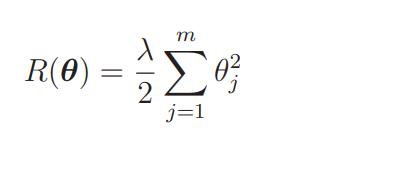

三、惩罚函数

为了防止参数的影响过大,在训练时要对参数施加一些惩罚。比如上面提到的 λ,可以控制正则化惩罚的强度。

C

(

θ

)

=

1

2

∑

i

=

1

n

(

y

(

i

)

−

f

θ

(

x

(

i

)

)

)

2

R

(

θ

)

=

λ

2

∑

j

=

1

m

θ

j

2

\\beginaligned & C(\\boldsymbol\\theta)=\\frac12 \\sum_i=1^n\\left(y^(i)-f_\\boldsymbol\\theta\\left(\\boldsymbolx^(i)\\right)\\right)^2 \\\\ & R(\\boldsymbol\\theta)=\\frac\\lambda2 \\sum_j=1^m \\theta_j^2 \\endaligned

C(θ)=21i=1∑n(y(i)−fθ(x(i)))2R(θ)=2λj=1∑mθj2

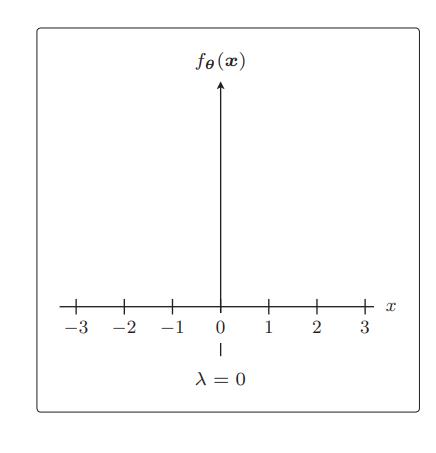

比如令 λ = 0,那就相当于不使用正则化

λ 越大,正则化的惩罚也就越严厉:

以上是关于机器学习中「正则化来防止过拟合」到底是一个啥原理?的主要内容,如果未能解决你的问题,请参考以下文章