Azure OpenAI 官方指南03|DALL-E 的图像生成功能与安全过滤机制

Posted 微软技术栈

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Azure OpenAI 官方指南03|DALL-E 的图像生成功能与安全过滤机制相关的知识,希望对你有一定的参考价值。

2021年1月,OpenAI 推出 DALL-E。这是 GPT 模型在图像生成方面的人工智能应用。其名称来源于著名画家、艺术家萨尔瓦多 • 达利(Dalí)和机器人总动员(Wall-E)。DALL-E 图像生成器,能够直接根据文本描述生成多种艺术风格的高质量图像,让机器也能拥有顶级画家、设计师的创造力。本期 Azure OpenAI 官方指南,为您详解 DALL-E 的图像生成功能、安全过滤机制与常见应用场景。

DALL-E的图像生成功能 ╱ 01

DALL-E的安全过滤机制 ╱ 02

DALL-E的常见应用场景 ╱ 03

DALL-E的图像生成功能

DALL-E 是一个高级人工智能应用,能够根据简单的自然语言描述创建极其逼真和清晰的图像。DALL-E 精通各种艺术风格,甚至可以根据季节、光线、环境、时间的不同,绘制相应的光影。

新推出的 DALL-E 2 版本,能够以比 DALL-E 高4倍的分辨率,生成更真实、更准确的图像,尤其在字幕匹配和照片真实性方面优于 DALL-E。此外,DALL-E 2 还具有更快的生成速度和更低的计算成本。

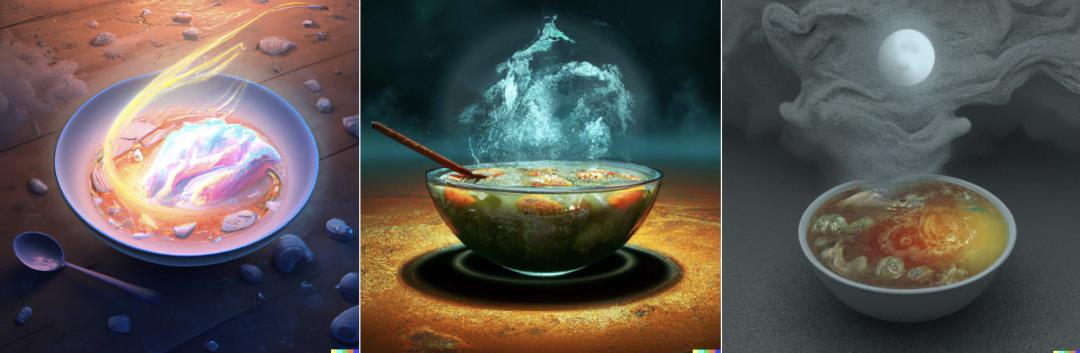

人们可以尽情展开想象力,DALL-E 2 可以短时间内将各种有趣的想法转化成图像。例如,当您描述 “可以通向另一个世界的一碗汤”,并指定图片风格分别为:数字艺术、巴斯奎特涂鸦风格以及洞穴壁画时,DALL-E 2 将生成如下画作:

⦿ 数字艺术风格

⦿ 巴斯奎特涂鸦风格

⦿ 洞穴壁画风格

除了画作外,DALL-E 2 还可以生成照片级的真实图像,如:宇航员闲适地呆在太空中的热带度假胜地。

此外,DALL-E 2 还有很多强大的拓展功能:

拓展功能 1

可以基于原始图像,在原始画布之外生成新图像,创造新构图。

拓展功能 2

可以基于自然语言描述,添加和删除元素,同时呈现出真实的阴影、反射和纹理。

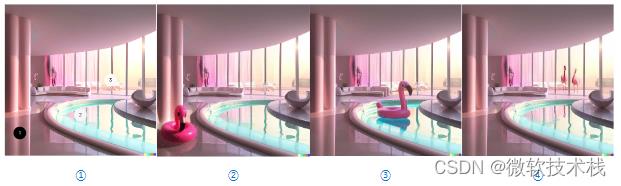

例如,以图1作为原始图片,在不同的位置分别放置火烈鸟时,图2、3、4分别呈现出了地板、水面、玻璃的多种反射和折射:

拓展功能 3

可以根据局部风格来调整成像,使画面整体更具真实性。

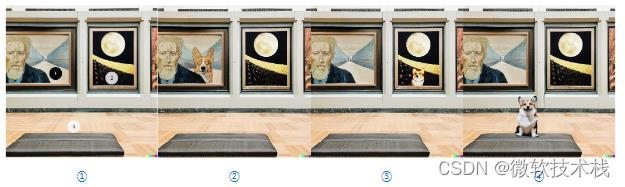

例如,图1是一张画展照片,在两幅画的位置和真实世界分别添加一只柯基,DALL-E 2 可以根据画面的局部风格,呈现出真实效果:

拓展功能 4

可以根据原始图像创建不同的变体

DALL-E的安全过滤机制

DALL-E 不仅能够理解图像,更能够理解图像和用于描述图像的文本之间的关系。基于此,我们能够理解AI是怎么看待这个世界的,并借此提升AI的生成能力和安全性。

为了确保使用者可以放心地使用 DALL-E,而不必担心生成的图像包含不适当的内容,DALL-E 通过模型训练构建了安全过滤机制,使模型从训练数据中获取明确的过滤内容。

DALL-E 2 预览版本中的安全过滤机制包括:

● 内容输入过滤器以及访问、使用等权限的相关策略。

● 风险导向调查和评估,包括偏见,虚假和错误信息,经济影响,涉及仇恨、骚扰和暴力的信息,版权等。

● 结合现有技术,思考进一步的风险和缓解措施。

DALL-E的常见应用场景

DALL-E 可以根据文字描述进行艺术创作,生成高质量的图像,并根据需要进行调整。因此,DALL-E 可以应用于广泛的领域和场景,例如广告、游戏、娱乐、教育等。

⦿ 广告娱乐:使用 DALL-E 生成极具吸引力的图像,以吸引更多客户。

⦿ 游戏:使用 DALL-E 生成游戏中的角色和场景,以增强游玩互动体验。

⦿ 教育:使用 DALL-E 生成教学图像,以帮助学生更好地理解课程内容。

⦿ 图形设计:使用 DALL-E 生成各种不同类型的图像,例如动画、漫画、矢量图等。

⦿ 汽车:使用 DALL-E 生成汽车设计图纸,以加速开发新车型。

⦿ 制造和零售:使用 DALL-E 生成产品图像,以优化产品销售体验。

此外,DALL-E 十分易用,可以通过 API 与其他系统集成,使开发人员可以轻松地将其集成到他们的应用程序中,获取更多功能。

微软已经宣布,将 DALL-E 集成到新版必应搜索引擎和 Designer 图形应用程序中,帮助设计师尽可能轻松地创建独特的图像和设计。设计师只需输入产品或公司名称,Designer 将帮助生成符合品牌形象的独特视觉效果。当添加新素材时,它还可以自动更新,确保与整体设计完美匹配。“有了 Designer,设计师就不需要从头开始创作,也无需耗时在数千个预先制作的模板中搜索。只需注入想象,让人工智能接管创作!”

企业级Azure OpenAI国际版官方指南

Vol.03 DALL-E 作者

钱祺斌微软云高级解决方案架构师

Azure OpenAI 官方指南02|ChatGPT 的架构设计与应用实例

ChatGPT 作为即将在微软全球 Azure 公有云平台正式发布的服务,已经迅速成为了众多用户关心的服务之一。而由 OpenAI 发布的 ChatGPT 产品,仅仅上线两个月,就成为互联网历史上最快突破一亿月活的应用。本期从技术角度深度解析 ChatGPT 的架构设计与应用实例。

ChatGPT的起源 ╱ 01

InsturctGPT的架构设计 ╱ 02

ChatGPT的技术应用场景及示例 ╱ 03

ChatGPT 的起源

ChatGPT 是由 OpenAI 公司在 2022年11月推出的一款智能聊天机器人程序,属于文本类AI应用。这里,Chat 即「聊天」,GPT 的全称为“Generative Pre-trained Transformer”。由于采用 Transformer 架构,且 ChatGPT 在 GPT-3 大模型基础上专门针对 Chat 聊天能力做了性能上的调优,所以 ChatGPT 在自然语言的许多交互场景中表现出了卓越的性能。

Transformer 模型在2017年问世,能够同时并行进行数据计算和模型训练,训练时长更短,并且训练得出的模型可用语法解释,也就是模型具有可解释性。经过训练后,这个最初的 Transformer 模型在包括翻译准确度、英语成分句法分析等各项评分上都达到了业内第一,成为当时最先进的大型语言模型(Large Language Model, LLM)。

2018年,在 Transformer 模型诞生还不到一年的时候,OpenAI 公司发表了论文“Improving Language Understanding by Generative Pre-training”(用创造型预训练提高模型的语言理解力),并推出了具有1.17亿个参数的GPT-1(Generative Pre-training Transformers)模型。

这是一个用大量数据训练的、基于 Transformer 结构的模型。OpenAI 的工程师使用了经典的大型书籍文本数据集(BookCorpus)进行模型预训练。该数据集包含超过7000本从未出版的书籍,涵盖了冒险、奇幻、言情等类别。在预训练之后,工程师们又针对四种不同的语言场景、使用不同的特定数据集对模型进行进一步的训练(又称为微调,Fine-Tuning)。最终训练所得的模型在问答、文本相似性评估、语义蕴含判定,以及文本分类这四种语言场景,都取得了比基础 Transformer 模型更优的结果,成为了新的业内第一。

2019年,OpenAI 公布了一个具有15亿个参数的模型:GPT-2。该模型架构与 GPT-1 原理相同,主要区别在于 GPT-2 的规模更大(10倍)。同时,OpenAI 也发表了介绍该模型的论文“Language Models are Unsupervised Multitask Learners”。

2020年,OpenAI 发表论文“Language Models are Few-Shot Learner”,并推出了最新的 GPT-3 模型——它有1750亿个参数。GPT-3 模型架构与 GPT-2 类似,但是规模大了整整两个数量级。GPT-3 的训练集也比前两款 GPT 模型要大得多:经过基础过滤的全网页爬虫数据集(4290亿个词符)、维基百科文章(30亿词符)、两个不同的书籍数据集(670亿词符)。

2022年3月,OpenAI再次发表论文“Training Language Models to Follow Instructions with Human Feedback”,并推出了基于 GPT-3 模型并进一步微调的 InstructGPT 模型。InstructGPT 的模型训练中加入了人类的评价和反馈数据,而不仅仅是事先准备好的数据集,从而训练出更真实、更无害,且更好地遵循用户意图的语言模型。

2022年11月,ChatGP 横空出世,它是基于 GPT-3.5 架构开发的对话AI模型,是 InstructGPT 的兄弟模型。但两者在训练模型的数据量上,以及数据收集、数据如何设置用于训练方面有所不同。

InsturctGPT 的架构设计

目前 Azure OpenAI 还没有官方公开资源详细说明 ChatGPT 的技术原理,因此我们将以 ChatGPT 的兄弟模型 InstructGPT 为对象,深度解析其算法架构设计。

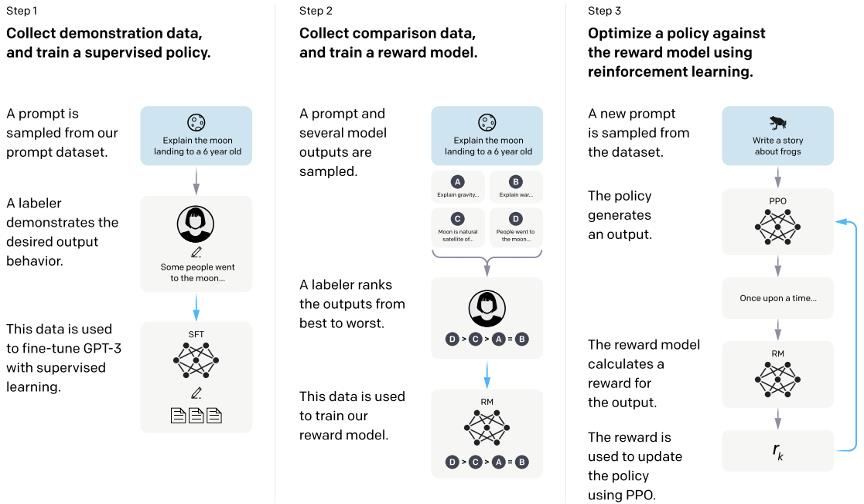

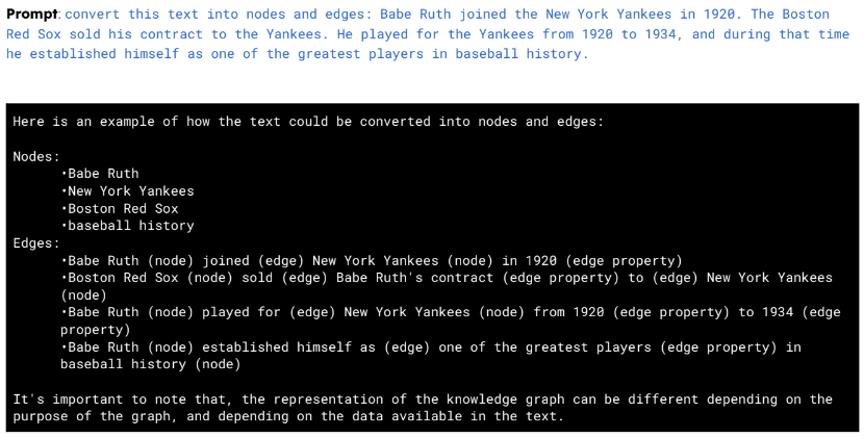

如上图所示,开发人员将提示分为三个阶段,并以不同的方式为每个阶段创建响应和训练:

第 1 阶段 训练监督策略模型

在这个阶段,工程师会在数据集中随机抽取问题,由专门的标注人员给出高质量答案,然后用这些人工标注好的数据来微调 GPT-3.5 模型。这些标注人员会在应聘前进行筛选测试,训练数据大约有1万3千个。相较于第二、三阶段,这里用到的数据量较少。

标注人员根据提示 (prompt) 编写质量可靠的输出响应 (demonstrations)。这里采用的是 Supervised Fine-Tuning(SFT)模型,即有监督的策略来进行微调。微调之后,SFT 模型在遵循指令/对话方面已经优于 GPT-3.5,但不一定符合人类偏好。

第 2 阶段 训练奖励模型

这一阶段主要是训练一个奖励模型Reward Modeling (RM)。这里的训练数据是怎么得到的呢?首先通过在数据集中随机抽取问题,使用第一阶段生成的模型,对每个问题生成多个不同的回答,然后再让标注人员对这些回答进行排序。对于标注人员来说,对输出进行排序比从头开始打标要容易得多,因此这一过程可以扩展数据量,大约产生3万3千个训练用的数据。

接下来,再使用这个排序结果来训练奖励模型。对于多个排序结果,两两组合,形成多个训练数据对。RM 模型接受输入后,给出评价回答质量的分数。对于一对训练数据,通过调节参数使得高质量回答的打分比低质量的打分要高。奖励模型学会了为评分高的响应计算更高的奖励,为评分低的回答计算更低的奖励。

第 3 阶段 采用 PPO 强化学习进行优化

PPO (Proximal Policy Optimization,近端策略优化)是一种用于在强化学习中训练 agent 的策略,这里被用来微调 SFT 模型。这一阶段利用第二阶段训练好的奖励模型,靠奖励打分来更新预训练模型参数。在数据集中随机抽取问题后,使用 PPO 模型生成回答,并用上一阶段训练好的 RM 模型计算奖励,给出质量分数,然后用这个奖励来继续更新 PPO 模型。奖励依次传递,由此产生策略梯度,通过强化学习的方式更新 PPO 模型参数。

不断重复第二和第三阶段,通过迭代,会训练出更高质量的 InstructGPT 模型。我们将来自于人类反馈的强化学习简称为 RLHF(reinforcement learning from human feedback):使用人类的偏好作为奖励信号来微调模型。这也是 ChatGPT 在实际对话过程中的输出更符合人类偏好的原因。

ChatGPT 的技术应用场景及示例

总的来说,ChatGPT 有如下几大类技术应用的领域——

⦿ 对话机器人:可以用于生成自然语言对话,实现人机交互。

⦿ 文本生成:可以用于生成摘要、文章、诗歌等文本。

⦿ 问答系统:可以用于回答用户提出的问题,提供相关信息。

⦿ 自动翻译:可以用于实现自动翻译,将文本从一种语言翻译为另一种语言。

⦿ 情感分析:可以用于分析文本的情感倾向,实现情感分析。

⦿ 语音合成:可以用于生成语音,将文本转换为语音。

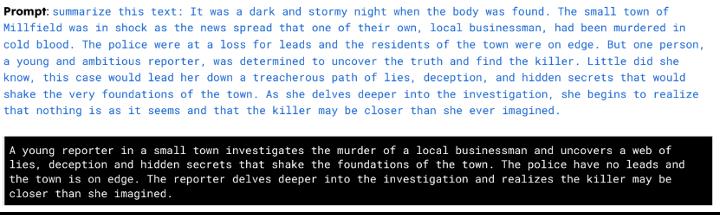

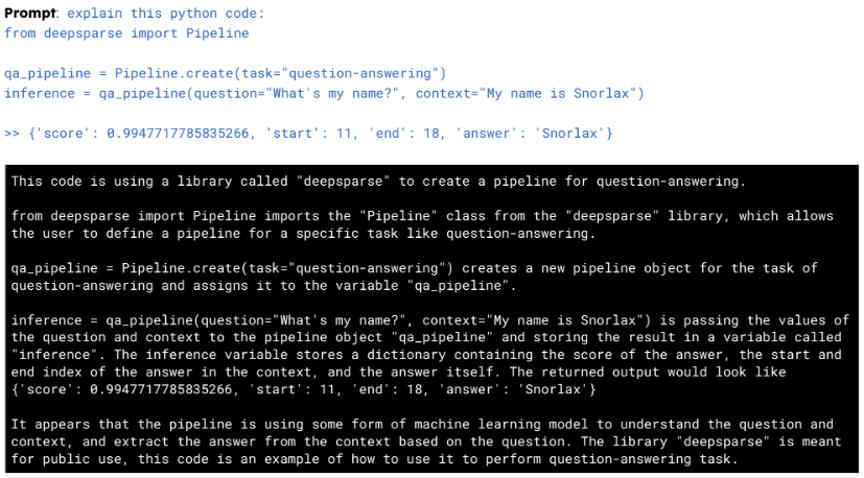

场景示例 1 NLP 领域

⦿ 生成摘要

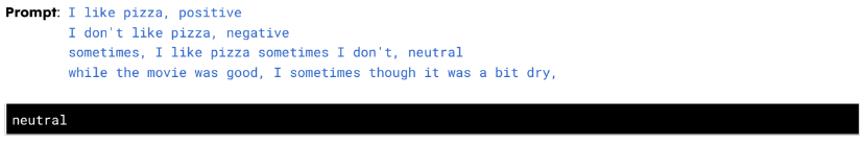

⦿ 情感分析(小样本或零样本)

few-shot or zero-shot

⦿ 开放领域问答

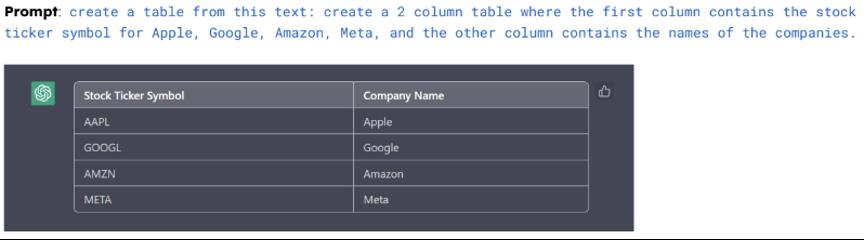

⦿ 由文字生成表格

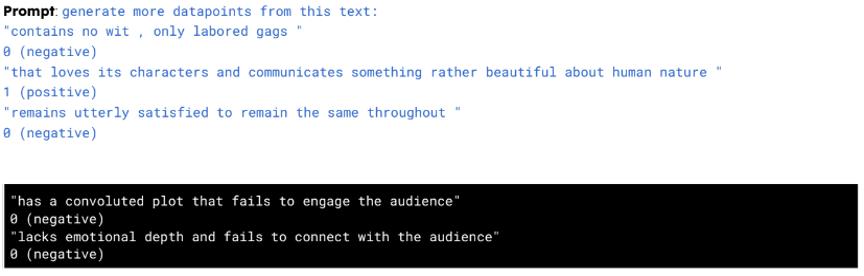

⦿ 数据集生成(小样本或零样本)

few-shot or zero-shot

场景示例 2 代码领域

⦿ 代码生成

⦿ 解释代码

⦿ 知识库生成

Azure OpenAI 官方指南 Vol.02 ChatGPT 作者

Annie Hu 微软云 AI 高级技术专家

以上是关于Azure OpenAI 官方指南03|DALL-E 的图像生成功能与安全过滤机制的主要内容,如果未能解决你的问题,请参考以下文章