警惕AI复制,几张图片就能实现视频伪造

Posted Yunlord

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了警惕AI复制,几张图片就能实现视频伪造相关的知识,希望对你有一定的参考价值。

CSDN话题挑战赛第1期

活动详情地址:https://marketing.csdn.net/p/bb5081d88a77db8d6ef45bb7b6ef3d7f

参赛话题:哪项人工智能技术使你感受到了神奇?

话题描述:在你漫长炼丹之旅,哪一项人工智能技术最让你印象深刻?

前言

前端时间悬疑剧《猎罪图鉴》热播,其中一个利用AI技术换脸进行诈骗的剧情,不少人被骗得倾家荡产,最终酿成自杀身亡的悲剧。而这不仅在影视剧中才能出现,在现实生活中,已经出现了不少AI变声换脸诈骗。

首先诈骗团伙通过电话录音等方式提取到声音素材,再在网上搜集公众发布的照片、视频等信息,通过AI技术将所搜集的素材进行合成,这样一个难以用肉眼进行区分的“伪视频”就制作完毕。

而这其实就是深伪技术。它是一种人工智能深度学习技术,通过对伪造事物的识别,再经过分析学习,当样本量足够多时,人工智能就会掌握原对象的特征。学习完成后,计算机就可以将人物形象、语言、背景拼合成近似完美的虚拟人物,这样,一段高仿视频就制作完毕。

上述过程看上去很难,但是随着技术的不断发展,使用门槛也在不断降低,通过一些开源软件,非专业的人员也能完成视频伪造。

而今天将介绍这项技术:DeepFake,能够实现AI换脸,然后再谈谈这个问题带来的影响以及如何解决这个问题。

一、DeepFake技术介绍

深度伪造一词译自英文“Deepfake”(“deep learning”和“fake”的组合),最初源于一个名为“deepfakes”的Reddit社交网站用户, 该用户于2017年12月在 Reddit 社交网站上发布了将斯嘉丽·约翰逊等女演员的面孔映射至色情表演者身上的伪造视频。

Deepfake目前在国际上并没有公认的统一定义, 美国在其发布的《2018 年恶意伪造禁令法 案》中将“deep fake”定义为“以某种方式使合理的观察者错误地将其视为个人真实言语或行为的真实记录的方式创建或更改的视听记录”, 其中“视听记录”即指图像、视频和语音等数字内容。

视频伪造:

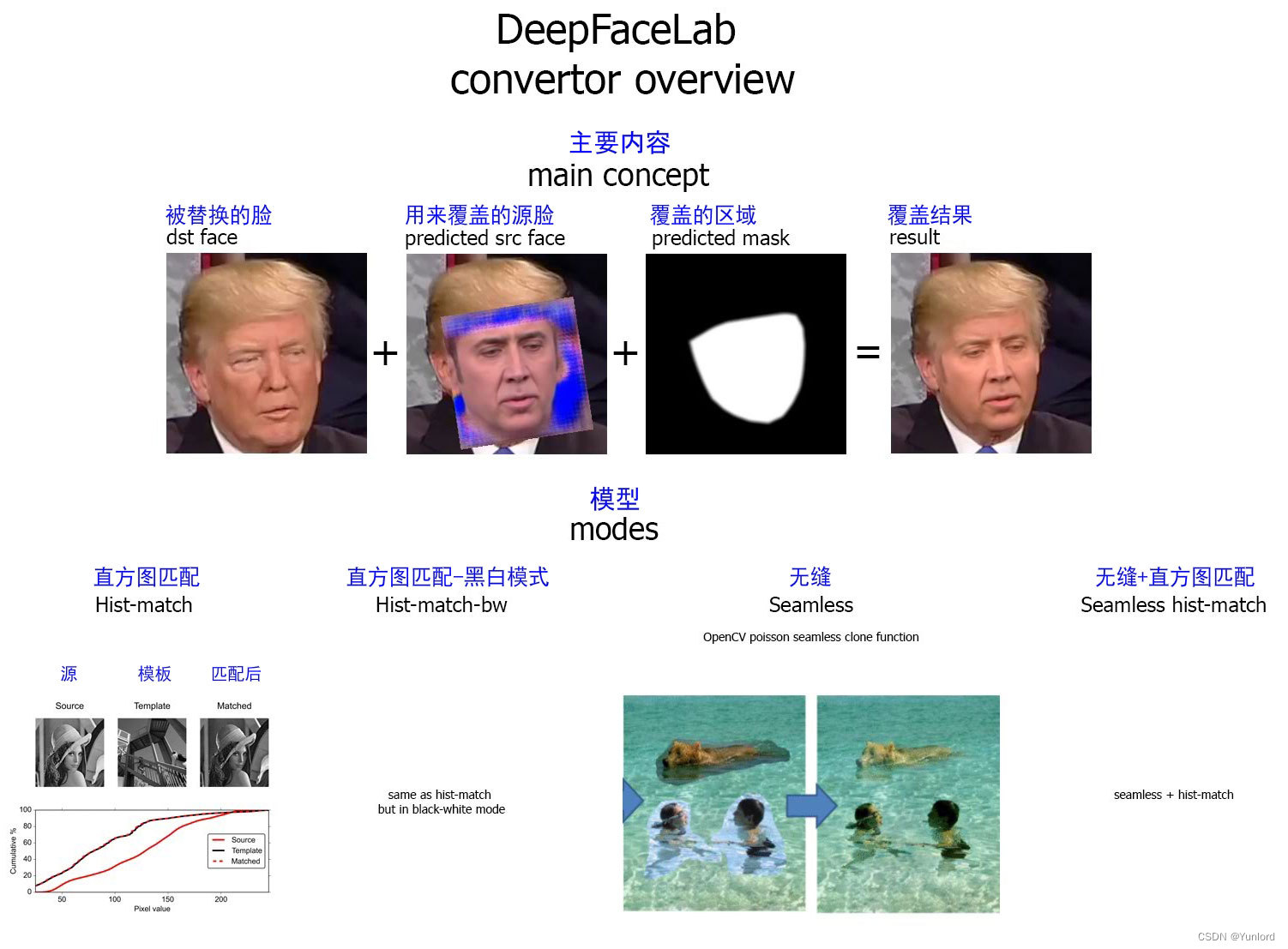

视频伪造是Deepfake技术最为主要的代表,制作假视频的技术也被称为AI换脸技术(AI face swap)。其核心原理是利用生成对抗网络或者卷积神经网络等算法将目标对象的面部“嫁接”到被模仿对象上。由于视频是连续的图片组成,因此只需要把每一张图片中的脸替换,就能得到变脸的新视频。具体而言,首先将模仿对象的视频逐帧转化成大量图片,然后将目标模仿对象面部替换成目标对象面部。最后,将替换完成的图片重新合成为假视频,而深度学习技术可以使这一过程实现自动化,主要采用自动编解码器以及生成对抗网络技术。

二、实现途径

接下来将介绍如何使用DeepFaceLab开源项目进行AI换脸。

首先我们需要从GitHub上克隆该项目DeepFaceLab,如下图所示:

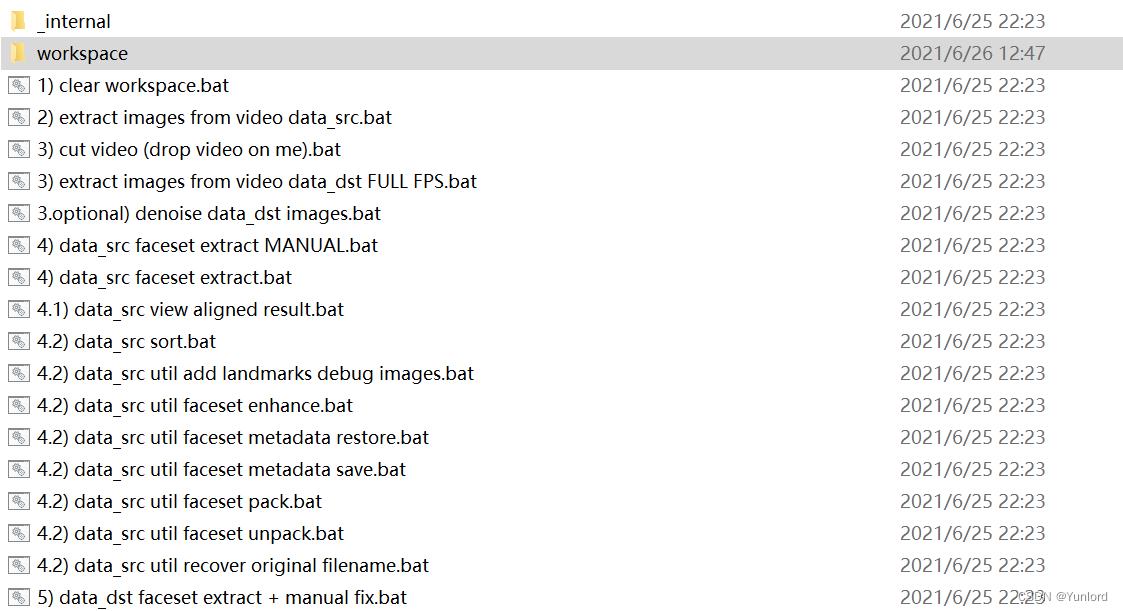

这里面包含两个文件夹,和一堆bat批处理指令。

- internal:存放源代码相关的内容

- workspace:工作目录

- bat: 脚本批处理文件,调用代码

执行步骤:

- 源视频转成图片(源图片)

- 目标视频转成图片(目标图片)

- 从源图片中提取源脸部信息

- 从目标图片中提取目标脸部信息

- 使用脸部信息头像训练模型(Model)

- 使用模型进行图片换脸

- 将换完脸的图片合成视频导出

三、效果展示

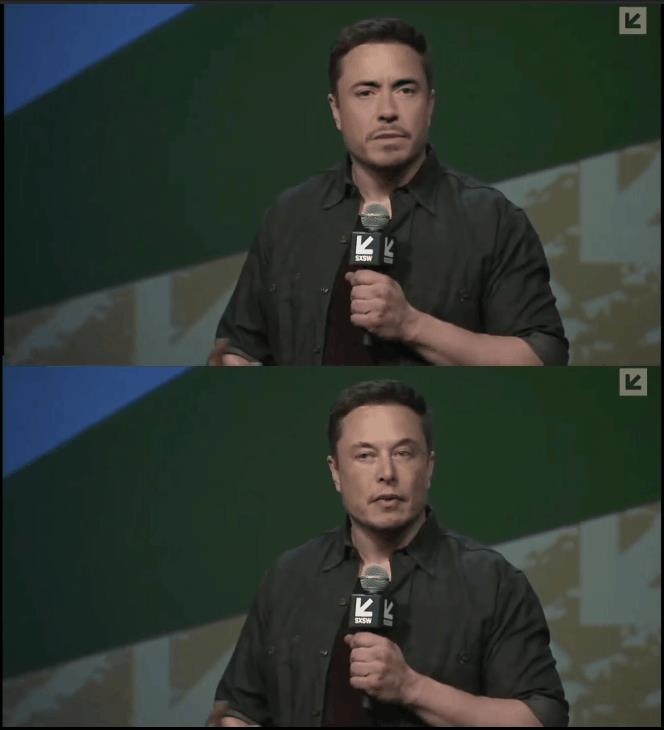

经过几个小时的训练,合成视频结果如下所示:

还有一些有趣的效果,如影视剧角色换脸!!!

高伟光沈腾AI换脸

四、总结

从AI换脸这一技术诞生起,大众对它的争议就从未停止过。诚然,每一项新兴技术给我们带来了便利,也存在着颠覆伦理道德和冲击安全底线的风险,急需行为道德和法律规范的双重约束。

而分享出这篇文章,会不会有人在本文的启发下做出恶意行为呢?事实上,不论是否由本文来介绍,该技术事实上就是存在的!

我们更加需要做的是唤醒更多人在虚假视频这方面的安全意识,从而促进研究相关的反制措施,分享出本文,利远大于弊。

最后也是最重要的,那就是在坚守道德底线的同时,始终记得科技是服务于我们的工具,而不是控制我们的漩涡。

参考:

CSDN话题挑战赛第1期活动详情地址:https://marketing.csdn.net/p/bb5081d88a77db8d6ef45bb7b6ef3d7f

以上是关于警惕AI复制,几张图片就能实现视频伪造的主要内容,如果未能解决你的问题,请参考以下文章

警惕AI,我搭建了一个“枪枪爆头”的视觉AI自瞄程序,却引发了一场“山雨欲来”

清华虚拟学生被质疑真人AI换脸?公司第三次回应:面部置换并非仅仅AI换脸