Graph Anomaly Detection with Deep Learning——图检测

Posted Anooyman

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Graph Anomaly Detection with Deep Learning——图检测相关的知识,希望对你有一定的参考价值。

图检测

论文:A Comprehensive Survey on Graph Anomaly Detection with Deep Learning

论文地址:https://arxiv.org/abs/2106.07178

异常图检测(Anomalous Graph Detection,ANOS GD)旨在检测其他图形有显著差异的单个图形,其代表例子是不同寻常的分子检测。当化合物被表示为分子/化学图,其中原子和键被表示为节点和边。异常图检测可以有效地识别不寻常的分子,因为它们对应的图具有与其他图不同的结构和特征。

除此之外,另一个例子是脑部疾病检测,给定不同年龄阶段的脑图,通过分析脑图序列的动力学(例如,脑区之间的相互作用模式),可以根据特定时间戳上不一致的脑图快照来诊断脑疾病,其中一些很少相互作用的脑区连接在一起。

之前提到的图形异常检测技术(即 边/节点/子图)无法用于图异常检测,因为它们专用于检测单个图形中的异常,而ANOS GD则针对图形级别的异常。

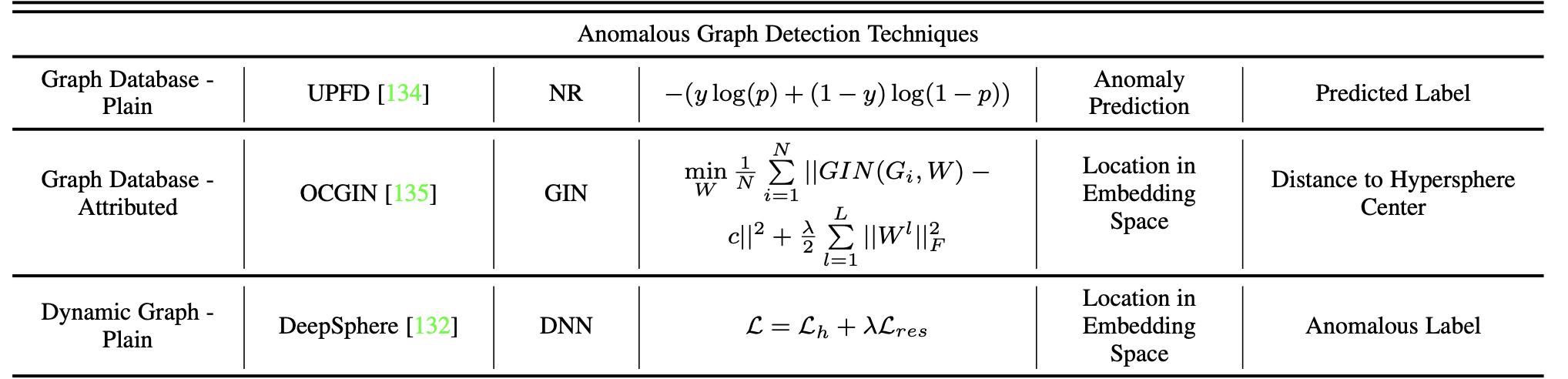

其代表作如下:

传统非深度的图异常检测方法

核心思想:构建图形的度量方法,衡量图形的差异

这里作者只简单的列举来部分已有工作,例如,[1] 试图通过使用图核测量图的成对近似度来检测异常图;[2] 通过检测异常节点组产生的异常图信号的表现;[3] 通过使用频繁基序编码图来检测异常图。

基于深度神经网络的图异常检测方法

核心思想:通过 NN 构建编码 ANOS GD 序列中包含的综合信息(例如,图形演化模式,图形快照的特征)

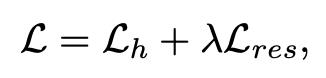

在常用的 DNN 中,LSTM 和 autoencoder 可以从图形快照序列中提取每个图形快照的特征。Teng [4] 等人提出了一个名为 DeepSphere 的模型应用这两种神经网络来检测不同于其他网络的异常图形快照,他们将动态图被描述为三阶张量的集合,是一个沿时间维切片的图快照邻接矩阵集合。为了识别异常张量,DeepSphere 首先使用 LSTM 自编码器将每个图形快照嵌入到一个潜在空间中,利用 one-class 分类器 [5] 学习超球体,使得异常快照位于外部。具体来说,LSTM 自编码器将邻接矩阵作为顺序输入,并对其进行训练以重构输入序列,超球面是通过单个神经网络层学习得到。其目标函数如下:

其中

L

h

L_h

Lh 是超球面损失函数,

L

r

e

s

L_res

Lres 是 LSTM 的重构损失。

L

h

L_h

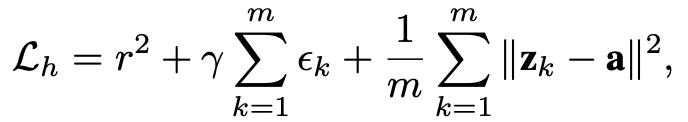

Lh 具体如下:

z

k

z_k

zk 是 LSTM 自编码器生成的隐向量,

a

\\mathbba

a 是超球体质心,

r

r

r是半径,

m

m

m为样本数目,

γ

\\gamma

γ 为超参,

ϵ

k

\\epsilon_k

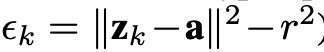

ϵk 代表惩罚项,具体如下:

基于图卷积神经网络的图异常检测方法

核心思想:利用 GNN 的特性更好的提取特征

Dou [6] 等人将假新闻检测转化为 ANOS GD 问题,提出一个名为 UPFD 的端到端模型,将新闻建模为树结构传播图,其中根节点表示新闻,其他节点表示共享根新闻的用户。将用户的历史帖子、新闻内容和传播图通过GNN层融合用户参与信息(即,用户的 embedding),并通过文本表示学习模型(例如 word2vec、BERT)提取新闻 embedding。对于每一条新闻,它都可以被表现为这两个嵌入的扁平连接,并被作为输入放入分类器中进行训练。相应的传播图被训练后的模型标记为假,可以认为是异常的。

Zhao 和 Akoglu [7] 使用 GIN 模型和 one-class 分类器(即,DeepSvd [5])损失来训练用于图级异常检测的端到端框架。对于图数据库中的每个图,其 graph-level embedding 是通过在其节点的节点级嵌入上应用 mean-pooling 生成的。如果图形位于学习的超球体之外,则最终会被描述为异常,如下图所示:

基于网络表示的图异常检测

核心思想:通过将图异常检测问题转化为嵌入空间中的常规异常检测问题。

采用通用 graph-level 技术进行异常检测分为两个阶段:首先,使用 graph-level 表示技术,如 Graph2Vec [8],FGSD [9],将数据库中的图形编码到共享的潜在空间中。然后,使用现成的异常检测器来测量每个图的异常。

基本上,这种方法涉及两个阶段中的现有方法配对,但是,这两个阶段彼此分隔开,因此检测性能可能低于标准,因为嵌入相似性不一定是为了异常检测而设计。

参考文献:

[1] E.A.Manzoor,S.M.Milajerdi,andL.Akoglu,“Fastmemory-efficient anomaly detection in streaming heterogeneous graphs,” in KDD, 2016, pp. 1035–1044.

[2] B. Hooi, L. Akoglu, D. Eswaran, A. Pandey, M. Jereminov, L. Pileggi, and C. Faloutsos, “Changedar: Online localized change detection for sensor data on a graph,” in CIKM, 2018, pp. 507–516.

[3] C. C. Noble and D. J. Cook, “Graph-based anomaly detection,” in KDD, 2003, pp. 631–636.

[4] X. Teng, M. Yan, A. M. Ertugrul, and Y. Lin, “Deep into hypersphere: Robust and unsupervised anomaly discovery in dynamic networks,” in IJCAI, 2018, pp. 2724–2730.

[5] L. Ruff, R. Vandermeulen, N. Goernitz, L. Deecke, S. A. Siddiqui, A. Binder, E. Mu ̈ller, and M. Kloft, “Deep one-class classification,” in ICML, 2018, pp. 4393–4402.

[6] Y. Dou, K. Shu, C. Xia, P. S. Yu, and L. Sun, “User preference-aware fake news detection,” arXiv preprint arXiv:2104.12259, 2021.

[7] L. Zhao and L. Akoglu, “On using classification datasets to evaluate graph outlier detection: Peculiar observations and new insights,” arXiv preprint arXiv:2012.12931, 2020.

[8] A. Narayanan, M. Chandramohan, R. Venkatesan, L. Chen, Y. Liu, and S. Jaiswal, “graph2vec: Learning distributed representations of graphs,” arXiv preprint arXiv:1707.05005, 2017.

[9] S. Verma and Z.-L. Zhang, “Hunt for the unique, stable, sparse and fast feature learning on graphs,” in NIPS, 2017, pp. 87–97.

微信公众号:

以上是关于Graph Anomaly Detection with Deep Learning——图检测的主要内容,如果未能解决你的问题,请参考以下文章