机器学习中的一些用语

Posted 为了明天而奋斗

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了机器学习中的一些用语相关的知识,希望对你有一定的参考价值。

ground truth

在机器学习中,“ground truth”指的是训练集对监督学习技术分类的准确性。在统计模型中被用来证明或否定研究假设。

“ground truth”指的是为测试收集适当的目标(可证明的)数据的过程。

logits

-

在深度学习中,logits 是最终的全连接层输出,所有 logits 共同减去一个数字,其得到的 softmax 结果是不变的,所以得到的 logits 并不一定与原始 logits 一模一样,而是会相差一个常数。

-

logits 不必担心值在0和1之间、各种情况相加等于一,但是又可以被容易地转换成表示概率的值。

-

logits 与 softmax 都属于在输出层的内容,logits = tf.matmul(X, W) + bias 再对 logits 做归一化处理,就用到了softmax:Y_pred = tf.nn.softmax(logits,name=‘Y_pred’)

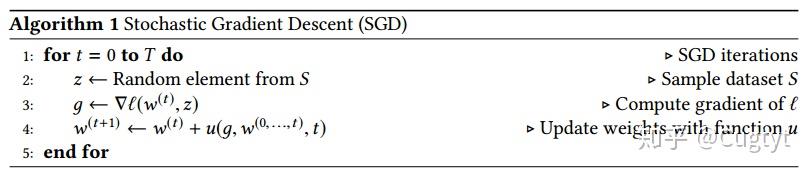

随机梯度下降

在运行 SGD 前,可以采样权重 w(0) 的初始估计,由于一些问题的病态特性,对于 w(0)的选择很重要,可以影响最终的结果。

可以选择采样一定的初始化策略或者预训练的权重(迁移学习)。

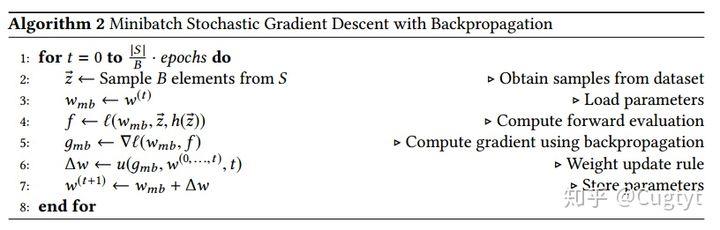

通常在批量 SGD 中,会减少权重的更新次数,对于数据的子集平均梯度,小批量的采样是通过打乱数据实现的,不断的从中取大小为 B 的数据。

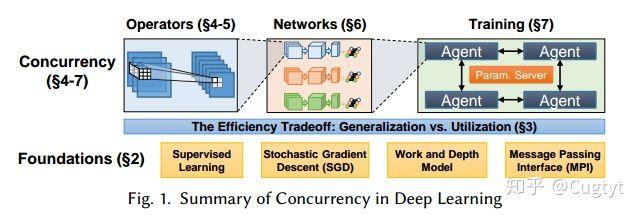

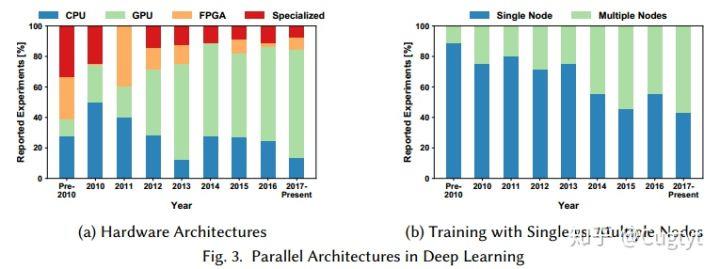

并行

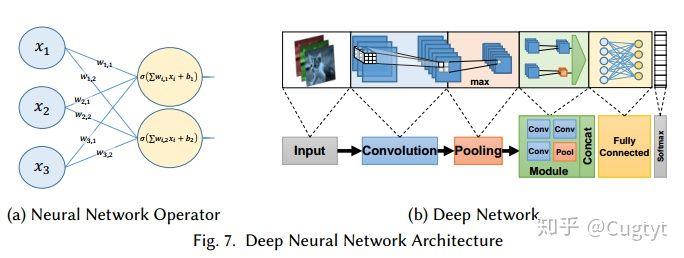

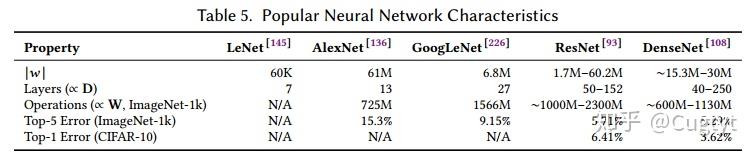

深度网络

模型并行:切分网络每层的神经元。

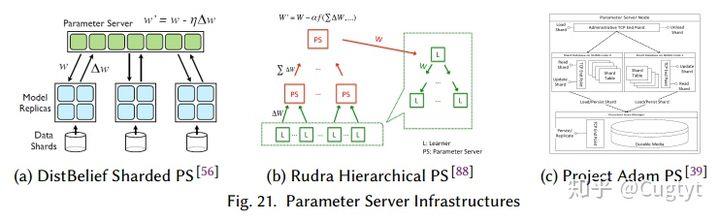

中心化,包括网络拓扑,带宽,通信延迟,参数更新频率,错误容忍度等。

参数和梯度压缩

使用高效的数据表示来压缩参数,避免发送不必要的信息,形成了稀疏数据结构的表示。

梯度压缩

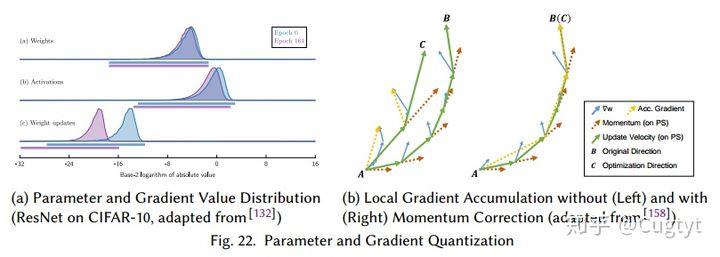

梯度压缩的一个数据表示是量化,把连续的信息映射到表示范围的桶中。

集成学习

集成学习需要很多的内存和算力,以一个训练后集成的技术是使用知识蒸馏减少网络的大小。这个模式中,训练有两步:第一步是正常的训练或集成一个大的网络,第二步是训练一个网络模拟大规模集成的输出。

结果显示第二个网络更容易训练。

以上是关于机器学习中的一些用语的主要内容,如果未能解决你的问题,请参考以下文章