文献阅读:Language Models are Unsupervised Multitask Learners

Posted Espresso Macchiato

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了文献阅读:Language Models are Unsupervised Multitask Learners相关的知识,希望对你有一定的参考价值。

1. 内容介绍

这篇文献就是OpenAI在2019年发表的大名鼎鼎的GPT2的文章,不过相较于GPT3,GPT2的影响力终究还是要小上不少,至少我印象中是这个样子。

而具体内容上来说,这篇文章整体上和GPT模型确实感觉好像没啥太大的差异,主要感觉还是改进了数据以及增大了模型参数量,没看出什么质上的区别……

不过这方面其实GPT3感觉也没啥太大的差别,可能真的就是more is different……

2. 模型介绍

下面,我们首先来看一下GPT2的整体模型以及训练数据。

如前所述,GPT2模型和GPT模型其实没啥本质上的差别,还是一个单向的Transformer Decoder模型,区别主要还是在训练数据以及模型的参数量上有了优化。

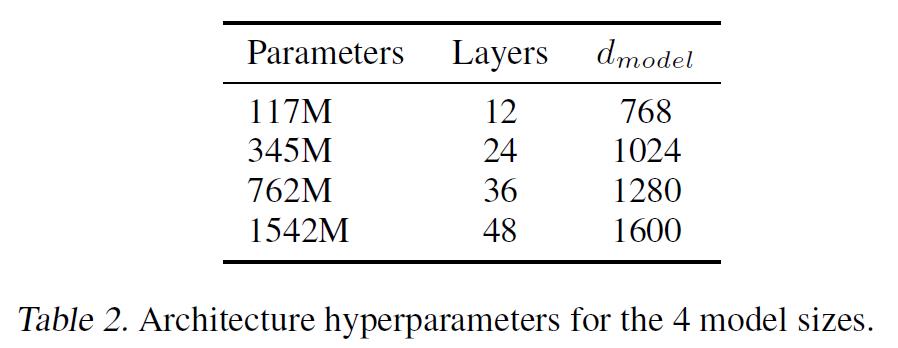

首先训练数据方面,这里使用WebText数据集,主要包括了800万个文件的共计40G的文本,而模型方面,其具体参数量详见下表:

3. 实验结果

下面,我们来考察一下GPT2的具体实验结果。

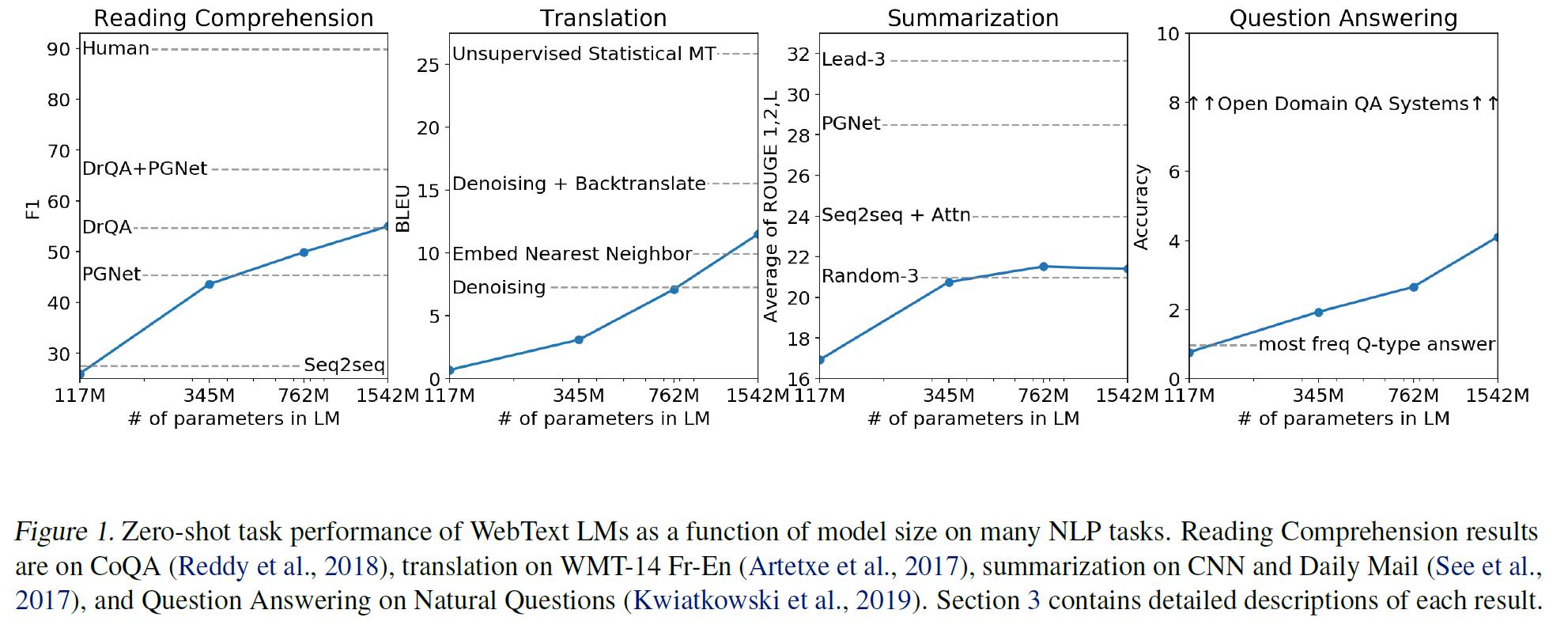

首先,我们给出整体的实验结果如下:

可以看到:

- 整体来说,随着参数量的增大,zero-shot的效果在各类任务上都是不断增加的。

下面,我们来分各个子任务对结果进行考察。

1. 语言模型

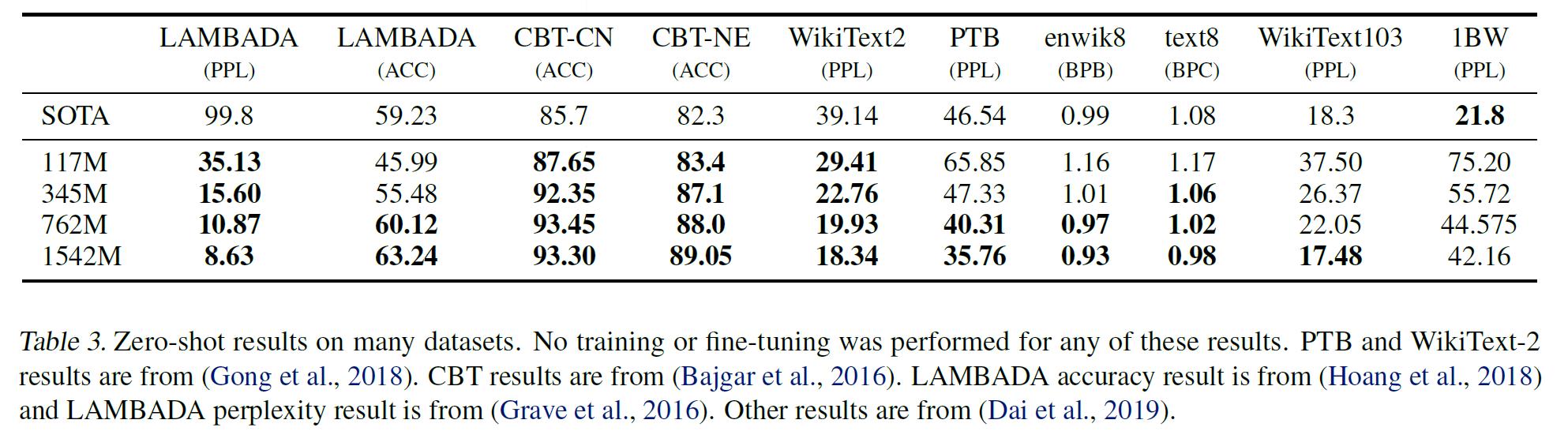

首先,我们来看一下GPT2的ppl效果:

可以看到:

- GPT2的PPL在各类数据集当中基本都达到了SOTA的结果;

- 随着模型的增大,模型的PPL是在持续减小的。

2. QA & 常识推断

同样的,给出GPT2模型在常识推断任务当中的结果如下:

可以看到,其整体效果是很好的。

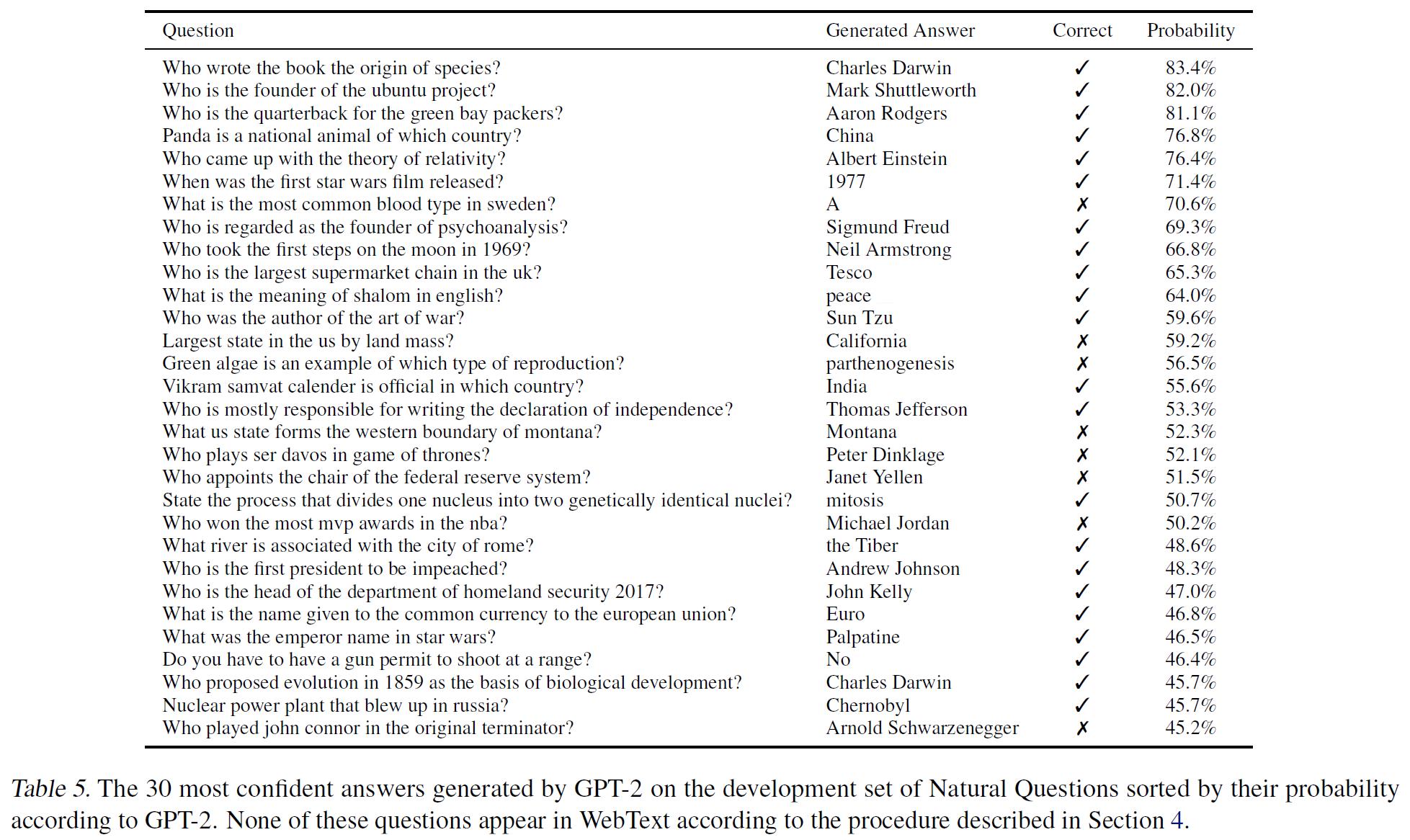

文中还给出了一些样例如下:

3. 生成任务

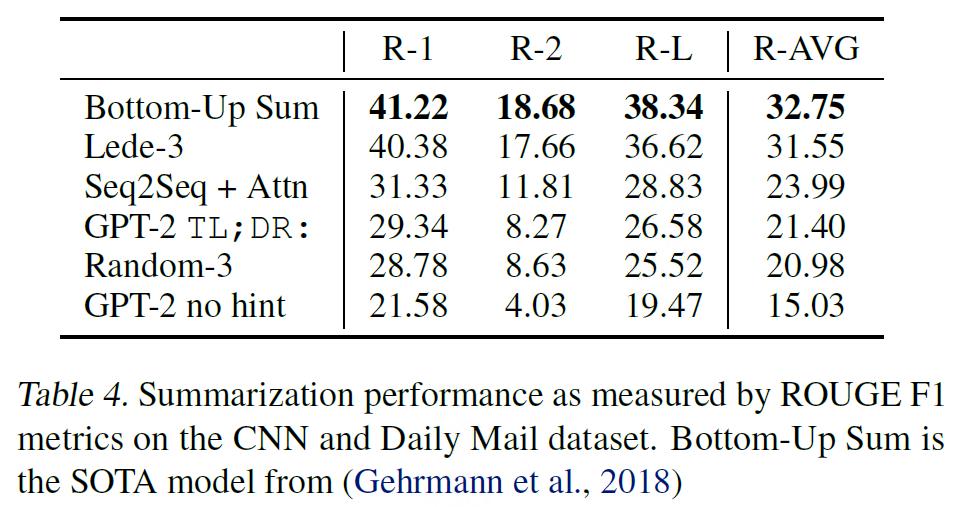

最后,文中还给出了生成任务的Rouge指标如下。

4. 总结 & 思考

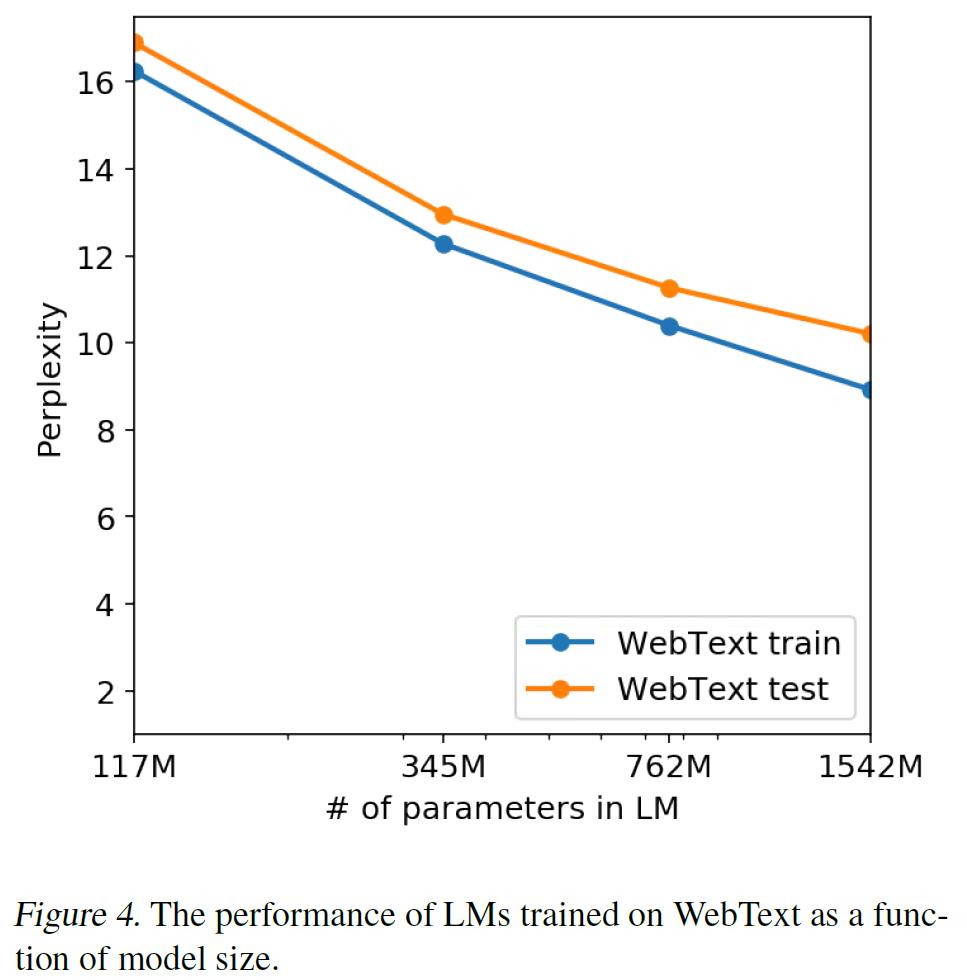

综上,GPT2较之GPT模型其实没啥本质上的差别,感觉还是在优化训练数据以及扩展模型,在探索基于Transformer的LLM的极限。

从GPT2的实验来看,其结果还远没有达到极限,因此后续才会有进一步的GPT3等模型的提出。

以上是关于文献阅读:Language Models are Unsupervised Multitask Learners的主要内容,如果未能解决你的问题,请参考以下文章