论文阅读 SV-RCNet: Workflow Recognition From Surgical Videos Using Recurrent Convolutional Network

Posted WXiujie123456

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文阅读 SV-RCNet: Workflow Recognition From Surgical Videos Using Recurrent Convolutional Network相关的知识,希望对你有一定的参考价值。

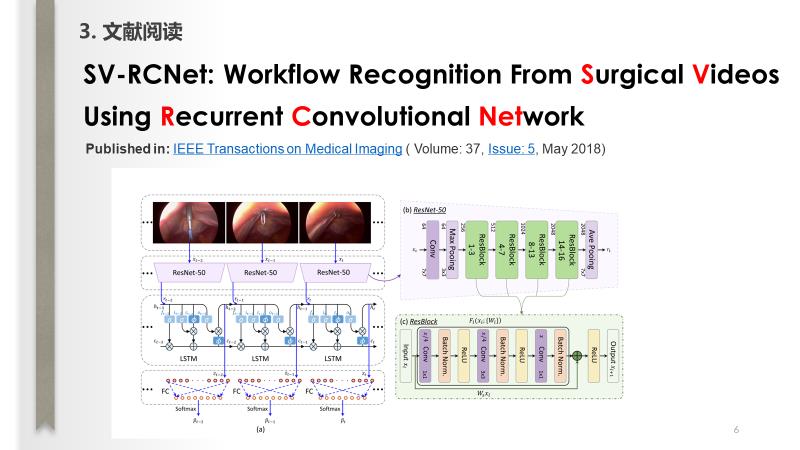

SV-RCNet: Workflow Recognition From Surgical Videos Using Recurrent Convolutional Network

IEEE Transactions on Medical Imaging 2018

task

手术工作流识别

阅读记录

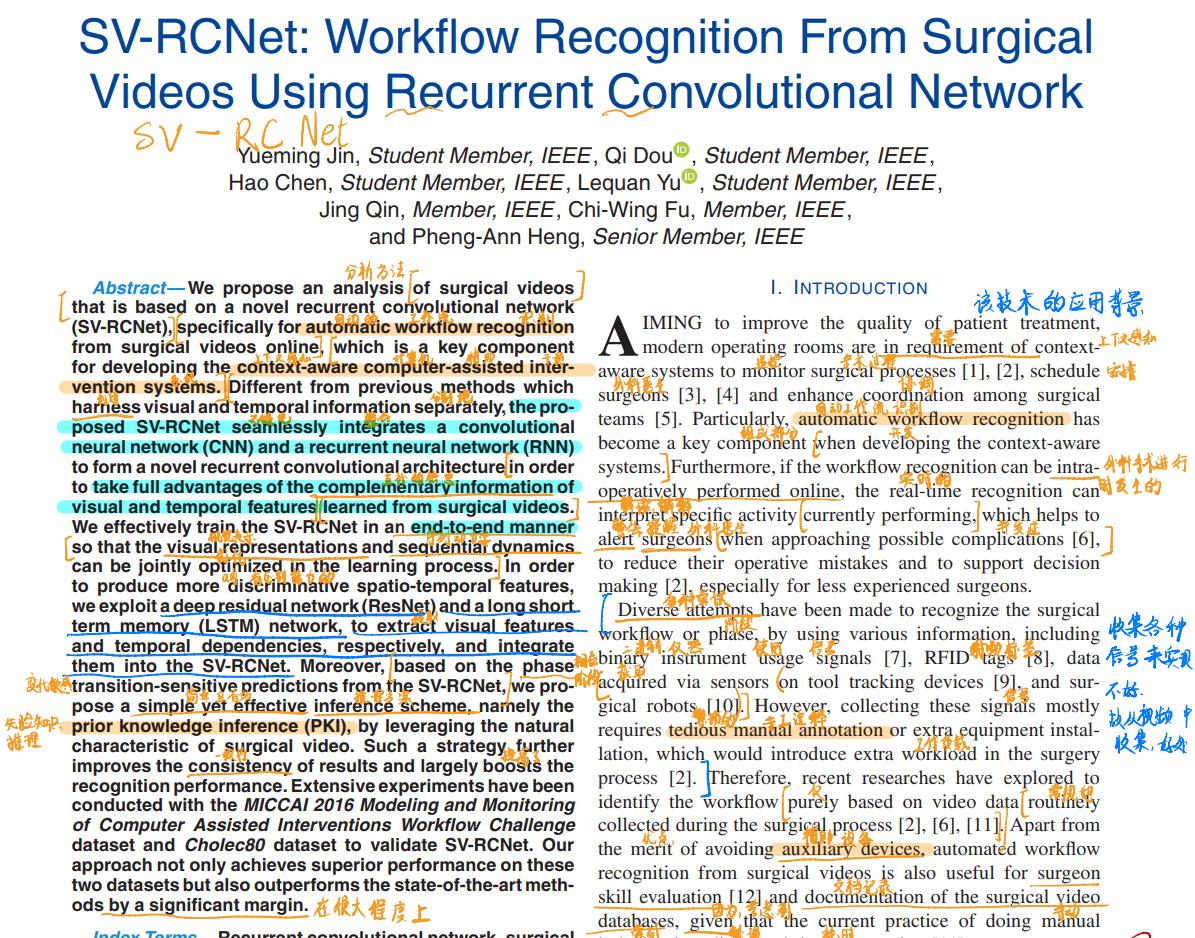

对于第一个视频片段,这个视频片段的相位标签是P1。第二行显示ResNet-50的注意图,它更关注分布在图像底部的脂肪区域。因此,对ground truth的预测相当低,这些帧被错误地预测为P0。第三行是分别训练的ResNet-50+LSTM模型的注意图,该网络的注意逐渐从脂肪区转移到胆囊和手术器械,这是工作流识别的重要线索。因此,预测不断增加,最终正确分类第三帧。最后一行显示了从我们的SV-RCNet注意力地图,能够成功地集中注意的关键线索的三张照片,证明,联合时空训练,SV-RCNet能够产生更多的歧视表示编码的视觉和时间信息。

同样,第二个带有P3相位标签的视频片段中的注意图也显示了时间线索以及视觉和时间特征联合优化的重要性。看这个视频剪辑的第三个画面,重要的分类线索(手术工具:剪刀)几乎从画面中消失。ResNet-50由于只依赖单一帧信息,忽略了工具信息,错误地将其归类为P2。相比之下,单独训练的ResNet-50+LSTM模型可以感知这些信息。但是,注意区域仍然是分散的,因此该模型不能获得较高的预测可信度。相反,我们的SV-RCNet的注意区域更紧凑,与正确的相位类别相关,因此我们的方法具有更高的置信度。

第三个带有P7标签的视频片段中的注意图也清楚地展示了时空特征学习的优越性。从前两行可以看出,ResNet-50和单独训练的ResNet-50+LSTM模型在前两帧和工具几乎消失时关注的是手术工具和背景。虽然它们的注意区域包含了一些重要的视觉信息,但由于P0和P7之间帧场景的方差较低(见图8),这两个模型无法根据底层特征识别帧。相比之下,我们的SV-RCNet不仅关注手术工具,还能根据时空特征感知手术工具的运动路径。也就是说,它可以区分工具的运动方向,即输入到患者身上或收回到患者身上。因此,可以正确地识别出相位间方差有限的帧。

说明

以上内容均为作者本人平时阅读并且汇报使用,内容整理全凭个人理解,如有侵权,请联系我;内容如有错误,欢迎留言交流。转载请注明出处,并附有原文链接,谢谢!

此外,我还喜欢用ipad对论文写写画画(个人英文阅读的水平有限),做一些断句、重点勾画等,有兴趣大家可以按需下载:链接

更多论文分享,请参考: 深度学习相关阅读论文汇总(持续更新)

以上是关于论文阅读 SV-RCNet: Workflow Recognition From Surgical Videos Using Recurrent Convolutional Network的主要内容,如果未能解决你的问题,请参考以下文章