论文笔记:Modeling Long- and Short-Term Temporal Patterns with Deep Neural Networks

Posted UQI-LIUWJ

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文笔记:Modeling Long- and Short-Term Temporal Patterns with Deep Neural Networks相关的知识,希望对你有一定的参考价值。

SIGIR 2018

使用CNN和RNN进行时间序列预测

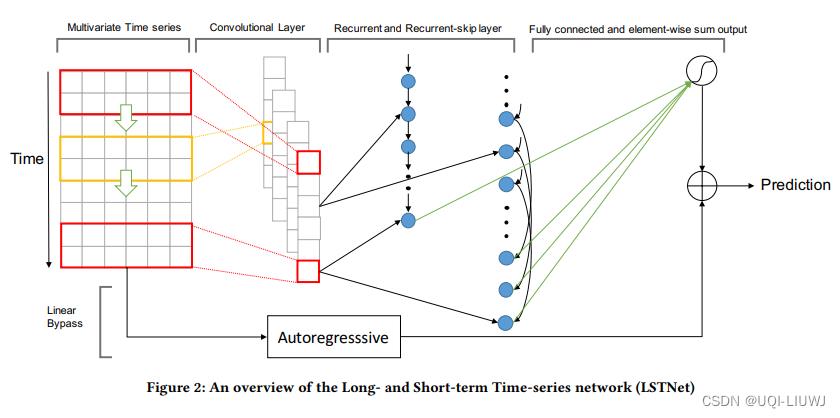

1 整体模型部分

输入 ,预测未来的h个时间片的信息

,预测未来的h个时间片的信息

2 卷积组件

-

由k个宽度维w,高度为n的卷积核作为filter

-

提取时间维度上的短期模式以及变量之间的局部依赖关系

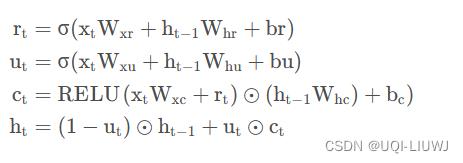

3 RNN组件

使用GRU,对卷积的输出进行学习,提取时序特征

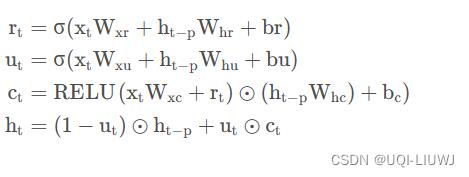

4 递归-跳过层

- 传统的GRU难以捕捉长期模式,论文涉及了递归-跳过层,通过间隔采样的方式,在采样序列长度不变的情况下,回看更长的时间,以此来捕获长期特征。

- 将GRU的t-1替换成t-p

5 全连接层

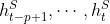

- 通过一个全连接层将递归组件和递归-跳过组件的输出组合起来

- 全连接层的输入包括:时间戳t的递归组件的输出

、递归-跳过组件从时间戳t-p+1到t的p个隐藏状态

、递归-跳过组件从时间戳t-p+1到t的p个隐藏状态

6 时间注意力层

- 递归-跳过层需要一个预定义的超参数 p

- 当时间序列没有周期性/周期长度随时间变化时,会影响模型的效果

- 为了解决这个问题,论文提出了用注意力机制替换递归-跳过层

- 当前时间戳t处的注意力权重

的计算方式是:

的计算方式是:

是GRU隐藏特征向量的拼接

是GRU隐藏特征向量的拼接

- 当前时间戳t处的注意力权重

- 时间注意力层的输出是

- 此时全连接层的计算方式变为:

7 自回归组件

- 由于卷积组件和递归组件的非线性性质,神经网络模型的一个主要缺点是对于局部的极端变化不敏感(左图这个样子)

- 解决方法是将LSTNet的最终预测分解为一个线性部分和一个非线性部分,其中线性部分主要关注局部变化,而非线性部分关注全局模式

- 线性部分:

- 线性部分:

- LSTNet的最终预测:

以上是关于论文笔记:Modeling Long- and Short-Term Temporal Patterns with Deep Neural Networks的主要内容,如果未能解决你的问题,请参考以下文章