Android流媒体开发之路二:NDK开发Android端RTMP直播推流程序

Posted HBStream 12年专注直播点播、网络视频技术

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了Android流媒体开发之路二:NDK开发Android端RTMP直播推流程序相关的知识,希望对你有一定的参考价值。

NDK C++开发android端RTMP直播推流程序

经过一番折腾,成功把RTMP直播推流代码,通过NDK交叉编译的方式,移植到了Android下,从而实现了Android端采集摄像头和麦克缝数据,然后进行h264视频编码和aac音频编码,并发送到RTMP服务器,从而实现Android摄像头直播。程序名为NdkRtmpEncoder,在这里把整个过程,和大体框架介绍一下,算是给需要的人引路。

开发思路

首先,为什么要用NDK来做,因为自己之前就已经实现过RTMP推流、RTMP播放、RTSP转码等等各种c++实现的流媒体项目,有很成熟的代码模块。既然Android有NDK,可以JNI的方式复用之前的成熟代码,大大拓展和加快项目实现,那为什么不这样去做呢。和其他平台一样,要实现采集摄像头推送直播流,需要实现以下几点

- 获取Android摄像头数据

- 对摄像头数据进行h264编码

- 编码后数据以RTMP协议封装数据并推送

下面分开来讲开发思路:

- Android端采集摄像头原始数据,可以在Java层通过Camera2获取数据,也可以用NativeCamera通过NDK来获取,不过后者需要的版本高一些,我考虑了一下,还是决定通过Java层获取数据,然后再交给下层处理。

- h264编码,可以通过AndroidMediaCodec进行硬件编码,也可以通过x264进行软件编码,这里因为要复用以前的代码,决定使用软件编码来验证

- RTMP协议封装,这部分代码,直接使用之前的C++代码即可,本身就是平台无关的,NDK也是linux环境开发,socket网络通信都是相通的。具体可以参考我之前的文章“C++实现RTMP协议发送H.264编码及AAC编码的音视频”

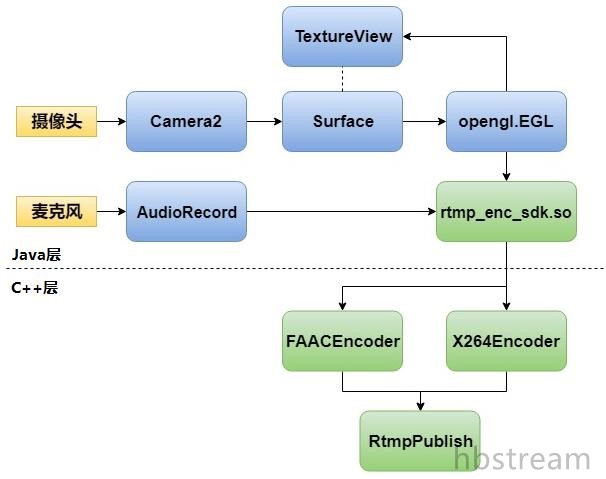

程序框架

根据我的开发思路,程序框架就显而易见了:

这里省略了部分内容,比如在so动态库之上,有一层封装模块,供Activity调用

-

Java层的主要做数据采集。对摄像头,通过Camera2接口,获取到更新的Surface,并转交给Opengl.EGL进行绘制,数据被绘制到TextureView的SurfaceTexture上,同时将RGB原始数据回调给Activity,由Activity把数据转交给动态库。 关于Camera2接口获取摄像头数据,可以参考之前的文章“Android流媒体开发之路一:Camera2采集摄像头原始数据并手动预览”,不同的是,那篇文章里直接使用ImageReader的Surface,这里使用的是自定义的Surface。

-

C++层实现对原始数据进行编码,并按照RTMP数据包进行封装,然后推送到RTMP服务器。这部分可以参考以前的文章“C++实现RTMP协议发送H.264编码及AAC编码的音视频”。

交叉编译

这部分也是主要工作之一,c++代码要想在Android上使用,必须编译成动态库,然后让APP通过JNI来调用。本质上,Android也是linux嘛,所以跟其他嵌入式arm-linux的交叉编译方式,本质上是差不多的,当然,前提是系统内布置好交叉编译环境。熟悉NDK的应该都知道,Google提供了完整的编译工具链,也包括SDK,下载地址在这里:“NDK Downloads”。我是在Ubuntu Linux上来做的,所以选择“Linux 64-bit(x86)”版本,记得Linux环境必须是64位,不然你什么都编译不了。

解压后其实就可以开始了。不过这里还是有两种编译方式:第一种就是类似其他arm-linux环境,配置好交叉编译工具链环境,然后直接按照普通的linux编译方式进行编译;第二种是编写Android.mk文件,然后用NDK里提供的ndk-build脚本进行编译。

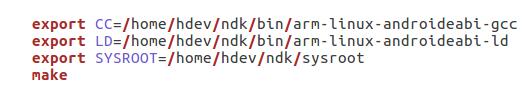

1. 工具链方式

对第一种方式来说其实比较简单,安装好交叉编译工具链之后,配置一下环境,就可以编译了。比如如下配置

这样基本就可以了,当然不同项目可能还需要进一步的修改配置,make之前需要执行configure等,但大致如此。

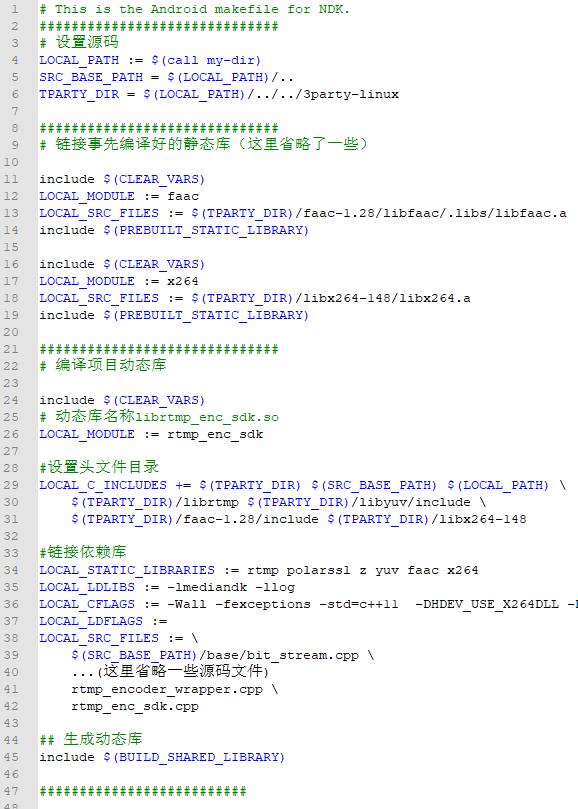

2. ndk-build方式

对Android.mk来说,跟Makefile差别是很大的,有它自己的语法,它在整个编译过程中的位置,可能更接近于automake工具里Makefile.am。关于它的语法,参见我下面的mk文件,做了一些注释,可以帮助理解,具体的语法可以参考官方网站Android Developer。我在这里把我rtmp_enc_sdk.so动态库的Android.mk的主要内容贴出来,大家可作参考。

模式基本是一样的,按照这个模板,修改成你自己项目里使用并不困难。

关键代码

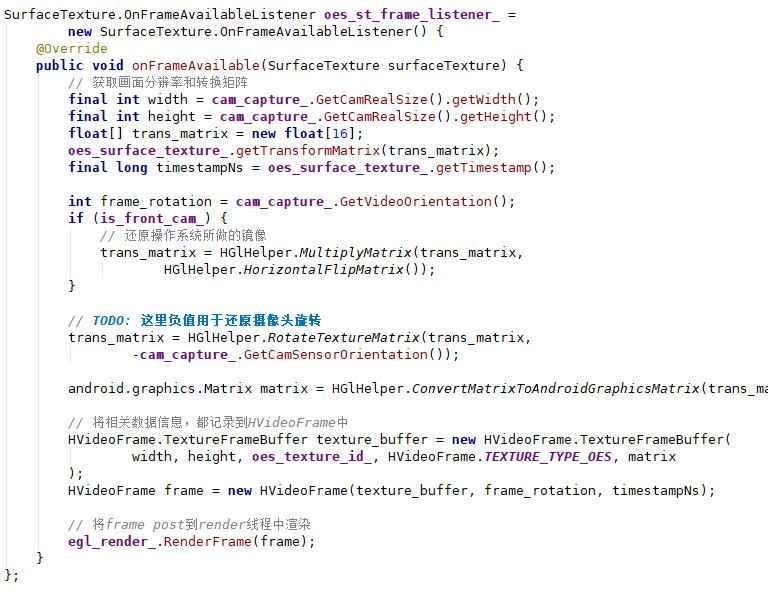

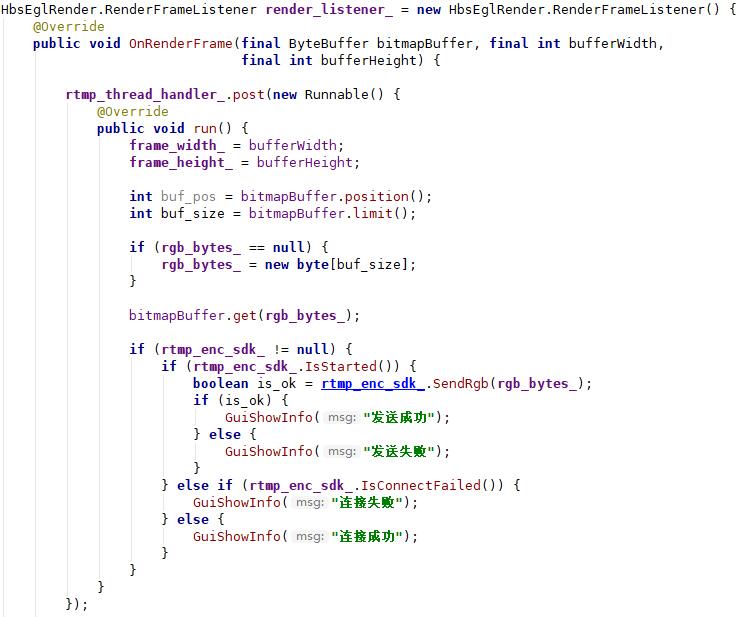

不管是Java层还是C++层的代码其实都不少,不过之前几篇文章里已经有关于他们的逻辑结构和实现方法的介绍,有兴趣的可以参考,按照文章里写的架构去理解,相信都可以实现。我这里把Java层对摄像头捕获到数据以后的处理逻辑的代码贴一下。

1 当TextureView有效之后,开始创建工作。首先要生成一个OES SurfaceTexture,后面要把它传递给Camera2接口,用于接收摄像头画面,之后开始创建RTMP推流模块调用线程,并创建摄像头捕获模块,和渲染模块

2 当OESTexture画面有效之后,获取摄像头画面的实际分辨率,以及旋转矩阵,画面旋转信息等,封装在一起,交给EGLRender,通知渲染模块进行画面渲染

3 渲染模块绘制完数据后,读取RGB原始数据并回调,在这里交给Rtmp发送线程,调用动态库,完成最后h264编码,并推送到RTMP服务器,这下面就是c++层so动态库做的事情了

运行效果

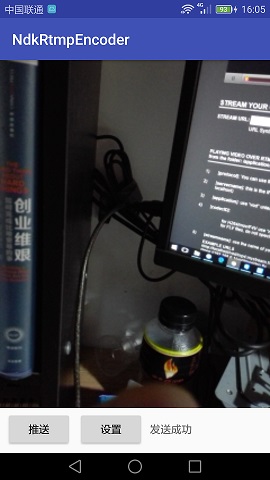

在手机端RTMP推流画面:

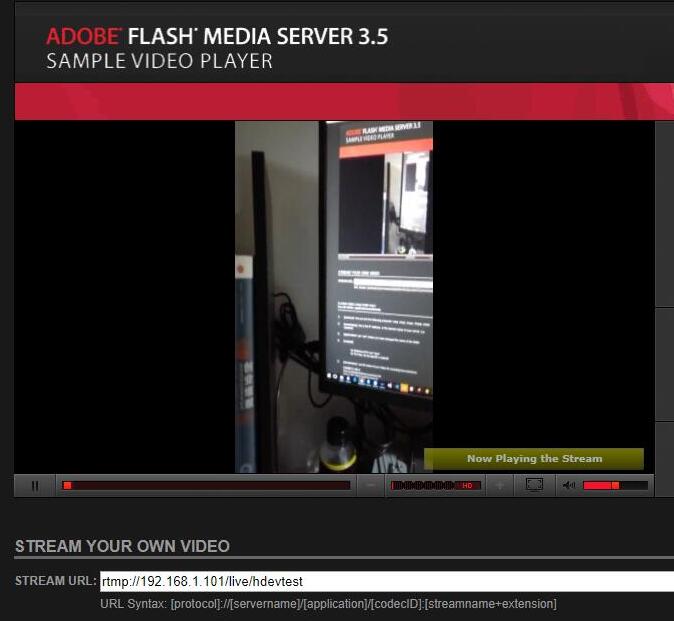

在PC上用flash播放RTMP直播画面:

haibindev.cnblogs.com,合作请联系QQ。(转载请注明作者和出处~)

haibindev.cnblogs.com,合作请联系QQ。(转载请注明作者和出处~)

以上是关于Android流媒体开发之路二:NDK开发Android端RTMP直播推流程序的主要内容,如果未能解决你的问题,请参考以下文章